ps:此文中的局部全局自适应搜索方案跟我想的简直一模一样啊

分类&跟踪 的区别

分类任务 跟踪任务

100类 没有固定类别

识别任务 矩阵学习+边界框回归

输入 图片 视频

DaSiamRPN 基于对siamRP的缺点的解决

![]()

存在的问题:

1 视频检测数据集 20 for VID 和 30 foryoutube -BB 有很少的类别,不足以训练高质量的广义feature

2 两个训练数据上的不平衡: 非语义背景 和 语义错误选择

3 大多跟踪器为短期场景量身定做,这里目标总是出现

解决办法:

1 通过 增加 ImageNet Detection 和 COCO Detection数据集 增加正样本对 的类别

2 消除训练样本分布的不不平衡

3 定制针对视觉跟踪的 有效数据增广

4 通过介绍一个简单而有效的局部-全局 搜索区域策略(自适应) 增加 长期跟踪 能力

ImageNet Detection

COCO Detection

imbalance

non-semantic

semantic

distractor

tailored

scenario

eliminate

distribution

generalized

customizing 定制

augmentation 增加

红色负样本太简单(语义信息太少),这样只能让 分清前景背景。

ImageNet Detection 和 COCO Detection 的数据充当正样本,增强分类器的泛化能力

Distractor-aware training 能意识到错误选择的训练

1 不同类的正样本能增强泛化能力

2 有语义的负样本能增加区分能力 (b)同类的负样本 (c)不同类别的负样本(北极熊,猫)

3 为视觉跟踪定制有效数据增广(平移,旋转,光照,运动模糊)

SiamRPN中跟丢了,但是得分还是很高

DaSiamRPN中跟丢了,但是得分降低

高质量跟踪分数,扩大搜索区域,当目标从新出现可以及时跟上

snapshot 快照

ablation 消融

检测数据的正样本

有语义的负样本

能意识到错误 更新

长时跟踪目标

实验

UAV20L

AUC 0.617

20像素 precision 0.838

UAV123

AUC 0.586

20像素 precision 0.796

2018 72种算法

成熟算法抠图,拟合框,漏含里面的背景&漏在外面的前景 加权和最小

通过protocol协议与他的工具箱交互,跟踪失败后会被重启

鲁棒性(重启的次数)

精度(平均期望框和跟踪框重叠率)

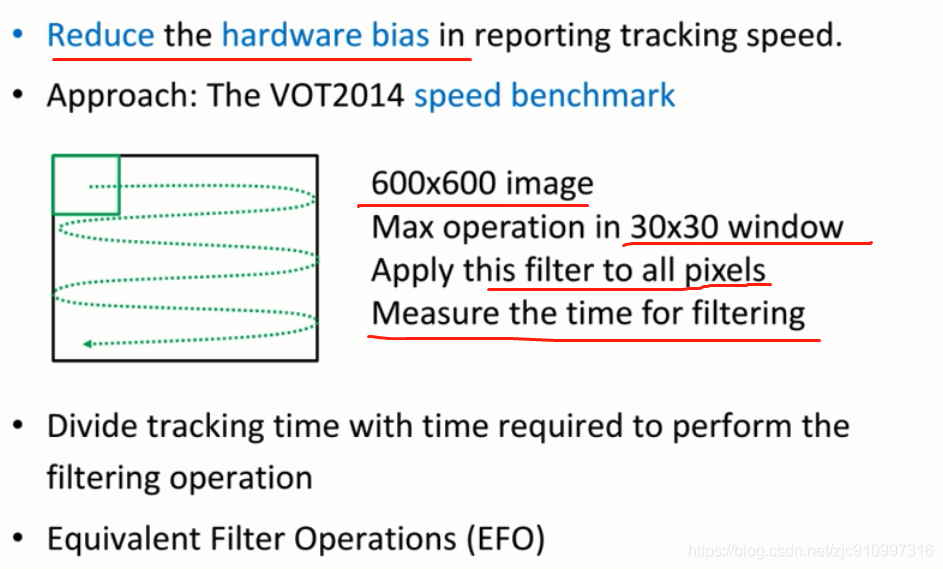

EFO 归一化思路指标,600 600做30 30 滤波操作,以此时间评价电脑性能,归一化算法的速度

实时比赛

实时比赛

长时比赛

平均每段视频12次丢失,每次丢失40帧

absence 缺失

起作用的尝试

不起作用的尝试

F score 0.607

实时

LT长时