介绍

上面讲到使用求解偏导的方式获取目标函数的最小值,但是却并不是所有的目标函数都能够通过求偏导的方式获取到最小值的,这个时候就需要这里讲到的梯度下降的方法;机器学习的套路就是交给机器一堆数据,然后告诉什么样的学习方式是正确的(目标函数),然后让机器朝这个方向去做

这里讲到的梯度,其实理解起来就是偏导,当给定一个目标函数,并且给定了一个起始值,这个时候朝着它切线的方式进行移动才会是最快的(移动的最快也就标识着能够更快的将结果求解出来)

梯度下降的操作流程

1、找到当前最合适的方向

2、走那么一小步,走快了可能取不到最小值

3、按照方向和步伐去更新参数

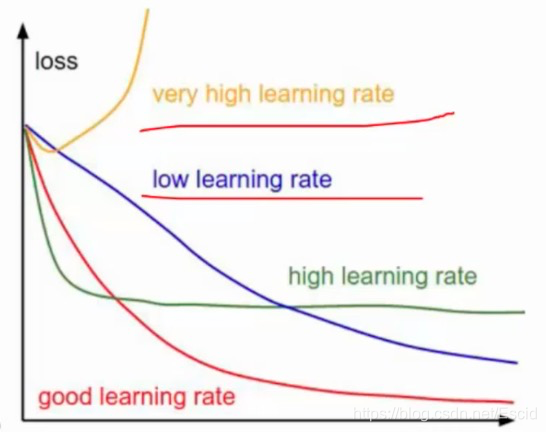

学习率(步长):对结果会产生巨大的影响,一般小一些;一般情况下选用0.01开始,如果并没有收敛的话,可以将学习率再调小到0.001(经验)

如何选择:从小的时候,不行再小

批处理数据:32,64,128都可以,很多时候还得考虑内存和效率(现在一般选择64)

上面讲到了学习率,其实在现在一种处理的方式就是在开始的时候将学习率调整的较大点,这样能够较快进行计算,之后慢慢将学习率降低,这样能够保证最后的一个收敛性