Introduction

预测股市将如何表现是最困难的事情之一。 预测中涉及的因素很多 - 物理因素与生理因素,理性行为和非理性行为等有关。所有这些因素共同导致股价波动,很难以高精度预测。

我们可以将机器学习作为该领域的游戏规则改变者吗? 利用有关组织的最新公告,季度收入结果等功能,机器学习技术有可能发掘出我们以前没有看到的模式和见解,并且可以用来做出准确无误的预测。

在本文中,我们将使用有关上市公司股票价格的历史数据。 我们将实施混合的机器学习算法来预测该公司的未来股票价格,从平均和线性回归等简单算法开始,然后转向Auto ARIMA和LSTM等高级技术。

本文背后的核心思想是展示如何实现这些算法。 我将简要介绍该技术并提供相关链接,以便在必要时了解这些概念。 如果你是时间序列世界的新手,我建议首先阅读以下文章:

A comprehensive beginner’s guide to create a Time Series Forecast

A Complete Tutorial on Time Series Modeling

Free Course: Time Series Forecasting using Python

Table of Contents

- 理解问题陈述

- 移动平均线

- 线性回归

- k-Nearest Neighbors

- 自动ARIMA

- 预言家

- 长期短期记忆(LSTM)

Understanding the Problem Statement

我们很快就会深入探讨本文的实现部分,但首先要确定我们要解决的问题。从广义上讲,股票市场分析分为两部分 - 基本面分析和技术分析。

- 基本面分析涉及根据当前的商业环境和财务业绩分析公司未来的盈利能力。

- 另一方面,技术分析包括阅读图表和使用统计数据来确定股票市场的趋势。

您可能已经猜到了,我们的重点将放在技术分析部分。我们将使用Quandl的数据集(您可以在这里查找各种股票的历史数据),对于这个特定项目,我使用了’Tata Global Beverages’的数据。是时候潜入了!

注意:以下是我用于代码的数据集:下载

我们将首先加载数据集并为问题定义目标变量:

#import packages

import pandas as pd

import numpy as np

#to plot within notebook

import matplotlib.pyplot as plt

%matplotlib inline

#setting figure size

from matplotlib.pylab import rcParams

rcParams['figure.figsize'] = 20,10

#for normalizing data

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler(feature_range=(0, 1))

#read the file

df = pd.read_csv('NSE-TATAGLOBAL(1).csv')

#print the head

df.head()

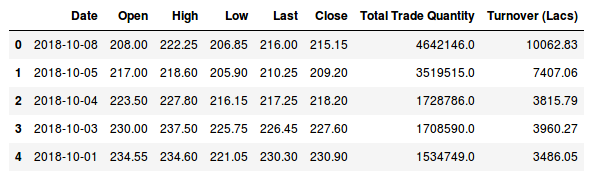

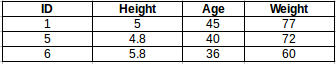

数据集中有多个变量 - date,open,high,low,last,close,total_trade_quantity和turnover。

- “开盘”和“关闭”列表示股票在特定日期交易的起始和最终价格。

- 高,低和最后代表当天股票的最高,最低和最后价格。

- 总交易数量是当天买入或卖出的股票数量,而营业额(Lacs)是特定公司在特定日期的营业额。

另一个需要注意的重要事项是市场在周末和公共假期关闭。再次注意上表,一些日期值缺失 - 2/10/201,6/10/201,7/10/201。 在这些日期中,第二个是国定假日,第六个和第七个是周末。

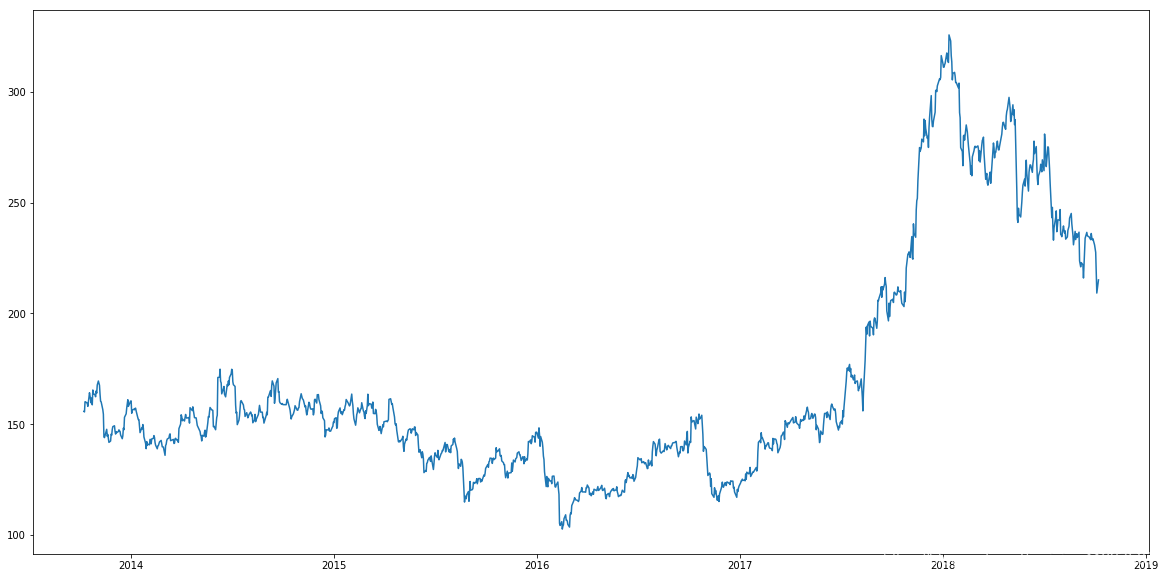

损益计算通常由当天股票的收盘价确定,因此我们将收盘价视为目标变量。 让我们绘制目标变量,以了解它在我们的数据中是如何形成的:

#setting index as date

df['Date'] = pd.to_datetime(df.Date,format='%Y-%m-%d')

df.index = df['Date']

#plot

plt.figure(figsize=(16,8))

plt.plot(df['Close'], label='Close Price history')

在接下来的部分中,我们将探索这些变量并使用不同的技术来预测股票的每日收盘价。

Moving Average

Introduction

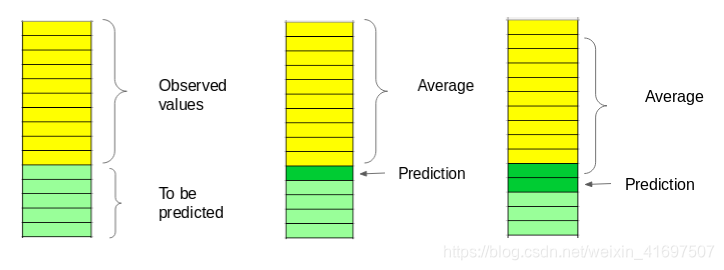

“平均”很容易成为我们日常生活中最常见的事情之一。 例如,计算平均标记以确定整体性能,或者找出过去几天的平均温度以了解今天的温度 - 这些都是我们定期执行的常规任务。 因此,这是用于我们的数据集进行预测的良好起点。

每天的预测收盘价将是一组先前观察到的值的平均值。 我们将使用移动平均技术而不是使用简单平均值,该技术使用每个预测的最新值集。 换句话说,对于每个后续步骤,在从集合中移除最老的观测值的同时考虑预测值。 这是一个简单的图形,可以帮助您更清晰地理解这一点。

我们将在我们的数据集上实现此技术。 第一步是创建一个仅包含Date和Close price列的数据框,然后将其拆分为train和validation集以验证我们的预测。

Implementation

#creating dataframe with date and the target variable

data = df.sort_index(ascending=True, axis=0)

new_data = pd.DataFrame(index=range(0,len(df)),columns=['Date', 'Close'])

for i in range(0,len(data)):

new_data['Date'][i] = data['Date'][i]

new_data['Close'][i] = data['Close'][i]

在将数据拆分为训练和验证时,我们不能使用随机拆分,因为这会破坏时间组件。 所以我在这里将去年的数据设置为验证,将4年前的数据设置为训练。

#splitting into train and validation

train = new_data[:987]

valid = new_data[987:]

new_data.shape, train.shape, valid.shape

((1235, 2), (987, 2), (248, 2))

train['Date'].min(), train['Date'].max(), valid['Date'].min(), valid['Date'].max()

(Timestamp('2013-10-08 00:00:00'),

Timestamp('2017-10-06 00:00:00'),

Timestamp('2017-10-09 00:00:00'),

Timestamp('2018-10-08 00:00:00'))

下一步是为验证集创建预测,并使用实际值检查RMSE。

#make predictions

preds = []

for i in range(0,248):

a = train['Close'][len(train)-248+i:].sum() + sum(preds)

b = a/248

preds.append(b)

Results

#calculate rmse

rms=np.sqrt(np.mean(np.power((np.array(valid['Close'])-preds),2)))

rms

104.51415465984348

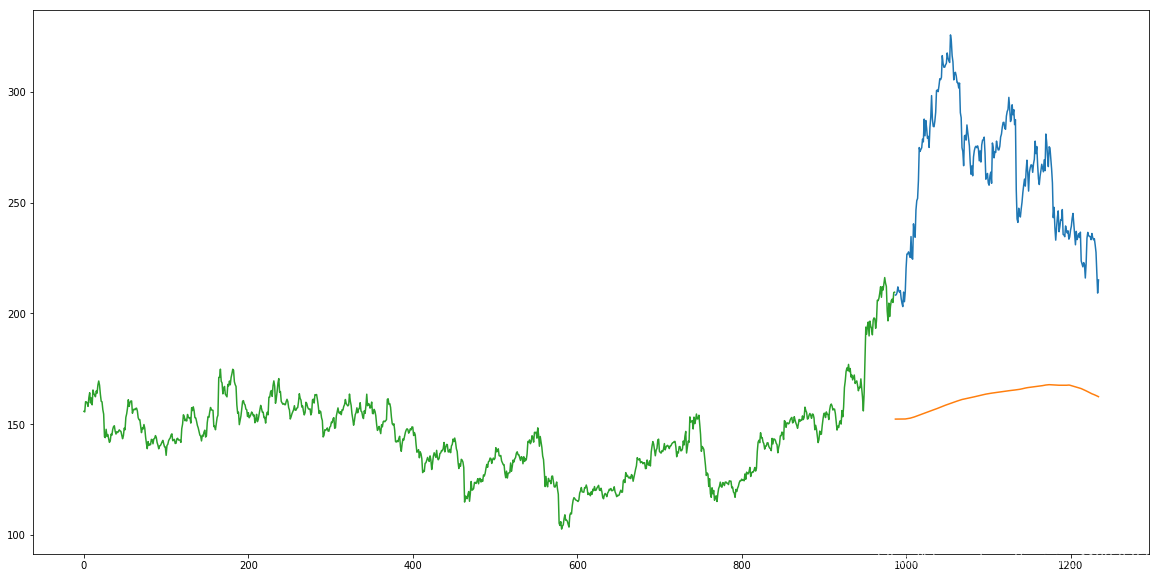

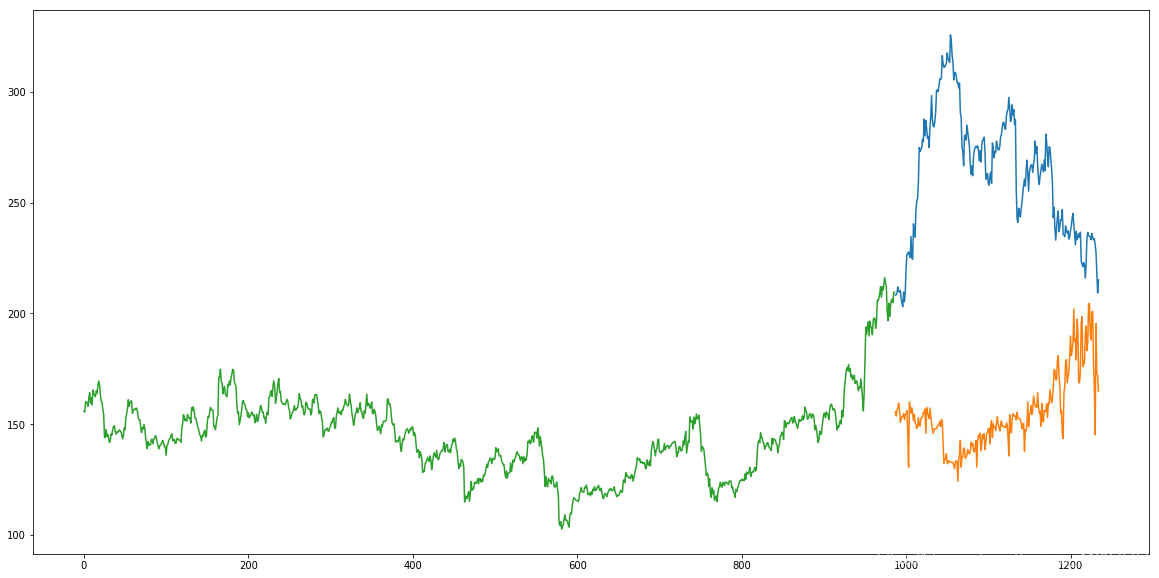

只检查RMSE并不能帮助我们理解模型的执行方式。 让我们将其可视化以获得更直观的理解。 因此,这是预测值与实际值的关系图。

#plot

valid['Predictions'] = 0

valid['Predictions'] = preds

plt.plot(train['Close'])

plt.plot(valid[['Close', 'Predictions']])

Inference

RMSE值接近105,但结果不是很有希望(你可以从图中收集)。 预测值与列车组中的观测值具有相同的范围(最初存在增加趋势,然后缓慢减小)。

在下一节中,我们将介绍两种常用的机器学习技术 - 线性回归和kNN,并了解它们对我们股票市场数据的表现。

Linear Regression

Introduction

可以在此数据上实现的最基本的机器学习算法是线性回归。 线性回归模型返回一个确定自变量和因变量之间关系的方程。

线性回归的等式可以写成:

这里,x1,x2,… xn表示独立变量,而系数θ1,θ2,…。 θn表示权重。 您可以参考以下文章更详细地研究线性回归:

对于我们的问题陈述,我们没有一组自变量。 我们只有日期而已。 让我们使用日期列来提取诸如 - 日,月,年,星期一/星期五等特征,然后拟合线性回归模型。

Implementation

我们将首先按升序对数据集进行排序,然后创建单独的数据集,以便创建的任何新要素不会影响原始数据。

#setting index as date values

df['Date'] = pd.to_datetime(df.Date,format='%Y-%m-%d')

df.index = df['Date']

#sorting

data = df.sort_index(ascending=True, axis=0)

#creating a separate dataset

new_data = pd.DataFrame(index=range(0,len(df)),columns=['Date', 'Close'])

for i in range(0,len(data)):

new_data['Date'][i] = data['Date'][i]

new_data['Close'][i] = data['Close'][i]

#create features

from fastai.structured import add_datepart

add_datepart(new_data, 'Date')

new_data.drop('Elapsed', axis=1, inplace=True) #elapsed will be the time stamp

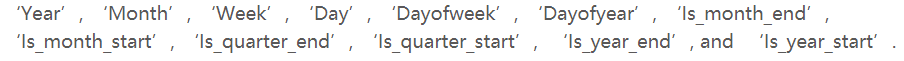

这会创建以下功能:

注意:我使用了fastai库中的add_datepart。 如果您没有安装它,只需使用命令pip install fastai。 否则,您可以在python中使用简单的for循环创建这些功能。 我在下面展示了一个例子。

除此之外,我们可以添加我们自己认为与预测相关的功能集。 例如,我的假设是,本周的第一天和最后一天可能会影响股票的收盘价,远远超过其他日子。 所以我创建了一个功能,可以确定某一天是周一/周五还是周二/周三/周四。 这可以使用以下代码行完成:

new_data['mon_fri'] = 0

for i in range(0,len(new_data)):

if (new_data['Dayofweek'][i] == 0 or new_data['Dayofweek'][i] == 4):

new_data['mon_fri'][i] = 1

else:

new_data['mon_fri'][i] = 0

如果星期几等于0或4,则列值将为1,否则为0.同样,您可以创建多个要素。 如果您对可以帮助预测股票价格的功能有一些想法,请在评论部分分享。

我们现在将数据拆分为训练集和验证集,以检查模型的性能。

#split into train and validation

train = new_data[:987]

valid = new_data[987:]

x_train = train.drop('Close', axis=1)

y_train = train['Close']

x_valid = valid.drop('Close', axis=1)

y_valid = valid['Close']

#implement linear regression

from sklearn.linear_model import LinearRegression

model = LinearRegression()

model.fit(x_train,y_train)

Results

#make predictions and find the rmse

preds = model.predict(x_valid)

rms=np.sqrt(np.mean(np.power((np.array(y_valid)-np.array(preds)),2)))

rms

121.16291596523156

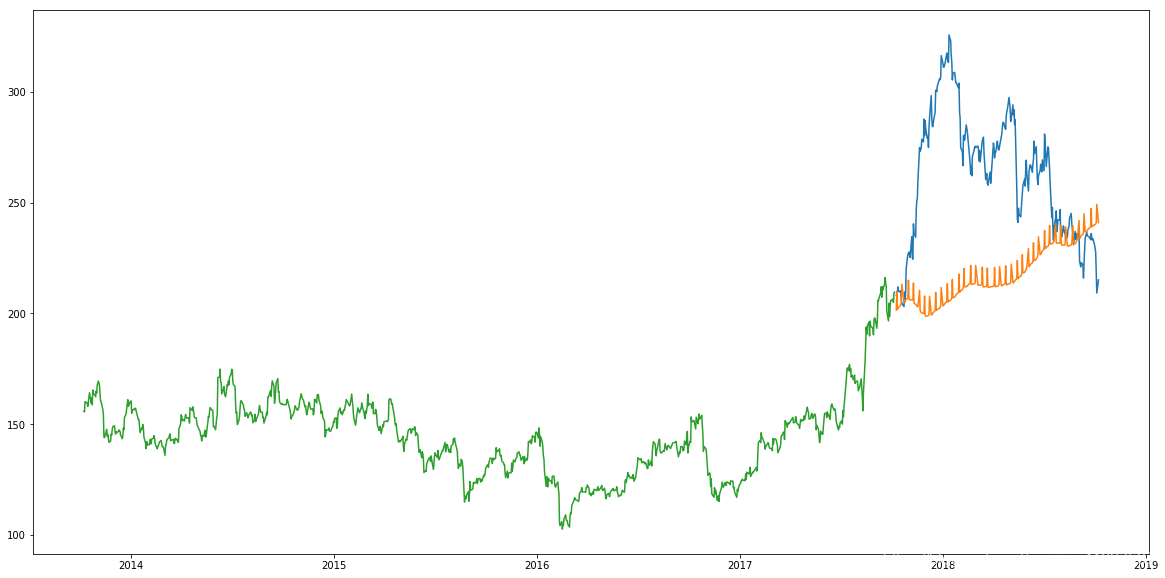

RMSE值高于之前的技术,这清楚地表明线性回归表现不佳。 让我们看一下情节,并理解为什么线性回归没有做得好:

#plot

valid['Predictions'] = 0

valid['Predictions'] = preds

valid.index = new_data[987:].index

train.index = new_data[:987].index

plt.plot(train['Close'])

plt.plot(valid[['Close', 'Predictions']])

Inference

线性回归是一种简单的技术,很容易解释,但有一些明显的缺点。 使用回归算法的一个问题是模型适应日期和月份列。 该模型不考虑预测点的先前值,而是考虑一个月前相同日期或一年前相同日期/月份的值。

从上图可以看出,2016年1月和2017年1月,股价出现下跌。 该模型预测2018年1月也是如此。线性回归技术可以很好地解决[Big Mart sales](https://datahack.analyticsvidhya.com/contest/practice-problem-big-mart-sales-iii /)等问题其中独立特征对于确定目标值是有用的。

k-Nearest Neighbours

Introduction

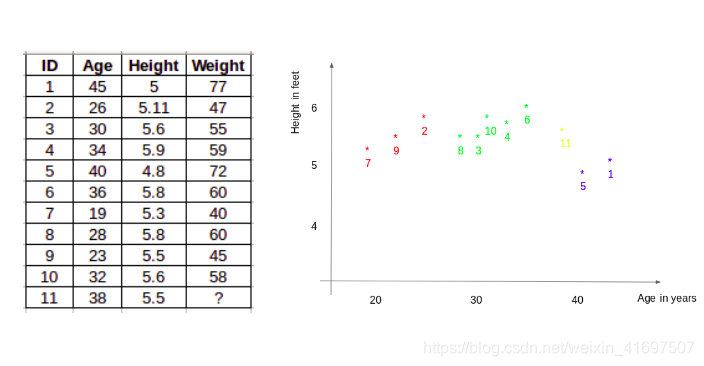

这里可以使用的另一个有趣的ML算法是kNN(k个最近邻居)。 基于自变量,kNN找到新数据点和旧数据点之间的相似性。 让我用一个简单的例子解释一下。

考虑11人的身高和年龄。 根据给定的特征(‘Age’和’Height’),表格可以用图形格式表示,如下所示:

为了确定ID#11的权重,kNN考虑该ID的最近邻居的权重。 ID#11的权重预计是其邻居的平均值。 如果我们现在考虑三个邻居(k = 3),ID#11的权重将是=(77 + 72 + 60)/ 3 = 69.66千克。

有关kNN的详细了解,请参阅以下文章:

Implementation

#importing libraries

from sklearn import neighbors

from sklearn.model_selection import GridSearchCV

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler(feature_range=(0, 1))

使用上一节中的相同训练和验证集:

#scaling data

x_train_scaled = scaler.fit_transform(x_train)

x_train = pd.DataFrame(x_train_scaled)

x_valid_scaled = scaler.fit_transform(x_valid)

x_valid = pd.DataFrame(x_valid_scaled)

#using gridsearch to find the best parameter

params = {'n_neighbors':[2,3,4,5,6,7,8,9]}

knn = neighbors.KNeighborsRegressor()

model = GridSearchCV(knn, params, cv=5)

#fit the model and make predictions

model.fit(x_train,y_train)

preds = model.predict(x_valid)

Results

#rmse

rms=np.sqrt(np.mean(np.power((np.array(y_valid)-np.array(preds)),2)))

rms

115.17086550026721

RMSE值没有太大差异,但预测值和实际值的图应提供更清晰的理解。

#plot

valid['Predictions'] = 0

valid['Predictions'] = preds

plt.plot(valid[['Close', 'Predictions']])

plt.plot(train['Close'])

Inference

RMSE值几乎与线性回归模型类似,并且图表显示相同的模式。 与线性回归一样,kNN也确定了2018年1月的下降,因为这是过去几年的模式。 我们可以有把握地说,回归算法在这个数据集上表现不佳。

让我们继续看看一些时间序列预测技术,以了解它们在面对股票价格预测挑战时的表现。

Auto ARIMA

Introduction

ARIMA是一种非常流行的时间序列预测统计方法。 ARIMA模型考虑了过去的值来预测未来的价值。 ARIMA有三个重要参数:

- p(用于预测下一个值的过去值)

- q(用于预测未来值的过去预测误差)

- d(差分的顺序)

ARIMA的参数调整会消耗大量时间。 因此,我们将使用自动ARIMA,它自动选择提供最小错误的(p,q,d)的最佳组合。 要阅读有关自动ARIMA如何工作的更多信息,请参阅此文章:

Implementation

from pyramid.arima import auto_arima

data = df.sort_index(ascending=True, axis=0)

train = data[:987]

valid = data[987:]

training = train['Close']

validation = valid['Close']

model = auto_arima(training, start_p=1, start_q=1,max_p=3, max_q=3, m=12,start_P=0, seasonal=True,d=1, D=1, trace=True,error_action='ignore',suppress_warnings=True)

model.fit(training)

forecast = model.predict(n_periods=248)

forecast = pd.DataFrame(forecast,index = valid.index,columns=['Prediction'])

Results

rms=np.sqrt(np.mean(np.power((np.array(valid['Close'])-np.array(forecast['Prediction'])),2)))

rms

44.954584993246954

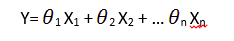

#plot

plt.plot(train['Close'])

plt.plot(valid['Close'])

plt.plot(forecast['Prediction'])

Inference

如前所述,自动ARIMA模型使用过去的数据来理解时间序列中的模式。 使用这些值,该模型捕获了该系列中的增长趋势。 虽然使用这种技术的预测远比先前实现的机器学习模型的预测好,但这些预测仍然不接近实际值。

从图中可以看出,该模型已经捕捉到了该系列中的一个趋势,但并没有关注季节性部分。 在下一节中,我们将实现一个时间序列模型,该模型考虑了系列的趋势和季节性。

Prophet

Introduction

有许多时间序列技术可以在股票预测数据集上实现,但是大多数这些技术在拟合模型之前需要大量的数据预处理。 由Facebook设计和开创的先知是一个时间序列预测库,不需要数据预处理,实现起来非常简单。 Prophet的输入是一个包含两列的数据框:date和target(ds和y)。

先知试图捕捉过去数据中的季节性,并在数据集很大时很好地运作。 这是一篇有趣的文章,以简单直观的方式解释了先知:

Implementation

#importing prophet

from fbprophet import Prophet

#creating dataframe

new_data = pd.DataFrame(index=range(0,len(df)),columns=['Date', 'Close'])

for i in range(0,len(data)):

new_data['Date'][i] = data['Date'][i]

new_data['Close'][i] = data['Close'][i]

new_data['Date'] = pd.to_datetime(new_data.Date,format='%Y-%m-%d')

new_data.index = new_data['Date']

#preparing data

new_data.rename(columns={'Close': 'y', 'Date': 'ds'}, inplace=True)

#train and validation

train = new_data[:987]

valid = new_data[987:]

#fit the model

model = Prophet()

model.fit(train)

#predictions

close_prices = model.make_future_dataframe(periods=len(valid))

forecast = model.predict(close_prices)

Results

#rmse

forecast_valid = forecast['yhat'][987:]

rms=np.sqrt(np.mean(np.power((np.array(valid['y'])-np.array(forecast_valid)),2)))

rms

57.494461930575149

#plot

valid['Predictions'] = 0

valid['Predictions'] = forecast_valid.values

plt.plot(train['y'])

plt.plot(valid[['y', 'Predictions']])

Inference

先知(与大多数时间序列预测技术一样)试图从过去的数据中捕捉趋势和季节性。 此模型通常在时间序列数据集上表现良好,但在这种情况下无法达到它的声誉。

事实证明,股票价格没有特定的趋势或季节性。 它在很大程度上取决于市场目前的情况,从而价格上涨和下跌。 因此,像ARIMA,SARIMA和Prophet这样的预测技术对于这个特定问题不会显示出良好的结果。

让我们继续尝试另一种先进技术 - 长期短期记忆(LSTM)。

Long Short Term Memory (LSTM)

Introduction

LSTM广泛用于序列预测问题,并且已被证明是非常有效的。 他们工作得很好的原因是因为LSTM能够存储过去重要的信息,并忘记不重要的信息。 LSTM有三个门:

- 输入门:输入门将信息添加到单元状态

- 遗忘门:它删除模型不再需要的信息

- 输出门:LSTM的输出门选择要显示为输出的信息

有关LSTM及其架构的更详细的了解,您可以阅读以下文章:

现在,让我们将LSTM实现为黑盒子,并检查它在我们的特定数据上的性能。

Implementation

#importing required libraries

from sklearn.preprocessing import MinMaxScaler

from keras.models import Sequential

from keras.layers import Dense, Dropout, LSTM

#creating dataframe

data = df.sort_index(ascending=True, axis=0)

new_data = pd.DataFrame(index=range(0,len(df)),columns=['Date', 'Close'])

for i in range(0,len(data)):

new_data['Date'][i] = data['Date'][i]

new_data['Close'][i] = data['Close'][i]

#setting index

new_data.index = new_data.Date

new_data.drop('Date', axis=1, inplace=True)

#creating train and test sets

dataset = new_data.values

train = dataset[0:987,:]

valid = dataset[987:,:]

#converting dataset into x_train and y_train

scaler = MinMaxScaler(feature_range=(0, 1))

scaled_data = scaler.fit_transform(dataset)

x_train, y_train = [], []

for i in range(60,len(train)):

x_train.append(scaled_data[i-60:i,0])

y_train.append(scaled_data[i,0])

x_train, y_train = np.array(x_train), np.array(y_train)

x_train = np.reshape(x_train, (x_train.shape[0],x_train.shape[1],1))

# create and fit the LSTM network

model = Sequential()

model.add(LSTM(units=50, return_sequences=True, input_shape=(x_train.shape[1],1)))

model.add(LSTM(units=50))

model.add(Dense(1))

model.compile(loss='mean_squared_error', optimizer='adam')

model.fit(x_train, y_train, epochs=1, batch_size=1, verbose=2)

#predicting 246 values, using past 60 from the train data

inputs = new_data[len(new_data) - len(valid) - 60:].values

inputs = inputs.reshape(-1,1)

inputs = scaler.transform(inputs)

X_test = []

for i in range(60,inputs.shape[0]):

X_test.append(inputs[i-60:i,0])

X_test = np.array(X_test)

X_test = np.reshape(X_test, (X_test.shape[0],X_test.shape[1],1))

closing_price = model.predict(X_test)

closing_price = scaler.inverse_transform(closing_price)

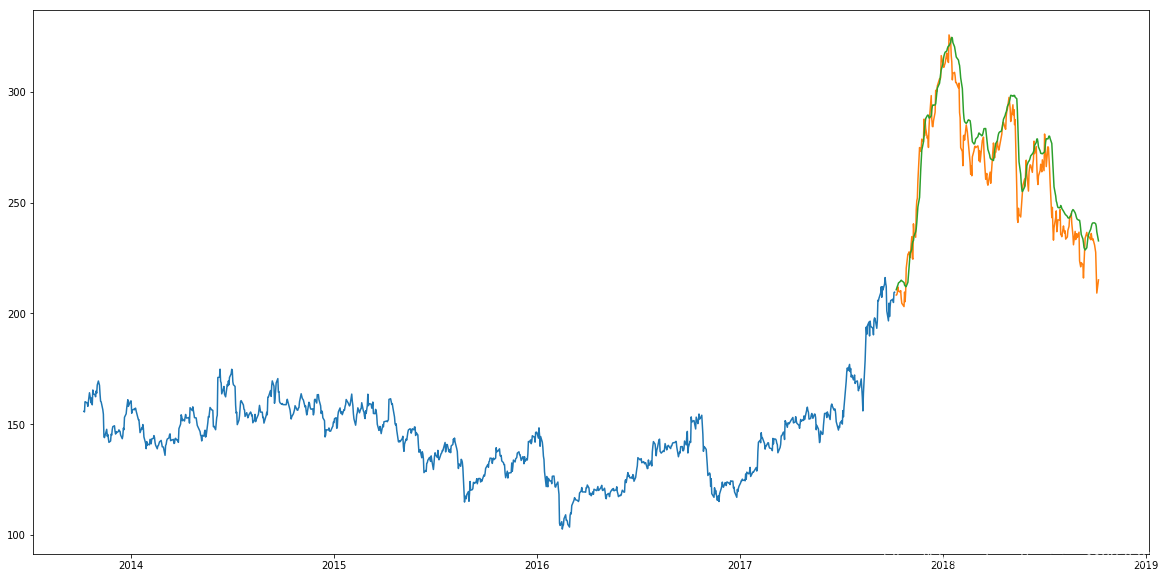

Results

rms=np.sqrt(np.mean(np.power((valid-closing_price),2)))

rms

11.772259608962642

#for plotting

train = new_data[:987]

valid = new_data[987:]

valid['Predictions'] = closing_price

plt.plot(train['Close'])

plt.plot(valid[['Close','Predictions']])

Inference

哇! 可以针对各种参数调整LSTM模型,例如改变LSTM层的数量,添加压差值或增加时期的数量。 但LSTM的预测是否足以确定股价是涨还是降? 当然不是!

正如我在文章开头提到的那样,股票价格受到有关公司的新闻以及其他因素的影响,如公司的非货币化或合并/分拆。 还有一些无形因素,事先往往无法预测。

End Notes

时间序列预测是一个非常有趣的领域,正如我在撰写这些文章时所意识到的那样。 在社区中有一种感觉,它是一个复杂的领域,虽然那里有一些事实,但是一旦掌握了基本技术,就不那么困难了。

我有兴趣了解LSTM如何处理不同类型的时间序列问题,并鼓励您自己尝试一下。 如果您有任何疑问,请随时在下面的评论部分与我联系。