原文链接:https://yq.aliyun.com/topic/111

08

反向传播(Back Propagation,简称BP) 算法

在神经网络(甚至深度学习)参数训练中,BP算法占据举足轻重的地位。

实际上BP算法是一个典型的双向算法,但通常强调的是反向传播。

工作流程分两大步:

- 正向传播输入信号,输出分类信息(对于有监督学习而言,基本上都可归属于分类算法)。简单说来,就是把信号通过激活函数的加工,一层一层的向前“蔓延”,直到抵达输出层。

- 反向传播误差信息,调整全网权值。如果没有达到预期目的,重走回头路(1)和(2),也就是通过微调网络参数让下一轮的输出更加准确。

反向传播演示

反向传播演示:https://google-developers.appspot.com/machine-learning/crash-course/backprop-scroll/

BP算法的不足

会存在“梯度扩散(Gradient Diffusion)”现象,其根源在于对于非凸函数,梯度一旦消失,就没有指导意义,导致它可能限于局部最优。

而且“梯度扩散”现象会随着网络层数增加而愈发严重,也就是说,随着梯度的逐层消减,导致它对调整网络权值的调整效益,作用越来越小。

故此BP算法多用于浅层网络结构(通常小于等于3),这就限制了BP算法的数据表征能力,从而也就限制了BP的性能上限。

09

在本质上,BP算法是一种全连接神经网络,虽然有很多成功的应用,但只能适用于“浅层”网络。

因为“肤浅”,所以也就限制了它的特征表征能力,进而也就局限了它的应用范围。

卷积神经网络(Convolutional Neural Network,简称CNN)

当前适用在图像、语音识别等众多任务。

CNN能够直接从原始图像出发,经过非常少的预处理,就能从图像中找出视觉规律,进而完成识别分类任务,其实这就是端到端(end-end)的含义。

避免了对图像进行复杂的前期处理(即大量的人工图像特征提取工作)

当前主流的卷积神经网络结构,其精华大致体现在3个核心操作和3个概念。

- 3个核心是指:卷积(Convolution)、池化(Poling)和非线性处理(ReLU)。

- 3个概念是指:局部感受域(Local receptive filed)、权值共享(Weight sharing)和亚采样(Subsampling)。

10

卷积操作的数学意义:一个函数和另一个函数在某个维度上的加权“叠加”作用。

通常把函数f称为输入函数, g 称为滤波器(filter,也称为特征检测器,feature detector)或卷积核(kernel),这两个函数的叠加结果称为特征图或特征图谱(feature map)

特征图谱也被称呼为做卷积特征(convolved feature)或激活图(activation map)。

在本质上,离散卷积就是一个线性运算,因此离散卷积操作也被称为线性滤波。

常用于图像处理的卷积核

同一化核(Identity)

卷积后得到的图像和原图一样。

只有中心点的值是1,邻域点的权值都是0,所以对滤波后的取值没有任何影响。边缘检测核(Edge Detection)

也称为高斯-拉普拉斯算子。

矩阵的元素总和为0(即中间元素为8,而周围8个元素之和为-8),所以滤波后的图像会很暗,而只有边缘位置是有亮度的。图像锐化核(Sharpness Filter)

图像的锐化和边缘检测比较相似。

首先找到边缘,然后再把边缘加到原来的图像上面,强化了图像的边缘,使得图像看起来更加锐利。均值模糊(Box Blur /Averaging)

每个元素值都是1,它将当前像素和它的四邻域的像素一起取平均,然后再除以9。

均值模糊比较简单,但图像处理得不够平滑。因此,还可以采用高斯模糊核(Gaussian Blur),这个核被广泛用在图像降噪上。

11

相比于全连接的前馈网络,卷积神经网络的结构要简洁,但并不简单。

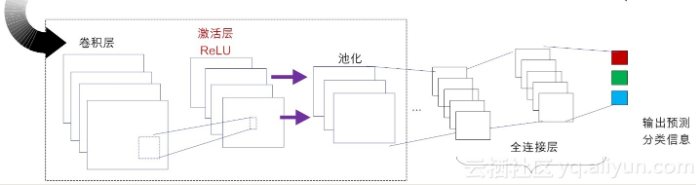

典型卷积神经网络的结构

在不考虑输入层的情况下,一个典型的卷积神经网络通常由若干个卷积层、激活层、池化层及全连接层组成。

卷积层(Convolutional Layer)

- 是卷积神经网络的核心所在。

- 在卷积层,通过实现“局部感知”和“权值共享”等系列的设计理念,可达到两个重要的目的:对高维输入数据实施降维处理和实现自动提取原始数据的核心特征。激活层(Activation Layer)

- 作用是将前一层的线性输出,通过非线性激活函数处理,从而可模拟任意函数,进而增强网络的表征能力。

- 在深度学习领域,ReLU(Rectified-Linear Unit,修正线性单元)是目前使用较多的激活函数,原因是它收敛更快,且不会产生梯度消失问题。池化层(Pooling Layer)

- 也称为亚采样层(Subsampling Layer)。

- 简单来说,利用局部相关性,“采样”在较少数据规模的同时保留了有用信息。

- 巧妙的采样还具备局部线性转换不变性,从而增强卷积神经网络的泛化处理能力。全连接层(Fully Connected Layer)

相当于传统的多层感知机(Multi-Layer Perceptron,简称MLP)。

通常来说,“卷积-激活-池化”是一个基本的处理栈,通过多个前栈处理之后,待处理的数据特性已有了显著变化:

一方面,输入数据的维度已下降到可用“全连接”网络来处理了;另一方面,此时全连接层的输入数据已不再是“泥沙俱下、鱼龙混杂”,而是经过反复提纯过的结果,因此最后输出的结果要可控得高。