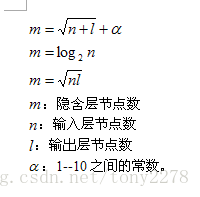

首先有公式如下:

最近在做关于文本相似度匹配的题目,输入层30+,输出层有200+,所以在定义隐含层节点数目的时候出现了很多麻烦。

从之前的CNN图像处理的神经网络可以很好理解,隐含层本质就是对特征的一种提取,对某个事物的多重角度的判定、认知最后综合起来决定这个事物最后的属性。所以隐含层如果过多的话特征提取会出现不足的情况,我们的模型便不能很好的获得学习能力。反之如果隐含层数目过多,网络复杂性会增强,很容易陷入局部最优解导致网络的学习速率很慢的情况。

从算法执行速度来看,隐含层节点越少速度越快,先前以为提取特征的话,隐含层节点数量肯定要远大于输出层,所以在训练的时候浪费了很多时间,局部最优解的情况一直没法得到改善。