版权声明:本文为博主原创文章,转载请声明本博主原创 https://blog.csdn.net/weixin_39381833/article/details/85054914

1.1.1.创建DataFrames

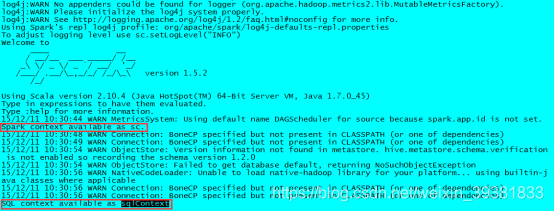

在Spark SQL中SQLContext是创建DataFrames和执行SQL的入口,在spark-1.5.2中已经内置了一个sqlContext

在本地创建一个文件,有三列,分别是id、name、age,用空格分隔,然后上传到hdfs上

hdfs dfs -put person.txt /

.在spark shell执行下面命令,读取数据,将每一行的数据使用列分隔符分割

val lineRDD = sc.textFile("hdfs://node1.itcast.cn:9000/person.txt").map(_.split(" "))

定义case class(相当于表的schema)

case class Person(id:Int, name:String, age:Int)

将RDD和case class关联

val personRDD = lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

将RDD转换成DataFrame

val personDF = personRDD.toDF

对DataFrame进行处理

personDF.show

1.2.DataFrame常用操作

查看DataFrame中的内容

personDF.show

查看DataFrame部分列中的内容

personDF.select(personDF.col("name")).show

personDF.select(col("name"), col("age")).show

personDF.select("name").show

打印DataFrame的Schema信息

personDF.printSchema

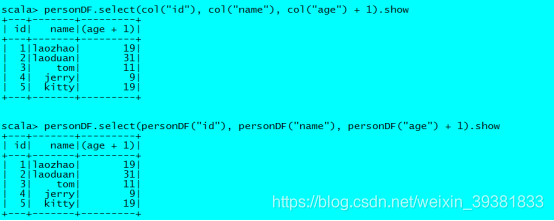

查询所有的name和age,并将age+1

personDF.select(col("id"), col("name"), col("age") + 1).show

personDF.select(personDF("id"), personDF("name"), personDF("age") + 1).show

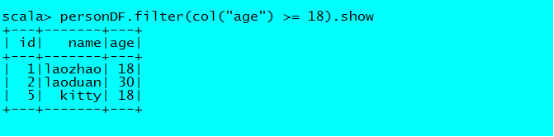

过滤age大于等于18的

personDF.filter(col("age") >= 18).show

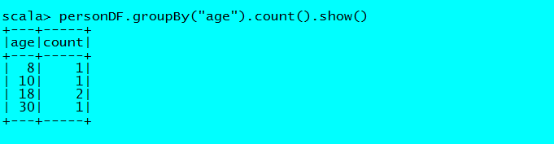

按年龄进行分组并统计相同年龄的人数

personDF.groupBy("age").count().show()

1.2.2.SQL风格语法

如果想使用SQL风格的语法,需要将DataFrame注册成表

personDF.registerTempTable(“t_person”)

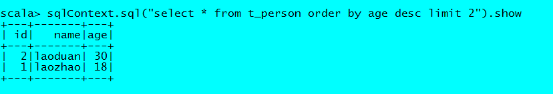

查询年龄最大的前两名

sqlContext.sql("select * from t_person order by age desc limit 2").show

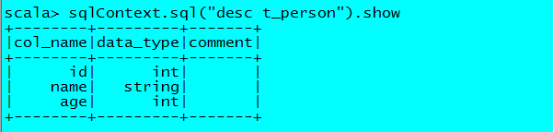

显示表的Schema信息

sqlContext.sql("desc t_person").show

以编程方式执行Spark SQL查询

1.3.编写Spark SQL查询程序

1.3.1.通过反射推断Schema

创建一个object为cn.itcast.spark.sql.InferringSchema

package cn.itcast.spark.sql

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.sql.SQLContext

object InferringSchema {

def main(args: Array[String]) {

//创建SparkConf()并设置App名称

val conf = new SparkConf().setAppName("SQL-1")

//SQLContext要依赖SparkContext

val sc = new SparkContext(conf)

//创建SQLContext

val sqlContext = new SQLContext(sc)

//从指定的地址创建RDD

val lineRDD = sc.textFile(args(0)).map(_.split(" "))

//创建case class

//将RDD和case class关联

val personRDD = lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

//导入隐式转换,如果不到人无法将RDD转换成DataFrame

//将RDD转换成DataFrame

import sqlContext.implicits._

val personDF = personRDD.toDF

//注册表

personDF.registerTempTable("t_person")

//传入SQL

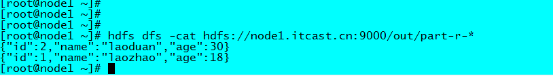

val df = sqlContext.sql("select * from t_person order by age desc limit 2")

//将结果以JSON的方式存储到指定位置

df.write.json(args(1))

//停止Spark Context

sc.stop()

}

}

//case class一定要放到外面

case class Person(id: Int, name: String, age: Int)

1.3.2.通过StructType直接指定Schema

创建一个object为cn.itcast.spark.sql.SpecifyingSchema

package cn.itcast.spark.sql

import org.apache.spark.sql.{Row, SQLContext}

import org.apache.spark.sql.types._

import org.apache.spark.{SparkContext, SparkConf}

/**

* Created by ZX on 2015/12/11.

*/

object SpecifyingSchema {

def main(args: Array[String]) {

//创建SparkConf()并设置App名称

val conf = new SparkConf().setAppName("SQL-2")

//SQLContext要依赖SparkContext

val sc = new SparkContext(conf)

//创建SQLContext

val sqlContext = new SQLContext(sc)

//从指定的地址创建RDD

val personRDD = sc.textFile(args(0)).map(_.split(" "))

//通过StructType直接指定每个字段的schema

val schema = StructType(

List(

StructField("id", IntegerType, true),

StructField("name", StringType, true),

StructField("age", IntegerType, true)

)

)

//将RDD映射到rowRDD

val rowRDD = personRDD.map(p => Row(p(0).toInt, p(1).trim, p(2).toInt))

//将schema信息应用到rowRDD上

val personDataFrame = sqlContext.createDataFrame(rowRDD, schema)

//注册表

personDataFrame.registerTempTable("t_person")

//执行SQL

val df = sqlContext.sql("select * from t_person order by age desc limit 4")

//将结果以JSON的方式存储到指定位置

df.write.json(args(1))

//停止Spark Context

sc.stop()

}

}