哈尔滨工业大学计算机学院-自然语言处理-课程总结

其他

2019-01-13 12:27:59

阅读次数: 0

1. 前言

- 自然语言处理是关毅老师的研究生课程。

- 本博客仅对噪声信道模型、n元文法(N-gram语言模型)、维特比算法详细介绍。

- 其他的重点知识还包括概率上文无关文法(PCFG)、HMM形式化定义、词网格分词等等,比较简单,不做赘述。

2. 噪声信道模型

2.1 噪声信道模型原理

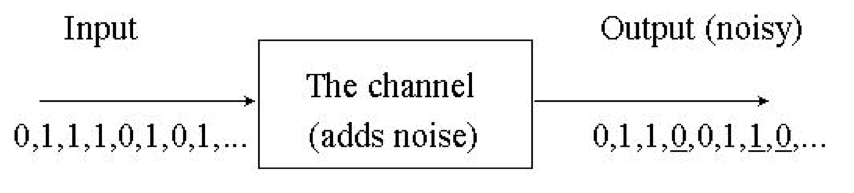

- 噪声信道模型的示意图如下所示:

- 该模型的目标是通过有噪声的输出信号试图恢复输入信号,依据贝叶斯公式,其计算公式如下所示:

\[I = \arg \max _ { I } P ( I | O ) = \arg \max _ { I } \frac { P ( O | I ) P ( I ) } { P ( O ) } = \arg \max _ { I } P ( O | I ) P ( I )\]

- 噪声模型的优点是具有普适性,通过修改噪声信道的定义,可以将很多常见的应用纳入到这一模型的框架之中,相关介绍见2.1。

2.2 噪声信道模型的应用

2.2.1 语音识别

- 语音识别的目的是通过声学信号,找到与其对应的置信度最大的语言文本。

- 计算公式与上文相同,此时的\(I\)为语言文本,\(O\)为声学信号。

- 代码实现过程中,有一个信息源以概率\(P(I)\)生成语言文本,噪声信道以概率分布\(P(O|I)\)将语言文本转换为声学信号。

- 模型通过贝叶斯公式对后验概率\(P(I|O)\)进行计算。

2.2.2 其他应用

3. N-gram语言模型

- N-gram语言模型基于马尔可夫假设,即下一个词的出现仅仅依赖于他前面的N个词,公式如下:

\[P ( S ) = P \left( w _ { 1 } w _ { 2 } \dots w _ { n } \right) = p \left( w _ { 1 } \right) p \left( w _ { 2 } | w _ { 1 } \right) p \left( w _ { 3 } | w _ { 1 } w _ { 2 } \right) \ldots p \left( w _ { n } | w _ { 1 } w _ { 2 } \dots w _ { n - 1 } \right)\]

4. 维特比算法

转载自www.cnblogs.com/szxspark/p/10262161.html