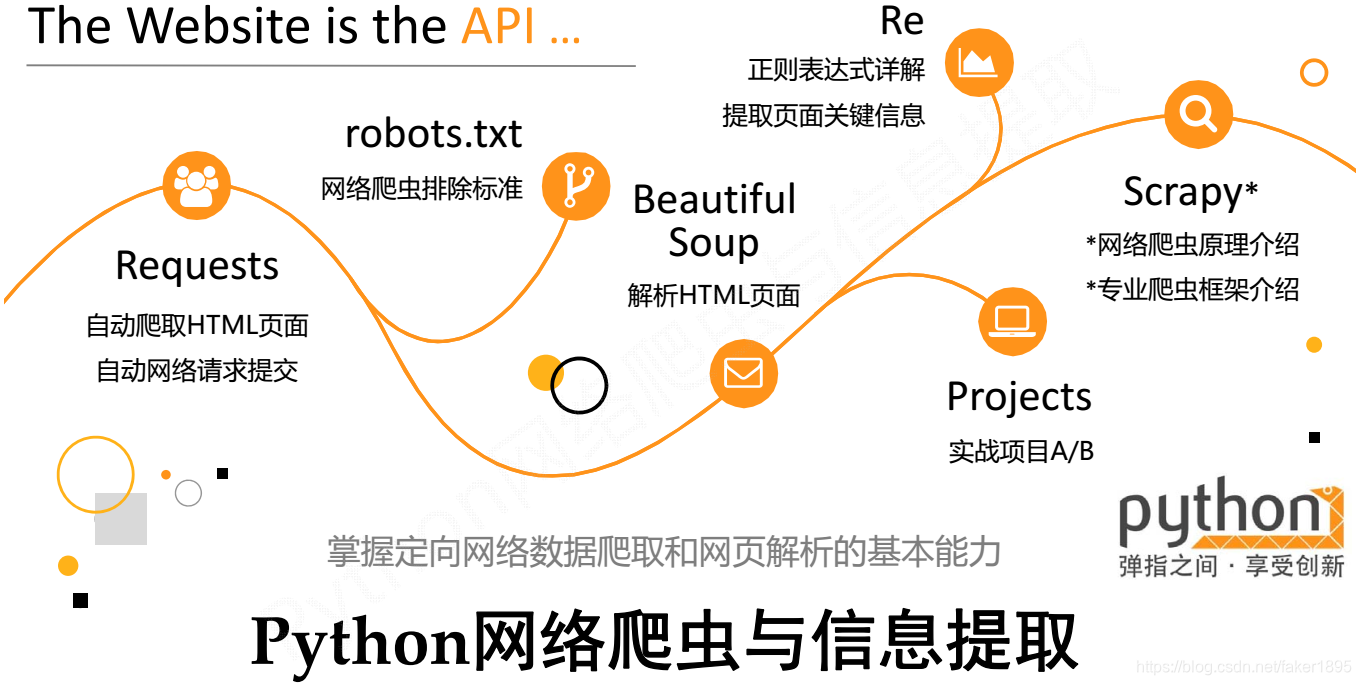

网络爬虫之前奏

网络爬虫之规则

Requests库入门

requests库的安装

- Win平台: “以管理员身份运行” cmd,执行pip3 install requests。

requests库安装成功与否的测试

- 按照以下代码在python交互模式下依次执行得到正确的结果就证明安装成功了。

>>> import requests

>>> r = requests.get("https://www.baidu.com")

>>> r.status_code

200

>>> r.encoding

'ISO-8859-1'

>>> r.apparent_encoding

'utf-8'

>>> r.encoding = 'utf-8'

>>> r.text

'<!DOCTYPE html>\r\n<!--STATUS OK--><html> <head><meta http-equiv=content-type content=text/html;charset=utf-8><meta http-equiv=X-UA-Compatible content=IE=Edge><meta content=always name=referrer><link rel=stylesheet type=text/css href=https://ss1.bdstatic.com/5eN1bjq8AAUYm2zgoY3K/r/www/cache/bdorz/baidu.min.css><title>百度一下,你就知道</title></head> <body link=#0000cc> <div id=wrapper> <div id=head> <div class=head_wrapper> <div class=s_form> <div class=s_form_wrapper> <div id=lg> <img hidefocus=true src=//www.baidu.com/img/bd_logo1.png width=270 height=129> </div> <form id=form name=f action=//www.baidu.com/s class=fm> <input type=hidden name=bdorz_come value=1> <input type=hidden name=ie value=utf-8> <input type=hidden name=f value=8> <input type=hidden name=rsv_bp value=1> <input type=hidden name=rsv_idx value=1> <input type=hidden name=tn value=baidu><span class="bg s_ipt_wr"><input id=kw name=wd class=s_ipt value maxlength=255 autocomplete=off autofocus=autofocus></span><span class="bg s_btn_wr"><input type=submit id=su value=百度一下 class="bg s_btn" autofocus></span> </form> </div> </div> <div id=u1> <a href=http://news.baidu.com name=tj_trnews class=mnav>新闻</a> <a href=https://www.hao123.com name=tj_trhao123 class=mnav>hao123</a> <a href=http://map.baidu.com name=tj_trmap class=mnav>地图</a> <a href=http://v.baidu.com name=tj_trvideo class=mnav>视频</a> <a href=http://tieba.baidu.com name=tj_trtieba class=mnav>贴吧</a> <noscript> <a href=http://www.baidu.com/bdorz/login.gif?login&tpl=mn&u=http%3A%2F%2Fwww.baidu.com%2f%3fbdorz_come%3d1 name=tj_login class=lb>登录</a> </noscript> <script>document.write(\'<a href="http://www.baidu.com/bdorz/login.gif?login&tpl=mn&u=\'+ encodeURIComponent(window.location.href+ (window.location.search === "" ? "?" : "&")+ "bdorz_come=1")+ \'" name="tj_login" class="lb">登录</a>\');\r\n </script> <a href=//www.baidu.com/more/ name=tj_briicon class=bri style="display: block;">更多产品</a> </div> </div> </div> <div id=ftCon> <div id=ftConw> <p id=lh> <a href=http://home.baidu.com>关于百度</a> <a href=http://ir.baidu.com>About Baidu</a> </p> <p id=cp>©2017 Baidu <a href=http://www.baidu.com/duty/>使用百度前必读</a> <a href=http://jianyi.baidu.com/ class=cp-feedback>意见反馈</a> 京ICP证030173号 <img src=//www.baidu.com/img/gs.gif> </p> </div> </div> </div> </body> </html>\r\n'

requests库的七个主要方法

-

requests.request()

- 构造一个请求,支撑以下各方法的基础方法。

-

requests.get()

- 获取HTML网页的主要方法,对应于HTTP的GET。

-

requests.head()

- 获取HTML网页头信息的方法,对应于HTTP的HEAD。

-

requests.post()

- 向HTML网页提交POST请求的方法,对应于HTTP的POST。

-

requests.put()

- 向HTML网页提交PUT请求的方法,对应于HTTP的PUT。

-

requests.patch()

- 向HTML网页提交局部修改请求,对应于HTTP的PATCH。

-

requests.delete()

- 向HTML页面提交删除请求,对应于HTTP的DELETE。

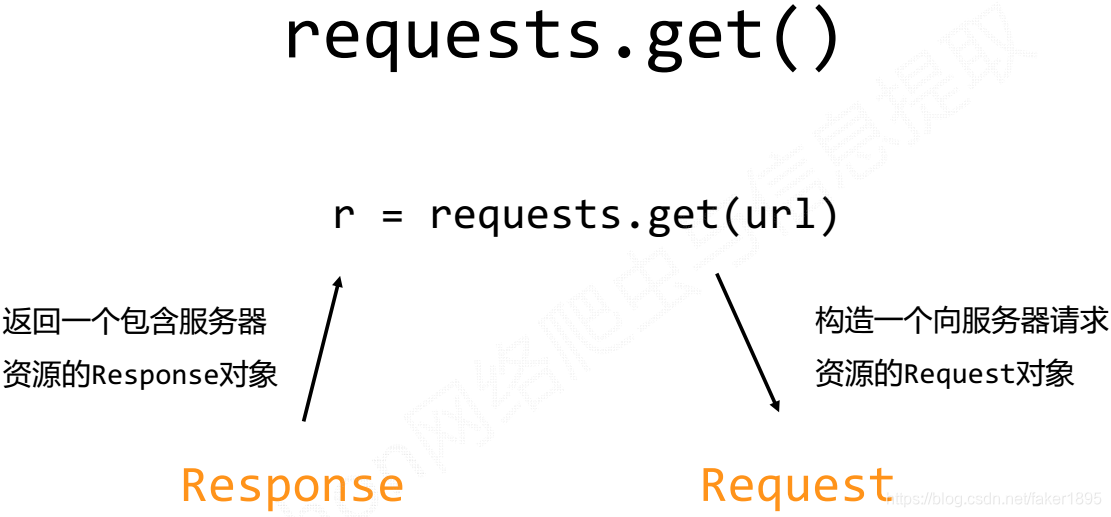

Requests库的get()方法

-

requests.get(url, params=None, **kwargs)

- url : 拟获取页面的url链接。

- params : url中的额外参数,字典或字节流格式,可选。

- **kwargs: 12个控制访问的参数。

-

Response对象

-

Response对象包含爬虫返回的内容。

-

Response对象包含服务器返回的所有信息,也包含请求的Request信息。

>>> import requests >>> r = requests.get("https://www.baidu.com") >>> print(r.status_code) 200 >>> type(r) <class 'requests.models.Response'> >>> r.headers {'Cache-Control': 'private, no-cache, no-store, proxy-revalidate, no-transform', 'Connection': 'Keep-Alive', 'Content-Encoding': 'gzip', 'Content-Type': 'text/html', 'Date': 'Tue, 30 Oct 2018 08:36:21 GMT', 'Last-Modified': 'Mon, 23 Jan 2017 13:24:46 GMT', 'Pragma': 'no-cache', 'Server': 'bfe/1.0.8.18', 'Set-Cookie': 'BDORZ=27315; max-age=86400; domain=.baidu.com; path=/', 'Transfer-Encoding': 'chunked'}

-

-

Response对象的属性

- r.status_code

- HTTP请求的返回状态,200表示连接成功,404表示失败。

- r.text

- HTTP响应内容的字符串形式,即,url对应的页面内容。

- r.encoding

- 从HTTP header中猜测的响应内容编码方式。

- 如果header中不存在charset,则认为编码为ISO‐8859‐1。

- r.text根据r.encoding显示网页内容。

- r.apparent_encoding

- 从内容中分析出的响应内容编码方式(备选编码方式)。

- 根据网页内容分析出的编码方式可以看作是r.encoding的备选。

- r.content

- HTTP响应内容的二进制形式。

- r.status_code

爬取网页的通用代码框架

-

Requests库的异常

- requests.ConnectionError

- 网络连接错误异常,如DNS查询失败、拒绝连接等。

- requests.HTTPError

- HTTP错误异常。

- requests.URLRequired

- URL缺失异常。

- requests.TooManyRedirects

- 超过最大重定向次数,产生重定向异常。

- requests.ConnectTimeout

- 连接远程服务器超时异常。

- requests.Timeout

- 请求URL超时,产生超时异常。

- requests.ConnectionError

-

r.raise_for_status()方法

- 如果不是200,产生异常 requests.HTTPError。

- r.raise_for_status()在方法内部判断r.status_code是否等于200,不需要增加额外的if语句,该语句便于利用try‐except进行异常处理。

-

通用代码框架

import requests

def getHTMLText(url):

try:

r = requests.get(url, timeout = 30)

r.raise_for_status() # 如果状态不是200,引发HTTPError异常

r.encoding = r.apparent_encoding

return r.text

except:

return "产生异常"

if __name__ == "__main__":

url = "http://www.baidu.com"

print(getHTMLText(url))