版权声明:本文为博主原创文章,转载请注明出处。 https://blog.csdn.net/u014722627/article/details/67662931

我感觉在学习过程中,遇到不懂的,常常都是需要复习概率论知识,所以假设机器学习的名词啥的都是掌握的。

下面这些文章都是头大的时候觉得读一遍就能懂的。

概率论基础

先验概率、后验概率、贝叶斯法则、极大后验概率假设、极大似然假设

微积分、线性代数基础

生成模型vs判别模型

生成:

- 生成模型与判别模型

- (EM算法)The EM Algorithm、混合高斯模型

- 从最大似然到EM算法浅解

判别:(理解极大似然的思想)

- logistics regression推荐看周志华的机器学习西瓜书

- Softmax回归-UFLDL

总之,在阅读下面这些东西之前,我觉得极大似然、KL散度是要非常熟悉了

生成模型

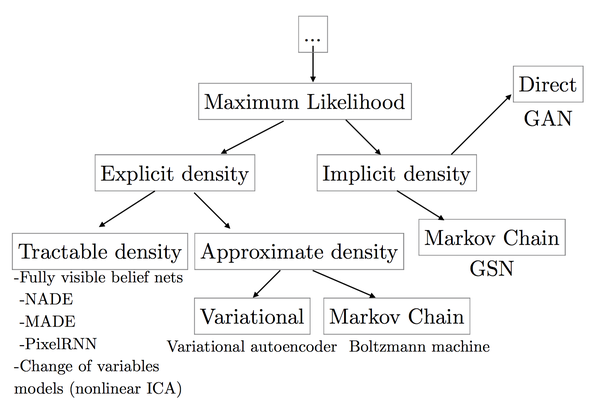

生成模型示意图

- [VAE]

– [paper]

– [Code (pytorch-example)]

– [非常直观的理解:Conditional Variational Autoencoders]

– [从模型到推导: 【Learning Notes】变分自编码器(Variational Auto-Encoder,VAE)] - [GAN]

– [Paper]

– [Code] - [DCGAN]

– [Paper]

– [Code (pytorch-example)] - [WGAN]

– [Paper]

– [Code (pytorch)]

– [深入浅出的介绍:令人拍案叫绝的Wasserstein GAN]