传统的获取物体三维数据的方法主要是依靠结构光或者激光等三维重建方法,但这些方法需要很多额外的硬件设备并且不适合户外的大场景的三维重建。文章提出的基于摄影测量学和图像光流的方法改变了传统的重建方式,只需要一台单反相机通过拍摄系列图片即可获得物体的三维数据,而且适用于户外场景的三维数据的获取。根据近景摄影测量学的方法能够获得相机的内外参数;而根据光流法能够获得两幅图片上的图像点匹配信息以及颜色信息,然后根据相机的标定数据、匹配数据以及颜色数据就能获得带有颜色纹理信息的物体三维点云。这种测量方式只需手持相机对物体拍摄多幅图片即可完成三维重建,可以使用在大场景VR虚拟现实中的三维获取。

基于近景摄影测量学[[i]]和光流[[ii]]的三维测量方式正好满足了上述需求。这种测量方式只需要一台单反相机,使用相机对物体从不同角度拍摄多幅图片的方式来获取三维信息。单反相机具有很高的像素和颜色信息,以此来对物体进行重建可以获得很好的精度并同时获得物体的纹理信息。首先,使用一些人工的标记点通过自标定的方法标定相机的内参数;然后,拍摄需要重建的物体图像,通过物体上自身的特征点,如sift特征信息[[iii]],来完成相机的外参数的标定;第三,使用光流检测算法可以计算出从不同角度拍摄的两幅图片上每个像素点的光流值。因为在三维空间中某个物体或者场景在对应二维图像平面运动时,物体或者场景中的三维点会投影到二维平面上,并且行成了以图像亮度为模式的运动,这种运动就叫做光流。光流场可以理解为物体在空间运动过程或者相机拍摄过程中产生的矢量场,这种矢量场同样可以通过物体不动而移动相机来获得。最后,基于两幅图片光流场的变化值可以获得像素精度的匹配点,根据这些图像匹配点和相机的标定数据就可以重建出物体的三维信息。

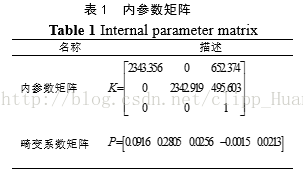

实验的过程只需要使用一台单反相机(如图2所示),焦距35mm,相机分辨率1024*1280。拍摄距离5m,视场大小4m*5m。首先是相机内参的标定过程,内参的计算使用1.1介绍的方法。首先在地面上铺设一些编码标记点如图3所示,这些编码点都具有编码唯一性特点,然后使用相机围绕着这些编码点拍摄8幅图片,通过图像处理的方法来获得每幅图像上每个编码点的二维图像坐标,最后根据(7)式计算出相机的内参数,计算的结果如表-1所示。表1 内参数矩阵

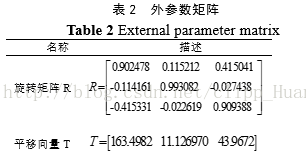

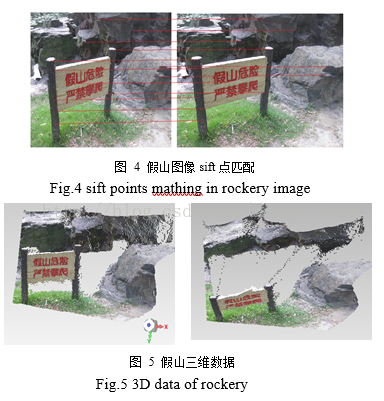

表2 外参数矩阵内参计算完成之后就是对两幅图像外参数的求解,首先对两幅图像分别使用SIFT算法来检测两幅图像的匹配点,如图4所示,然后根据这些匹配点使用2.2介绍的方法来计算两幅图像的外参数,计算结果如表-2所示。

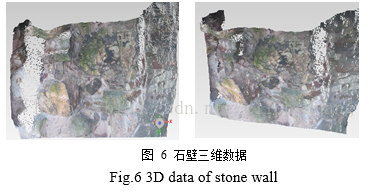

内参和外参标定完成之后可以使用第三节介绍的光流计算方法来计算两幅图像上的光流场,然后根据光流场来对像素级别的稠密点进行匹配,可以得到两幅图像上稠密的二维图像匹配点。最后根据三角测量原理,有了内参和外参以及图像上的匹配点就可以进行三维点的重建,并获取到每个三维点对应的图像颜色值。重建的效果如图5和图6所示。

[1] A.Gruen.Development of digitalmethodology and systems[J].Close Range Photogrammetryand Machine Vision.Caithness:Whittles,1996:pp78-105.