理论

实现原理

-

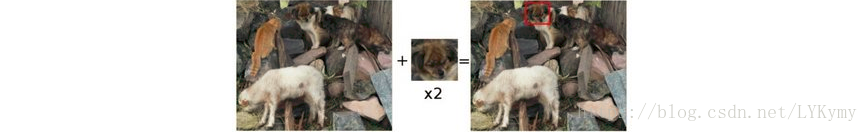

我们需要2幅图像:

- 原图像 (I): 在这幅图像里,我们希望找到一块和模板匹配的区域

- 模板 (T): 将和原图像比照的图像块

-

我们的目标是检测最匹配的区域:

- 为了确定匹配区域, 我们不得不滑动模板图像和原图像进行比较 :

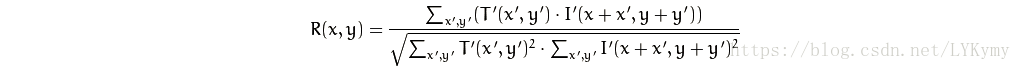

- 对于 T 覆盖在 I 上的每个位置,你把度量值保存 到结果图像矩阵 (R) 中. 在 R 中的每个位置

都包含匹配度量值:

都包含匹配度量值: - 上图就是 TM_CCORR_NORMED 方法处理后的结果图像 R . 最白的位置代表最高的匹配. 正如您所见, 红色椭圆框住的位置很可能是结果图像矩阵中的最大数值, 所以这个区域 (以这个点为顶点,长宽和模板图像一样大小的矩阵) 被认为是匹配的.

- 实际上, 我们使用函数 minMaxLoc 来定位在矩阵 R 中的最大值点 (或者最小值, 根据函数输入的匹配参数) .

Opencv包括哪些匹配算法?

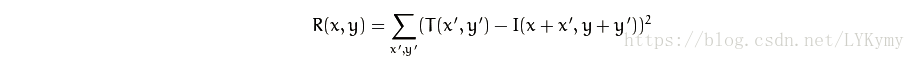

- 平方差匹配 method=CV_TM_SQDIFF:这类方法利用平方差来进行匹配,最好匹配为0.匹配越差,匹配值越大.

- 标准平方差匹配 method=CV_TM_SQDIFF_NORMED

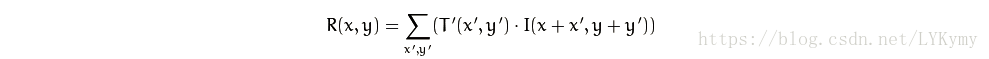

- 相关匹配 method=CV_TM_CCORR:这类方法采用模板和图像间的乘法操作,所以较大的数表示匹配程度较高,0标识最坏的匹配效果.

- 标准相关匹配 method=CV_TM_CCORR_NORMED

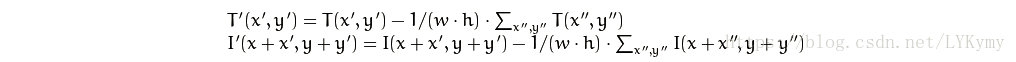

- 相关匹配 method=CV_TM_CCOEFF:这类方法将模版对其均值的相对值与图像对其均值的相关值进行匹配,1表示完美匹配,-1表示糟糕的匹配,0表示没有任何相关性(随机序列).

- 标准相关匹配 method=CV_TM_CCOEFF_NORMED

代码

代码流程

- 载入一幅输入图像和一幅模板图像块 (template)

- 通过使用函数 matchTemplate 实现之前所述的6种匹配方法的任一个. 用户可以通过滑动条选取任何一种方法.

- 归一化匹配后的输出结果

- 定位最匹配的区域

- 用矩形标注最匹配的区域

#include "opencv2/highgui/highgui.hpp"

#include "opencv2/imgproc/imgproc.hpp"

#include <iostream>

#include <stdio.h>

using namespace std;

using namespace cv;

/// 全局变量

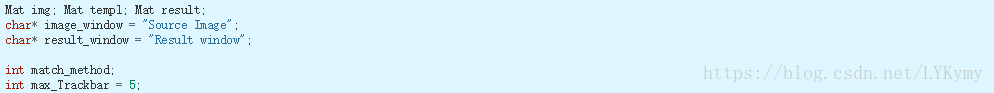

Mat img; Mat templ; Mat result;

char* image_window = "Source Image";

char* result_window = "Result window";

int match_method;

int max_Trackbar = 5;

/// 函数声明

void MatchingMethod( int, void* );

/** @主函数 */

int main( int argc, char** argv )

{

/// 载入原图像和模板块

img = imread( argv[1], 1 );

templ = imread( argv[2], 1 );

/// 创建窗口

namedWindow( image_window, CV_WINDOW_AUTOSIZE );

namedWindow( result_window, CV_WINDOW_AUTOSIZE );

/// 创建滑动条

char* trackbar_label = "Method: \n 0: SQDIFF \n 1: SQDIFF NORMED \n 2: TM CCORR \n 3: TM CCORR NORMED \n 4: TM COEFF \n 5: TM COEFF NORMED";

createTrackbar( trackbar_label, image_window, &match_method, max_Trackbar, MatchingMethod );

MatchingMethod( 0, 0 );

waitKey(0);

return 0;

}

/**

* @函数 MatchingMethod

* @简单的滑动条回调函数

*/

void MatchingMethod( int, void* )

{

/// 将被显示的原图像

Mat img_display;

img.copyTo( img_display );

/// 创建输出结果的矩阵

int result_cols = img.cols - templ.cols + 1;

int result_rows = img.rows - templ.rows + 1;

result.create( result_cols, result_rows, CV_32FC1 );

/// 进行匹配和标准化

matchTemplate( img, templ, result, match_method );

normalize( result, result, 0, 1, NORM_MINMAX, -1, Mat() );

/// 通过函数 minMaxLoc 定位最匹配的位置

double minVal; double maxVal; Point minLoc; Point maxLoc;

Point matchLoc;

minMaxLoc( result, &minVal, &maxVal, &minLoc, &maxLoc, Mat() );

/// 对于方法 SQDIFF 和 SQDIFF_NORMED, 越小的数值代表更高的匹配结果. 而对于其他方法, 数值越大匹配越好

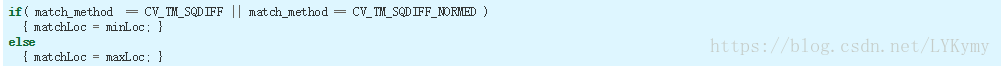

if( match_method == CV_TM_SQDIFF || match_method == CV_TM_SQDIFF_NORMED )

{ matchLoc = minLoc; }

else

{ matchLoc = maxLoc; }

/// 让我看看您的最终结果

rectangle( img_display, matchLoc, Point( matchLoc.x + templ.cols , matchLoc.y + templ.rows ), Scalar::all(0), 2, 8, 0 );

rectangle( result, matchLoc, Point( matchLoc.x + templ.cols , matchLoc.y + templ.rows ), Scalar::all(0), 2, 8, 0 );

imshow( image_window, img_display );

imshow( result_window, result );

return;

}解释

- 定义一些全局变量, 例如原图像(img), 模板图像(templ) 和结果图像(result) , 还有匹配方法以及窗口名称:

- 载入原图像和匹配块:

- 创建窗口,显示原图像和结果图像:

- 创建滑动条并输入将被使用的匹配方法. 一旦滑动条发生改变,回调函数 MatchingMethod 就会被调用.

- 一直等待,直到用户退出这个程序.

- 先看看回调函数。首先, 它对原图像进行了一份复制:

- 然后, 它创建了一幅用来存放匹配结果的输出图像矩阵. 仔细看看输出矩阵的大小(它包含了所有可能的匹配位置)

- 执行模板匹配操作:

- 我们对结果进行归一化:

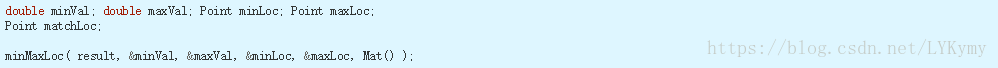

- 通过使用函数 minMaxLoc ,我们确定结果矩阵 R 的最大值和最小值的位置.

-

函数中的参数有:

- result: 匹配结果矩阵

- &minVal 和 &maxVal: 在矩阵 result 中存储的最小值和最大值

- &minLoc 和 &maxLoc: 在结果矩阵中最小值和最大值的坐标.

- Mat(): 可选的掩模

- 对于前二种方法 ( CV_SQDIFF 和 CV_SQDIFF_NORMED ) 最低的数值标识最好的匹配. 对于其他的, 越大的数值代表越好的匹配. 所以, 我们在 matchLoc 中存放相符的变量值:

- 显示原图像和结果图像. 再用矩形框标注最符合的区域:

效果

- 开始测试我们的程序,一幅输入图像:

- 一幅模版图像:

- 产生了一下结果图像矩阵 (第一行是标准的方法 SQDIFF, CCORR 和 CCOEFF, 第二行是相同的方法在进行标准化后的图像). 在第1列, 最黑的部分代表最好的匹配, 对于其它2列, 越白的区域代表越好的匹配.

- 正确的匹配在下面显示 (右侧被矩形标注的人脸). 需要注意的是方法 CCORR 和 CCOEFF 给出了错误的匹配结果, 但是它们的归一化版本给出了正确的结果, 这或许是由于我们实际上仅仅考虑 “最匹配” 而没考虑其他可能的高匹配位置.