LRN是一种提高深度学习准确度的技术方法。LRN一般是在激活、池化函数后的一种方法。

在ALexNet中,提出了LRN层,对局部神经元的活动创建竞争机制,LRN仿造生物学上活跃的神经元对相邻神经元的抑制现象(侧抑制)。

好处有以下两点:

- 归一化有助于快速收敛;

- 对局部神经元的活动创建竞争机制,使得其中响应比较大的值变得相对更大,并抑制其他反馈较小的神经元,增强了模型的泛化能力。

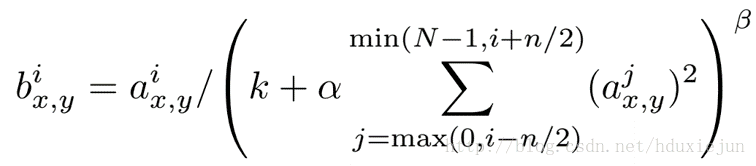

在2012的Alexnet网络中具体计算公式如下:

其中,i表示第i个神经元在位置(x, y)使用激活函数ReLU后的输出,n是同一位置上临近的kernal map的数目,N是kernal的总数。参数K, n, alpha, belta 都是超参数,一般设置k=2, n=5, alpha=1*e-4, beta=0.75。