“词频”(Term Frequency,缩写为TF),停用词:表示对找到结果毫无帮助、必须过滤掉的词,如”的”、”是”、”在”—-这一类最常用的词

判定一个词的重要性:需要一个重要性调整系数,衡量一个词是不是常见词。如果某个词比较少见,但是它在这篇文章中多次出现,那么它很可能就反映了这篇文章的特性,正是我们所需要的关键词。用统计学语言表达,就是在词频的基础上,要对每个词分配一个”重要性”权重。这个权重叫做”逆文档频率”(Inverse Document Frequency,缩写为IDF),它的大小与一个词的常见程度成反比。

将”词频”(TF)和”逆文档频率”(IDF)相乘,就得到了一个词的TF-IDF值。某个词对文章的重要性越高,它的TF-IDF值就越大。所以,排在最前面的几个词,就是这篇文章的关键词。

词频

词频(TF)=某个词在文章中出现的次数

考虑到文章有长短之分,所以要对词频参数进行归一化处理,下面是两种归一化的方法

(1)

(2)

逆文档频率

即词的区分度,逆文档概率针对的是整个预料库中的语料来计算的的

注:上式中分母加一避免log1=0的情况

ps:应该也可以用该文章中某词的数量除以整个语料库中该词的总数

TF-IDF:

TF-IDF=词频(TF)* 逆文档频率(IDF)

TF-IDF数学含义

– TF:代表性,出现次数越多,代表性越强,TF值越大

– IDF:普遍性,在越多的地方出现,普遍性越强,IDF值越小(逆)

TF-IDF算法的优点是简单快速,结果比较符合实际情况。缺点是,单纯以”词频”衡量一个词的重要性,不够全面,有时重要的词可能出现次数并不多。而且,这种算法无法体现词的位置信息,出现位置靠前的词与出现位置靠后的词,都被视为重要性相同,这是不正确的。(一种解决方法是,对全文的第一段和每一段的第一句话,给予较大的权重。)

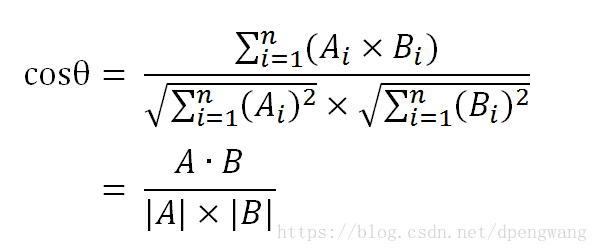

余弦相似性:对于两个向量A B

cos值越接近1,表明夹角越接近0度,也就是两个向量越相似,这就叫做余弦相似性

计算两篇文章相似度的一种算法:

(1)使用TF-IDF算法,找出两篇文章的关键词;

(2)每篇文章各取出若干个关键词(比如20个),合并成一个集合,计算每篇文章对于这个集合中的词的词 频(为了避免文章长度的差异,可以使用相对词频);

(3)生成两篇文章各自的词频向量;

(4)计算两个向量的余弦相似度,值越大就表示越相似。