1. 朴素贝叶斯法

设输入空间 为

为 维向量的集合,输出空间为类标记集合

维向量的集合,输出空间为类标记集合 ,输入特征向量

,输入特征向量 ,输出类标记为

,输出类标记为 ,

, 是

是 和

和 的联合概率分布,数据集

的联合概率分布,数据集

由 独立同分布产生。

独立同分布产生。

朴素贝叶斯法就是通过训练集来学习联合概率分布 .具体怎么学习呢? 主要就是从先验概率分布和条件概率分布入手,俩个概率相乘即可得联合概率。

.具体怎么学习呢? 主要就是从先验概率分布和条件概率分布入手,俩个概率相乘即可得联合概率。

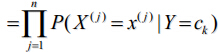

为什么称之为朴素呢,主要是其将条件概率的估计简化了,对条件概率分布作了条件独立性假设,这也是朴素贝叶斯法的基石,具体的假设如下

此公式在假设条件之下可以等价于

现在, 对于给定的输入向量 ,通过学习到的模型计算后验概率分布P(Y=Ck|X=x),后验分布中最大的类作为的输出结果,根据贝叶斯定理可知后验概率为

,通过学习到的模型计算后验概率分布P(Y=Ck|X=x),后验分布中最大的类作为的输出结果,根据贝叶斯定理可知后验概率为

上面的公式可能有点歧义,分母的Ck应该写成Cj才对,因为P(X=x)=E P(Y=Cj)*P(X=x|Y=Cj)

而 对于所有

对于所有 都是相同的,即此可以将输出结果简化为

都是相同的,即此可以将输出结果简化为

知识点1:argmax 在数学中是什么意思啊?

表示寻找具有最大评分的参量 函数y=f(x),x0= argmax(f(x)) 的意思就是参数x0满足f(x0)为f(x)的最大值;换句话说就是 argmax(f(x))是使得 f(x)取得最大值所对应的变量x。 举个例子更好懂: f(x)=-|x|+5, i.e., f(x)=-abs(x)+5; max[f(x)] = 5, when x = 0; so, argmax[f(x)] = 0