学习参数的定义与输入的定义很像,分为直接定义和字典定义两部分。

这两种都是常见的使用方式,只不过在深层神经网络里由于参数过多,普遍使用第二种情况。

一 直接定义

1 说明

通过tf.Variable可以对参数直接定义。

2 示例

# 模型参数 W = tf.Variable(tf.random_normal([1]), name="weight") b = tf.Variable(tf.zeros([1]), name="bias")

二 字典定义

1 说明

通过字典的方式定义和直接定义比较相似,只不过是堆叠到了一起。

2 关键代码

# 模型参数

paradict = {

'w': tf.Variable(tf.random_normal([1])),

'b': tf.Variable(tf.zeros([1]))

}

# 前向结构

z = tf.multiply(X, paradict['w'])+ paradict['b']

3 全部代码

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

plotdata = { "batchsize":[], "loss":[] }

def moving_average(a, w=10):

if len(a) < w:

return a[:]

return [val if idx < w else sum(a[(idx-w):idx])/w for idx, val in enumerate(a)]

#生成模拟数据

train_X = np.linspace(-1, 1, 100)

train_Y = 2 * train_X + np.random.randn(*train_X.shape) * 0.3 # y=2x,但是加入了噪声

#图形显示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.legend()

plt.show()

# 创建模型

# 占位符

X = tf.placeholder("float")

Y = tf.placeholder("float")

# 模型参数

paradict = {

'w': tf.Variable(tf.random_normal([1])),

'b': tf.Variable(tf.zeros([1]))

}

# 前向结构

z = tf.multiply(X, paradict['w'])+ paradict['b']

#反向优化

cost =tf.reduce_mean( tf.square(Y - z))

learning_rate = 0.01

optimizer = tf.train.GradientDescentOptimizer(learning_rate).minimize(cost) #Gradient descent

# 初始化变量

init = tf.global_variables_initializer()

#参数设置

training_epochs = 20

display_step = 2

# 启动session

with tf.Session() as sess:

sess.run(init)

# Fit all training data

for epoch in range(training_epochs):

for (x, y) in zip(train_X, train_Y):

sess.run(optimizer, feed_dict={X: x, Y: y})

#显示训练中的详细信息

if epoch % display_step == 0:

loss = sess.run(cost, feed_dict={X: train_X, Y:train_Y})

print ("Epoch:", epoch+1, "cost=", loss,"W=", sess.run(paradict['w']), "b=", sess.run(paradict['b']))

if not (loss == "NA" ):

plotdata["batchsize"].append(epoch)

plotdata["loss"].append(loss)

print (" Finished!")

print ("cost=", sess.run(cost, feed_dict={X: train_X, Y: train_Y}), "W=", sess.run(paradict['w']), "b=", sess.run(paradict['b']))

#图形显示

plt.plot(train_X, train_Y, 'ro', label='Original data')

plt.plot(train_X, sess.run(paradict['w']) * train_X + sess.run(paradict['b']), label='Fitted line')

plt.legend()

plt.show()

plotdata["avgloss"] = moving_average(plotdata["loss"])

plt.figure(1)

plt.subplot(211)

plt.plot(plotdata["batchsize"], plotdata["avgloss"], 'b--')

plt.xlabel('Minibatch number')

plt.ylabel('Loss')

plt.title('Minibatch run vs. Training loss')

plt.show()

print ("x=0.2,z=", sess.run(z, feed_dict={X: 0.2}))

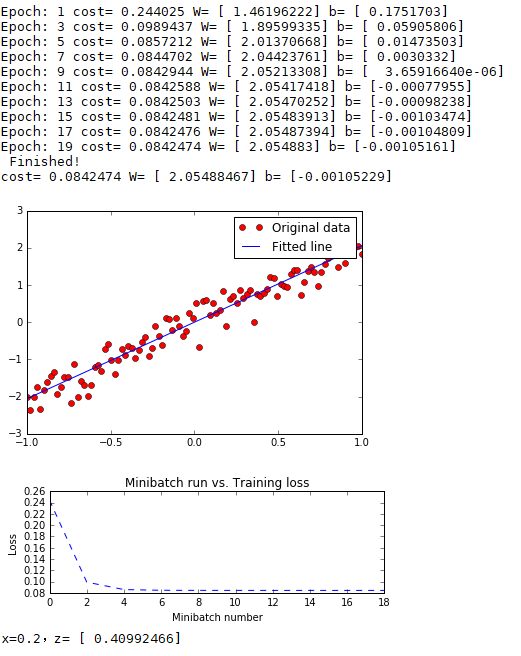

4 运行结果