1.SoftmaxWithLoss

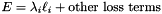

对一对多的分类任务计算多项逻辑斯蒂损失,并通过softmax传递预测值,来获得各类的概率分布。该层可以分解为SoftmaxLayer+MultinomialLogisticLossLayer,但它的梯度计算在数值上更为稳健。在测试时,该层可用SoftmaxLayer替代。

前向传播

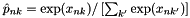

bottom: 1.(N×C×H×W)维的预测得分x,N是batch数,类别总数为K=CHW,目前看到的SoftmaxWithLossLayer的bottom一般是一个InnerProduct层,所以K是写在一起的。该层将这些得分通过softmax函数(多项logistic回归模型)

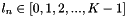

2.(N×1×1×1)维的标签l,

top:(1×1×1×1)维,对softmax输出类别概率

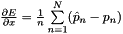

反向传播

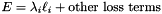

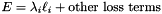

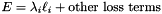

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×H×W)维的预测得分x,反向计算微分

2.(N×1×1×1)维的标签,忽略。

另外可参考一篇很好的介绍文章:http://blog.csdn.net/u012162613/article/details/44239919

2.EuclideanLoss

对回归任务计算欧氏距离(L2)损失

前向传播

bottom: 1.(N×C×H×W)维的预测,

2.(N×C×H×W)维的真实结果,

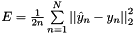

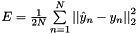

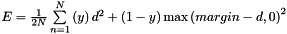

top:(1×1×1×1)维的欧氏距离损失:

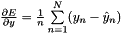

反向传播

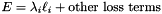

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

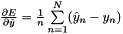

bottom: 1.(N×C×H×W)维的预测

2.(N×C×H×W)维的预测

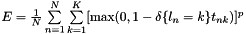

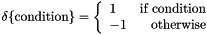

3.HingeLoss

对一对多的分类任务计算铰链损失。

前向传播

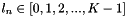

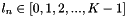

bottom: 1.(N×C×H×W)维的预测t,blob值的范围是

2.(N×1×1×1)维的真实标签l,

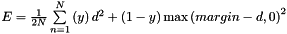

top:(1×1×1×1)维的铰链损失:

反向传播

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×H×W)维的预测得分t,反向计算微分

2.(N×1×1×1)维的标签,忽略。

4.SigmoidCrossEntropyLoss

计算交叉熵(逻辑斯蒂)损失

前向传播

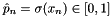

bottom: 1.(N×C×H×W)维的预测得分

2.(N×C×H×W)维的真实结果,

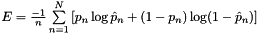

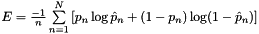

top:(1×1×1×1)维的交叉熵损失:

反向传播

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×H×W)维的预测得分x,反向计算微分

2.(N×1×1×1)维的标签,忽略。

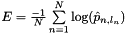

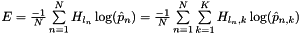

5.MultinomialLogisticLossLayer

对一对多的分类任务计算多项逻辑斯蒂损失,直接将预测的概率分布作为输入。当预测并不是概率分布时应该用SoftmaxWithLossLayer,因为它在计算多项逻辑斯蒂损失前通过SoftmaxLayer将预测映射为分布。

前向传播

bottom: 1.(N×C×H×W)维的预测得分

2.(N×1×1×1)维的标签l,

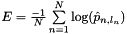

top:(1×1×1×1)维的多项逻辑斯蒂损失

反向传播

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×H×W)维的预测得分

2.(N×1×1×1)维的标签,忽略。

6.InfogainLoss

是MultinomialLogisticLossLayer的泛化,利用“information gain”(infogain)矩阵指定所有标签对的“value“,如果infogain矩阵一致则与MultinomialLogisticLossLayer等价。

前向传播

bottom: 1.(N×C×H×W)维的预测得分

2.(N×1×1×1)维的标签l,

3.(1×1×K×K)维的infogain矩阵H(相应的另一个为I),若H=I则该层等价于MultinomialLogisticLossLayer。

top:(1×1×1×1)维的infogain多项逻辑斯蒂损失

反向传播

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×H×W)维的预测得分

2.(N×1×1×1)维的标签,忽略;

3.(1×1×K×K)维的infogain矩阵,忽略。

7.ContrastiveLoss

计算对比损失

前向传播

bottom: 1.(N×C×1×1)维的特征

2.(N×C×1×1)维的特征

3.(N×C×1×1)维的二元相似度

top:(1×1×K×K)维的对比损失

反向传播

top:(1×1×1×1)维,该blob的微分就是loss_weight λ,λ是该层输出

bottom: 1.(N×C×1×1)维的特征a;

2.(N×C×1×1)维的特征b。