1.安装3个虚拟机并实现ssh免密码登录

1.1安装3个机器

安装3个机器,机器名称分别叫hserver1、hserver2、hserver3.

说明:为了免去后面一系列授权的麻烦,这里直接使用root账户登录和操作了。

使用ifconfig命令,查看这3个机器的IP。我的机器名和ip的对应关系是:

192.168.119.128 hserver1

192.168.119.129 hserver2

192.168.119.130 hserver3

1.2检查机器名称

为了后续操作方便,确保机器的hostname是我们想要的。拿192.168.119.128这台机器为例,用root账户登录,然后使用hostname命令查看机器名称

(1)永久的修改主机名

【1】切换到root用户

【2】vi /etc/sysconfig/network

HOSTNAME=localhost.localdomain #修改localhost.localdomain为reserver2

vi /etc/hosts

127.0.0.1 localhost.localdomain #修改localhost.localdomain为reserver2

【3】reboot重启

(2)centOS修改ip地址

【1】进入网络配置文件目录

首先,确保在root用户下进行操作。进入网络配置文件network-scripts目录下。

cd /etc/sysconfig/network-scripts/

找到我们需要修改的配置文件

使用ls命令,列出该目录下的文件。其中“ifcfg-ens33”(或ifcfg-eth0)(红框)的文件,为我们需要修改的网络配置文件

【2】vi ifcfg-eth0

安insert(进入编辑模式)我们需要修改BOOTPROTO="static"也就是将dhcp改为static(把ip由动态改成静态),修改ONBOOT="yes" 意思是将网卡设置 为开机启用,同时在文字下方添加

IPADDR=192.168.0.230 #静态IP

GTEWAY=192.168.0.1 #默认网关

NETMASK=255.255.255.0 #子网掩码

DNS1=192.168.0.1 #DNS 配置DNS2=8.8.8.8 #谷歌地址

【3】service network restart 重启网络服务

1.3 修改/etc/hosts文件

修改这3台机器的/etc/hosts文件,在文件中添加以下内容:

192.168.119.128 hserver1 192.168.119.129 hserver2 192.168.119.130 hserver3

配置完成后使用ping命令检查这3个机器是否相互ping得通,以hserver1为例,在什么执行命令:

ping -c 3 hserver2

如图:

执行命令:

ping -c 3 hserver3

如图:

ping得通,说明机器是互联的,而且hosts配置也正确。

1.4给3个机器生成秘钥文件

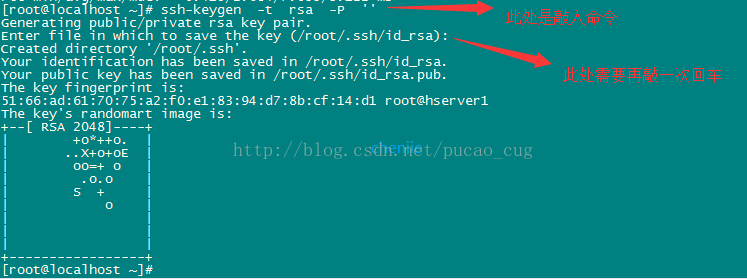

以hserve1为例,执行命令,生成空字符串的秘钥(后面要使用公钥),命令是:

ssh-keygen -t rsa -P ''

因为我现在用的是root账户,所以秘钥文件保存到了/root/.ssh/目录内,可以使用命令查看,命令是:

ls /root/.ssh/

如图:

使用同样的方法为hserver2和hserver3生成秘钥(命令完全相同,不用做如何修改)。

1.5在hserver1上创建authorized_keys文件

接下来要做的事情是在3台机器的/root/.ssh/目录下都存入一个内容相同的文件,文件名称叫authorized_keys,文件内容是我们刚才为3台机器生成的公钥。为了方便,我下面的步骤是现在hserver1上生成authorized_keys文件,然后把3台机器刚才生成的公钥加入到这个hserver1的authorized_keys文件里,然后在将这个authorized_keys文件复制到hserver2和hserver3上面。

1.6将authorized_keys文件复制到其他机器

1.7测试使用ssh进行无密码登录

在hserver1上进行测试

输入命令:

ssh hserver2

exit回车

输入命令:

ssh hserver3

exit回车

在这个过程中如果你已经配置完无密登陆时,但还需要密码的话,那可能就是authorized_keys的权限不够,你可以百度一下这方面解决。

2安装jdk和hadoop

2.1安装jdk

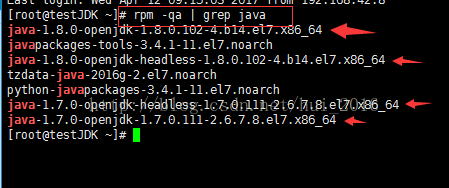

2.1.1使用CentOS7卸载自带jdk

(1) rpm -qa | grep java 命令来查询出系统自带的jdk(带箭头的四个就是系统自带的)注:不带箭头的那三个不要删掉

(2)然后通过 rpm -e --nodeps 后面跟系统自带的jdk名 这个命令来删除系统自带的jdk,

(3)删完之后可以再通过 rpm -qa | grep Java 命令来查询出是否删除掉

2.1.2 安装jdk

(1)在usr下新建一个java文件夹,把jdk拷进去

(2)cd /usr/java 回车

进入到上载过jdk文件的目录后,接着执行解压命令

tar -zxvf jdk-8u141-linux-x64.tar.gz 回车(我centos是64位的,所以jdk也是64位的)

(3)修改配置文件

vim /etc/profile

把这个加在末尾

JAVA_HOME=/usr/java/jdk1.8.0_141

CLASSPATH=$JAVA_HOME/lib/

PATH=$PATH:$JAVA_HOME/bin

export PATH JAVA_HOME CLASSPATH

(4)修改了/etc/profile文件后,需要把这个文件里保存的命令执行一次(方法是使用source命令)

执行命令 source /etc/profile回车

(5)测试是否安装成功

执行命令 java -version回车

注意:将配置内容(其实是命令脚本)写到/etc/profile中目的就是让任意用户登录后,都会自动执行该脚本,这样这些登录的用户就可以直接使用jdk了。如果因为某个原因该脚本没有自动执行,自己手动执行以下就可以了(也就是执行命令source /etc/profile)

2.2 安装hadoop

注意: 3台机器上都需要重复下面所讲的步骤。

2.2.1 上载文件并解压缩

在opt目录下新建一个名为hadoop的目录,并将下载得到的hadoop-2.8.0.tar上载到该目录下,如图:

进入到该目录,执行命令:

cd /opt/hadoop

执行解压命令:

tar -xvf hadoop-2.8.0.tar.gz

说明:3台机器都要进行上述操作,解压缩后得到一个名为hadoop-2.8.0的目录。

3.2.2新建几个目录

在/root目录下新建几个目录,复制粘贴执行下面的命令:

- mkdir /root/hadoop

- mkdir /root/hadoop/tmp

- mkdir /root/hadoop/var

- mkdir /root/hadoop/dfs

- mkdir /root/hadoop/dfs/name

- mkdir /root/hadoop/dfs/data

3.2.3 修改etc/hadoop中的一系列配置文件

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop目录内的一系列文件。

3.2.3.1 修改core-site.xml

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop/core-site.xml文件

在<configuration>节点内加入配置:

<property>

<name>hadoop.tmp.dir</name>

<value>/root/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.default.name</name>

<value>hdfs://hserver1:9000</value>

</property>

</configuration>

3.2.3.2 修改hadoop-env.sh

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop/hadoop-env.sh文件

将export JAVA_HOME=${JAVA_HOME}

修改为:

export JAVA_HOME=/opt/java/jdk1.8.0_121

说明:修改为自己的JDK路径

3.2.3.3 修改hdfs-site.xml

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop/hdfs-site.xml文件

在<configuration>节点内加入配置:

<property>

<name>dfs.name.dir</name>

<value>/root/hadoop/dfs/name</value>

<description>Path on the local filesystem where theNameNode stores the namespace and transactions logs persistently.</description>

</property>

<property>

<name>dfs.data.dir</name>

<value>/root/hadoop/dfs/data</value>

<description>Comma separated list of paths on the localfilesystem of a DataNode where it should store its blocks.</description>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

<description>need not permissions</description>

</property>

说明:dfs.permissions配置为false后,可以允许不要检查权限就生成dfs上的文件,方便倒是方便了,但是你需要防止误删除,请将它设置为true,或者直接将该property节点删除,因为默认就是true。3.2.3.4 新建并且修改mapred-site.xml

在该版本中,有一个名为mapred-site.xml.template的文件,复制该文件,然后改名为mapred-site.xml,命令是:

- cp /opt/hadoop/hadoop-2.8.0/etc/hadoop/mapred-site.xml.template /opt/hadoop/hadoop-2.8.0/etc/hadoop/mapred-site.xml

修改这个新建的mapred-site.xml文件,在<configuration>节点内加入配置:

<property>

<name>mapred.job.tracker</name>

<value>hserver1:49001</value>

</property>

<property>

<name>mapred.local.dir</name>

<value>/root/hadoop/var</value>

</property>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

3.2.3.5 修改slaves文件

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop/slaves文件,将里面的localhost删除,添加如下内容:

- hserver2

- hserver3

3.2.3.6 修改yarn-site.xml文件

修改/opt/hadoop/hadoop-2.8.0/etc/hadoop/yarn-site.xml文件,

在<configuration>节点内加入配置(注意了,内存根据机器配置越大越好,我这里只配2个G是因为机器不行):

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hserver1</value>

</property>

<property>

<description>The address of the applications manager interface in the RM.</description>

<name>yarn.resourcemanager.address</name>

<value>${yarn.resourcemanager.hostname}:8032</value>

</property>

<property>

<description>The address of the scheduler interface.</description>

<name>yarn.resourcemanager.scheduler.address</name>

<value>${yarn.resourcemanager.hostname}:8030</value>

</property>

<property>

<description>The http address of the RM web application.</description>

<name>yarn.resourcemanager.webapp.address</name>

<value>${yarn.resourcemanager.hostname}:8088</value>

</property>

<property>

<description>The https adddress of the RM web application.</description>

<name>yarn.resourcemanager.webapp.https.address</name>

<value>${yarn.resourcemanager.hostname}:8090</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>${yarn.resourcemanager.hostname}:8031</value>

</property>

<property>

<description>The address of the RM admin interface.</description>

<name>yarn.resourcemanager.admin.address</name>

<value>${yarn.resourcemanager.hostname}:8033</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.scheduler.maximum-allocation-mb</name>

<value>2048</value>

<discription>每个节点可用内存,单位MB,默认8182MB</discription>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-check-enabled</name>

<value>false</value>

</property>

说明:yarn.nodemanager.vmem-check-enabled这个的意思是忽略虚拟内存的检查,如果你是安装在虚拟机上,这个配置很有用,配上去之后后续操作不容易出问题。如果是实体机上,并且内存够多,可以将这个配置去掉。

最后把他们复制到hserver2,hserver3中,修改core-site.xml文件将fs.defaultFs对应的value中master修改为对应hostname

4启动hadoop

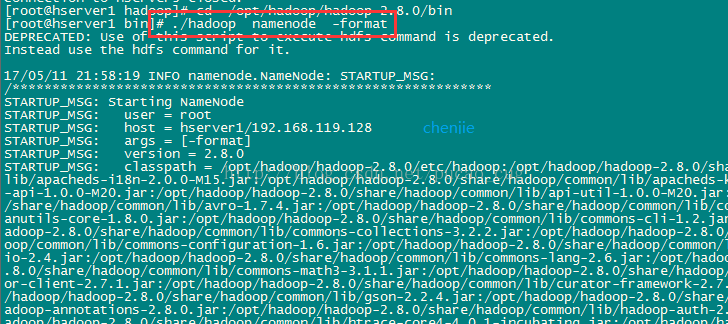

4.1在namenode上执行初始化

因为hserver1是namenode,hserver2和hserver3都是datanode,所以只需要对hserver1进行初始化操作,也就是对hdfs进行格式化。

进入到hserver1这台机器的/opt/hadoop/hadoop-2.8.0/bin目录,也就是执行命令:

cd /opt/hadoop/hadoop-2.8.0/bin

执行初始化脚本,也就是执行命令:

./hadoop namenode -format

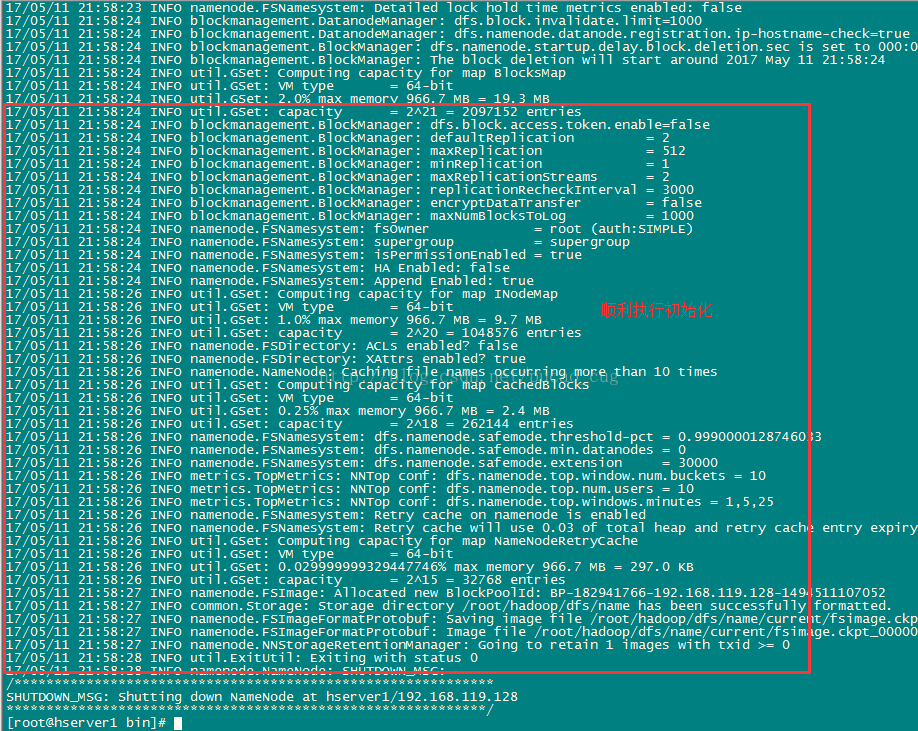

如图:

稍等几秒,不报错的话,即可执行成功,如图:

格式化成功后,可以在看到在/root/hadoop/dfs/name/目录多了一个current目录,而且该目录内有一系列文件

如图:

4.2在namenode上执行启动命令

因为hserver1是namenode,hserver2和hserver3都是datanode,所以只需要再hserver1上执行启动命令即可。

进入到hserver1这台机器的/opt/hadoop/hadoop-2.8.0/sbin目录,也就是执行命令:

cd /opt/hadoop/hadoop-2.8.0/sbin

执行初始化脚本,也就是执行命令:

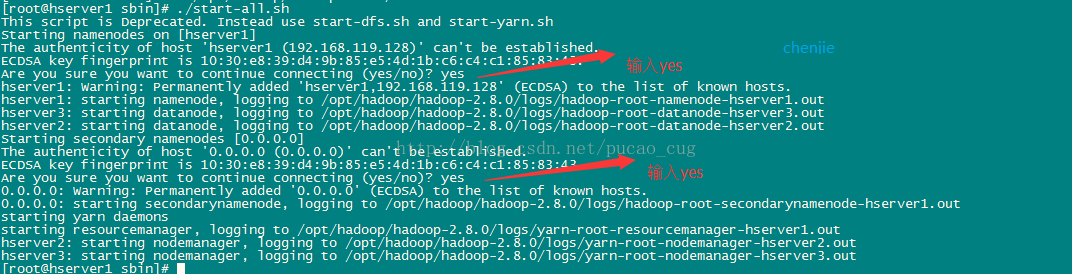

./start-all.sh

第一次执行上面的启动命令,会需要我们进行交互操作,在问答界面上输入yes回车

如图:

5测试hadoop

haddoop启动了,需要测试一下hadoop是否正常。

执行命令,关闭防火墙,CentOS7下,命令是:

systemctl stop firewalld.service

centOS 6.5关闭防火墙步骤

关闭命令: service iptables stop

永久关闭防火墙:chkconfig iptables off

两个命令同时运行,运行完成后查看防火墙关闭状态

service iptables status

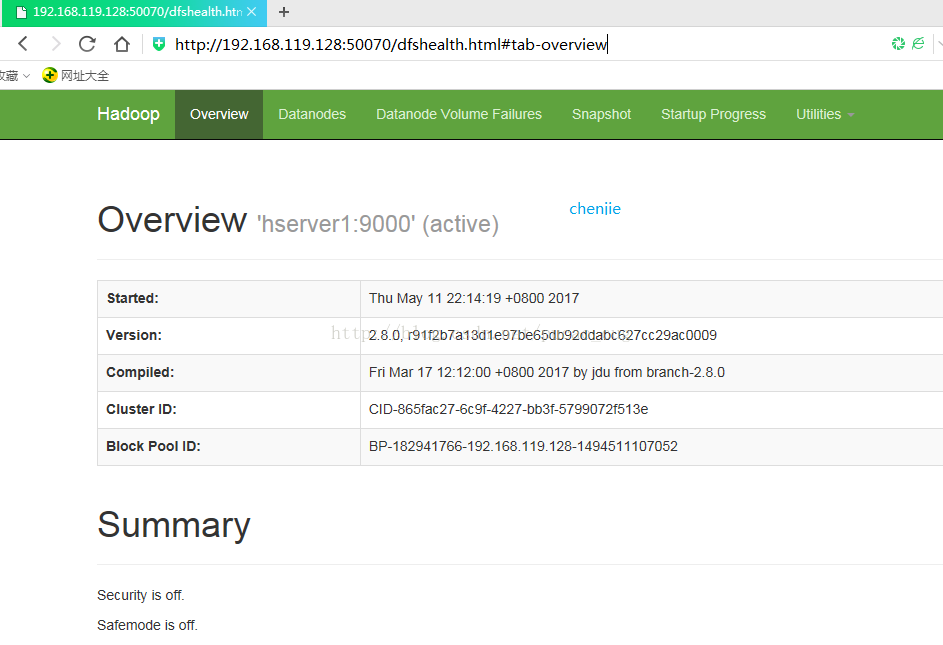

hserver1是我们的namanode,该机器的IP是192.168.119.128,在本地电脑访问如下地址:

自动跳转到了overview页面

如图:

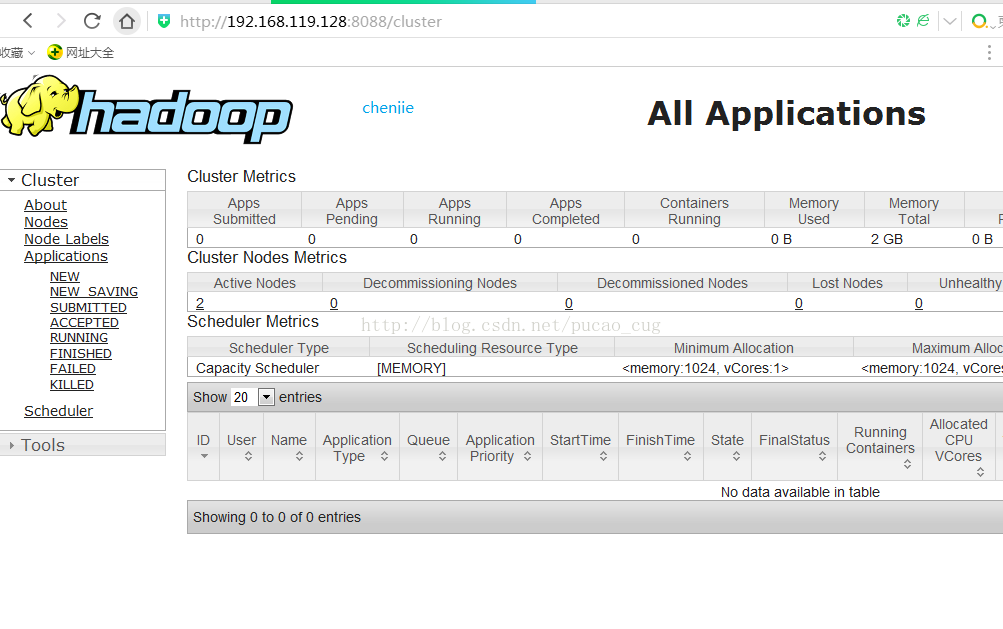

在本地浏览器里访问如下地址:

自动跳转到了cluster页面

如图:

切记如果你的电脑和虚拟机在同一个网段,彼此可以ping通,那么可以在本地浏览器访问,否则只能在虚拟机浏览器访问。

参照这个大神的搭建的https://blog.csdn.net/pucao_cug/article/details/71698903