嘿,各位深度学习战士!今天我们要探讨的是深度学习中的“公平守护者”——处理样本不平衡问题的方法。在面对不平衡数据时,这些方法可以帮助我们训练出更强大且公正的模型。现在,让我们来了解这些方法吧!

第一步:了解样本不平衡

样本不平衡指的是在数据集中,不同类别的样本数量差别很大。这种情况会导致模型偏向于多数类别,而对少数类别的预测效果较差。

第二步:重采样技术

重采样是解决样本不平衡问题的一种常用方法,有两种策略:

-

过采样(Oversampling):对少数类别样本进行复制或生成新样本,增加其在数据集中的数量。

-

欠采样(Undersampling):对多数类别样本进行删除或随机选择,减少其在数据集中的数量。

第三步:类别权重调整

通过为每个类别设置不同的权重,我们可以让模型更关注少数类别。

-

权重平衡法(Class Weighting):设置每个类别的权重,让模型在训练时更关注少数类别。

-

Focal Loss:Focal Loss可以调整损失函数,使得模型在重要样本上的学习更加“聚焦”。

第四步:生成式对抗网络(GAN)

GAN是一种强大的生成模型,可以通过生成新的样本来增加少数类别的数据量。

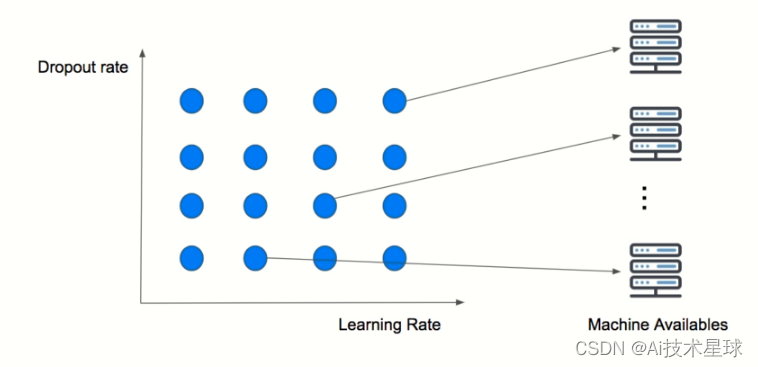

第五步:集成学习

通过将多个模型的预测结果结合起来,可以提高模型的性能,并减轻样本不平衡问题的影响。

感谢大家对文章的喜欢,欢迎关注威 |

❤公众号【AI技术星球】回复(123) |

白嫖配套资料+60G入门进阶AI资源包+技术问题答疑+完整版视频 |

内含:深度学习神经网络+CV计算机视觉学习(两大框架pytorch/tensorflow+源码课件笔记)+NLP等 |

综上所述,处理深度学习中的样本不平衡问题有多种方法。重采样技术、类别权重调整、GAN和集成学习等方法都可以帮助我们训练出更公平、更强大的模型。记住要根据具体问题和数据特点选择合适的方法,相信你会解决样本不平衡问题,让模型在不同类别上表现公正且优异!加油,你们是最棒的!