关键字: [Amazon Web Services re:Invent 2023, Generative Ai, 亚马逊云科技, Model Development, Machine Learning, Fine Tuning]

本文字数: 1700, 阅读完需: 8 分钟

视频

如视频不能正常播放,请前往bilibili观看本视频。>> https://www.bilibili.com/video/BV1fi4y1v7Wa

导读

了解如何通过 HPE 的托管、可扩展和安全的HPE机器学习开发环境,加速组织采用生成式 AI。学习通过 HPE 的托管服务和生成式 AI 解决方案消除运营瓶颈,如解决方案和模型选择、基础架构部署和平台管理。了解如何授权团队专注于模型评估和定制,以提供更快的价值实现时间,并将 AI 无缝集成到产品和流程中。了解如何通过在亚马逊云科技和内部部署环境中创建高效和可扩展的机器学习工作负载,促进协作和创新。最后,学习如何在不升级叉车的情况下将生成式 AI 模型和应用程序从原型移动到生产。本演示文稿由亚马逊云科技合作伙伴 Hewlett-Packard Enterprise 为您带来。

演讲精华

以下是小编为您整理的本次演讲的精华,共1400字,阅读时间大约是7分钟。如果您想进一步了解演讲内容或者观看演讲全文,请观看演讲完整视频或者下面的演讲原文。

会议由来自惠普企业的产品经理乔舒亚·贝诺尼欢迎与会者参加关于使用惠普企业的机器学习开发环境(MLDE)平台支持生成性人工智能驱动的企业突破性研讨会议。他介绍了他的同事拉姆,两人将共同进行演示。

乔舒亚概述了即将进行的这堂50分钟课程的内容。首先,他们将讨论企业在与生成性人工智能共事的五个常见阶段。接着,他们将涵盖企业在整个机器学习模型开发过程中面临的挑战,以及如何借助合适的资源和合作伙伴关系克服这些挑战。

随后,乔舒亚和拉姆将介绍惠普企业的机器学习开发环境,这是一个专为支持完整模型开发周期而设计的强大AI开发平台,包括特定于生成性人工智能的方面。他们将详细介绍使MLDE成为企业级解决方案的十多种功能。

此外,他们将演示如何使用MLDE的评估游乐场、提示工程和简化的单击优化等功能来激发并加速生成性人工智能计划。他们还将在托管服务的部分中讨论他们的托管服务产品,该服务便于轻松部署和持续管理MLDE环境。

最后,乔舒亚提到他们将展示一个端到端的托管服务的部署,时间为5-10分钟,并将展示一个生成性人工智能的演示,重点突出三个常见的使用场景。鼓励与会者注册免费的30天MLDE试用,以亲身体验其功能。

在准备就绪之后,拉姆接手,讲述了企业经历生成的五个阶段的旅程。他解释说,第一个阶段是作为模型消费者,他们只想使用内置了AI功能的现成解决方案,而无需进行任何定制工作。这种便利是有益的,但过度依赖第三方模型也有缺点。

拉姆给出了一个例子,流行的生成性人工智能系统OpenAI最近经历了3小时的停机时间,这影响了任何依赖于它的应用程序。他用一个类比来说明,是依靠电力公司供应电力还是拥有像太阳能板或发电机这样的备用电源。类似地,组织可能想考虑使用AI的替代品,以避免中断。

第二阶段被称为模型评估阶段。在这个阶段,企业不仅使用一个模型,而是评估多种选项,如开源模型,如Anthropic的Claude、Cohere和Hugging Face的Transformer实现。这样的优势是可以避免供应商锁定,并且能够根据不同的应用场景在不同的指标上(如准确性、速度和成本)进行比较。例如,对于游戏公司来说,低延迟可能是最重要的,而制药研究人员则更关注准确性。Ram强调,评估模型有助于确定满足特定需求的合适模型。

在第三阶段,即应用构建阶段,组织希望进行更多的定制,并利用AI模型、知识库和数据库来构建自己的应用程序。因此,除了提示工程外,他们现在还需要开发应用程序。

第四阶段的模型定制阶段,企业利用其领域数据对模型进行微调,以实现更大的差异化。此时,提示工程、应用建设和微调都发挥作用。

最后的第五阶段被认为是最先进的,即成为模型生产商,其中组织使用大量数据集从头训练模型以出售给客户,就像Anthropic、Cohere和OpenAI所做的那样。这需要大量的计算资源。

总的来说,Ram强调了确定一个组织在人工智能进程中的位置以选择正确工具以实现快速进步的重要性。不同的阶段需要不同的解决方案。

然而,企业在面对挑战时也会遇到一些问题。Ram指出,最大的痛点之一是缺乏内部专业知识。许多想要利用AI但缺乏技术技能的公司面临着这个问题。另一个主要问题是决定在开源和商业模型之间进行选择。前者允许自定义和透明度,但后者提供更便捷的服务。此外,数据安全和隐私问题也需要考虑。

评估和选择不断涌现的开源模型是一个额外的挑战。从原型到生产的扩展以及基础设施和工作负载的管理也带来了自己的复杂性。这些问题是HPE MLDE旨在解决的一些问题。

Josh随后介绍了机器学习开发环境概述。他将其描述为HPE专为支持整个生成性AI生命周期设计的AI和ML开发平台。

机器学习开发环境(MLDE)致力于支持团队协作,确保实验的可重复性,并利用分布式训练加速模型开发。这个环境使得来自Hugging Face等地的现成模型可以轻松评估,同时保持控制和安全性,因为它们都是自托管的。用户可以通过可解释的方式进行提示工程和简单的1-点击微调来定制满足他们需求的模型。

MLDE与Hugging Face Hub紧密集成,方便用户访问模型和数据集。更重要的是,它有助于实现从原型到生产部署的平稳过渡。

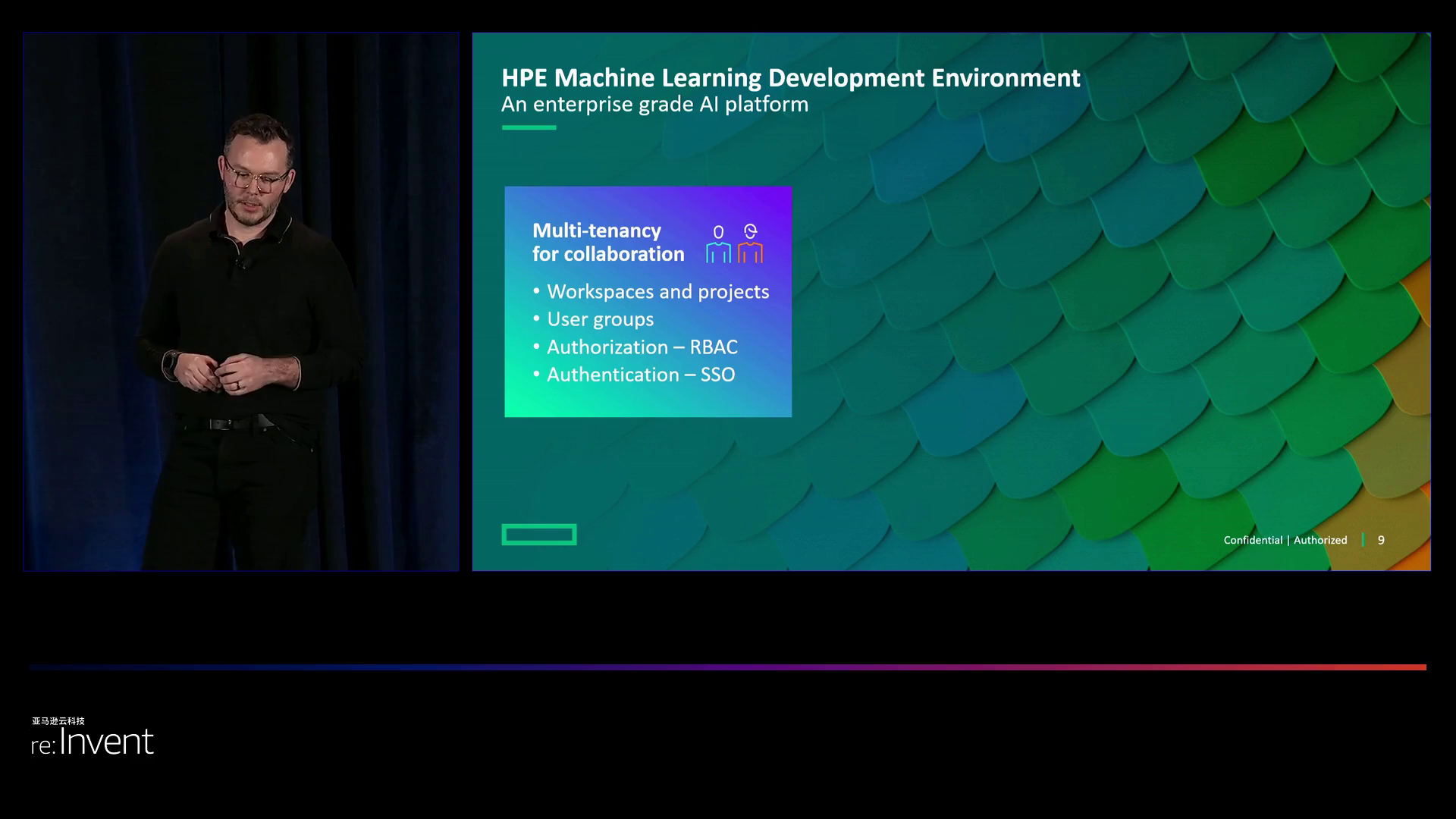

Josh详细介绍了MLDE的一些关键功能,如多租户支持,这使得团队可以在不重复努力的情况下安全地协作。此外,MLDE还提供访问控制、通过实验跟踪的重现性以及通过分布式训练和超参数优化更快更准确的模型。

MLDE独立于基础设施运行,支持诸如亚马逊云科技亚马逊云科技和GCP这样的公共云以及Kubernetes。集成的托管服务使得MLDE集群的部署和管理具有最小的开销。此外,它还提供了监控、安全控制和指导的入门指南。

Ram探讨了MLDE在生成性人工智能方面的优势。它可以快速验证想法,并通过引导式提示工程缩短时间。以数据集为中心的提示允许批量生成100多个输出,而不是每个输入。一键微调简化了像Claude这样的模型的定制过程。紧密的Hugging Face集成使得模型和数据的发现和使用变得更加容易。最重要的是,MLDE通过提供模型权重、日志和代码等工件的全面透明度,促进了从原型到生产的过渡。

Ram给出了两个客户如何在MLDE中发现巨大价值的例子。Recursion Pharmaceuticals利用计算机视觉和机器学习分析显微镜图像并发现新药物。他们在管理用于训练的100多个GPU的大型多GPU工作负载方面遇到了困难。MLDE的无尽扩展、超参数搜索和跟踪的功能帮助他们很多。

Aleph Alpha,一家位于欧洲的初创公司,致力于研发基础模型,正寻求一个能够将基础设施和软件无缝结合在一起的端到端平台,以便实现从原型到大规模生产的扩展。在这种情况下,MLDE(机器学习数据中心引擎)为其提供了一个一站式解决方案,并与高性能服务器相整合,以应对其复杂的业务需求。

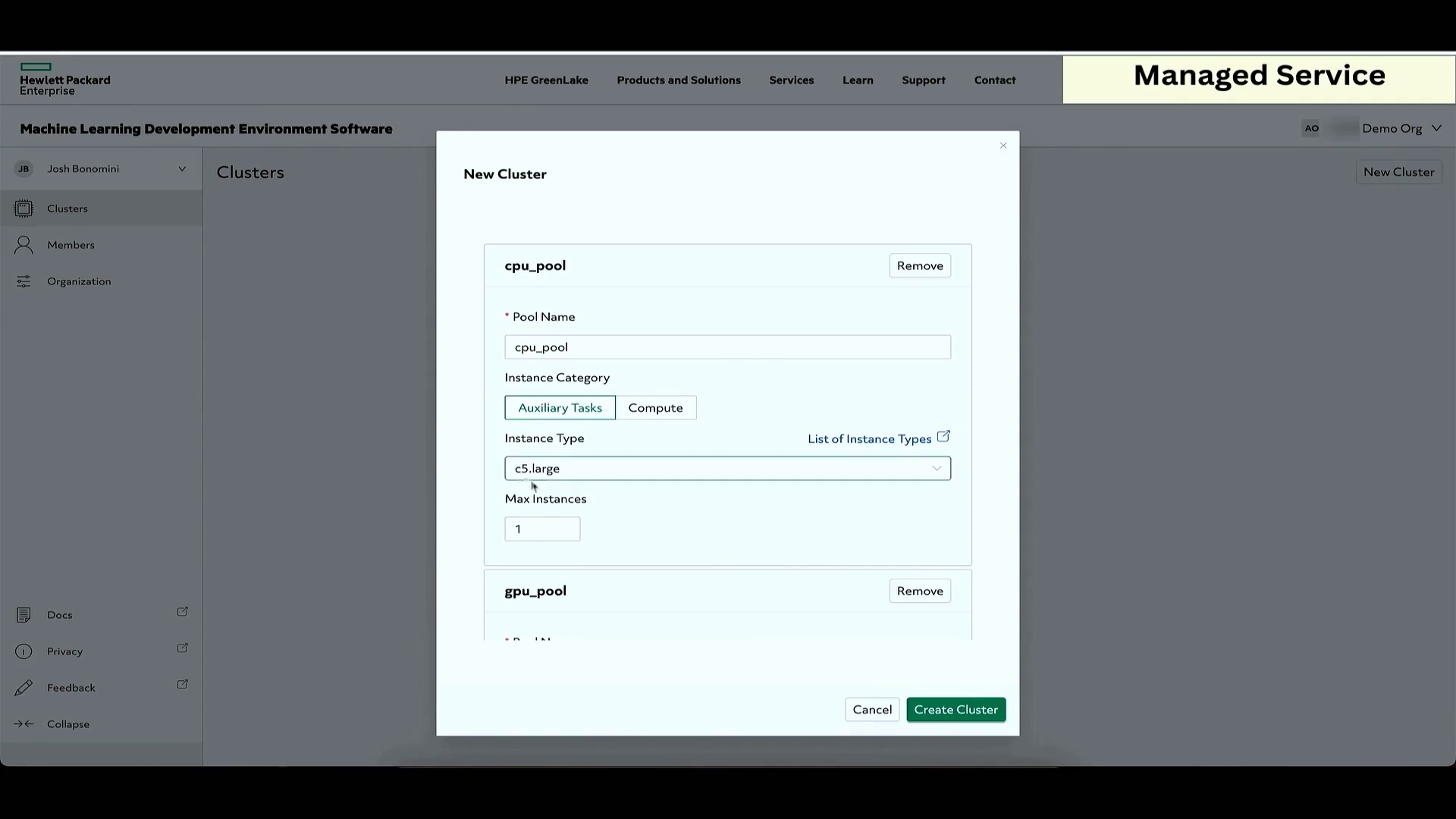

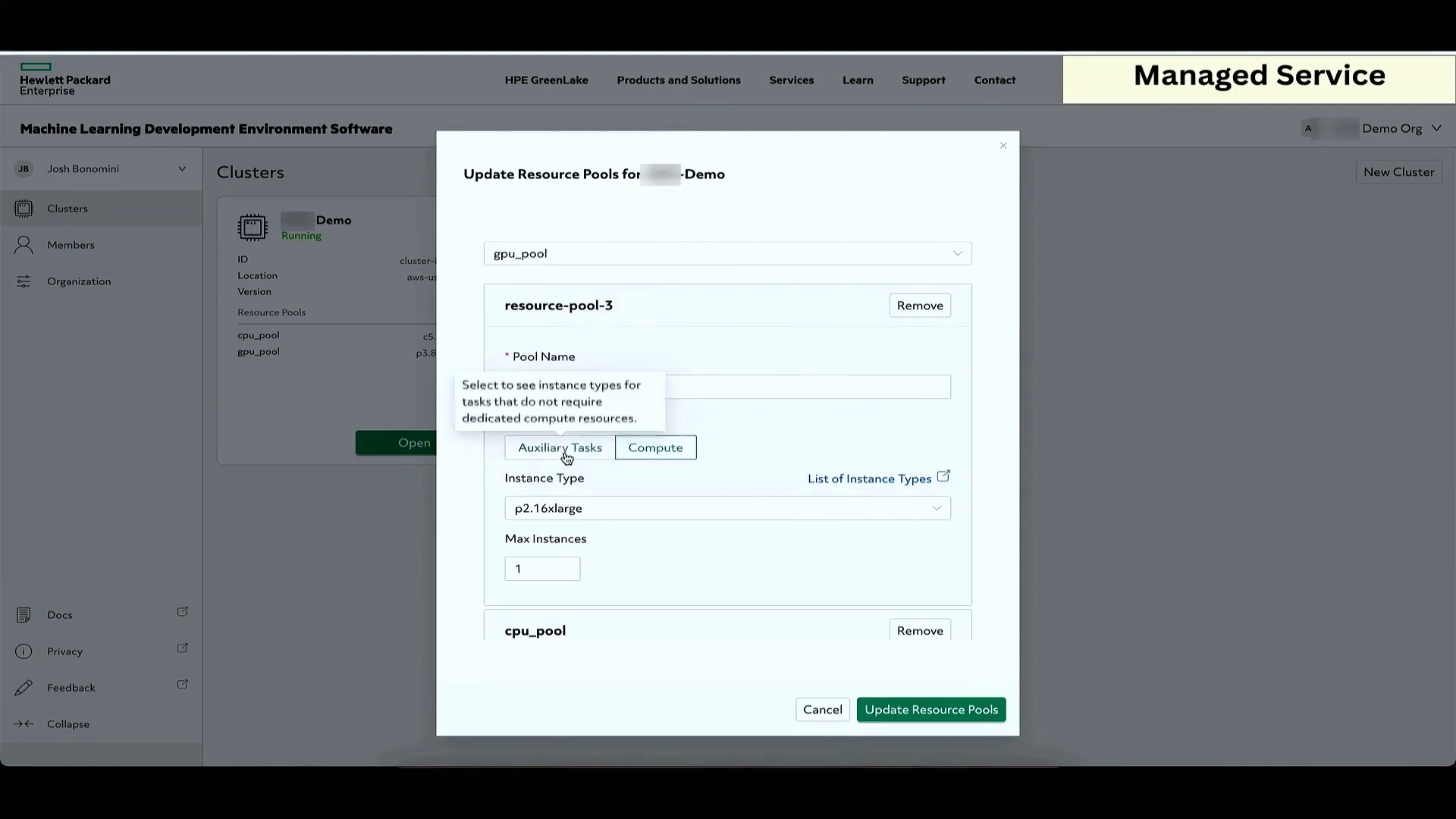

Josh(乔希)向观众介绍了MLDE在诸如亚马逊云科技和谷歌云平台等公共云环境中的托管服务功能。通过这种方式,企业可以在最低成本下部署和管理MLDE。他们甚至可以自带云账户,而HPE(惠普企业)将负责设置、升级、备份、扩展等工作。

这个服务提供了易于扩展性、监控、如RBAC(基于角色的访问控制)等安全控制以及指导式的上线流程。这使得团队能够专注于模型的开发,而无需担心基础设施的管理。

乔希还进行现场演示,向观众展示了管理员如何在亚马逊云科技上轻松地部署MLDE托管服务。只需要提供三条信息和一个云形成模板,就可以在3-5分钟内完成后台设置。最终用户随后便可以使用部署的MLDE集群来创建工作空间,启动Jupyter笔记本,并通过命令行界面进行实验。

Ram(拉姆)接着进行了一个针对客户支持使用情况演示。他使用了MLDE的生成性AI工作室,将一份长达500多字的投诉票证简化为几个简洁的20字句子。然后,他提出了一个关于投诉的问题,并从AI获得了一个相关的答案。接下来,他用几个示例将门票归类为三个类别,这是一种称为少数拍摄学习的技术。

通过一个包含30,000多个门票的数据集,拉姆进行了批量分类,并将AI的预测与真实标签进行了比较。有些不匹配,这表明需要进行调整以提高准确性。他只需点击一下,就可以在8个GPU上启动一个完整的500步调整作业,并向观众展示MLDE如何提供对训练过程的可见性,包括参数更改、检查点和对日志的访问。

经过调整后,模型的预测更接近真实值,展示了定制化的力量。拉姆只用几步就将现成的模型转换为一个针对他的使用情况进行的精细调整版本——这正是MLDE的一个关键优势。

在总结中,演讲者强调,机器学习开发环境(MLDE)的目标是为企业提供采用生成性人工智能的平台。这个平台旨在简化协作、模型评估、基于提示和数据集的生成、可解释的微调以及规模化的部署过程。为了让更多人亲身体验其功能,演讲者鼓励感兴趣的与会者注册一个免费的30天试用。

下面是一些演讲现场的精彩瞬间:

亚马逊云科技的部门负责人探讨了如何助力企业实现生成性人工智能和革命性的机器学习。

通过其机器学习平台开发环境(MLDE),用户可以轻松地组织和共享工作空间及项目,实现高效的团队协作。

部门负责人表示,在MLDE平台上,可以通过配置网络拓扑来避免现有环境中的冲突。

此外,部门负责人还讨论了如何优化亚马逊云科技的实例类型以及针对不同工作负载的扩展限制。

在亚马逊云科技控制台中,用户可以轻松配置和管理EKS集群和节点组。

部门负责人还通过Amazon SageMaker展示了如何对客户投诉进行批量推理,并对比预测结果与实际数据的差异。

最后,部门负责人通过扫描二维码邀请观众参加测试新的机器学习开发环境。

总结

本次演讲主要介绍了惠普企业的机器学习开发环境(MLDE),这是一个专为开发和部署生成性人工智能(AI)模型的AI平台。该环境概述了企业在采用AI技术过程中可能遇到的常见问题,包括专业知识匮乏、数据安全和从原型到生产的扩展问题。MLDE旨在解决这些问题,通过其简化的部署托管服务、内置的模型监控MLOps、可扩展的分布式训练以及基于角色的访问控制(RBAC)等安全功能。

对于生成性AI领域,MLDE使得研发团队能够轻松评估、定制和优化开源模型,例如LaMDA和GPT-3。这得益于其引导式的工作流程、透明的模型训练过程以及一键式微调功能。此外,MLDE还拥有模型注册表、可重复性功能以及与持续集成/持续部署(CI/CD)管道的集成,从而促进了模型向生产环境的迁移。总之,MLDE通过提供一个跨越模型开发、运营和部署的企业级就绪平台,加速并降低了组织在生成性AI领域的风险。

演讲原文

https://blog.csdn.net/just2gooo/article/details/134996783

想了解更多精彩完整内容吗?立即访问re:Invent 官网中文网站!

2023亚马逊云科技re:Invent全球大会 - 官方网站

点击此处,一键获取亚马逊云科技全球最新产品/服务资讯!

点击此处,一键获取亚马逊云科技中国区最新产品/服务资讯!

即刻注册亚马逊云科技账户,开启云端之旅!

【免费】亚马逊云科技中国区“40 余种核心云服务产品免费试用”

亚马逊云科技是谁?

亚马逊云科技(Amazon Web Services)是全球云计算的开创者和引领者,自 2006 年以来一直以不断创新、技术领先、服务丰富、应用广泛而享誉业界。亚马逊云科技可以支持几乎云上任意工作负载。亚马逊云科技目前提供超过 200 项全功能的服务,涵盖计算、存储、网络、数据库、数据分析、机器人、机器学习与人工智能、物联网、移动、安全、混合云、虚拟现实与增强现实、媒体,以及应用开发、部署与管理等方面;基础设施遍及 31 个地理区域的 99 个可用区,并计划新建 4 个区域和 12 个可用区。全球数百万客户,从初创公司、中小企业,到大型企业和政府机构都信赖亚马逊云科技,通过亚马逊云科技的服务强化其基础设施,提高敏捷性,降低成本,加快创新,提升竞争力,实现业务成长和成功。