截至2023年8月,在算法备案系统登记的相关算法已经有151个,我们可以观察到All in AI的中国公司布局生成式AI算法的现状。在这151个算法中,33.8%的生成合成式算法都集中在文本生成领域,而图像、多媒体和音频方向也是各家的主攻方向之一。

图片来源:澎湃《AI狂飙的这一年,我们的工作被取代了多少?》 https://www.thepaper.cn/newsDetail_forward_25440475

可以看到腾讯、阿里、百度、字节、抖音、网易、金山、商汤、华为、京东、快手、美图、科大讯飞等25家互联网知名大厂是算法申报成功的主力,总共有104个算法通过备案,占比高达68.8%,平均每家企业成功申报4个算法备案。而35家互联网小厂,总共仅有47个算法通过备案,仅占比31.2%,平均每家企业只成功申报1.3个算法。而根据各大机构公布的AIGC产业图谱中,市场上已公开发布的近百家大模型和数百个AIGC应用,绝大部分都还未成功拿到算法备案号,或者还并未进行算法备案申请,也就是说仍在业务“裸奔”状态。

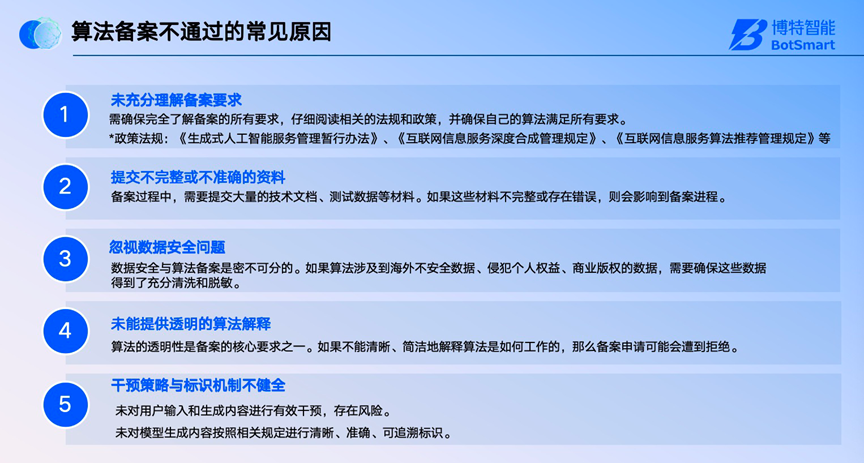

毫无疑问的是,无论你的产品服务形态是网页、App、小程序,只要涉及深度合成技术服务(文本、图片、音频、视频、虚拟现实等)都需要进行算法备案,接受监管,否则将会让自己的业务和用户置身于极大的不确定性中。那么如何避坑,博特智能AIGC安全实验室根据辅导20+算法的备案过程中,总结出以下避坑指南:

首先,充分理解算法备案的要求。《生成式人工智能服务管理暂行办法》、《互联网信息服务深度合成管理规定》、《互联网信息服务算法推荐管理规定》是进行算法备案的基础法规依据,必须认真阅读,从法规的视角来审视,避免自说自话,确保算法符合三个法律法规的要求。

第二,提交的内容完整准确。申报官网上提供的相应模板里面已经提出了超过200个应答点。需要备案人针对每个应答点做一一的响应和准确回答。如果填写不完整或存在错误缺失,都会影响备案的通过。

第三,数据安全问题,由于对数据安全考虑得不周密,例如备案中涉及到了一些训练数据是海外不安全的数据;或者选择的机构模型无法溯源说明它原始训练的数据安全;另外可能会涉及到侵犯个人权益商业版权的事情,没有去做充分的清洗和脱敏,例如有些客户训练数据会用到了一些像法律判决书。医疗诊断报告等等,建议脱敏和授权以后再去使用,否则很难通过。

第四,算法。提供透明的算法解释。模型输入输出策略点每一步该如何设计,需要以最小的颗粒,足够透明去呈现给监管单位。

第五,干预策略和标签:干预策略需要对用户输入输出内容做审核过滤和有效干预,当最后给用户输出的时候发现本身是存在风险的,那它肯定是不安全的。另外,标识需要清晰、准确、确保可被实名追溯,以更好的保护用户的知情权。

特别注意点

IMPORTANT POINTS

✅ 同一种算法可能被用于不同应用产品时,只需要一项备案即可;同一款产品如果触及多类算法,应当申请多个算法备案。

✅ 若是深度合成类的,是使用他人API算法的,也是需要备案,在备案的身份里应选择"服务提供者",而不是“服务支持者”。

✅ 备案编号是分批次发放的。根据实际经验,往往只有驳回的意见会通知给你,通过并不会给你一个明确的回复。

✅ 做了大模型的项目,项目还是用到了生成式算法的企业,除了要进行算法备案,还需在网信那边做安全评估,安全评估主要流程是审核评估报告,监测项目包括业务,黑盒,算法漏洞测试等,进行这个流程需先进行算法备案。

✅ 主体认证期间,注意接听带有区号的网信办座机电话,以北京为例,未接听电话,会直接导致主体认证不通过,继而影响下一阶段算法备案填报进度。

✅ 主体认证期间,尽量避免进行大规模产品迭代,确保申报报告与产品的一一对齐,否则会影响备案。