一个不知名大学生,江湖人称菜狗

original author: jacky Li

Email : [email protected]

Last edited: 2022.11.27

目录

这里菜狗,大佬让路

一:效果展示

二:所需配置

1.环境配置

mediapipe

cv2

pytorch

xgboost

numpy

2.准备展示

三:算法设计

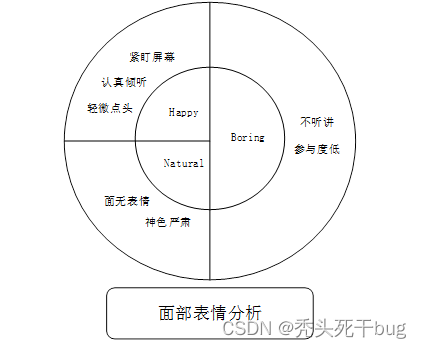

一、参与度判断标准

我们通过表情特征将学习者情感状态主要划分为三类,分别是开心、中性、无聊。依据伊扎德面部编码系统,通过面部表情结合扭转角度与头部姿态来判断这四种状态。

| 学习效率 |

表情特征 |

头部姿态特征 |

计算机分析情况 |

| 积极参与课堂 并且能听懂 |

愉快,开心表情放松 |

扭头或直视(头部角度|α|变化在 0~30度之间) |

参与度较高且对课堂内容掌控较好(持续进行跟踪判断) |

| 积极参与课堂并得到了理解 |

仰头或低头(头部角度|β|变化在 0~15度之间) |

||

| 参与课堂但是对课堂内容有疑惑 |

面无表情 |

直盯屏幕,没有表情明显特征波动,脸部神情较为严肃(特征角度变化不明显) |

参与度较高但对课堂内容掌握可能较差(课后进行提醒与反馈老师) |

| 不参与课堂,对课堂内容不感兴趣 |

无聊、不屑 |

低头或扭头(角度变化|α|大于30度;或者脸部检测失败) |

参与度较低(当长期处于当前状态会进行实时提醒,并反馈给老师。) |

表1:线上教学中常见的学生心

二、基于视频图像的人脸检测方法

在目前的线上教学过程中,学习者会呈现不同的姿态、表情与行为,且受于线上教学的影响,每位学习者上课环境不同,因此监控视频影像中的场景较为复杂多变。但是也正是因为线上教学,学习者与学习屏幕之间的距离不会超出一定的范围,而自带的摄像头通常可以完成较为清晰的对目标的连续拍摄,所以可以有效捕捉学习者的人脸信息。

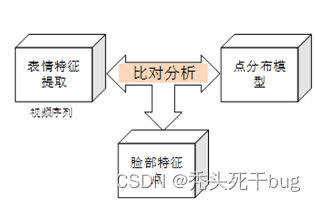

给定一个视频影像,要求定位和检测出一个人的头部姿态、人脸位置、颈部以及手臂、五指的屈伸与姿态,即三个部分,图像分割、检测物锁定、特征提取。 由于人脸的差异性与环境的复杂性使得面部与肢体特征点的定位与跟踪变得非常具有挑战性。目前,基于模型的定位是主流的定位方法,XGBoost(eXtreme Gradient Boosting)极致梯度提升,是一种基于GBDT的算法或者说工程实现,因为其高效、灵活、轻便的特点成为了推荐系统、数据挖掘等领域得到了广泛的应用。本文在引入XGBoost模型的基础上,结合RESnet的机理实现人脸特征的提取。

三、面部表情的分析判断方法

表情是情绪的外在体现与表达,更是研究人类的一种客观指标,美国著名心理学专家保罗·艾克曼的面部感情记录技术可以测量出愉快、惊奇、厌恶、愤怒、惧怕、悲伤6种情绪(孟昭兰,1987)。毋庸置疑的是这六种表情不能很好的适用于教育,但是本文从中截取其特色,使之可以更好的适用于教育领域。在正常的上课体验中,学生的表情给老师传递大量的情感信息,反映了学生对这门课的理解程度,表现了其听懂、困惑等情感特征。学生在能听懂的基础上表现出来的面部表情是轻松愉快的,头部状态是紧盯老师的,跟着老师的节奏移动,这代表了他对当前学习内容很感兴趣,参与度很高。而当学生对该内容表现出无聊甚至是抗拒的表现,而行为特征也表现为长期低头,左顾右盼,又或者眉头紧锁,甚至是趴下睡觉,多数是参与度较低或者学习者不能听懂教师所讲的内容。

四、头部姿态与躯体行为检测

在计算机视觉领域,头部姿态检测( Head Pose Estimation)指的是计算机通过视频或者图片得到用户所成图像来判断其头部姿态参数的过程. 近年来,头部姿态检测成为模式识别和计算机视觉领域内的活跃课题,而其中的主要原因就是因为头部姿态估计在人脸识别、人眼视线判断等头部研究中有着广泛的研究前景。

本文提出一种基于XGBoost模型的识别方法,通过实时跟踪脸部特征对脸部468个关键点进行高效判断与追踪,结合扭转角度判断公式,通过预训练好的示例性模型,得到学习者脸部姿态。

一种头部姿态估计方法,包括如下步骤:确定包含人脸的图像与视频并进行实时跟踪;将视频中的图像实时输入到预先训练好的XGBoost示例性模型,预测得到学习者人脸姿态朝向的俯仰角、偏航角以及翻滚角,用来判断学习者头部姿态;所述该模型用于提取不同尺寸的图像空间特征,将上述提取到的特征通过该模型将不同尺寸图像空间特征融合,得到融合特征,用降维模块针对所述融合特征进行三种不同维度的降维。得到图像三种维度的空间特征,不同维度对应不同的图像通道数;最后对所述三种维度的空间特征进行预测,预测得到人脸姿态的朝向,减少三个角度预测之间的相互干扰;所述尺寸以像素为单位。

一种躯体姿态行为检测方法,包含以下步骤:将高清摄像头实时读取到的视频进行胸部固定,首先判断头部位置,通过科学权重计算判断胸部的位置,以胸部为基准点,得到胳膊、关节、手指的点。通过关键点连线所成的结构判断手部肢体动作行为,从而更好的辅助判断学习者的参与度。

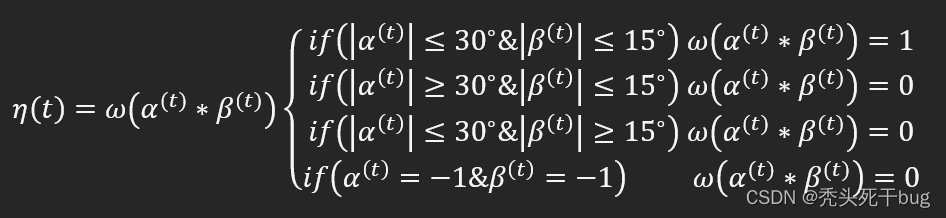

引入在两个方向的夹角α与β,对头部姿态进行状态跟踪。当学生本身处于开心或者设初始参与度系数为α(t) = -1,β(t) = -1,t 为实时变化的时间,当夹角α随时间变化的度数α(t) 不超过30°、β随时间变化的度数β(t) 不超过15°时,关注度系数α(t) = 1、β(t) = 1,否则关注度系数即为0。则基于线上课堂的参与度的判断具体见计算公式

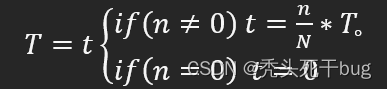

而当学生本身处于消极的一种状态属性,或者面部检测认定失败,又或者角度偏转大于三十度则可基本定义为没有参与课堂行为,当持续超过一个标准的时间则由该系统进行提醒。的计算公式如课堂参与时间的计算公式T :

其中N线上上课中学习者一共被检测的次数,而n为其中检测报告为积极参与课堂的次数,T∘ 则是总共的上课时长,因此基于此公式可以得到课堂的参与时间,从而侧面表现学生对课堂的感兴趣程度与学习效率,帮助教师进行统筹协调规划。

四:实验设计

一、学习者线上课堂行为数据集的建立

本文针对心理学通过对线上学生的数据收集统计分析,系统的归纳出了七种学习者线上学习的行为特点(即书写、无人、睡觉、玩手机、玩耍、听讲、左顾右盼),可以全面的反映学习者在线上课堂学习过程中学习状态。根据所述的行为特点进行分类匹配,通过权重计算与分析得到学习者的线上课堂学习效率的参与度。

学习者线上学习行为说明

| 学生线上课堂行为 |

动作状态 |

| 书写 |

低头+手部有笔 |

| 无人 |

不能捕捉到人脸特征 |

| 睡觉 |

爬着+脸部朝下 |

| 玩手机 |

低头+手部触碰手机 |

| 玩耍 |

眼神飘忽+嬉笑开心 |

| 听讲 |

眼神注视屏幕 |

| 左顾右盼 |

左右扭头+不注释屏幕 |

本研究对面部表情的判断采用ResNet神经变换网络,训练模型采用的是fer_2013数据集,fer_2013人脸表情数据集由35886张人脸表情图片组成,其中,测试图(Training)28708张,公共验证图(PublicTest)和私有验证图(PrivateTest)各3589张,每张图片是由大小固定为48×48的灰度图像组成,共有7种表情,分别对应于数字标签0-6,具体表情对应的标签和中英文如下:0 anger 生气;1 disgust 厌恶;2 fear 恐惧;3 happy 开心;4 sad 伤心;5 surprised 惊讶;6 normal 中性。

二、实验环境

①硬件环境配置:本次实验的主要设备配置为 NVIDIA GeForce RTX 3060(GPU)16GB 显存和 R7-5800H(CPU)。

②软件环境配置:本次实验所用的编程语言为 Python,使用的框架为 PyTorch。

③模型使用方面:本次实验主要使用了ResNet空间变换网络,XGBoost预测模型。

三、具体实验步骤

本研究对采集的视频依次进行了以下处理:

①按照既定频率进行选取分割。首先,对采集的全过程长视频进行筛选;随后,按照设定好的频率按帧抽取学习者学习状态图片进行保存,等待下一步使用。

②数据处理。首先对读取到的图片进行灰度化处理,旋转剪切成为符合要求测试数据,放入ResNet网络中对人脸表情进行追踪判断;其次将图片数据输入XGBoost模型分析标注人脸与躯体468个关键点,从而进一步得到头部姿态与角度。

③智能分析。最后通过计算机智能分析,按照设定好的权重处理判断,得到学习者学习效率。

五:作者有言

如果需要代码,请私聊博主,博主看见回。

如果感觉博主讲的对您有用,请点个关注支持一下吧,将会对此类问题持续更新……