广告公司可以使用生成式人工智能和文字转图像根基模型,制作创新的广告素材和内容。在本篇文案中,将演示如何使用亚马逊云科技Amazon SageMaker从现有的基本图像生成新图像,这是一项完全托管式服务,用于大规模构建、训练和部署机器学习模型。采用此解决方案,企业无论规模如何,都可以比以往更快地制作新的广告素材,而且大幅降低成本。这样,便能够以低成本和高速度,为企业制作新的定制广告素材内容。

解决方案概览

想象这样一个场景:一家全球汽车公司需要为其即将发布的新车型制作新的营销材料,为此聘请了一家广告公司,该公司以向拥有强大品牌资产的客户提供广告解决方案而闻名。这家汽车制造商在寻找低成本的广告素材,以便在保持汽车制造商品牌形象的同时,使用不同的位置、颜色和视角来展示该车型。凭借先进技术的强大功能,广告公司可以在其安全的亚马逊云科技环境中,使用生成式人工智能模型为客户提供支持。

该解决方案是使用生成式人工智能以及Amazon SageMaker中的文字转图像模型开发的。SageMaker是一项完全托管式机器学习(ML)服务,可针对任何使用场景,使用完全托管的基础设施、工具和工作流,轻松地构建、训练和部署机器学习模型。Stable Diffusion是Stability AI推出的文本到图像根基模型,用于支持图像生成流程。Diffusers是预先训练的模型,通过Stable Diffusion使用现有图像,根据提示生成新图像。将Stable Diffusion与ControlNet等Diffusers结合使用,可以利用现有的品牌特定内容开发出炫目的版本。在亚马逊云科技中使用Amazon SageMaker开发解决方案的主要好处是:

-

私密性——将数据存储在Amazon Simple Storage Service(Amazon S3)中并使用SageMaker托管模型,这样就可以遵循亚马逊云科技账户中的安全最佳实践,同时不对外公开资产。

-

可扩展性——将Stable Diffusion模型部署作为SageMaker端点时,允许配置实例大小和实例数量,从而实现可扩展性。SageMaker端点还具备自动扩缩功能和高可用性。

-

灵活性——在创建和部署端点时,可以通过SageMaker灵活选择GPU实例类型。此外,在业务需求发生变化时,可以毫不费力地更改SageMaker端点后面的实例。亚马逊云科技还开发了硬件和芯片,为生成式人工智能使用AWS Inferentia2,以最低的成本实现高性能的推理。

-

快速创新——生成式人工智能是一个快速发展的领域,采用全新方法,而且还在不断开发和发布新模型。Amazon SageMaker JumpStart定期推出新模型和根基模型。

-

端到端集成——利用亚马逊云科技,能够将创作流程与任何亚马逊云科技服务集成,并开发端到端的流程,通过AWS Identity and Access Management(IAM)进行精细的访问控制,通过Amazon Simple Notification Service(Amazon SNS)发送通知,以及使用事件驱动型计算服务AWS Lambda进行后处理。

-

分发——生成新素材后,使用亚马逊云科技的Amazon CloudFront,可以通过多个区域中的全球渠道分发内容。

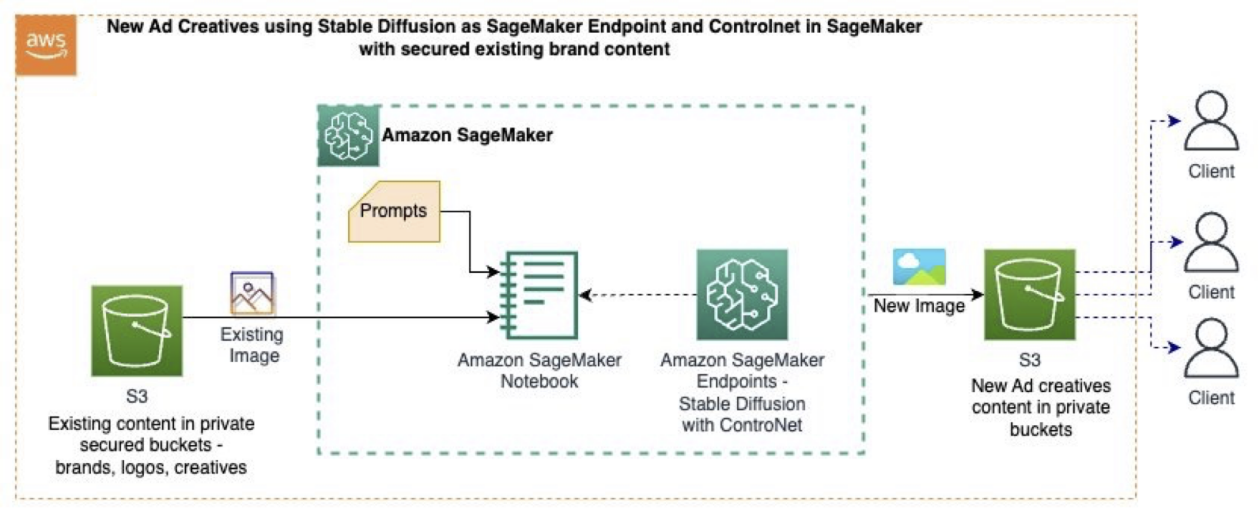

在此篇文案中,使用GitHub为示例,该示例使用Amazon SageMaker Studio和根基模型(Stable Diffusion)、提示、计算机视觉技术和SageMaker端点,从现有图像生成新图像。下图展示了该解决方案的架构。

该工作流包含以下步骤:

-

将现有内容(图片、品牌风格等)安全地存储在S3存储桶中。

-

在SageMaker Studio笔记本中,使用计算机视觉技术,将原始图像数据转换为图像,这将保留产品(汽车模型)的形状,去除颜色和背景,并生成单色的中间图像。

-

中间图像用作Stable Diffusion与ControlNet的控制图像。

-

在基于GPU的适宜实例大小上,从SageMaker Jumpstart部署SageMaker端点和Stable Diffusion文本转图像根基模型,并部署ControlNet。

-

使用描述新背景和汽车颜色的提示以及单色中间图像来调用SageMaker端点,从而生成新图像。

-

新图像在生成后存储在S3存储桶中。

在SageMaker端点上部署ControlNet

要将模型部署到SageMaker端点,必须为每个单独的技术模型构件创建一个压缩文件,并创建Stable Diffusion权重、推理脚本和NVIDIA Triton配置文件。

为了创建模型管道,定义一个inference.py脚本,SageMaker实时端点将使用该脚本,来加载和托管Stable Diffusion与ControlNet tar.gz文件。

从模型URI,使用所需的实例大小(GPU类型)部署SageMaker端点。

生成新图像

现在,端点已部署在SageMaker端点上,我们可以传入提示和要用作基准的原始图像。

为了定义提示,创建正向提示p_p,这是希望在新图像中出现的内容;还创建了负向提示n_p,这是希望在新图像中避免出现的内容。

最后,使用提示和源图像调用端点,以此来生成新图像。

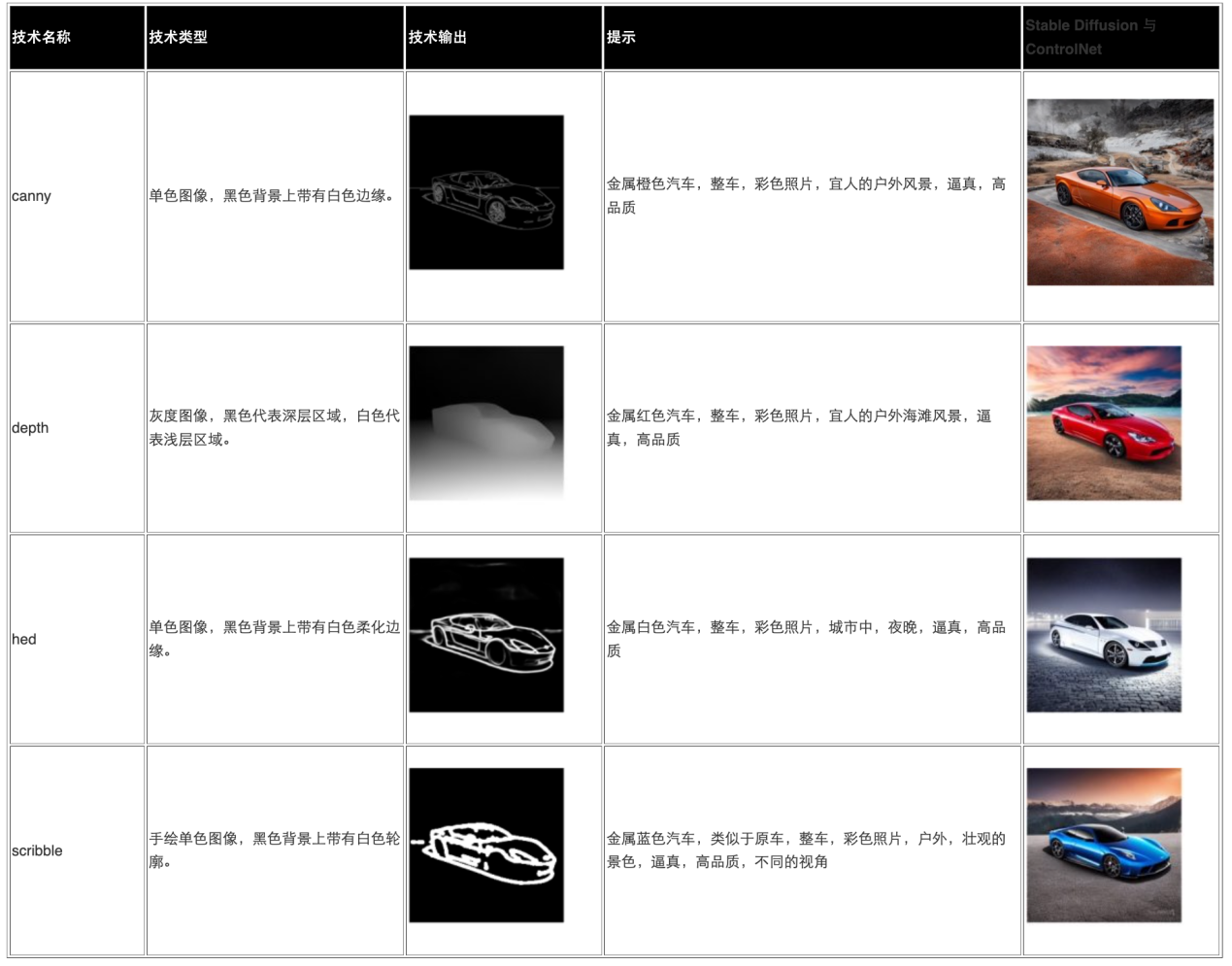

不同的ControlNet技术

综上所述,比较不同的ControlNet技术及其在所生成图像上的效果。通过以下原始图像,使用Amazon SageMaker中的Stable Diffusion和ControlNet生成新内容。

下表显示了技术输出如何描述在原始图像中需要强调的内容。

清理

使用生成式人工智能生成新的广告素材后,清理所有不再使用的资源。删除Amazon S3中的数据并停止任何SageMaker Studio笔记本实例,以免继续产生任何费用。如果您使用SageMaker JumpStart将Stable Diffusion部署为SageMaker实时端点,请通过SageMaker控制台或SageMaker Studio删除该端点。

总结

使用SageMaker上的根基模型,从存储在Amazon S3中的现有图像创建新的内容图像。借助这些技术,营销、广告和其他创意机构都能够使用生成式人工智能工具,增强其广告创意流程。