你是否经常在一些场景因为看不懂外语而着急?

出国旅行时看不懂外语菜单和产品说明书

手机上打外服游戏时看不懂外文界面

学习工作时看不懂外语PPT

......

这些“看不懂”的苦恼瞬间,相信大家都或多或少经历过,那么又该如何解决?

小米AI实验室机器翻译团队组建于2018年,持续探索机器翻译前沿技术。秉持着“让更多人享受没有语言障碍的美好生活”这一愿景,联合小爱同学,打造了小米手机系统级翻译产品——小爱翻译App。

陆续研发了“实时字幕”、“通话翻译”、“网页翻译”、“同声传译”、“会议秘书”、“离线翻译”等一系列实用的翻译功能,带给用户更为便利的跨语言交流体验。有了小爱翻译,这些“看不懂”的苦恼都迎刃而解。

01

小爱图片翻译,显而“译”见

图片翻译是机器翻译与光学字符识别(OCR)技术结合的一种翻译能力,它的工作原理是先通过OCR技术识别图片中的外语文字,再采用机器翻译系统将外语文本翻译成目标语言译文,最后将译文回填到图片中替换外文,同时可以保留原图样式和布局让用户可以沉浸式地理解外文图片。

小爱翻译中的「屏幕翻译」和「拍照翻译」即是基于图片翻译技术打造的两项实用功能,可以通过拍照或截屏两种方式满足用户处理手机内外部两种场景下的外语图片,实现所看即所译。

我们注意到,用户在浏览长篇或跨多页的外文文章时,经常使用小爱翻译的「屏幕翻译」功能来解决理解难题,而频繁手动开启「屏幕翻译」功能会打断流畅的阅读流程,影响整体体验。深入分析这一需求与场景后,小爱翻译团队决定从产品和技术两方面进行创新升级。

小爱翻译「屏幕翻译」功能演示

02

“大”屏幕来袭,小爱翻译新升级

在8月14日,雷总正式发布了小米MIX Fold 3和小米平板6 Max 14这两款大屏新品。在这两款大屏新品设备上,小爱翻译「屏幕翻译」升级为「实时屏幕翻译」,通过检测用户翻页或屏幕文字变化,自动地进行屏幕翻译,而无需用户每次手动重复开启该功能,提升了用户跨语言阅读效率和沉浸式阅读体验。

「实时屏幕翻译」的应用场景:

全局【屏幕翻译】

场景:主打外文文章/网页阅读场景,采用分屏显示方案,一屏原文、一屏译文,充分发挥大屏在办公/学习场景的优势,译文可跟随用户手动翻页进行实时滚动显示。

入口:小爱翻译APP->屏幕翻译。

全局【屏幕翻译】效果示意

会议【屏幕翻译】

场景:针对使用腾讯会议、飞书、钉钉、微信、QQ、企业微信等软件开在线会议时共享外语PPT等场景,通过采用屏幕图像变化检测算法,当屏幕文字改变时,即立刻自动进行屏幕翻译,无需用户手动重复开启。

入口:会议工具箱->屏幕翻译。

会议【屏幕翻译】效果示意

03

“大”模型加持,实时屏幕翻译词义必达

近期,以 GPT 为代表的大语言模型引领了一股热潮,也为机器翻译带来了新的技术方案。虽然大模型相比现有主流的神经机器翻译有许多优势,但服务成本的急剧增加也为实际落地带来不小挑战。因此,我们依据“单点切入”方法论:一开始尽量聚焦到只解决用户一个玻切的需求。去思考如何在小爱翻译中以低成本的方式引入大模型,同时还能显著提升当前产品用户体验中的痛点问题,使大模型能够在实际应用中扎根生长,发挥技术价值。

▍瞄准一词多义“靶心”

目前,大多数商用图片翻译产品通常会通过 OCR 提取图片中的多段外语文本,再使用机器翻译将每段文本转化为目标语言。这种技术路线面临诸多挑战,例如英语中存在的一词多义问题。具体来说,某个英语单词的机器翻译结果单独看可能准确,但放在整句或整体图片语境中却可能是错误的,这是因为翻译过程仅考虑了单词本身,而未综合利用上下文信息。

除了常用词语外,科技、医学、金融等专业领域的缩写术语翻译更是一个巨大的挑战。例如,“LLM”在法律领域代表“法学硕士(Master of Laws)”,而在计算机领域代表“大语言模型(Large Language Model)”,现有的神经机器翻译一方面无法有效利用上下文信息,另一方面训练数据难以覆盖各种专业领域,最终影响专业文档的翻译质量和用户体验。

因此,解决图片翻译中“一词多义”的问题迫在眉睫。我们选择从这个单点和痛点切入,利用大模型技术提升实时屏幕翻译产品体验。

▍构建篇章翻译全新方案

传统机器翻译通常仅针对单个句子进行翻译,近年来神经机器翻译(NMT)技术进步显著,大幅提高了句子翻译质量,因此当前绝大多数商用机器翻译系统都是基于句子级神经机器翻译。然而实际上句子存在于上下文环境中,理解句子准确含义需要考虑上下文信息,这就涉及到机器翻译的另一个重要方向——篇章级机器翻译。

在翻译新闻、文学、学术文章等时,篇章翻译尤为重要,图片翻译一般来说因为涉及多段文本,也属于一种篇章翻译。然而,传统 NMT 系统缺乏对上下文信息的建模,因此基于单句翻译产生的篇章译文质量不尽人意。近年来,篇章翻译一直是学术研究的热点,但实际应用受限,主要障碍是篇章翻译需要设计特殊的模型结构,同时需要大量篇章级平行语料进行训练,导致模型训练和应用成本过高,而翻译效果提升也不明显。

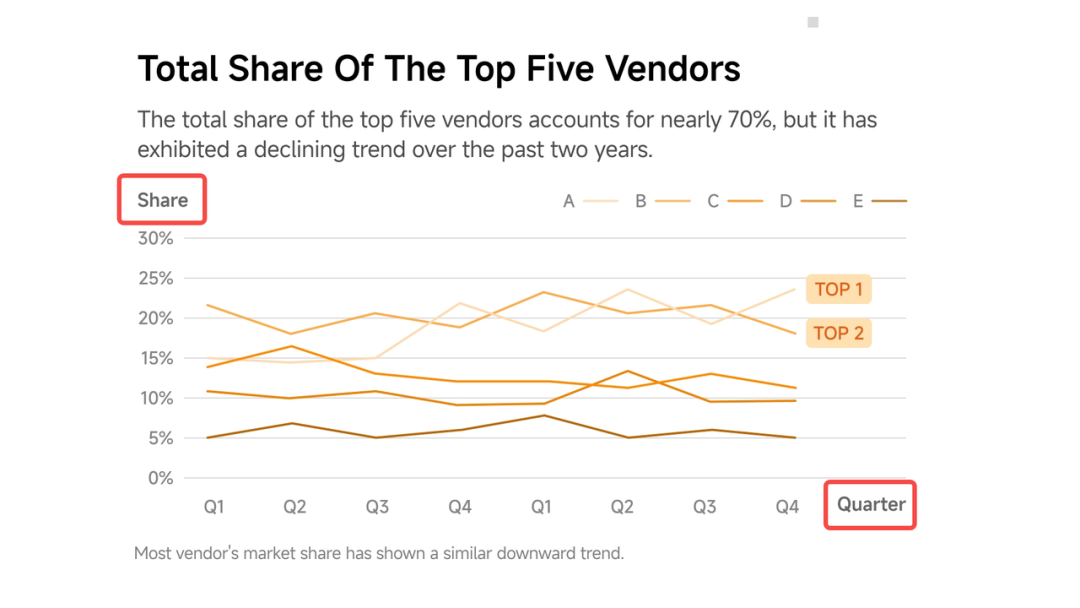

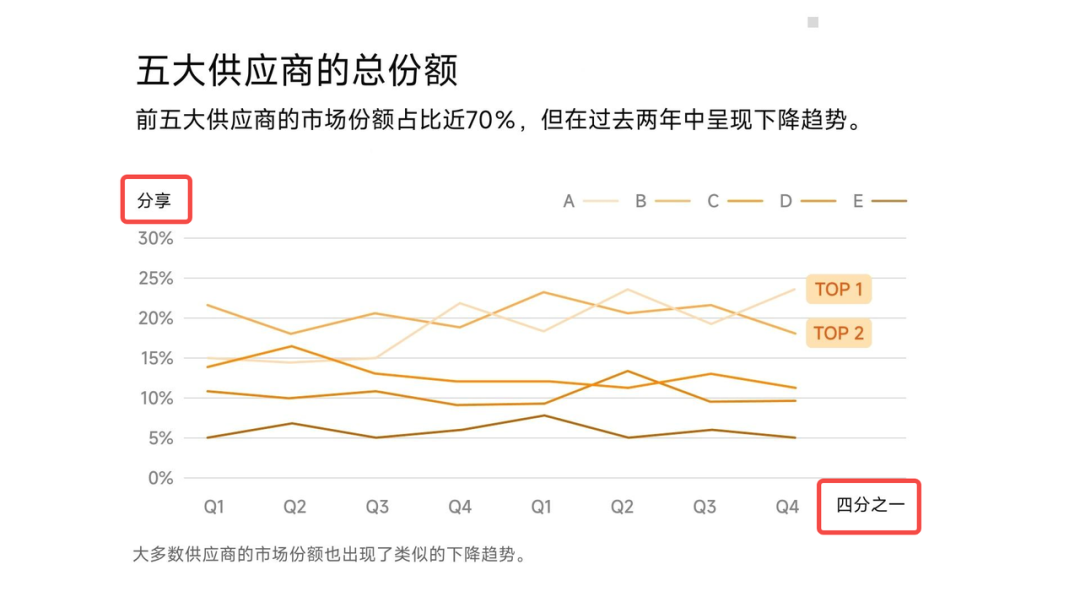

举例来说,下图中的单词“Share”和“Quarter”在没有上下文约束时被翻译成了“分享”和“四分之一”,然而考虑到图片的整体信息,正确的翻译应为“份额”和“季度”。相比之下,人工译员能够通过综合考虑整个图片的信息来做出正确的翻译决策。

英文原图

基于常规方案的小爱翻译译图

大模型的出现为篇章机器翻译提供了新的思路。大模型通过海量无监督数据上进行预训练(pretrain),再结合少量有监督数据进行微调(finetune),能够得到显著提升上下文理解和词义消歧的能力。我们通过构建面向图片翻译等多样性翻译任务的指令微调数据,基于 BigScience 开源且可商用的 BLOOM 大模型,进一步优化其翻译质量,研发了适用于小爱翻译的翻译大模型。

以100张英文图片为基础,对图片中的词语人工标注正确译文,构建了图片翻译单词翻译质量评测集,基于我们的评测结果,采用大模型后单词翻译准确率提高27.5%,更令人鼓舞的是,准确率也显著超过了国内外主流机器翻译产品,甚至达到了 GPT-4 的水平。

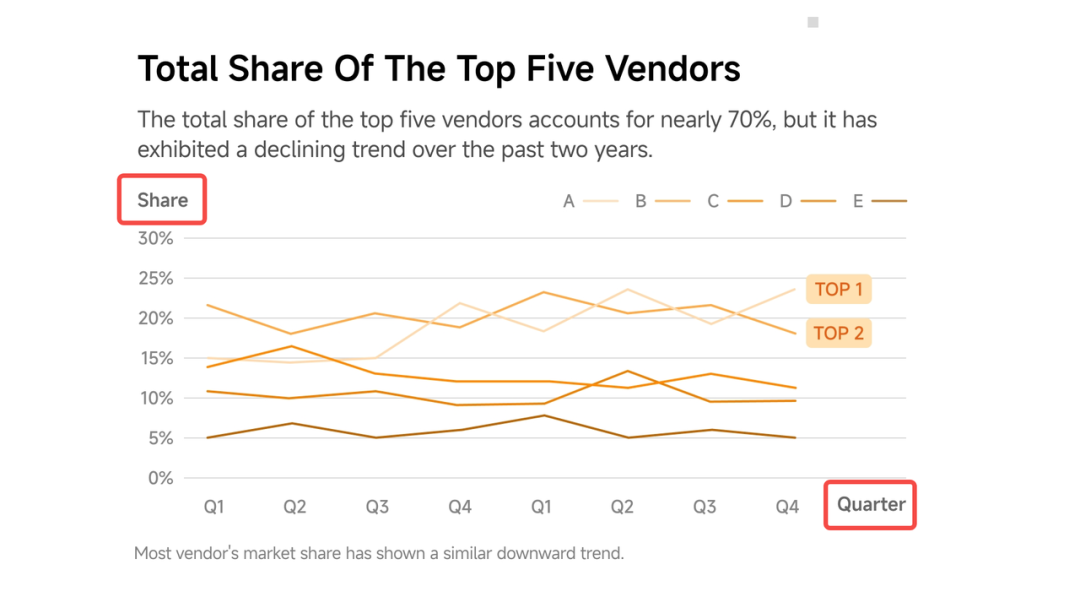

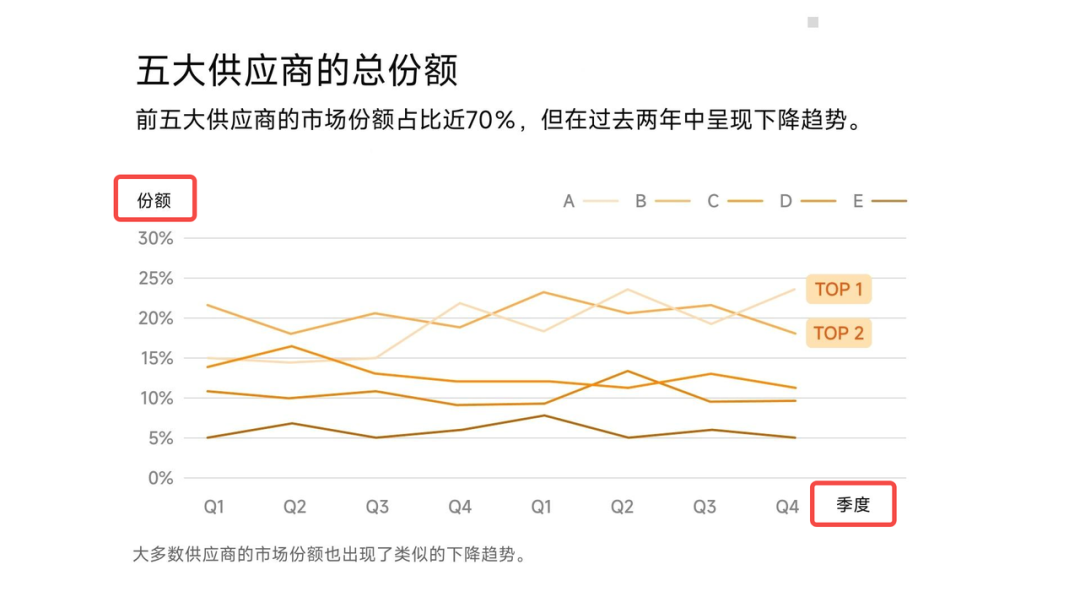

针对前文提到的示例图片,小爱翻译大模型能够根据图片上下文准确地将“Share”翻译为“份额”,将“Quarter”翻译为“季度”,而市场上其他广受欢迎的翻译产品都存在不同程度的瑕疵。

英文原图

基于大模型的小爱翻译译图

除了优化大模型翻译质量外,我们还从如下方面优化推理效率和服务成本:1)裁剪 BLOOM 原生词表规模,降低模型计算量;2)采用业界最新 PagedAttention 技术,提升推理吞吐;3)采用 NVIDIA A30 GPU ,在保持相同推理性能基础上降低50%的成本;4)采用向量数据库技术,提升大模型缓存效率,减少对语义高度相近的新请求对大模型服务的调用。通过以上优化,采用大模型的单词翻译延时小于100毫秒,满足上线的性能和成本要求。

由此,升级后的「实时屏幕翻译」无需用户手动介入,就能够自动检测页面内容变动或用户翻页从而进行实时翻译,为用户提供高效流畅阅读体验,同时,通过融合了 AI 翻译大模型技术,单词翻译更符合上下文语境,为用户提供更准确的翻译结果,实现“所见即所译”的升级。

-

严复先生曾言:“译事三难:信、达、雅。求其信已大难矣,顾信矣不达,虽译犹不译也,则达尚焉。……信达而外,求其尔雅。” 在面对不同语种,语序、句法各不相同的情况下,小米致力于将翻译做到:准确、通顺、精美,既忠于原文,词义必达,又将文采富于其上,锦上添花。

小米会始终以“信、达、雅”作为机器翻译的目标,长久持续的打造更多实用产品,打磨既有产品体验,结合终端智能设备多样性的特点,将前沿的实用技术融入到产品中,满足用户多场景跨语言交流和获取信息的需求,持续升级小爱翻译。进一步将 AI 翻译大模型应用于更多的翻译功能和场景,让全球每个人都能够享受到大模型带来的美好生活。