多级缓存

多级缓存方案

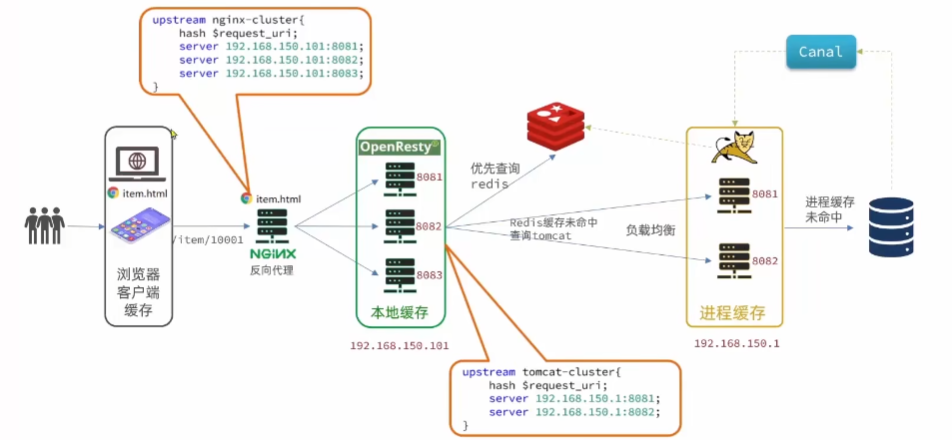

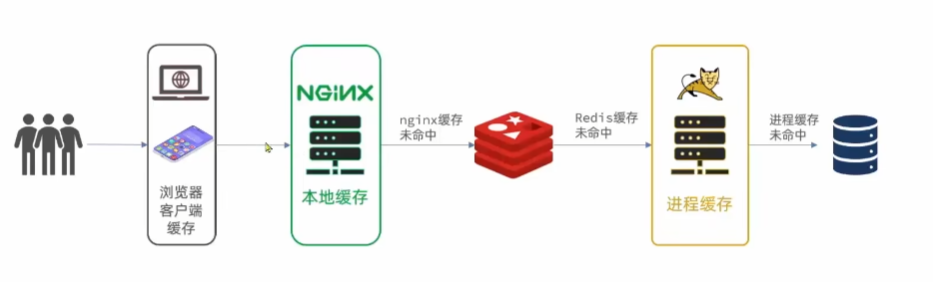

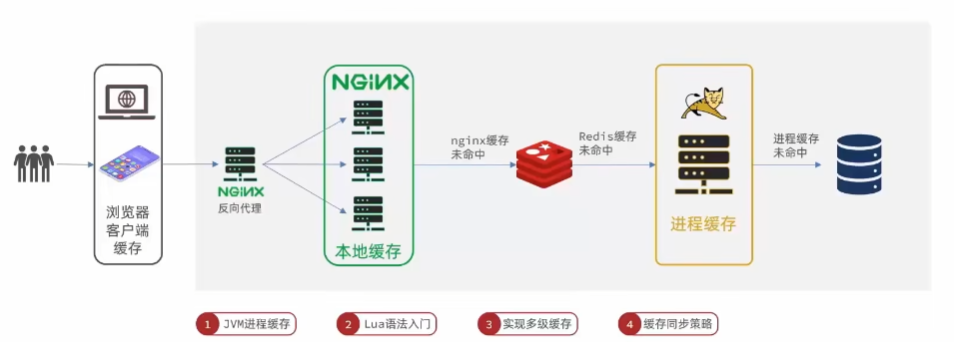

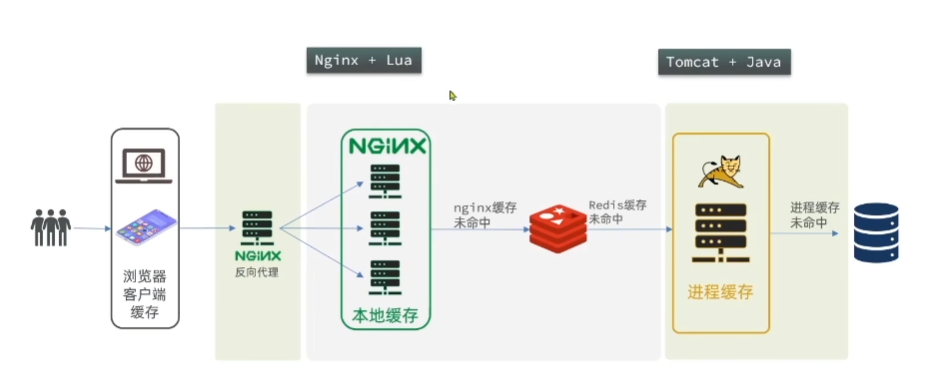

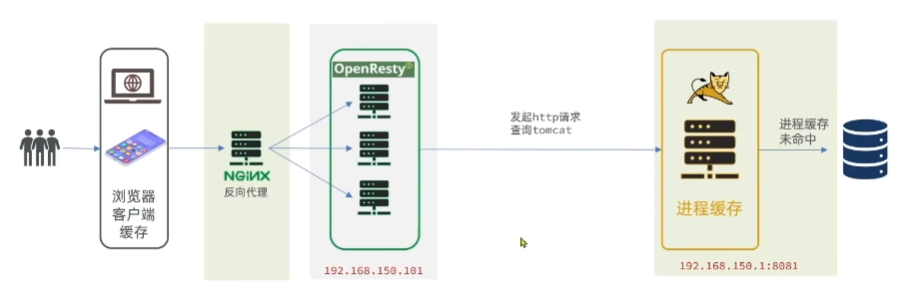

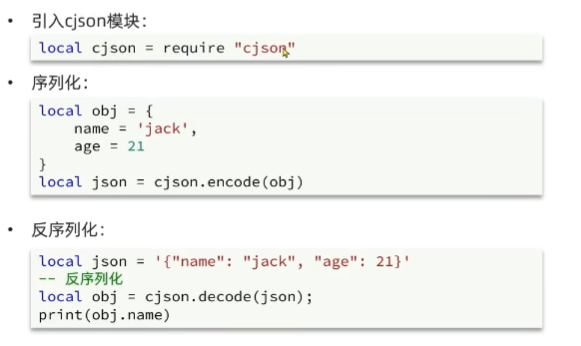

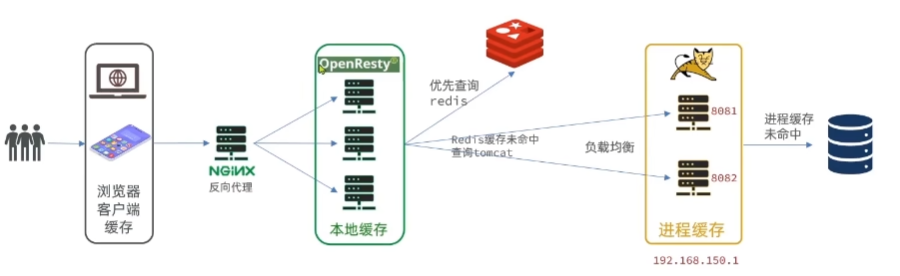

多级缓存就是充分利用请求处理的每个环节,分别添加缓存,减轻Tomcat压力,提升服务器性能:

用作缓存的Nginx是业务Nginx,需要部署为集群,再有专门的Nginx用来做反向代理:

JVM进程缓存

1.安装MySQL

1.1.准备目录

为了方便后期配置MySQL,我们先准备两个目录,用于挂载容器的数据和配置文件目录:

# 进入/tmp目录

cd /tmp

# 创建文件夹

mkdir mysql

# 进入mysql目录

cd mysql

1.2.运行命令

进入mysql目录后,执行下面的Docker命令:

docker run \

-p 3306:3306 \

--name mysql \

-v $PWD/conf:/etc/mysql/conf.d \

-v $PWD/logs:/logs \

-v $PWD/data:/var/lib/mysql \

-e MYSQL_ROOT_PASSWORD=xcxc666 \

--privileged \

-d \

mysql:5.7.25

1.3.修改配置

在/tmp/mysql/conf目录添加一个my.cnf文件,作为mysql的配置文件:

# 创建文件

touch /tmp/mysql/conf/my.cnf

文件的内容如下:

[mysqld]

skip-name-resolve

character_set_server=utf8

datadir=/var/lib/mysql

server-id=1000

1.4.重启

配置修改后,必须重启容器:

docker restart mysql

本地进程缓存

缓存在日常开发中有着至关重要的作用,由于是存储在内存中,数据的读取速度是非常快的,能大量减少对数据库访问,减少数据库的压力。我们把缓存分为两类:

-

分布式缓存,例如Redis:

-

- 优点:存储容量更大、可靠性更好、可以在集群间共享

- 缺点:访问缓存有网络开销

- 场景:缓存数据量较大、可靠性要求较高、需要在集群间共享

-

进程本地缓存,例如HashMap、GuavaCache:

-

- 优点:读取本地内存,没有网络开销,速度更快

- 缺点:存储容量有限,可靠性较低、无法共享

- 场景:性能要求较高,缓存数据量较小

Caffeine官网:https://github.com/ben-manes/caffeine/wiki/Home-zh-CN

Caffeine示例

@Test

void testBasicOps() {

// 创建缓存对象

Cache<String, String> cache = Caffeine.newBuilder().build();

// 存数据

cache.put("gf", "迪丽热巴");

// 取数据,不存在则返回null

String gf = cache.getIfPresent("gf");

System.out.println("gf = " + gf);

// 取数据,不存在则去数据库查询

String defaultGF = cache.get("defaultGF", key -> {

// 这里可以去数据库根据 key查询value

return "柳岩";

});

System.out.println("defaultGF = " + defaultGF);

}

Caffeine提供了三种缓存驱逐策略:

- 基于容量:设置缓存的数量上限

// 创建缓存对象

Cache<String, String> cache = Caffeine.newBuilder()

.maximumSize(1) // 设置缓存大小上限为1

.build();

- 基于时间:设置缓存的有效时间

// 创建缓存对象

Cache<String, String> cache = Caffeine.newBuilder()

.expireAfterWrite(Duration.ofSeconds(1)) // 设置缓存有效时间为10秒,从最后一次写入开始计时

.build();

- 基于引用:设置缓存为软引用或弱引用,利用GC来回收缓存数据。性能较差,不建议使用

在默认情况下,当一个缓存元素过期的时候,Caffeine不会自动立即将其清理和驱逐。而是在一次读或写操作后,或者在空闲时间完成对失效数据的驱逐。

案例:实现商品的查询的本地进程缓存

利用Caffeine实现下列需求:

- 缓存初始大小100

- 缓存上限为10000

将bean交给spring管理

package com.heima.item.config;

import com.github.benmanes.caffeine.cache.Cache;

import com.github.benmanes.caffeine.cache.Caffeine;

import com.heima.item.pojo.Item;

import com.heima.item.pojo.ItemStock;

import org.springframework.context.annotation.Bean;

import org.springframework.context.annotation.Configuration;

/**

* @author xc

* @date 2023/5/16 21:12

*/

@Configuration

public class CaffeineConfig {

@Bean

public Cache<Long, Item> itemCache(){

return Caffeine.newBuilder()

// 初始缓存大小

.initialCapacity(100)

// 最大缓存大小

.maximumSize(10_000)

.build();

}

@Bean

public Cache<Long, ItemStock> stockCache(){

return Caffeine.newBuilder()

.initialCapacity(100)

.maximumSize(10_000)

.build();

}

}

- 给根据id查询商品的业务添加缓存,缓存未命中时查询数据库

@GetMapping("/{id}")

public Item findById(@PathVariable("id") Long id) {

return itemCache.get(id, key -> itemService.query()

.ne("status", 3).eq("id", key)

.one()

);

}

- 给根据id查询商品库存的业务添加缓存,缓存未命中时查询数据库

@GetMapping("/stock/{id}")

public ItemStock findStockById(@PathVariable("id") Long id) {

return stockCache.get(id,key -> stockService.getById(key));

}

Lua语法入门

初始Lua

Lua是一种轻量小巧的脚本语言。官网:https://www.lua.org/

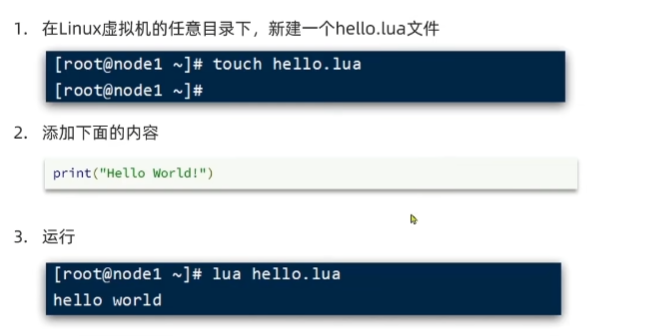

HelloWorld

数据类型

变量

Lua声明变量的时候,并不需要指定数据类型:

-- 声明字符串

local str = 'hello'

-- 声明数字

local num = 21

-- 声明布尔类型

local flag = true

-- 声明数组 key为索引的table

local arr = {

'java','python','lua'}

-- 声明table,类似java的map

local map = {

name='Jack', age=21}

访问table:

-- 访问数组(下标从1开始)

print(arr[1])

-- 访问table

print(map['name'])

print(map.name)

循环

数组、table都可以利用for循环来遍历:

- 遍历数组:

-- 声明数组 key为索引的table

local arr = {

'java', 'python', 'lua'}

-- 遍历数组

for index,value in ipairs(arr) do

print(index,value)

end

- 遍历table:

-- 声明map

local map = {

name='Jack', age=21}

-- 遍历数组

for index,value in pairs(map) do

print(index,value)

end

函数

定义函数的语法:

function 函数名(arg1,arg2....)

--函数体

return 返回值

end

例如,定义一个函数,用来打印数组:

function printArr(arr)

for index,value in ipairs(arr) do

print(index,value)

end

end

条件控制

类似Java的条件控制,例如if,else语法

if(布尔表达式)

then

--[为true的语句块]

else

--[为false的语句块]

end

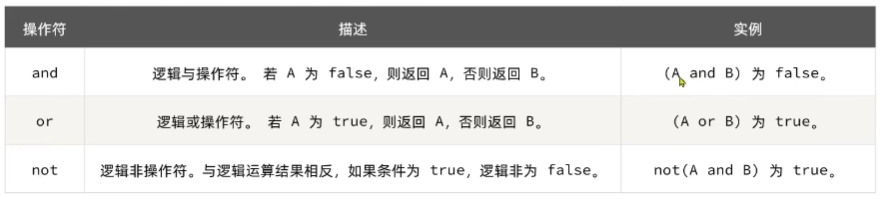

与java不同,布尔表达式中的逻辑运算是基于英文单词

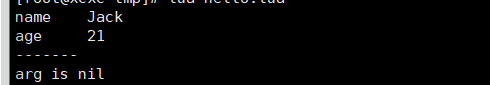

案例:自定义函数,打印table

需求:自定义一个函数,可以打印table,当参数为nil时,打印错误信息

function printTable(table)

if(not table)

then

print('arg is nil')

reutrn nil

else

for k,v in pairs(table) do

print(k,v)

end

end

end

local map = {

name='Jack', age=21}

printTable(map)

print('-------')

printTable(nil)

运行结果:

多级缓存

初始OpenResty

OpenResty是一个基于Nginx的高性能Web平台,用于方便地搭建能够处理超高并发、扩展性极高的动态Web应用、Web服务和动态网关。具备以下特点:

- 具备Nginx的完整功能

- 基于Lua语言进行扩展,集成大量精良的Lua库、第三方模块

- 允许使用Lua自定义业务逻辑、自定义库

官网:https://openresty.org/cn/

安装OpenResty

1.安装

首先你的Linux虚拟机必须联网

1)安装开发库

首先要安装OpenResty的依赖开发库,执行命令:

yum install -y pcre-devel openssl-devel gcc --skip-broken

2)安装OpenResty仓库

你可以在你的 CentOS 系统中添加 openresty 仓库,这样就可以便于未来安装或更新我们的软件包(通过 yum check-update 命令)。运行下面的命令就可以添加我们的仓库:

yum-config-manager --add-repo https://openresty.org/package/centos/openresty.repo

如果提示说命令不存在,则运行:

yum install -y yum-utils

然后再重复上面的命令

3)安装OpenResty

然后就可以像下面这样安装软件包,比如 openresty:

yum install -y openresty

4)安装opm工具

opm是OpenResty的一个管理工具,可以帮助我们安装一个第三方的Lua模块。

如果你想安装命令行工具 opm,那么可以像下面这样安装 openresty-opm 包:

yum install -y openresty-opm

5)目录结构

默认情况下,OpenResty安装的目录是:/usr/local/openresty

看到里面的nginx目录了吗,OpenResty就是在Nginx基础上集成了一些Lua模块。

6)配置nginx的环境变量

打开配置文件:

vi /etc/profile

在最下面加入两行:

export NGINX_HOME=/usr/local/openresty/nginx

export PATH=${NGINX_HOME}/sbin:$PATH

NGINX_HOME:后面是OpenResty安装目录下的nginx的目录

然后让配置生效:

source /etc/profile

2.启动和运行

OpenResty底层是基于Nginx的,查看OpenResty目录的nginx目录,结构与windows中安装的nginx基本一致:

所以运行方式与nginx基本一致:

# 启动nginx

nginx

# 重新加载配置

nginx -s reload

# 停止

nginx -s stop

nginx的默认配置文件注释太多,影响后续我们的编辑,这里将nginx.conf中的注释部分删除,保留有效部分。

修改/usr/local/openresty/nginx/conf/nginx.conf文件,内容如下:

#user nobody;

worker_processes 1;

error_log logs/error.log;

events {

worker_connections 1024;

}

http {

include mime.types;

default_type application/octet-stream;

sendfile on;

keepalive_timeout 65;

server {

listen 8081;

server_name localhost;

location / {

root html;

index index.html index.htm;

}

error_page 500 502 503 504 /50x.html;

location = /50x.html {

root html;

}

}

}

在Linux的控制台输入命令以启动nginx:

nginx

然后访问页面:http://192.168.72.133:8081,注意ip地址替换为你自己的虚拟机IP:

3.备注

加载OpenResty的lua模块:

#lua 模块

lua_package_path "/usr/local/openresty/lualib/?.lua;;";

#c模块

lua_package_cpath "/usr/local/openresty/lualib/?.so;;";

OpenResty获取请求参数

多级缓存需求

案例:获取请求路径中商品id信息,根据id向Tomcat查询商品信息

这里要修改item.lua,满足下面的需求:

1.获取请求参数中的id

2.根据id向Tomcat服务发送请求,查询商品信息

3.根据id向Tomcat服务发送请求,查询库存信息

4.组装商品信息、库存信息,序列化为JSON格式返回

nginx内部发送Http请求

nginx提供了内部API用以发送http请求

local resp = ngx.location.capture("/path",{

method = ngx.HTTP_GET, -- 请求方式

args = {

a=1,b=2}, -- get方式传参数

body = "c=3&d=4" -- post方式传参数

})

返回的响应内容包括:

- resp.status:响应状态码

- resp.header:响应头,是一个table

- resp.body:响应体,就是响应数据

**注意:**这里的path路径,并不包含IP和端口。这个请求会被nginx内部的server监听并处理。

当我们希望这个请求发送到Tomcat服务器,所以还需要编写一个server来对路径做反向代理:

location /path{

# 保证win防火墙关闭

proxy_pass http://192.168.72.1:8081;

}

封装http查询的函数

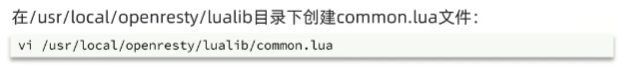

common.lua

-- 封装函数,发送http请求,并解析响应

local function read_http(path, params)

local resp = ngx.location.capture(path,{

method = ngx.HTTP_GET,

args = params,

})

if not resp then

-- 记录错误信息,返回404

ngx.log(ngx.ERR, "http not found, path: ", path , ", args: ", args)

ngx.exit(404)

end

return resp.body

end

-- 将方法导出

local _M = {

read_http = read_http

}

return _M

JSON结果处理

OpenResty提供了一个cjson的模块用来处理JSON的序列化和反序列化

官网:https://github.com/openresty/lua-cjson

Tomcat集群的负载均衡

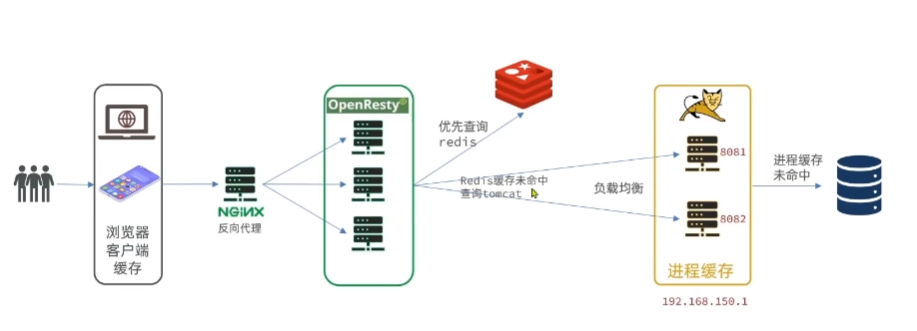

添加redis缓存的需求

冷启动与缓存预热

**冷启动:**服务刚刚启动时,Redis中并没有缓存,如果所有商品数据都在第一次查询时添加缓存,可能会给数据库带来较大压力。

**缓存预热:**在实际开发中,我们可以利用大数据统计用户访问的热点数据,在项目启动时将这些热点数据提前查询并保存到Redis中。

缓存预热

查询Redis缓存

OpenResty的Redis模块

OpenResty提供了操作Redis的模块,我们只要引入该模块就能直接使用:

- 引入Redis模块,并初始化Redis对象

-- 引入redis模块

local redis = require("resty.redis")

-- 初始化Redis对象

local red = redis:new()

-- 设置Redis超时时间

red:set_timeouts(1000,1000,1000)

- 封装函数,用来释放Redis连接,其实是放入连接池

-- 关闭redis连接的工具方法,其实是放入连接池

local function close_redis(red)

local pool_max_idle_time = 10000 -- 连接的空闲时间,单位是毫秒

local pool_size = 100 --连接池大小

local ok, err = red:set_keepalive(pool_max_idle_time, pool_size)

if not ok then

ngx.log(ngx.ERR, "放入redis连接池失败: ", err)

end

end

- 封装函数,从Redis读取数据并返回

-- 查询redis的方法 ip和port是redis地址,key是查询的key

local function read_redis(ip, port, key)

-- 获取一个连接

local ok, err = red:connect(ip, port)

if not ok then

ngx.log(ngx.ERR, "连接redis失败 : ", err)

return nil

end

-- 查询redis

local resp, err = red:get(key)

-- 查询失败处理

if not resp then

ngx.log(ngx.ERR, "查询Redis失败: ", err, ", key = " , key)

end

--得到的数据为空处理

if resp == ngx.null then

resp = nil

ngx.log(ngx.ERR, "查询Redis数据为空, key = ", key)

end

close_redis(red)

return resp

end

添加redis缓存需求

nginx本地缓存

OpenResty为Nginx提供了shard dict功能,可以在nginx的多个worker之间共享数据,实现缓存功能。

- 开启共享词典:

# 共享字典,也就是本地缓存,名称叫做:item_cache,大小150m

lua_shared_dict item_cache 150m;

- 操作共享字典:

local item_cache = ngx.shared.item_cache

item_cache:set('key','value',1000)

local val = item_cache:get('key')

缓存同步策略

缓存数据同步的常见方式有三种:

-

设置有效期: 给缓存设置有效期,到期后自动删除。再次查询时更新

-

- 优势:简单、方便

- 缺点:时效性差,缓存过期之前可能不一致

- 场景:更新频率较低,时效性要求低的业务

-

同步双写: 在修改数据库的同时,直接修改缓存

-

- 优势:时效性强,缓存与数据库强一致

- 缺点:有代码侵入,耦合度高

- 场景:对一致性、时效性要求较高的缓存数据

-

异步通知: 修改数据库时发送时间通知,相关服务监听到通知后修改缓存数据

-

- 优势:低耦合,可以同时通知多个缓存服务

- 缺点:时效性一般,可能存在中间不一致状态

- 场景:时效性要求一般,有多个服务需要同步

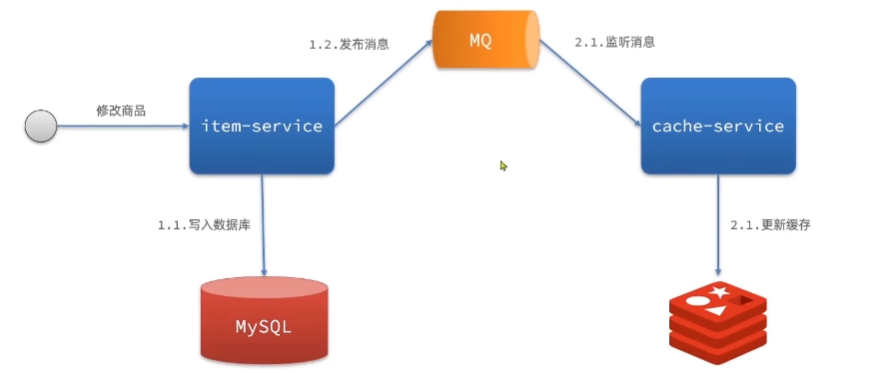

基于MQ的异步通知:

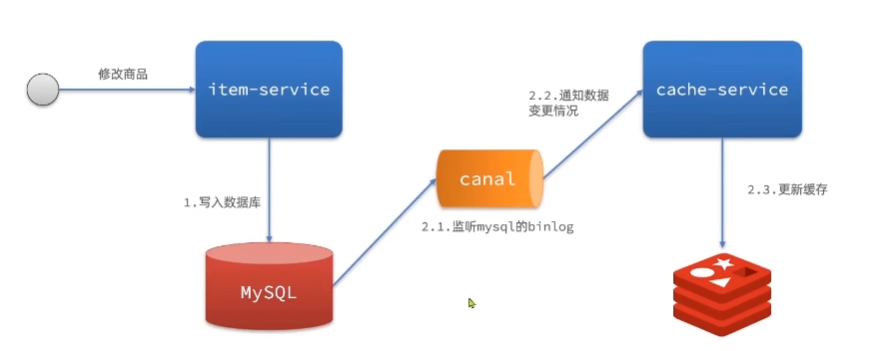

基于Canal的异步通知:

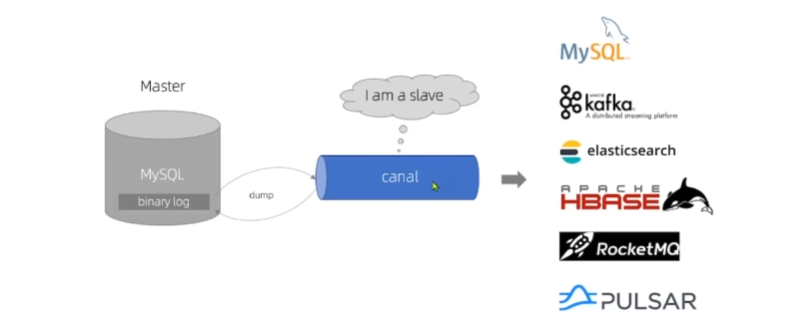

初始Canal

基于数据库增量日志解析,提供增量数据订阅&消费

官网:https://github.com/alibaba/canal

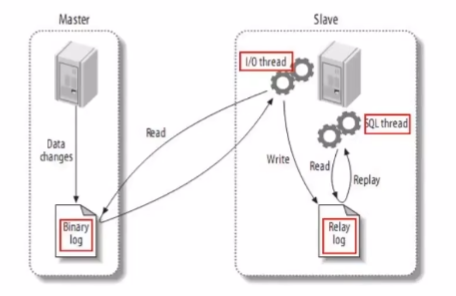

Canal是基于mysql的主从同步来实现,MySQL主从同步的原理如下:

- MySQL master将数据变更写入二进制日志,其中记录的数据叫做binary log events

- MySQL slave将master的binary log events拷贝到它的中继日志

- MySQL slave重放relay log中事件,将数据变更反映它自己的数据

Canal就是把自己伪装成MySQL的一个slave节点,从而监听master的binary log变化。再把得到的变化信息通知给Canal的客户端,进而完成对其它数据库的同步。

安装和配置Canal

下面我们就开启mysql的主从同步机制,让Canal来模拟salve

1.开启MySQL主从

Canal是基于MySQL的主从同步功能,因此必须先开启MySQL的主从功能才可以。

这里以之前用Docker运行的mysql为例:

1.1.开启binlog

打开mysql容器挂载的日志文件,我的在/tmp/mysql/conf目录:

修改文件:

vi /tmp/mysql/conf/my.cnf

添加内容:

log-bin=/var/lib/mysql/mysql-bin

binlog-do-db=heima

配置解读:

- log-bin=/var/lib/mysql/mysql-bin:设置binary log文件的存放地址和文件名,叫做mysql-bin

- binlog-do-db=heima:指定对哪个database记录binary log events,这里记录heima这个库

最终效果:

[mysqld]

skip-name-resolve

character_set_server=utf8

datadir=/var/lib/mysql

server-id=1000

log-bin=/var/lib/mysql/mysql-bin

binlog-do-db=heima

1.2.设置用户权限

接下来添加一个仅用于数据同步的账户,出于安全考虑,这里仅提供对heima这个库的操作权限。

create user canal@'%' IDENTIFIED by 'canal';

GRANT SELECT, REPLICATION SLAVE, REPLICATION CLIENT,SUPER ON *.* TO 'canal'@'%' identified by 'canal';

FLUSH PRIVILEGES;

重启mysql容器即可

docker restart mysql

测试设置是否成功:在mysql控制台,或者Navicat中,输入命令:

show master status

2.安装Canal

2.1.创建网络

我们需要创建一个网络,将MySQL、Canal、MQ放到同一个Docker网络中:

docker network create heima

让mysql加入这个网络:

docker network connect heima mysql

2.3.安装Canal

可以将canal.tar上传到虚拟机,然后通过命令导入:

docker load -i canal.tar

然后运行命令创建Canal容器:

docker run -p 11111:11111 --name canal \

-e canal.destinations=heima \

-e canal.instance.master.address=mysql:3306 \

-e canal.instance.dbUsername=canal \

-e canal.instance.dbPassword=canal \

-e canal.instance.connectionCharset=UTF-8 \

-e canal.instance.tsdb.enable=true \

-e canal.instance.gtidon=false \

-e canal.instance.filter.regex=heima\\..* \

--network heima \

-d canal/canal-server:latest

说明:

- -p 11111:11111:这是canal的默认监听端口

- -e canal.instance.master.address=mysql:3306:数据库地址和端口,如果不知道mysql容器地址,可以通过docker inspect 容器id来查看

- -e canal.instance.dbUsername=canal:数据库用户名

- -e canal.instance.dbPassword=canal :数据库密码

- -e canal.instance.filter.regex=:要监听的表名称

表名称监听支持的语法:

mysql 数据解析关注的表,Perl正则表达式.

多个正则之间以逗号(,)分隔,转义符需要双斜杠(\\)

常见例子:

1. 所有表:.* or .*\\..*

2. canal schema下所有表: canal\\..*

3. canal下的以canal打头的表:canal\\.canal.*

4. canal schema下的一张表:canal.test1

5. 多个规则组合使用然后以逗号隔开:canal\\..*,mysql.test1,mysql.test2

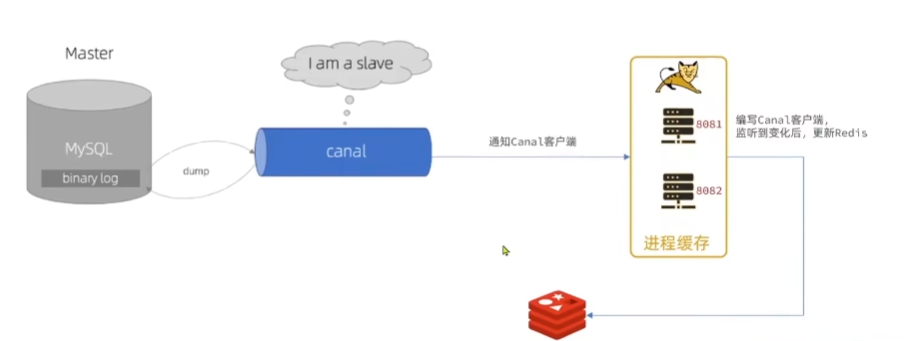

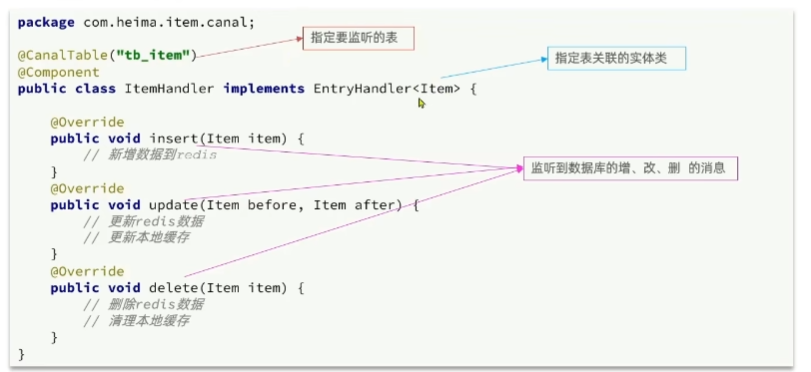

Canal客户端

Canal提供了各种语言的客户端,当Canal监听到binlog变化时,会通知Canal的客户端

使用第三方开源的canal-starter:https://github.com/NormanGyllenhaal/canal-client

引入依赖:

<dependency>

<groupId>top.javatool</groupId>

<artifactId>canal-spring-boot-starter</artifactId>

<version>1.2.1-RELEASE</version>

</dependency>

编写配置:

canal:

destination: heima

server: 192.168.72.133:1111

编写监听器,监听Canal消息:

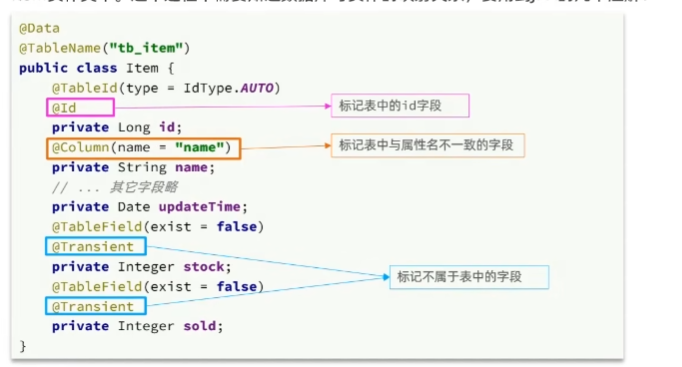

Canal推送给canal-client是被修改的这一行数据,而我们引入的canal-client则会帮我们把这行数据封装到item实体类中。

多级缓存总结