一、kafka使用要点

要点一:Producer即生产者,向Kafka集群发送消息,在发送消息之前,会对消息进行分类,即Topic,topic1,topic2。Topic即主题,通过对消息指定主题可以将消息分类,消费者可以只关注自己需要的Topic中的消息。Consumer即消费者,消费者通过与kafka集群建立长连接的方式,不断地从集群中拉取消息,然后可以对这些消息进行处理。

要点二:kafka的存储,不得不提到分区,即partitions,创建一个topic时,同时可以指定分区数目,分区数越多,其吞吐量也越大,但是需要的资源也越多,同时也会导致更高的不可用性,kafka在接收到生产者发送的消息之后,会根据均衡策略将消息存储到不同的分区中。每个分区中,消息以顺序存储,最晚接收的的消息会最后被消费。生产者在向kafka集群发送消息的时候,可以指定分区来发送,也可以通过指定均衡策略来发送,或不指定,采用默认策略,将消息随机的存储到不同的分区中。

要点三:在消费者消费消息时,kafka使用offset来记录当前消费的位置,在kafka的设计中,可以有多个不同的group来同时消费同一个topic下的消息,如有两个不同的group同时消费,他们的的消费的记录位置offset各不相同,不互相干扰。对于一个group而言,消费者的数量不应该多余分区的数量,因为在一个group中,每个分区至多只能绑定到一个消费者上,即一个消费者可以消费多个分区,一个分区只能给一个消费者消费,因此,若一个group中的消费者数量大于分区数量的话,多余的消费者将不会收到任何消息。

要点四:Kafka是使用scala编写的运行与jvm虚拟机上的程序,虽然也可以在windows上使用,但是kafka基本上是运行在linux服务器上,因此我们这里也使用linux来开始今天的实战。首先确保你的机器上安装了jdk,kafka需要java运行环境,以前的kafka还需要zookeeper,新版的kafka已经内置了一个zookeeper环境,所以我们可以直接使用。

二、安装

1、jkd 安装

查看可安装的jdk版本

yum -y list java*

选择一版本安装

sudo yum install -y java-1.8.0-openjdk-devel.x86_64

检查安装结果

java -version

你如果好奇这个自动安装把jdk安装到哪里去了,其实你可以在usr/lib/jvm下找到它们

2、kafka安装

官网 http://kafka.apache.org/downloads下载到最新的kafka安装包,选择下载二进制版本的tgz文件,我们不选择带src的kafka-3.3.1-src,否则启动zookeeper会提示,这里下载kafka_2.13-3.3.1 , 拖到创建的/home/lighthouse/kafka目录,如果只需要进行最简单的尝试的话我们只需要解压到任意目录即可,这里我们将kafka压缩包解压到/home/lighthouse/kafka 目录

tar -zxvf kafka_2.13-3.3.1

3、kafka配置

在kafka解压目录下下有一个config的文件夹,里面放置的是我们的配置文件

- consumer.properites 消费者配置,此处我们使用默认的即可

- producer.properties 生产者配置,此处我们使用默认的即可

- server.properties kafka服务器的配置,此配置文件用来配置kafka服务器,目前仅介绍几个最基础的配置

broker.id 申明当前kafka服务器在集群中的唯一ID,需配置为integer,并且集群中的每一个kafka服务器的id都应是唯一的,我们这里采用默认配置即可

listeners 申明此kafka服务器需要监听的端口号,如果是在本机上跑虚拟机运行可以不用配置本项,默认会使用localhost的地址,如果是在远程服务器上运行则必须配置,例如:

listeners=PLAINTEXT:// 192.168.180.128:9092。并确保服务器的9092端口能够访问

zookeeper.connect 申明kafka所连接的zookeeper的地址 ,需配置为zookeeper的地址,由于本次使用的是kafka高版本中自带zookeeper,使用默认配置即可

zookeeper.connect=localhost:2181

三、使用

1、启动zookeeper

[lighthouse@VM-0-8-centos ~]$ cd kafka/kafka_2.13-3.3.1/

[lighthouse@VM-0-8-centos kafka_2.13-3.3.1]$ bin/zookeeper-server-start.sh config/zookeeper.properties

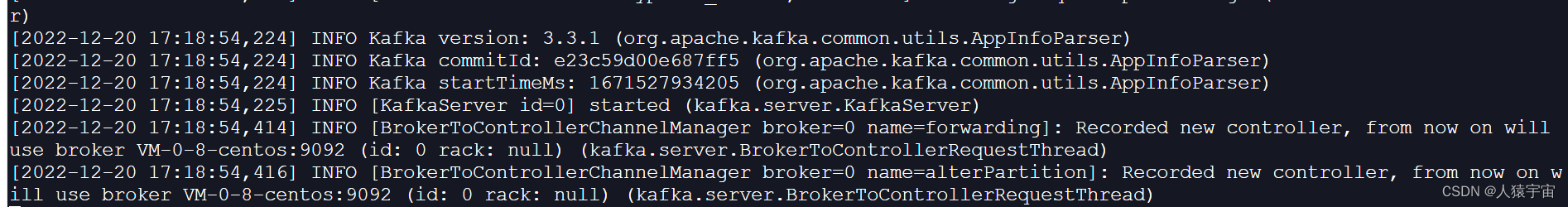

2、启动kafka

[lighthouse@VM-0-8-centos ~]$ cd kafka/kafka_2.13-3.3.1/

[lighthouse@VM-0-8-centos kafka_2.13-3.3.1]$ ./bin/kafka-server-start.sh ./config/server.properties

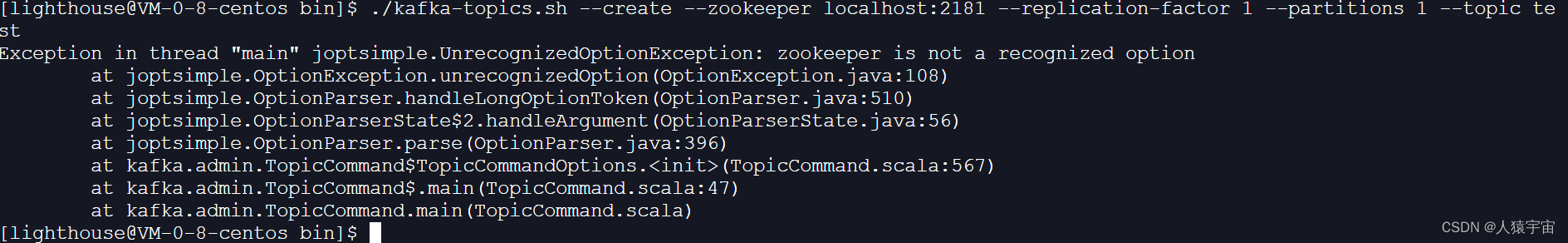

3、创建一个topic

Kafka通过topic对同一类的数据进行管理,同一类的数据使用同一个topic可以在处理数据时更加的便捷

[lighthouse@VM-0-8-centos ~]$ cd kafka/kafka_2.13-3.3.1/

创建一个名为sun_demo的topic

[lighthouse@VM-0-8-centos kafka_2.13-3.3.1]$./bin/kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic sun_demo

会报错:

需用新的方式创建主题:

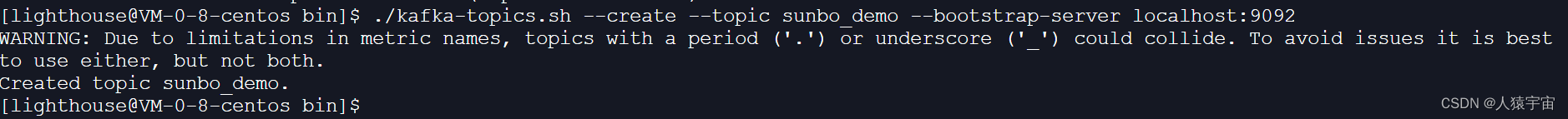

[lighthouse@VM-0-8-centos bin]$ ./kafka-topics.sh --create --topic sun_demo --bootstrap-server localhost:9092

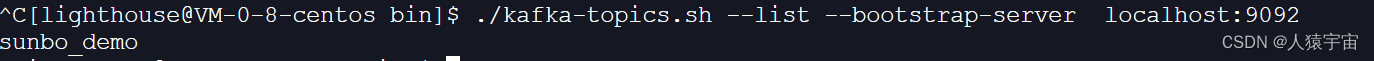

创建结果如图:

显示已经创建的topic

[lighthouse@VM-0-8-centos bin]$ ./kafka-topics.sh --list --bootstrap-server localhost:9092

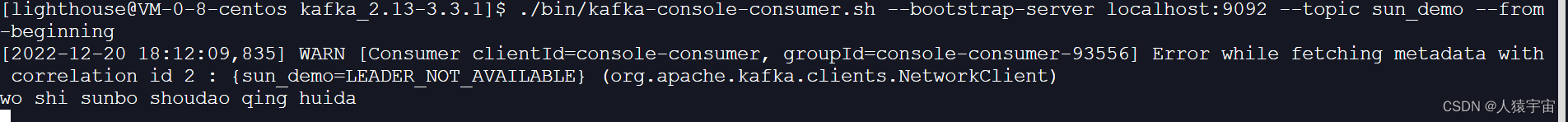

4、创建消息消费者

[lighthouse@VM-0-8-centos ~]$ cd kafka/kafka_2.13-3.3.1/bin

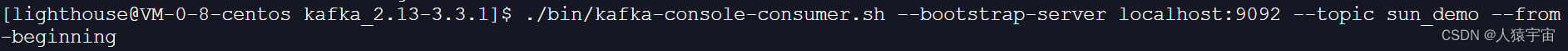

[lighthouse@VM-0-8-centos kafka_2.13-3.3.1]$ ./bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic sun_demo --from-beginning

5、创建消息生产者

创建消息生产者并输入消息内容

[lighthouse@VM-0-8-centos bin]$ ./kafka-console-producer.sh --broker-list localhost:9092 --topic sun_demo

>wo shi sunbo shoudao qing huida

消息消费者收到内容如图