作者 | 李建忠

出品 | 「李建忠研思」公众号

OpenAI通过一系列在AI技术和产品上的突破,引爆了通用人工智能(AGI)的发展,被微软CEO 萨提亚 · 纳德拉称为“堪比工业革命的技术浪潮”。OpenAI趟出来的以大语言模型为主的AGI技术路线,也基本上宣告了其他AI技术路线的终结,这样以一己之力改变整个领域航道的,在技术史上也是空前绝后。一个区区两三百人(在去年底推出ChatGPT时,OpenAI团队大约270人)的创业公司,何以在众多巨头逐鹿多年的AI竞技场一路披荆斩棘,摘得通用人工智能的圣杯?无论在硅谷,还是在国内,很多人都在问:

为什么AGI这样史诗级的革命,背后的核心推手竟然是OpenAI这样的创业公司?OpenAI到底做对了什么?

我自从2016年开始一直追踪研究AI领域的产业发展,每年筹办全球机器学习技术大会(ML-Summit)的工作原因,陆续和很多来自OpenAI的专家、包括Ilya Sutskever(首席科学家)、Lukasz Kaiser(Transformer共同发明人)、Andrej Karpathy(联合创始人)、Ian goodfellow(GAN之父)等经常接触和交流。很早就注意到了OpenAI这个在AI领域特立独行的“异类”。

如果回看AI产业的发展历史,和OpenAI历史道路上的诸多关键选择,我几乎惊叹地发现,作为一家创业公司,OpenAI在每一次关键的岔路口上,都毫不犹豫地选择了“难而正确”的决定。回顾OpenAI发展历史上这些“难而正确”的选择,我觉得对于我们今天很多AI领域的同行者会有重要的启发。

愿景和使命:剑指通用人工智能

「我们的目标是以造福全人类的方式推进人工智能。今天的AI系统虽然令人惊叹,但很多表现又不免差强人意。但在未来,AI极有可能在几乎所有智力任务上达到人类的表现。这项事业的结果是不确定的,工作是困难的,但我们相信我们的目标和结构是正确的。」

这段话是我摘抄自OpenAI 在2015年12月刚成立不久创始团队发表的“愿景和使命”博客中的一段文字。八年后的今天读来,感受仍然是真诚和激荡的。

OpenAI能够在2015年整个AI领域被各种迷雾笼罩的时候,就提出“通用人工智能”这一强大的“愿景和使命”,是建立在创始团队对人工智能的坚实信仰、深刻理解和现状研究基础之上的,我将这些合称为对通用人工智能的“愿力”。这样的“愿力”,帮助OpenAI此后在人工智能的发展道路上一次次守正出奇。

“愿景和使命”在今天浮躁的创投圈,很容易被异化为“忽悠VC和给员工画饼”。但如果研究人类科技发展史,你会发现在一个领域提出强大的“愿景和使命”,是成为一个领域拓荒者的鲜明特征。反过来说,但凡革命性的事情,都有极大的难度,没有强大的“愿景和使命”指引,遇到困难就很容易放弃和溃散。因此,对于那些坚定信仰的创业者,我鼓励大家大声讲出你的“愿景和使命”。我也希望我们的创投界、媒体界对于创业者的“愿景和使命”要鼓励支持、而非奚落鞭挞。

我时常在想如果将时间拉回到2015年,如果30岁的Sam Altman和29岁的Ilya Sutskever这两位毛头小子在我们的某个创投活动上讲出上述“愿景和使命”,是不是会被一众“大佬”唾沫星子淹死?事实是OpenAI在成立时就获得了大约1亿美金的捐赠,彼时OpenAI还是以非赢利性组织的方式成立的。

技术路线一:无监督学习

OpenAI刚成立不久,就在Ilya Sutskever的领导下下注“无监督学习”这条道路。熟悉AI研究领域的朋友都知道,今天这个看起来无比正确的决定,在2015-2016年,绝对不是那么显而易见。因为彼时的人工智能领域,通过标注数据方法的“监督学习”大行其道,在很多垂直领域比如推荐系统、机器视觉等,效果也更好。

而“无监督学习”在理论突破和工程技术上彼时都非常不成熟,效果也大打折扣,属于典型的“非主流”。但无需人工标注数据的“无监督学习”具有强大的普适性、且易扩展,通过大规模的数据预训练,模型就能学到数据中蕴涵的人类丰富的知识,从而在各类任务中大显身手。对于“通用人工智能”这一目标来说,“无监督学习”显然具有“任务的普适性”和依据海量数据进行快速“scale(扩展)”的能力。

今天来看,很多“监督学习”方法都被OpenAI的“无监督学习”大幅甩开,但在当时选择“无监督学习”显然属于“难而正确”的决定,这样的关键道路选择和OpenAI对AGI的愿景是密不可分的。

技术路线二:生成式模型

当2016年,各种“识别”类任务(如视觉识别、语音识别等)大行其道时,OpenAI在2016年6月发表《生成式模型(Generative Models)》中开篇就引用著名物理学家费曼的名言“What I cannot create, I do not understand. 如果不能创造,就无法理解”。也将OpenAI的研究重心放在生成式任务上。

而彼时虽然有Ian goodfellow 发明的GAN(生成式对抗网络)的惊艳时刻,但它的不可解释性,以及相较于识别类任务的“有用”,总体上,主流的人工智能业界其实对于生成式模型的判断是“难度大,但用处不大”。

但通读《生成式模型(Generative Models)》文章中,可以看出OpenAI团队对于生成式模型是“AGI必经之路”的坚定,就能体会出OpenAI团队卓尔不群、坚定自我的特质。

技术路线三:自然语言

虽然在2012年深度学习进入工业界成为主流方法之后,机器视觉很快成为更为成熟、效果更好、变现能力也更强的领域。虽然Ilya Sutskever也是通过AlexNet参加ImageNet大赛拔得头筹而在机器视觉领域一战成名,但OpenAI在做了一些尝试之后并没有选择视觉作为主攻方向,而是选择了押注更难、更险的“自然语言”。

相对视觉、语音等领域,自然语言处理长期被认为是相对落后的领域,因为自然语言任务具有巨大的复杂性和解空间,很多方法在某一个单一任务上可以,但放到另一任务上就表现很差,起伏不定。业界也有说法,自然语言处理是人工智能领域的“圣杯”。

在尝试OpenAI Gym(开源强化学习平台)和OpenAI Five(使用强化学习打Dota2游戏)的同时,OpenAI在使用无监督学习来进行自然语言的任务上走的越来越远。特别是2017年通过生成式方式来预测 Amazon 评论的下一个字符,取得了很棒的效果。

为什么OpenAI选择押注自然语言?套用著名哲学家维特根斯坦“语言的边界就是世界的边界”。如果用Ilya Sutskever的话来说 “语言是世界的映射,GPT是语言的压缩”。就人类智能而言,自然语言是核心中的核心,而其他视觉、语音等都不过是自然语言的辅助佐料。

正是有了对自然语言通向AGI道路信仰般的押注,等到2017年6月12日Google的Transformer奠基性论文《Attention is All You Need》一发布,用Ilya Sutskever的原话说论文发表的第二天,他看到论文后的第一反应是“就是它了”。Transformer模型从理论上颠覆了前代RNN、LSTM等自然语言处理方法,扫清了OpenAI团队苦苦探索自然语言领域的一些关键障碍。

然而遗憾的是,Transformer这一理论模型并没有在Google内部得到足够的重视,反倒让OpenAI团队如获至宝。这一幕像极了1979年乔布斯参观施乐PARC研究院的Alto电脑上的图形界面(GUI)和鼠标后,回到苹果就开始押注图形界面并开启了轰轰烈烈的个人电脑时代,而施乐PARC的领导层却迟迟看不到GUI向普通大众释放的巨大计算潜力。而亲自打造Transformer的七位共同发明人后来也陆续离开Google,有的加入OpenAI(包括我们2021年全球机器学习技术大会的keynote speaker、OpenAI研究科学家Lukasz Kaiser),有的在硅谷VC支持下创办新一代人工智能公司。很有点当年硅谷仙童半导体“八叛徒”的昨日重现。

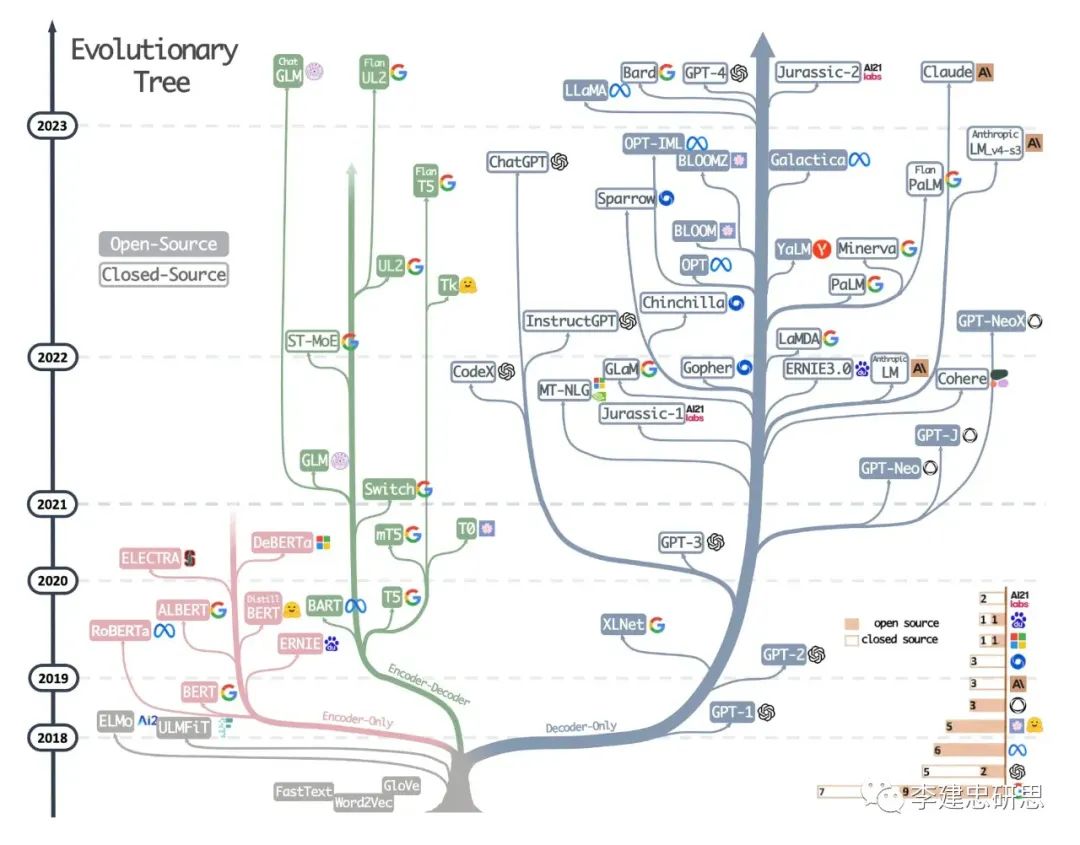

技术路线四:解码器

在Transformer打开了大语言模型的理论窗口之后,大语言模型发展出了三种路线。第一种,以Google BERT、ELECTRA为代表的Encoder-Only(编码器)路线;第二种,以Google T5、BART为代表的Encoder- Decoder(编解码器)路线;第三种,以OpenAI GPT为代表的Decoder-Only(解码器)路线。

这三种路线,Encoder-Only路线适合理解类任务,很难应对生成式任务,也不具有好的扩展性和适应性,虽然被Google BERT在个别子领域一度带火,但现在几乎处于被主流抛弃的地步。Encoder- Decoder路线适合特定场景任务,但通用性和扩展性也比较差。Decoder-Only路线首先非常适合生成类任务,同时对各类任务都具有很好的通用性,在工程上也具有很高的可扩展性(scale),非常适合将模型规模做大。

基于这些特点来看,要以AGI通用人工智能为目的地的话,那么Decoder-Only路线显然是不二选择。从上面的大语言模型进化树来看,可以看出GPT选择的Decoder-Only路线显然引领了大语言模型的发展和繁荣。

技术路线五:从强化学习到对齐

通过以上的无监督学习、生成式模型、自然语言、解码器这几个关键的技术岔路口选择之后,GPT模型显然已经奔赴在通往AGI的康庄大道上了。但是GPT的强大也引入一些新的隐忧,它的强大会不会为人类带来危险、破坏人类价值观、帮助作恶、扰乱社会秩序、甚至威胁人类的生存?

这是严重违背OpenAI的愿景和使命的。如何将强大的GPT模型与人类价值观和社会规范对齐?强大之后如何变得“对人类有用”?技术的问题要靠技术来解决。这时候OpenAI在早期训练Dota游戏智能代理时积累已久的强化学习功底就派上用场了。通过在预训练之后加入基于人类反馈的强化学习(RLHF,Reinforcement Learning from Human Feedback)来教导AI做一个对人类有益的“好的AI”,设立护栏,防止被用来做恶。这方面,OpenAI想得很远,投入的也很大,配得上它的“愿景和使命”。

工程智慧:Scale Law

如果回顾OpenAI在历史上做的一系列技术选择,我们会发现几乎所有的选择都是围绕“是否有利于通用人工智能Scale”的原则进行的,而与该技术在当时“是否能快速变现”、“是否主流”、“是否容易上手”、“是否效果立竿见影”完全无关。

做过技术架构,或者商业战略的人也都知道,“快速易扩展”是好的技术架构或者商业模式的“铁律”。这一铁律同样适用于通用人工智能的发展。OpenAI的团队显然是洞悉这一点的。他们甚至在2020年发表了一篇著名的论文《Scaling Laws for Neural Language Models》来总结模型参数、训练数据集大小、算力投入(FLOPs 每秒浮点操作)、网络架构之间的扩展法则。

其实除了模型的Scale Law,OpenAI对于迈向AGI道路上的各种Scale力量都有非常深刻的洞见和睿智的选择。

产品智慧:从超级应用到生态平台

从2018年OpenAI推出GPT 1.0到2020年GPT发展到3.0,OpenAI这时已经拿到大语言模型这样一张王牌,但怎么出牌也很重要。历史上握着一手技术好牌,但是打得稀烂的也比比皆是。以OpenAI强大的“通用人工智能”愿景来说,不做平台型公司是很难的。但是科技史上一上来就做平台的公司,大部分都折戟沙场。反观那些成功的平台型技术公司,绝大多数都是先从建立“超级应用”开始的。

历经硅谷顶级孵化器YC总裁的锻炼,OpenAI的另一位灵魂人物CEO Sam Altman,当然是产品战略高手中的高手。OpenAI选择先从ChatGPT这一“超级应用”入手,通过短短几个月的时间,积累了上亿的用户、海量的交互数据、和极强的品牌号召力,才有后面的ChatGPT API, Plugins等一系列大手笔的平台布局。以目前各种渠道的消息来看,OpenAI在产品上还有很多大招,让我们拭目以待。

顺便提一下,我在前面《AGI时代的产品版图和范式》文章中,也更深入地谈了很多我对AGI时代产品创新的思考。

股权设计:限制盈利公司

OpenAI最早是以非盈利组织的方式成立,初期资金以捐赠的方式募集。但显然创始团队低估了发展AGI需要的硬件和人才投入,也高估了捐赠的兑现(早期承诺的捐赠后来其实很多没到位)。因此到2019年3月,OpenAI重新设计公司治理架构,改为“限制盈利”的公司,接受微软10亿美金投资。

“限制盈利”规定向OpenAI投资的股东,未来从OpenAI能够获取的利润分配最多到投资额X100倍的上限。超出部分将由非盈利组织OpenAI Nonprofit控制。

这一精妙的股权设计既能吸引OpenAI所需要的投资,又防止了AGI过于强大而攫取巨额利润。平衡了发展AGI需要的商业支持和AGI造福全人类这一宏大愿景之间的矛盾。我觉得若干年后回看历史,这一股权设计也是商业史上一个伟大的发明。创始人兼CEO Sam Altman不拿股权,不求商业回报,一心追求AGI改变世界的胸怀也让人心生敬意。

战略设计:合纵连横

如果将OpenAI比作AI时代的一只小恐龙,那么在AI领域长期重兵投入、市值万亿的Google和微软显然是AI时代的两只大恐龙。OpenAI这样的“搅局者”如果被两只大恐龙中的任何一只盯上,都会惹火烧身。而OpenAI对于ChatGPT这样的“爆款应用”推出所引起的AI战国纷争显然有充分的预判和精妙的战略设计。

OpenAI首先通过和微软这只大恐龙的战略合作,既拿到百亿美金量级的宝贵发展资金,同时又通过GPT赋能微软Bing搜索、半路拦截Google这只大恐龙,还顺带将GPT赋能到自己一时半会照顾不到的B端市场(Azure云服务、Office 365等)以获取适当利润,而自己却可以集中精力、以C端市场为切入点、在构建AGI时代的生态平台上蒙眼狂奔。

这一巧妙利用巨头“创新者窘境”的合纵连横,让一家人数仅有300多估值不过300亿美金的创业公司,同时撬动两家市值万亿美金、员工近二十万的科技巨鳄的战略布局,放眼整个商业史,空前绝后,蔚为大观。

团队架构:学术+工程+产品+商业

读到这里很多朋友可能会问,OpenAI到底什么来头、何德何能如此彪悍?秘密无他,科技公司最贵的就是人才。OpenAI有着足以笑傲AI江湖的联合创始团队组合。

一号位CEO Sam Altman 20岁从斯坦福辍学创办Loopt,于2012年将公司以4300万美金出售。于2014被大自己二十岁的YC创始人、硅谷创业教父格雷厄姆说服接替他担任YC总裁。格雷厄姆很早就看到Sam Altman的卓越才华,在他眼里,Sam Altman就是硅谷未来的乔布斯。Sam Altman在硅谷的创业和YC的经历锻造了他在产品模式、商业战略、投融资方面的顶级才能。

二号位首席科学家Ilya Sutskever是深度学习之父Geoffrey Hinton的关门弟子,从ImageNet大赛一战成名,后来加入Google大脑,发明Seq2Seq大幅改善机器翻译,参与TensorFlow和AlphaGo的研发。是深度学习学术领域当仁不让的“开山功臣”。

总裁Greg Brockman之前创立著名支付公司Stripe并担任CTO,具有极强的工程技术能力和从零到一搭建技术团队的经验。是OpenAI长期的工程技术支柱。除此之外,像Andrej Karpathy 、John Schulman、Lukasz Kaiser等灿若群星的汇聚,使得OpenAI在AI人才密度上放眼全球,都属顶流之列。OpenAI的团队结构也反应OpenAI的AGI创业观:学术、工程、产品、商业,四大支柱缺一不可,而且各个都很强。

除了自己聚焦AGI还不够,OpenAI和Sam Altman还投资了众多核聚变、量子计算、加密货币等公司,围绕能源、算力、财富分配等未来变革进行大手笔布局。这些每一个都剑指AGI的未来。

综上所述,OpenAI无论是在技术的多个岔路口上的关键选择,还是在产品、工程、股权、战略、团队上,都打得一手好牌,是一家非常值得研究和重视的公司,也是我们窥视AGI时代的一扇窗户。

作者简介

李建忠 Boolan创始人兼任首席技术专家,全球机器学习技术大会主席。对人工智能、产品创新、商业模式有丰富经验和深入研究。近年来研究以⼤语⾔模型为主的⼈⼯智能⽅法,相关研究和咨询引起业界强烈关注。曾于 2005年-2010年期间担任微软最有价值技术专家,区域技术总监。拥有近二十年技术与产品经验,为包括众多世界500强公司在内的知名品牌提供高端产品创新、技术战略咨询服务。

注:本文经授权转载自微信公众号『李建忠研思』,如需转载,请联系对方授权!

【活动分享】全球机器学习技术大会(ML-Summit)将于2023年10月20-21日在北京金茂威斯汀大饭店举办。此次大会的slogan是“拥抱AGI变革时代”,聚焦工程实践,共八大主题:「大模型前沿技术演进,大模型系统工程实践,大模型应用开发实践,AIGC与机器视觉,AIGC 行业应用与实践,AIGC 赋能软件工程变革,ML/LLM Ops 大模型运维,AI Infra 大模型基础架构」。详情参考官网:http://ml-summit.org/ (或点击原文链接)