一、问题描述

在命令行输入命令运行Flume可以启动

[root@bigdata111 flume-1.9.0]# bin/flume-ng agent -n a1 -c conf/ -f job/file_to_kafka.conf -Dflume.root.logger=info,console

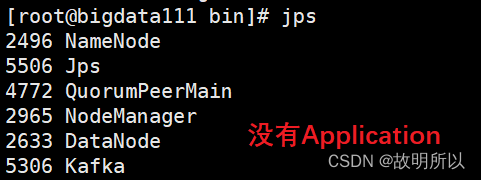

但当我运行编写的shell启停脚本时,不起作用

脚本如下:

#!/bin/bash

case $1 in

"start"){

for i in bigdata111 bigdata112

do

echo " --------启动 $i 采集flume-------"

ssh $i "nohup /opt/module/flume-1.9.0/bin/flume-ng agent -n a1 -c /opt/module/flume-1.9.0/conf/ -f /opt/module/flume-1.9.0/job/file_to_kafka.conf >/dev/null 2>&1 &"

done

};;

"stop"){

for i in bigdata111 bigdata112

do

echo " --------停止 $i 采集flume-------"

ssh $i "ps -ef | grep file_to_kafka.conf | grep -v grep |awk '{print \$2}' | xargs -n1 kill -9 "

done

};;

esac

原因:

这应该不是大问题,可能是环境变量引起的的问题。

linux环境变量,是否登录,是否交互访问,决定了系统的加载顺序 /etc/profile 以及 /etc/profile.d/*.sh 以及 ~/.bashrc 以及 ~/.profile 或其他文件。

在centos和ubuntu的同一位置改变环境变量,ssh到远程机器上执行某个命令,可能一个可以找到该命令,另一个可能找不到该命令。

二、解决方法

进入flume的lib文件夹下,删除默认值 guava-11*.jar 依赖

[root@bigdata111 lib]# rm -fr guava-11.0.2.jar

在正常情况下,删除这个jar之后,flume会查找 $HADOOP_HOME 在hadoop中使用的guava。

然后去复制hadoop中的guava*.jar 到flume的lib文件中

[root@bigdata111 lib]# cp /opt/module/hadoop-3.1.3/share/hadoop/common/lib/guava-27.0-jre.jar /opt/module/flume-1.9.0/lib/

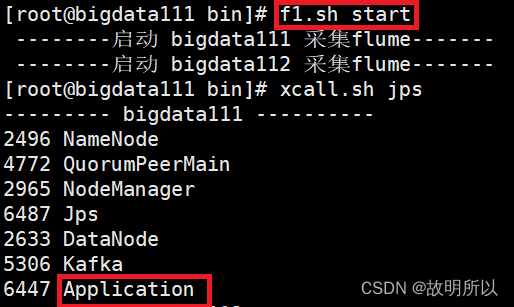

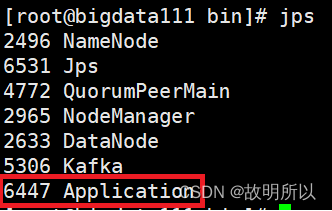

再次执行脚本,发现成功了