一、HOG向梯度直方图概述

向梯度直方图(Histogram of Oriented Gradient, HOG)特征是基于对稠密网格中归一化的局部方向梯度直方图的计算。此方法的基本观点是:局部目标的外表和形状可以被局部梯度或边缘方向的分布很好的描述,即使我们不知道对应的梯度和边缘的位置。在实际操作中,将图像分为小的元胞(cells),在每个元胞内累加计算出一维的梯度方向(或边缘方向)直方图。

为了对光照和阴影有更好的不变性,需要对直方图进行对比度归一化,这可以通过将元胞组成更大的块(blocks)并归一化块内的所有元胞来实现。归一化的块描述符就叫作HOG描述子。将检测窗口中的所有块的HOG描述子组合起来就形成了最终的特征向量,然后使用SVM分类器进行行人检测。检测窗口划分为重叠的块,对这些块计算HOG描述子,形成的特征向量放到线性SVM中进行目标/非目标的二分类。检测窗口在整个图像的所有位置和尺度上进行扫描,并对输出的金字塔进行非极大值抑制来检测目标。

=========================================================================

二、向梯度直方图(Histogram of Oriented Gradient, HOG)特征算法大概过程:

1)HOG特征提取方法就是将一个image即要检测的目标或者扫描窗体进行图像灰度化,就是将图像看做一个R,G,B三颜色的三维图像,对于彩色图像,将RGB分量转化成灰度图像,其转化数学公式为:

2)采用Gamma校正法对输入图像进行颜色空间的标准化(归一化);目的是调节图像的对照度,减少图像局部的阴影和光照变化所造成的影响,同一时候能够抑制噪音的干扰。 在图像照度不均匀的情况下,可以通过Gamma校正,将图像整体亮度提高或降低。在实际中可以采用两种不同的方式进行Gamma标准化,平方根、对数法。这里我们采用平方根的办法,公式如下(其中γ=0.5):

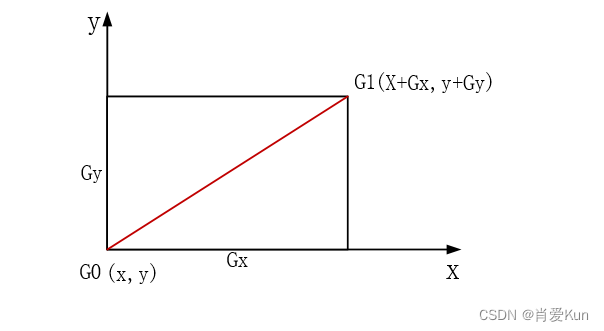

3)计算图像每一个像素的梯度dx和dy(包含梯度大小和梯度方向);主要是为了捕获轮廓信息,同一时候进一步弱化光照的干扰,计算图像的X方向梯度dx与Y方向梯度dy,根据梯度计算mag与角度,计算梯度时候可以先高斯模糊,使用sobel算子或者其它一阶导数算子计算梯度值dx、dy,梯度的大小和方向:

,

sobel的水平方向算子和垂直方向算子:

首先用sobel算子,Horizontal Direction梯度算子对原图像做卷积运算,得到x方向(水平方向,以向右为正方向)的梯度分量gradscalx,然后用Horizontal Direction梯度算子对原图像做卷积运算,得到y方向(竖直方向,以向上为正方向)的梯度分量gradscaly。然后再用以下公式计算该像素点的梯度大小和方向:

分别表示输入图像中像素点的(x,y)处的水平方向梯度,垂直方向梯度和像素值,像素点(x,y)c处的梯度幅值和梯度方向分别为:

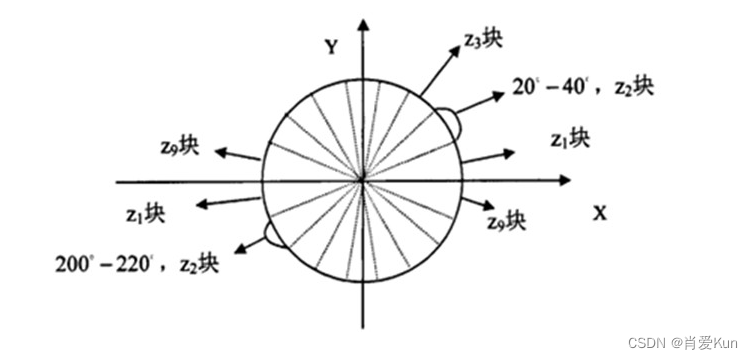

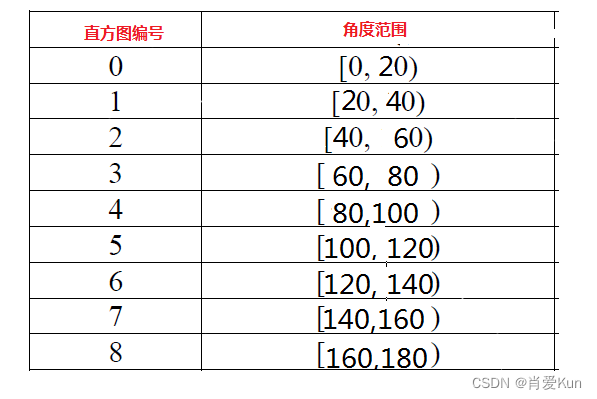

将图像划分为8x8的小网格,对每个小网格内的图像做梯度方向直方图,每个8x8=64个像素为一个cell,对每个cell根据角度分为9个直方图块(BIN),对cell内每一个像素用梯度方向在直方图中进行加权投影,映射到固定的角度范围,就能够得到这个cell的梯度方向直方图了,就是该cell中对应的9维特征向量,例如,20°-40°和200°-220°划入一个直方图块里。

4)将图像划分成小网格cells,为每一个网格单元构建梯度方向直方图,将cell的梯度方向360度分成9个方向块Block。一般地,一个块(Block)都由若干网格单元Cell组成,一个单元Cell都有若干个像素点组成。假设行人检测的参数设置是:2×2 cell/block、8×8像素/cell、9个直方图通道(9 bins),一个cell的hog描述子向量的长度为9,一个块的特征向量长度为:2×2×9=36,所以检测窗口的HOG向量长度=105×4×9=3780。

5)统计每一个cell的梯度直方图不同梯度的个数,就可以形成每一个cell的描述算子descriptor;在计算每个cell的梯度直方图时,可以用三线性插值来提高计算速率。对于每个cell里的点,我们认为都是一个三维向量

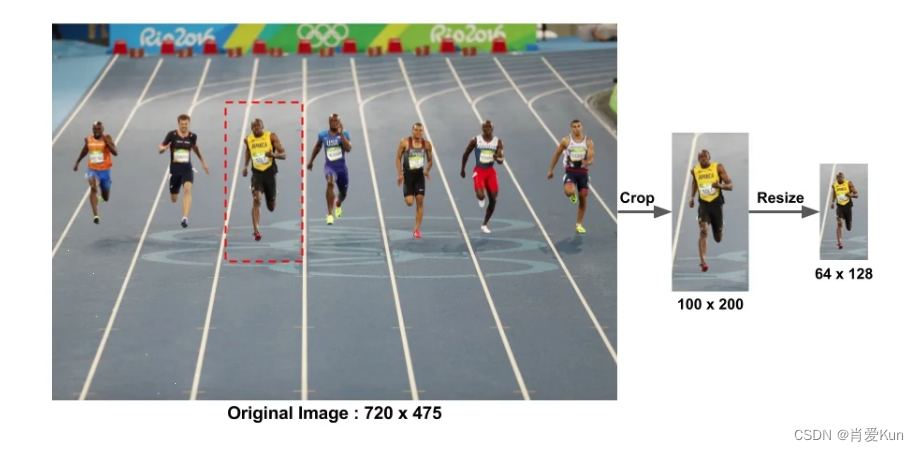

从下面的图片可以看到,原图像大小为720×475,裁剪成大小为64×128个像素的图片,然后可以被分割成128个8*8大小的网格cell,每个网格cell都会计算一个梯度直方图。8×8像素大小的网格cell可以提供了一个紧凑(compact)/压缩的表示。

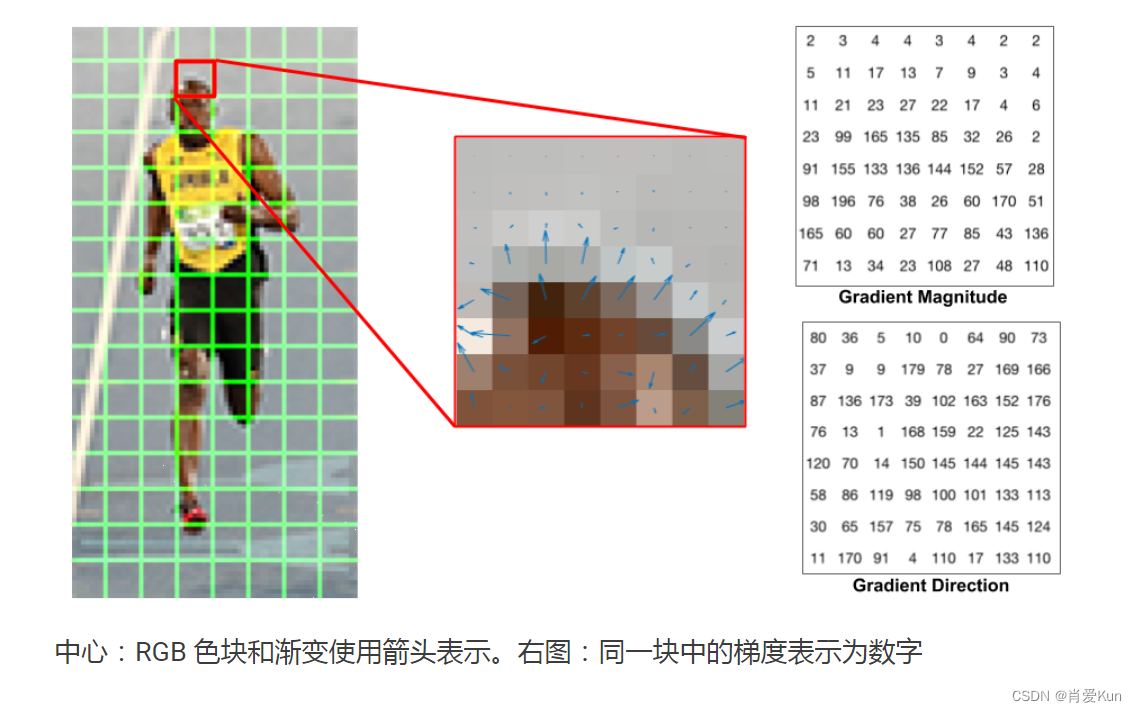

在图像中,每个像素点包括像x方向梯度幅值magnitude,梯度方向direction三个要素,即一个8×8像素大小的图像有8×8×3=192个像素值,三个channel取最大magnitude那个,加起来就是8*8*2=128,后面我们会看到这128个数如何用一个9个bin的直方图来表示成9个数的数组。不仅仅是可以有紧凑的表示,用直方图来表示一个图像也可以更加抗噪,一个gradient可能会有噪音,但是用直方图来表示后就不会对噪音那么敏感了。

在图像中,每个像素点包括像x方向梯度幅值magnitude,梯度方向direction三个要素,即一个8×8像素大小的图像有8×8×3=192个像素值,三个channel取最大magnitude那个,加起来就是8*8*2=128,后面我们会看到这128个数如何用一个9个bin的直方图来表示成9个数的数组。不仅仅是可以有紧凑的表示,用直方图来表示一个图像也可以更加抗噪,一个gradient可能会有噪音,但是用直方图来表示后就不会对噪音那么敏感了。

上面这个图片的大小是64×128个像素,分割成了128个8×8像素大小的网格cell,那么整个图像一共有64/8 ×128/8 = 8*16=128个网格

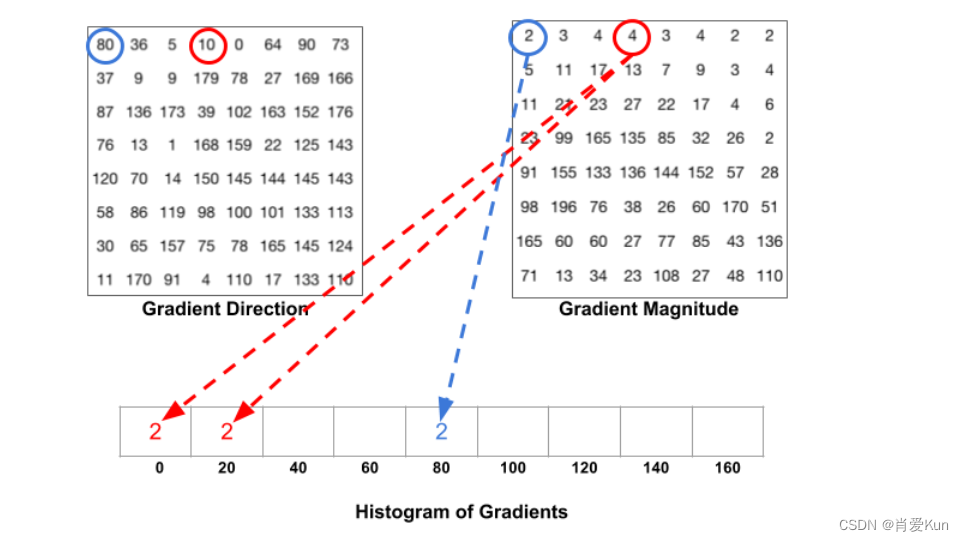

根据梯度幅值magnitude,梯度方向direction的两张表格,根据梯度方向direction选择bin的位置, 根据副值来确定这个bin的大小。蓝色圈的像素点对应的梯度方向direction为80,对应的幅值大小为2,与其对应的直方图第五个bin里面加2;对应的梯度方向direction为10,对应的幅值大小为4,因为角度10介于0-20度的中间(正好一半),所以把幅值一分为二按照比例影响大小放到0和20两个bin里面去。

如果角度大于 160 度,则这个角度介于 160 度和 180 度之间,角度环绕使 0 度和 180 度相等。因此,在下面的示例中,角度为 165 度的像素对 0 度 bin 和 160 度 bin 的贡献成比例。

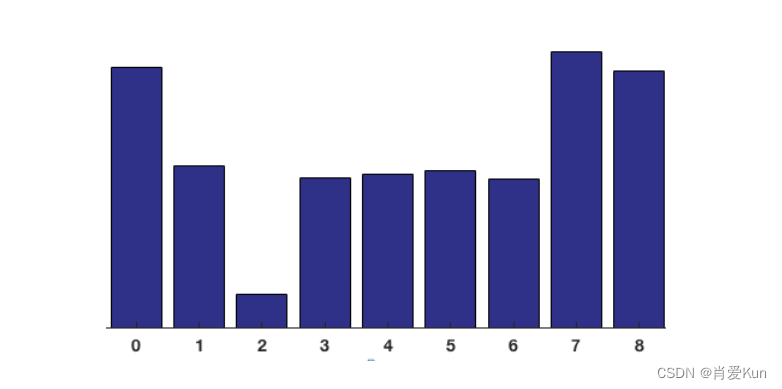

可以看到有很多值分布在0-180的bin里面,这其实也就是说明这个网格中的梯度方向很多都是要么朝上,要么朝下。把每个8*8的cell里面所有的像素点都分别加到这9个bin里面去,就构建了一个9-bin的直方图,上面的网格对应的直方图如下:

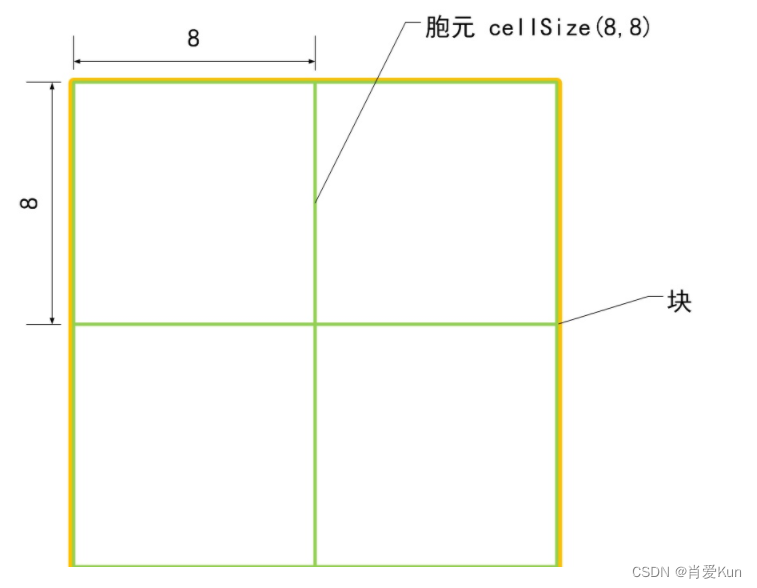

6)将每几个cell组成一个block(比如2×2个cell/block),一个block内全部cell的特征descriptor串联起来便得到该block的HOG特征描述算子descriptor。有几个参数非常重要,分别为winSize(64,128), blockSize(16,16), blockStride(8,8), cellSize(8,8), nbins(9),在此,用几个示意图来表示。

a) 窗口大小winSize(64,128)

b) 块大小blockSize(16,16)

c) 胞元大小cellSize(8,8)

c) 胞元大小cellSize(8,8)

Hog特征维数的计算

Hog特征维数的计算

HOGDescriptor* hog = newHOGDescriptor(cvSize(64, 48), cvSize(8, 6), cvSize(8, 6), cvSize(4, 3), 9);根据上面的描述可知,cvSize(64,128)表示窗口的大小,cvSize(16, 16)表示块(block)大小,cvSize(8,8)表示块滑动增量(blockStride)大小,cvSize(4, 4)表示胞元(cell)大小,9表示每个胞单元中梯度直方图的数量。

可知:一个块(block)包含A=(blockSize.width/cellSize.width)*(blockSize.height / cellSize.height)=128个网格(cell),所以一个块(block)含有9A=1125个梯度直方图。可以通过计算一个窗口中包含了B=((windowSize.width-blockSize.width)/(blockStrideSize.width)+1)* ((windowSize.height-blockSize.height)/(blockStrideSize.height)+1)=105个块(block),所以一个窗口包含9AB=3780个梯度直方图。

将2x2的网格单元cell组合成为一个大的块(Block)对每个块之间有1/2部分是重叠区域。主要是将每个Cell的直方图合并为一个大的直方图向量,这样每个块就有36个向量描述子。对每个块的描述子做归一化处理,常见的归一化处理为L2-norm或者L1-norm,公式如下:

7)将图像image内的全部block的HOG特征descriptor串联起来就能够得到该image(你要检測的目标)的HOG特征descriptor了。这个就是终于的可供分类使用的特征向量了。

=========================================================================

代码实现:

#include"stdafx.h"

#include <opencv2/opencv.hpp>

#include <iostream>

#include "math.h"

#include <opencv2/features2d.hpp>

#include <opencv2/highgui/highgui.hpp>

#include <opencv2/imgproc/imgproc.hpp>

using namespace cv;

using namespace std;

//using namespace cv::features2d;

int main(int argc, char** argv) {

Mat src = imread("F:/photo/h1.jpg");

if (src.empty()) {

printf("could not load image...\n");

return -1;

}

namedWindow("input image", WINDOW_AUTOSIZE);

imshow("input image", src);

/*Mat dst, dst_gray;

resize(src, dst, Size(64, 128));

cvtColor(dst, dst_gray, COLOR_BGR2GRAY);

HOGDescriptor detector(Size(64, 128), Size(16, 16), Size(8, 8), Size(8, 8), 9);

vector<float> descriptors;

vector<Point> locations;

detector.compute(dst_gray, descriptors, Size(0, 0), Size(0, 0), locations);

printf("number of HOG descriptors : %d", descriptors.size());

*/

HOGDescriptor hog = HOGDescriptor();

hog.setSVMDetector(hog.getDefaultPeopleDetector());

vector<Rect> foundLocations;

hog.detectMultiScale(src, foundLocations, 0, Size(8, 8), Size(32, 32), 1.05, 2);

Mat result = src.clone();

for (size_t t = 0; t < foundLocations.size(); t++) {

rectangle(result, foundLocations[t], Scalar(0, 0, 255), 2, 8, 0);

}

namedWindow("HOG SVM Detector Demo", WINDOW_AUTOSIZE);

imshow("HOG SVM Detector Demo", result);

waitKey(0);

return 0;

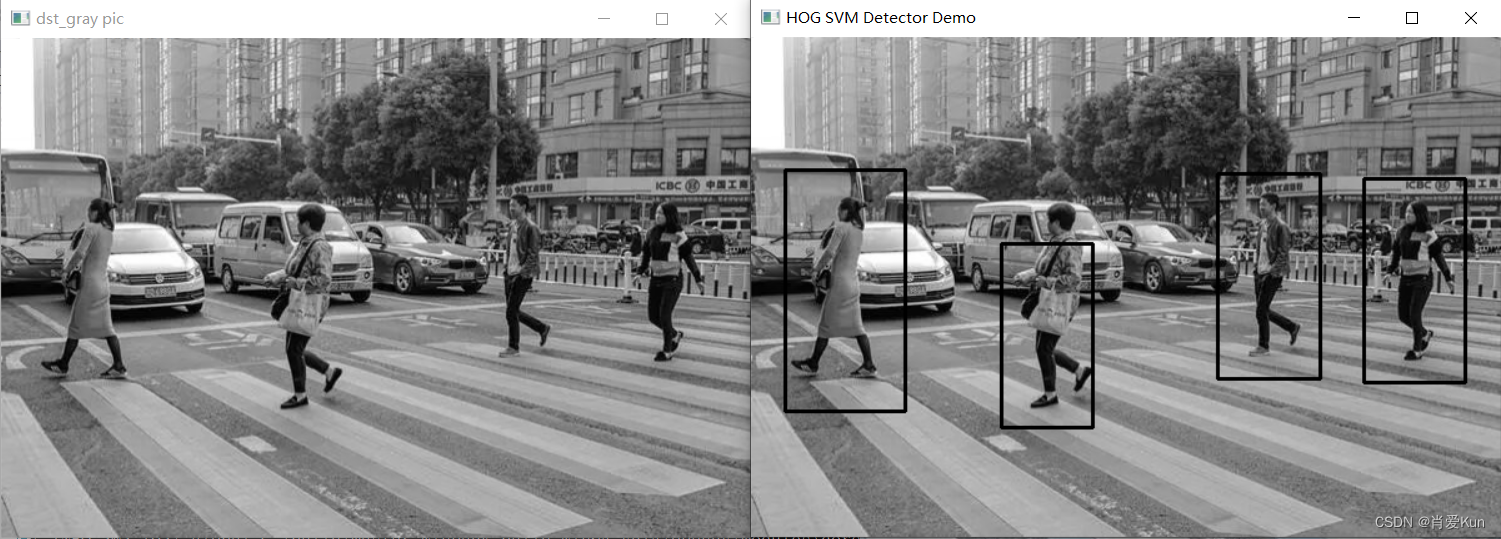

}图像处理效果:

行人识别:

行人识别:

灰度图行人识别: