该节是ffmpeg开发播放器学习记要的开篇《Hello FFmpeg》

ffmeg是一个跨平台的音视频录制、转换、编解码的库。使用C语言编写而成,可在主流移动与PC平台上使用。ffmeg不仅提供可嵌入到App中的库,还提供了可以直接使用的工具。掌握必要的ffmpeg基础使用与基本的音视频信息对于端开发者还是很有必要的。本系列记录了ffmpeg开发播放器的过程,目前规划的小节并不是全部,随着学习的深入可能会有增加或者删除。

第一节 - Hello FFmpeg

第二节 - 软解视频流,渲染 RGB24

第三节 - 认识YUV

第四节 - 硬解码,OpenGL渲染YUV

第五节 - Metal 渲染YUV

第六节 - 解码音频,使用AudioQueue 播放

第七节 - 音视频同步

第八节 - 完善播放控制

第九节 - 倍速播放

第十节 - 增加视频过滤效果

第十一节 - 音频变声

该小节 Demo 地

实例代码提供了Objective-C与Swift两种实现

目标

- 编译 ffmpeg,生成x86_64静态库

- 搭建 macOS+ffmpeg 开发环境

- 了解 ffmpeg 初始化流程

- 使用 ffmpeg 并打印音视频信息

编译 ffmpeg

1.下载

ffmpeg下载地址是 ffmpeg.org/download.ht… Source Code下载最新的源码。

下载完成后解压,然后进入到ffmpeg源码根目录。

2.配置编译参数

终端进入到ffmpeg源码目录,输入以下配置命令配置一个基础版本的编译参数

./configure --prefix=./macos --enable-gpl --enable-nonfree --enable-libfdk-aac--prefix 指定了编译产物的输出目录,这里指定输出到当前目录下的macos目录,提前创建好这个目录。--enable-gpl 允许使用GPL代码,生成的库和二进制文件将在GPL下--enable-nofree 允许使用非自由代码,生成的库和二进制文件将是不可分发的--enable-libfdk-aac 使用libfdk-acc对ACC音频流进行编码或者解码

3.编译ffmpeg

使用以下命令编译并将产物输出到macos目录

make && make install生成后的产物目录结构是这样的

4.编译libfdk-acc

由于启用了fdk-acc,需要单独编译libfdk-acc。

下载地址:www.linuxfromscratch.org/blfs/view/s…

配置编译参数,需要先创建macos目录

./configure --prefix=./macos --disable-staticmake && make install搭建 macOS+ffmpeg 开发环境

1.新建工程

新建macOS工程,并创建以下目录结构

resources: 存放音频、视频等vender: 存储ffmpeg静态库与头文件FFmpegPlayer: Objective-C工程FFmpegPlayer-Swift: Swift工程

创建好工程之后,导入ffmpeg库与头文件

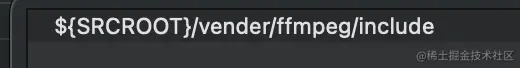

2.设置头文件搜索目录

到此,编码前的准备工作就做好了 。

了解 ffmpeg 初始化流程

在编码前,需要搞清楚ffmpeg的基本解码流程,下图大致描述了ffmpeg软解码的流程,接下来对每一步进行一个说明

1.打开文件/数据流

/// formatContet: AVFormatContext,保存了音视频文件信息

/// url: 需要打开的音视频文件地址

/// fmt: 指定打开的音视频文件的格式,如果不指定则自动推导

/// options: 设置AVFormatContext的options,它的默认值定义在:libavformat/options_table.h

/// 说明: AVFormatContext是一个AVClass,可以通过键值读取与设置定义的相关属性

int ret = avformat_open_input(&formatContext, url, NULL, NULL);2.找到音、视频流信息

/// formatContet: AVFormatContext,保存了音视频文件信息

/// options: 如果配置了,则流信息会被保存到里面,这里不需要保存输入NULL

ret = avformat_find_stream_info(formatContext, NULL);这个函数会读取少量的数据包方便找到精确的音视频流信息,这些包会被缓存起来,解码的时候不会重复读取。

3.遍历流信息

从已经读取到的流信息中遍历查找到音频与视频的流信息

for(int i = 0; i < formatContext->nb_streams; i ++) {

AVStream *stream = formatContext->streams[i];

AVMediaType mediaType = stream->codecpar->codec_type;

if(mediaType == AVMEDIA_TYPE_VIDEO) {

_mediaVideo = [[FFMediaVideoContext alloc] initWithAVStream:stream formatContext:formatContext];

if(!_mediaVideo) goto fail;

} else if(mediaType == AVMEDIA_TYPE_AUDIO) {

_mediaAudio = [[FFMediaAudioContext alloc] initWithAVStream:stream formatContext:formatContext];

if(!_mediaAudio) goto fail;

}

}4.初始化音视频解码器

从AVStream中可以读取到解码器的参数信息,这个结构体里包括了视频的宽高、FPS、视频长度等信息;如果是音频它包括了采样率、声道、音频数据包、音频格式、解码器等信息。

AVCodecParameters *codecParameters = stream->codecpar;AVCodec定义了解码器的功能,首先找到解码对应流信息的解码器

AVCodec *codec = avcodec_find_decoder(codecParameters->codec_id);找到解码器之后,需要实例化一个解码器上下文

AVCodecContext *codecContext = avcodec_alloc_context3(codec);AVCodec定义了功能,AVCodecContext结构表示程序运行的当前 AVCodec 使用的上下文,着重于所有 AVCodec 共有的属性(并且是在程序运行时才能确定其值)和关联其他结构的字段。

AVCodecContext可以看作是AVCodec的一个具体实体表现,后续的解码操作都使用AVCodecContext。AVCodecContext不仅包含了AVCodec定义的功能,还需要通过特定的参数来完成功能的调用,这些参数存储在AVCodecParameters中。

初始化完成之后还需要将流信息参数填充到AVCodecContext。

avcodec_parameters_to_context(codecContext, codecParameters);AVCodecContext默认是关闭的,在解码使用前需要先打开

avcodec_open2(codecContext, codec, NULL);到此,就完成了音视频解码器的初始化,这个是软解码的基本流程。

打印相关音视频信息

1.打印视频流信息

NSLog(@"=================== Video Information ===================");

NSLog(@"FPS: %f", av_q2d(stream->avg_frame_rate));

NSLog(@"Duration: %d Seconds", (int)(stream->duration * av_q2d(stream->time_base)));

NSLog(@"Size: (%d, %d)", self->codecContext->width, self->codecContext->height);

NSLog(@"Decodec: %s", self->codec->long_name);

NSLog(@"=========================================================");这里需要注意在ffmpeg中经常使用到的一个结构体: AVRational。

它的定义很简单,如下:

typedef struct AVRational{

int num; ///< Numerator

int den; ///< Denominator

} AVRational;分母与分子两个参数定义了一个值,使用这样一个结构可以很灵活的表达任意一个小数。

比如这里的在AVStream中的变量time_base,它直译出来就是时间基。

它表示将1秒分成11988,每一分代表0.000083416750083416754秒,而stream->duration的值表示基于这个time_base它总共有2490800份,将2490800 * 0.000083416750083416754就得到了这个视频总共有多少秒。

而av_q2d函数就是num/den。

最终打印出视频信息如下:

2.打印音频信息

NSLog(@"=================== Audio Information ===================");

NSLog(@"Sample Rate: %d", codecContext->sample_rate);

NSLog(@"FMT: %d, %s", codecContext->sample_fmt, av_get_sample_fmt_name(codecContext->sample_fmt));

NSLog(@"Channels: %d", codecContext->channels);

NSLog(@"Channel Layout: %llu", codecContext->channel_layout);

NSLog(@"Decodec: %s", self->codec->long_name);

NSLog(@"=========================================================");

音频的这几个信息很重要,音频播放器初始化也需要用到这几个信息。

总结:

- 了解了ffmpeg的功能,它不仅可以单独使用现成的工具,还可以集成到App中使用其API

- 编译了ffmpeg并认识了编译产物

- 搭建了macOS+ffmpeg的开发环境

- 使用ffmpeg并打印了音视频流信息

更多内容请关注微信公众号<<程序猿搬砖>>

原文 ffmpeg开发播放器学习笔记 - Hello FFmpeg - 掘金

★文末名片可以免费领取音视频开发学习资料,内容包括(FFmpeg ,webRTC ,rtmp ,hls ,rtsp ,ffplay ,srs)以及音视频学习路线图等等。

见下方!↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓