通用的加载和保存方式

SparkSQL 提供了通用的保存数据和数据加载的方式。这里的通用指的是使用相同的 API,根据不同的参数读取和保存不同格式的数据,SparkSQL 默认读取和保存的文件格式 为 parquet

加载数据

spark.read.load 是加载数据的通用方法 ,如果读取不同格式的数据,可以对不同的数据格式进行设定

spark.read.format("…")[.option("…")].load("…")

- format("…"):指定加载的数据类型,包括"csv"、"jdbc"、"json"、"orc"、"parquet"和 "textFile"。

- load("…"):在"csv"、"jdbc"、"json"、"orc"、"parquet"和"textFile"格式下需要传入加载 数据的路径。

- option("…"):在"jdbc"格式下需要传入 JDBC 相应参数,url、user、password 和 dbtable

val df = spark.read.format("json").load("input/user.json")

其实,我们也可以直 接在文件上进行查询: 文件格式.`文件路径`

spark.sql("select * from json.`input/user.json`").show保存数据

df.write.save 是保存数据的通用方法,如果保存不同格式的数据,可以对不同的数据格式进行设定

- format("…"):指定保存的数据类型,包括"csv"、"jdbc"、"json"、"orc"、"parquet"和 "textFile"。

- save ("…"):在"csv"、"orc"、"parquet"和"textFile"格式下需要传入保存数据的路径。

- option("…"):在"jdbc"格式下需要传入 JDBC 相应参数,url、user、password 和 dbtable

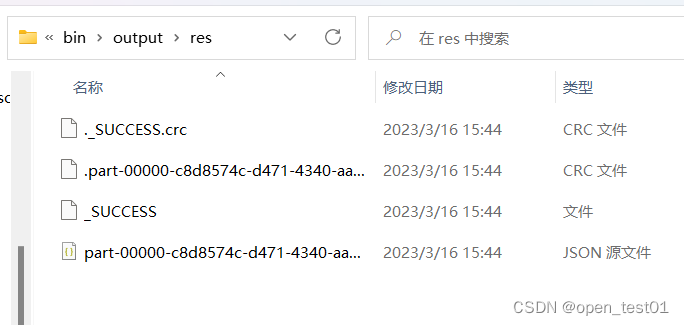

df.write.format("json").save("output/res")

保存操作可以使用 SaveMode, 用来指明如何处理数据,使用 mode()方法来设置。 有一点很重要: 这些 SaveMode 都是没有加锁的, 也不是原子操作。

SaveMode 是一个枚举类,其中的常量包括:

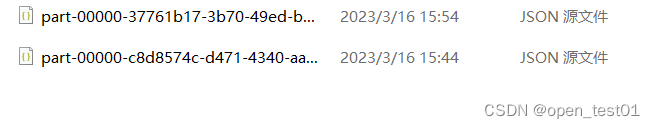

文件存在可再保存追加一个新的

df.write.mode("append").json("/opt/module/data/output")

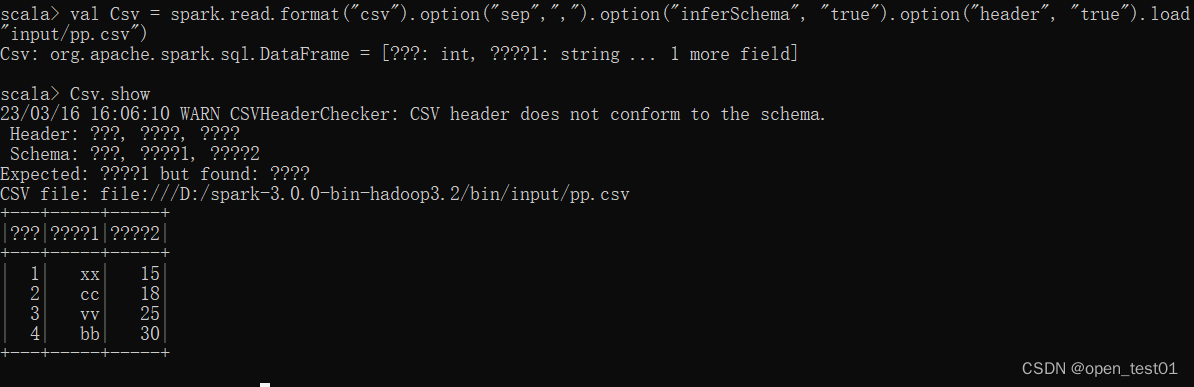

csv文件

Spark SQL 可以配置 CSV 文件的列表信息,读取 CSV 文件,CSV 文件的第一行设置为 数据列

spark.read.format("csv").option("sep", ";").option("inferSchema", "true").option("header", "true").load("data/user.csv")

操作MySQL

Spark SQL 可以通过 JDBC 从关系型数据库中读取数据的方式创建 DataFrame,通过对 DataFrame 一系列的计算后,还可以将数据再写回关系型数据库中。如果使用 spark-shell 操 作,可在启动 shell 时指定相关的数据库驱动路径或者将相关的数据库驱动放到 spark 的类 路径下。

在 Idea 中通过 JDBC 对 Mysql 进行操作

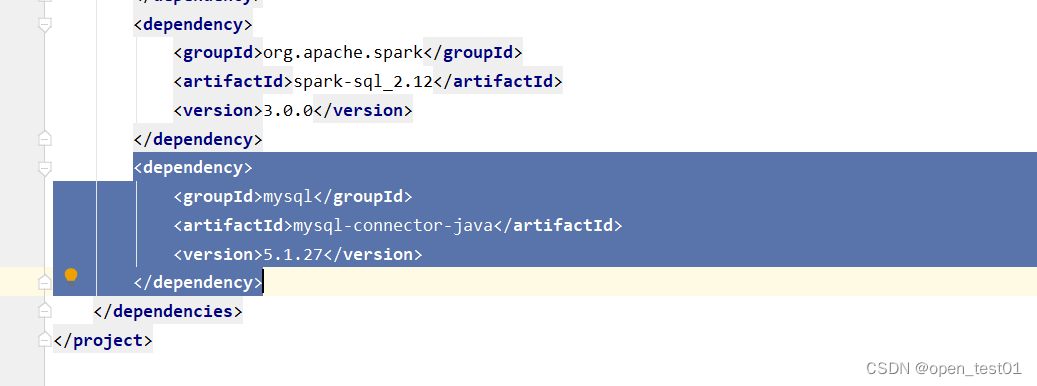

导入依赖

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>5.1.27</version>

</dependency>

读取数据和保存数据

准数据

def main(args: Array[String]): Unit = {

//创建sparksql的运行环境

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("sparkSQL")

//创建sparkSession对象

val spark = SparkSession.builder().config(sparkConf).getOrCreate()

import spark.implicits._

//读取mysql数据

val df = spark.read

.format("jdbc")

.option("url", "jdbc:mysql://master:3306/spark-sql")

.option("driver", "com.mysql.jdbc.Driver")

.option("user", "root")

.option("password", "p@ssw0rd")

.option("dbtable", "user")

.load()

df.show()

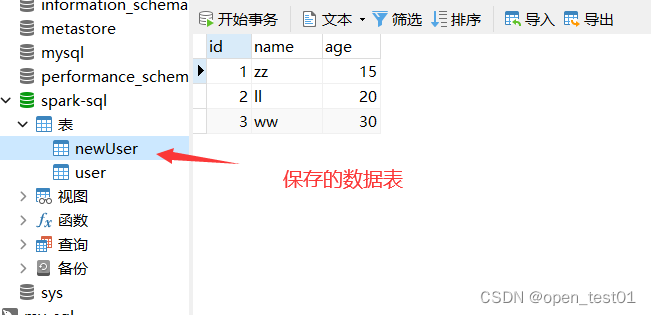

//保存数据

df.write

.format("jdbc")

.option("url", "jdbc:mysql://master:3306/spark-sql")

.option("driver", "com.mysql.jdbc.Driver")

.option("user", "root")

.option("password", "p@ssw0rd")

.option("dbtable", "newUser")

.mode(SaveMode.Append) //追加

.save()

spark.stop()

}

操作内置Hive

若要把 Spark SQL 连接到一个部署好的 Hive 上,你必须把 hive-site.xml 复制到 Spark 的配置文件目录中($SPARK_HOME/conf)。即使没有部署好 Hive,Spark SQL 也可以 运行。 需要注意的是,如果你没有部署好 Hive,Spark SQL 会在当前的工作目录中创建出 自己的 Hive 元数据仓库,叫作 metastore_db。此外,如果你尝试使用 HiveQL 中的 CREATE TABLE (并非 CREATE EXTERNAL TABLE)语句来创建表,这些表会被放在你默 认的文件系统中的 /user/hive/warehouse 目录中(如果你的 classpath 中有配好的 hdfs-site.xml,默认的文件系统就是 HDFS,否则就是本地文件系统)。 spark-shell 默认是 Hive 支持的;代码中是默认不支持的,需要手动指定(加一个参数即可)。

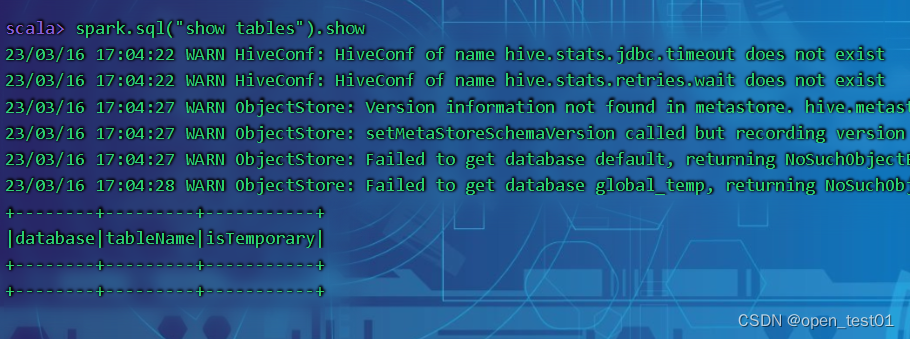

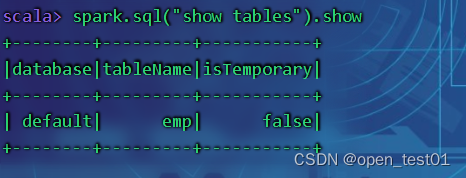

查看表

如果没有则会在spark目录中自动生成一个源数据库,使用 Spark 内嵌的 Hive, 则什么都不用做, 直接使用即可. Hive 的元数据存储在 derby 中, 默认仓库地址:$SPARK_HOME/spark-warehouse

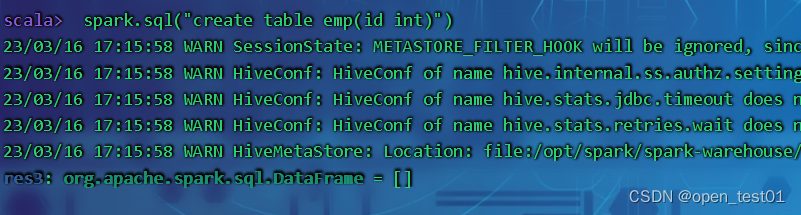

创建表

spark.sql("create table emp(id int)")

查看

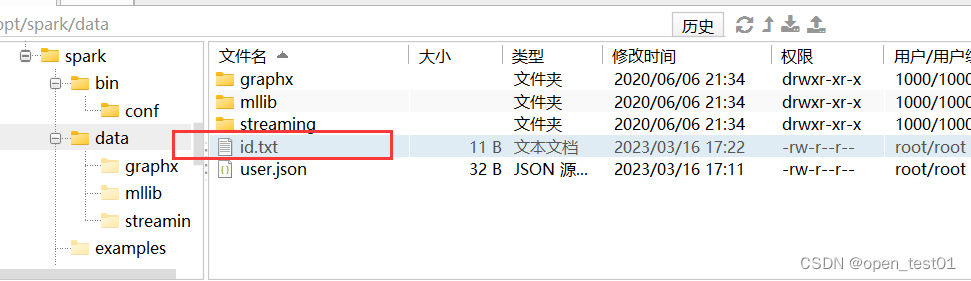

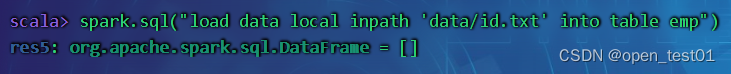

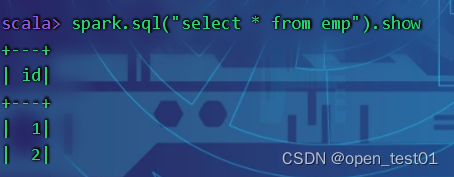

将文件数据加载到表中

spark.sql("load data local inpath 'data/id.txt' into table emp")

操作外置Hive

如果想连接外部已经部署好的 Hive,需要通过以下几个步骤:

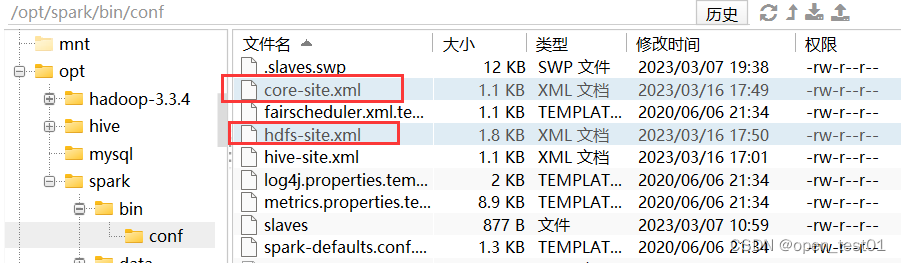

1、Spark 要接管 Hive 需要把 hive-site.xml 拷贝到 conf/目录下

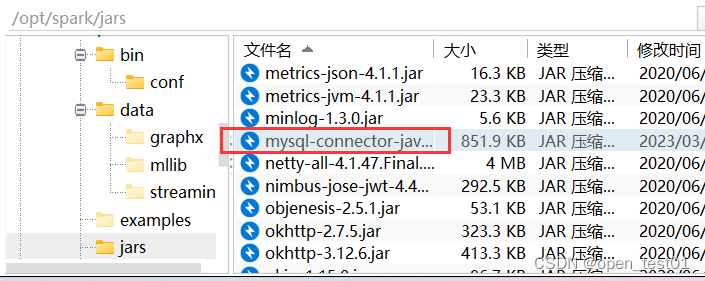

2、把 Mysql 的驱动 copy 到 jars/目录下

3、 如果访问不到 hdfs,则需要把 core-site.xml 和 hdfs-site.xml 拷贝到 conf/目录下

4、重启 spark-shell

scala> spark.sql("show tables").show

20/04/25 22:05:14 WARN ObjectStore: Failed to get database global_temp, returning

NoSuchObjectException

+--------+--------------------+-----------+

|database| tableName|isTemporary|

+--------+--------------------+-----------+

| default| emp| false|

| default|hive_hbase_emp_table| false|

| default| relevance_hbase_emp| false|

| default| staff_hive| false|

| default| ttt| false|

| default| user_visit_action| false|

+--------+--------------------+-----------+Spark SQL CLI

Spark SQL CLI 可以很方便的在本地运行 Hive 元数据服务以及从命令行执行查询任务。在 Spark 目录下执行如下命令启动 Spark SQL CLI,直接执行 SQL 语句,类似一 Hive 窗口

bin/spark-sql代码操作 Hive

导入依赖

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-hive_2.12</artifactId>

<version>3.0.0</version>

</dependency>

<dependency>

<groupId>org.apache.hive</groupId>

<artifactId>hive-exec</artifactId>

<version>1.2.1</version>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>5.1.27</version>

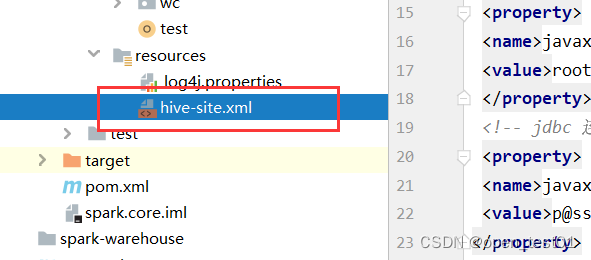

</dependency>将 hive-site.xml 文件拷贝到项目的 resources 目录中

后台启动hive

hiveserver2 &nohup hive --service metastore &在IEDA中连接使用

def main(args: Array[String]): Unit = {

//创建sparksql的运行环境

val sparkConf = new SparkConf().setMaster("local[*]").setAppName("sparkSQL")

//创建sparkSession对象

val spark = SparkSession.builder().config(sparkConf).enableHiveSupport().getOrCreate()

//使用sparkSQL连接外置hive

spark.sql("create database ee")

spark.sql("show databases").show()

spark.close()

}

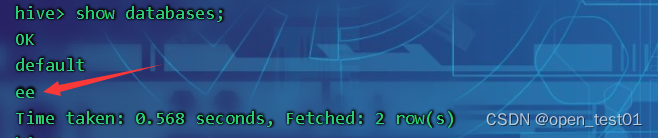

回到虚拟机中查看hive是否操作成功