本文介绍基于TensorBoard工具,对tensorflow库构建的神经网络模型加以可视化,并对其训练过程中的损失函数(Loss)、精度指标(Metric)等的变化情况加以可视化的方法。

在之前的两篇文章基于Python TensorFlow Estimator的深度学习回归与分类代码——DNNRegressor(https://blog.csdn.net/zhebushibiaoshifu/article/details/114001720)与基于Python TensorFlow Keras的深度学习回归代码——keras.Sequential深度神经网络(https://blog.csdn.net/zhebushibiaoshifu/article/details/114016531)中,我们介绍了利用Python中的tensorflow库,实现机器学习与深度学习的具体思路与代码实现;此外,我们也曾介绍过神经网络模型可视化的方法,例如基于Python的神经网络模型结构框架可视化绘图简便方法(https://blog.csdn.net/zhebushibiaoshifu/article/details/116212113)以及神经网络模型结构框架可视化的在线与软件绘图方法(https://blog.csdn.net/zhebushibiaoshifu/article/details/116723916)等。但是,一直没有介绍过基于tensorflow库中的TensorBoard工具,对神经网络模型,以及其训练过程中各项参数变化情况加以可视化的方法;这篇文章就对其加以具体介绍。

TensorBoard是TensorFlow提供的一个可视化工具,可以帮助用户更好地理解和调试TensorFlow模型。它提供了各种图表和面板,可以展示模型的训练过程、性能指标、网络结构、数据分布等信息。

首先,为了使用TensorBoard进行可视化,需要在代码中添加TensorBoard的回调函数。在模型训练时,每个epoch结束时将记录模型的性能和其他相关信息,并将它们写入TensorBoard日志目录中。以下是添加TensorBoard回调函数的示例代码。

from tensorflow.keras.callbacks import TensorBoard

# 创建TensorBoard回调函数并指定日志目录

tensorboard_callback = TensorBoard(log_dir = "E:/01_Reflectivity/03_Code")

# 在fit()函数中将TensorBoard回调函数添加到回调列表中

model.fit(train_data, train_targets, epochs=50, batch_size=64, validation_data=(test_data, test_targets), callbacks=[tensorboard_callback])

当然,很显然上述代码只是一个添加TensorBoard回调函数的示例代码,并不是tensorflow库实现神经网络模型的全部代码;如果大家需要全部的代码,可以参考基于Python TensorFlow Keras的深度学习回归代码——keras.Sequential深度神经网络(https://blog.csdn.net/zhebushibiaoshifu/article/details/114016531)这篇文章,这里就不再赘述了。

上述代码中,log_dir是大家存放日志的目录,大家可以自行修改。

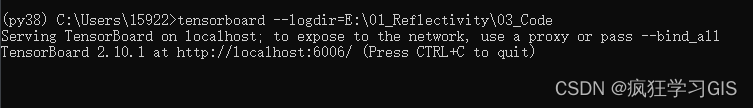

随后,启动TensorBoard服务器。在终端中输入以下命令来启动TensorBoard服务器。

tensorboard --logdir=E:\01_Reflectivity\03_Code

其中,最后的路径就是前面我们提到的存放日志的路径。随后,运行上述代码,如下图所示。

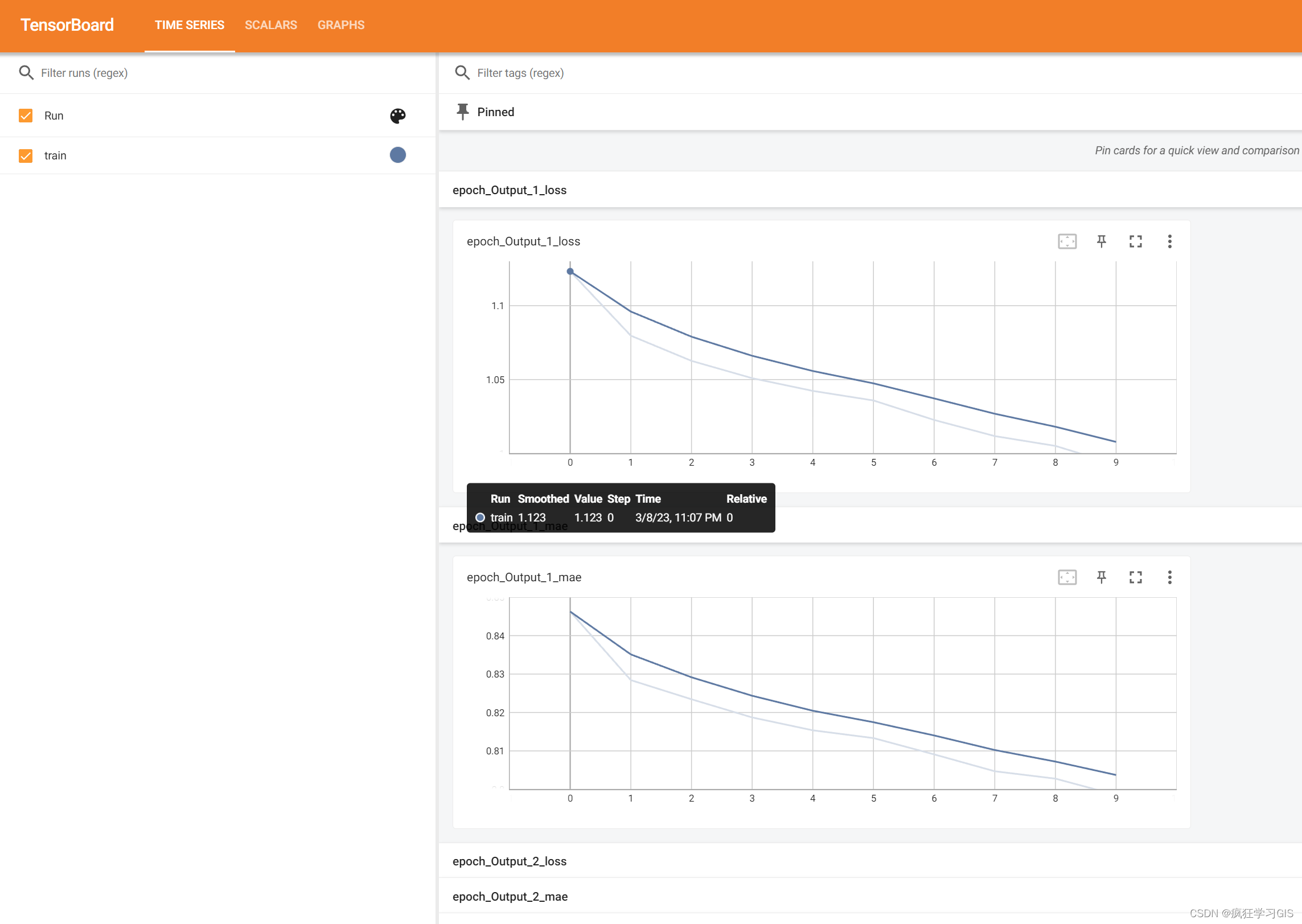

接下来,在浏览器中查看TensorBoard。在浏览器中访问http://localhost:6006/,就可以看到TensorBoard的主界面了。在界面上,你可以查看模型的架构、性能指标、激活直方图等信息。如下图所示。

TensorBoard中的主要面板包括以下几个:

Scalars:展示训练过程中的标量指标,比如训练误差、验证误差、学习率等。

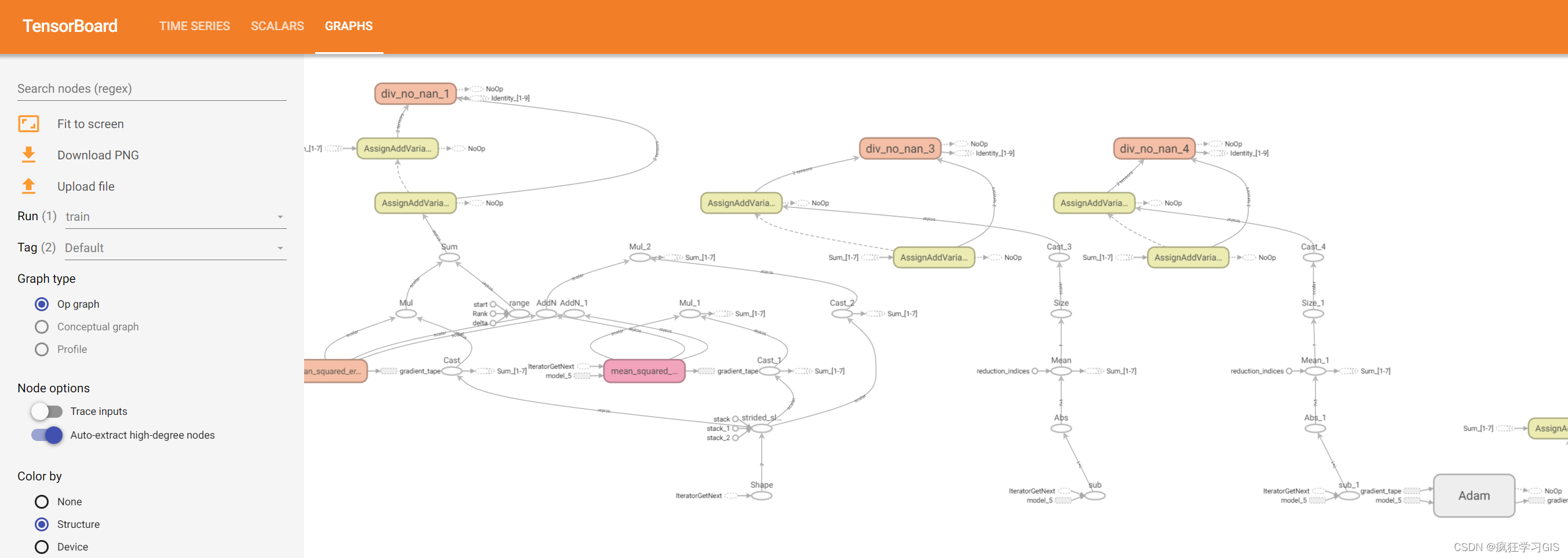

Graphs:展示计算图,可以看到每一层的输入输出,以及参数的维度和数值。

Distributions:展示数据分布情况,可以查看权重、梯度、激活值等的分布情况,有助于诊断过拟合或欠拟合等问题。

Histograms:展示数据分布的直方图,类似于Distributions,但更详细。

Images:展示图像数据,可以查看输入图片、卷积层的输出等。

Projector:展示高维数据的嵌入情况,可以对数据进行降维可视化。

Text:展示文本数据,可以查看文本分类、生成等任务的结果。

总之,TensorBoard提供了丰富的可视化功能,可以帮助用户更好地理解和优化模型。

其中,我们往往对Scalars与Graphs面板比较感兴趣,我们也就在此主要谈谈这两个部分。

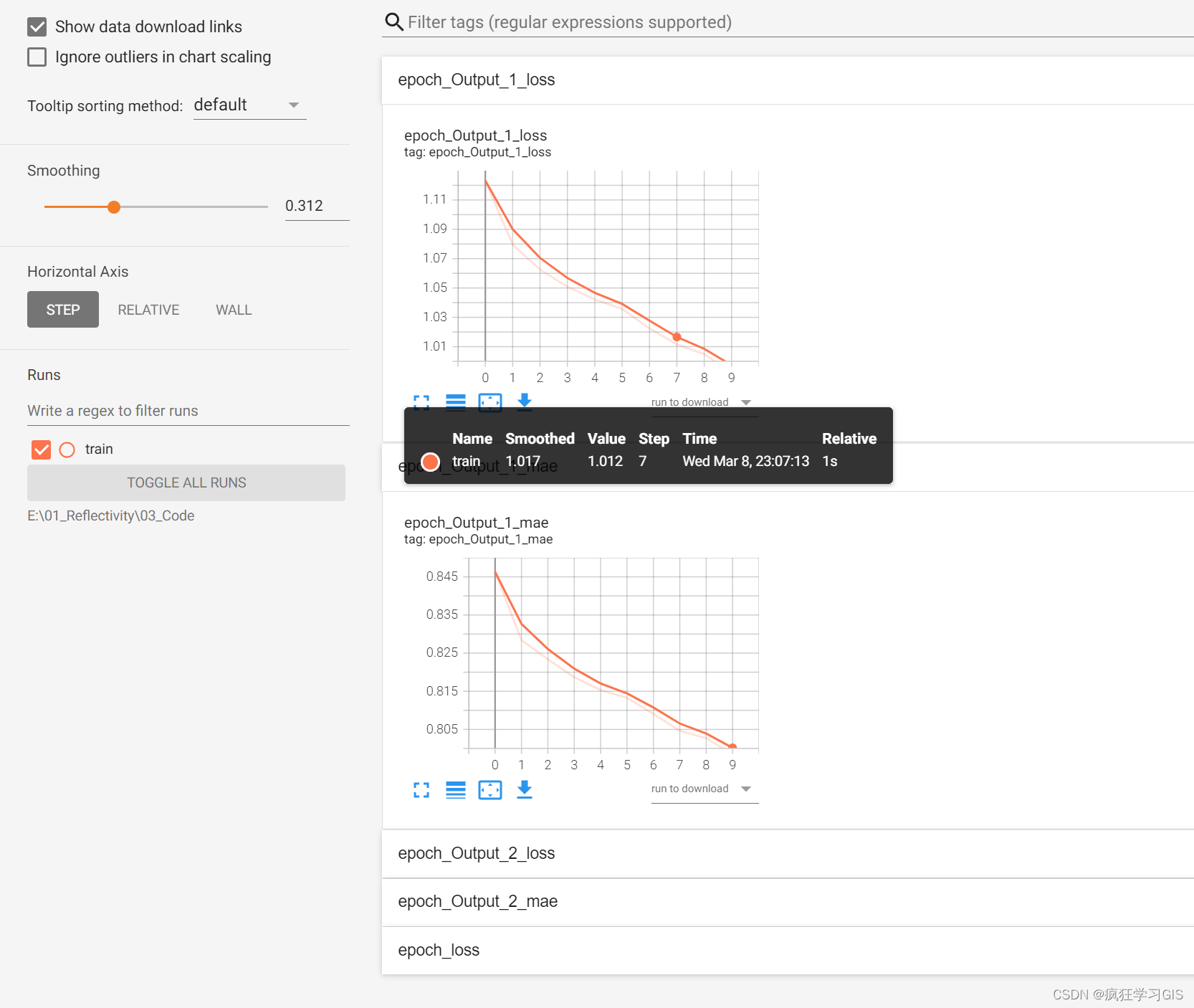

当我们训练模型时,可能会想要实时监控模型的训练情况,比如损失函数的变化、准确率的变化等。TensorBoard提供了Scalars界面,可以方便地对这些指标进行可视化;如下图所示。

在代码中,我们可以使用tf.summary.scalar函数将指标写入TensorBoard日志文件中。

其次,介绍一下Graphs界面。在TensorFlow中,Graphs(图)是表示神经网络的计算图,包括各个层之间的连接、每个层的参数以及激活函数等等。Graphs界面可以用于可视化TensorFlow计算图的结构,从而更好地理解神经网络的计算过程。如下图所示。

在Graphs界面中,可以看到神经网络中每一层的名称和形状,以及层与层之间的连接。通过单击每个层,可以查看该层的详细信息,包括该层的参数、激活函数等等。此外,Graphs界面还可以显示每个变量和操作的名称,以及它们在计算图中的位置。

通过Graphs界面,可以更好地理解神经网络的计算过程,发现神经网络中可能存在的问题,并对神经网络的结构进行优化。同时,Graphs界面还可以与TensorBoard的其他界面(如Scalars、Histograms等)进行配合使用,进一步提升神经网络的可视化效果和调试能力。

此外,TensorBoard还具有非常巨大的功能,大家具体可以查阅其官方帮助文档。

欢迎关注:疯狂学习GIS