1.权重初始化的重要性

- 神经网络的训练过程中的参数学习时基于梯度下降算法进行优化的。梯度下降法需要在开始训练时给每个参数赋予一个初始值。这个初始值的选取十分重要。在神经网络的训练中如果将权重全部初始化为0,则第一遍前向传播过程中,所有隐藏层神经元的激活函数值都相同,导致深层神经元可有可无,这一现象称为对称权重现象。

- 为了打破这个平衡,比较好的方法是对每层的权重都进行随机初始化,这样使得不同层的神经元之间有很好的区分性。但是,随机初始化参数的一个问题是如何选择随机初始化的区间。如果权重初始化太小,会导致神经元的输入过小,随着层数的不断增加,会出现信号消失的问题;也会导致sigmoid激活函数丢失非线性的能力,因为在0附件sigmoid函数近似是线性的。如果参数初始化太大,会导致输入状态太大。对sigmoid激活函数来说,激活函数的值会变得饱和,从而出现梯度消失的问题。

2.常用的参数初始化方法

2.1 高斯分布初始化

参数从一个固定均值(比如0)和固定方差(比如0.01)的高斯分布进行随机初始化。

2.2 均匀分布初始化

在一个给定的区间[-r,r]内采用均匀分布来初始化参数。超参数r的设置可以按照神经元的连接数量进行自适应的调整。

- 初始化一个深层神经网络时,一个比较好的初始化策略是保持每个神经元输入和输出的方差一致。

2.3 Xavier初始化

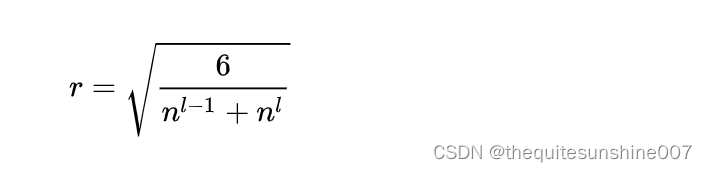

- 当网络使用logistic激活函数时,xavier初始化可以根据每层的神经元数量来自动计算初始化参数的方差。假设第l层神经元的激活函数是logistic函数,对第l-1层到第l层的权重区间r可以设置为:

- 上式中是第l层神经元个数,是第l-1层神经元个数。

- 对于tanh函数,r可以设置为:

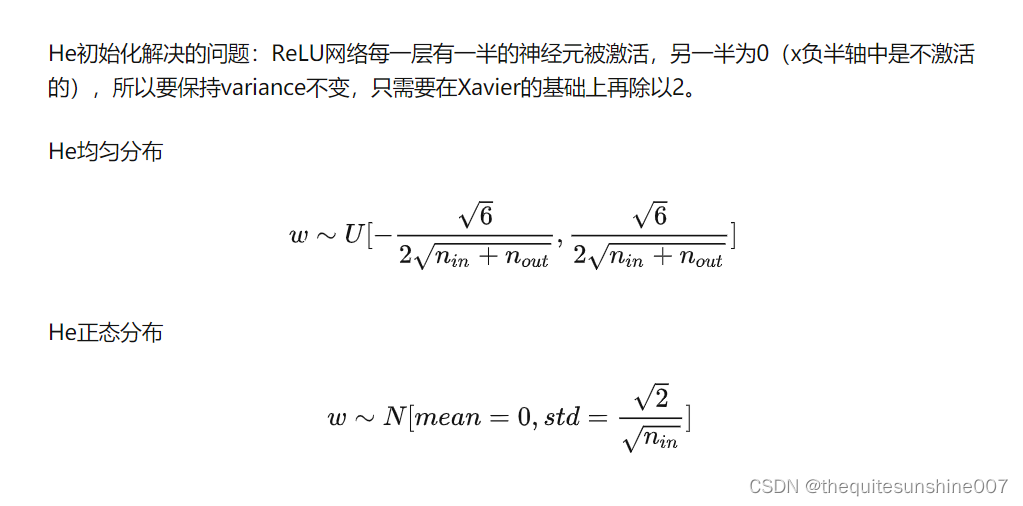

2.4 He初始化

与2.3方法类似.

3 神经网络权重为什么不能初始化为0

参见: