摘要

二维卷积神经网络忽略了医学图像的三维信息,而三维卷积神经网络对计算资源的需求过大。而本文提出一种新的结构,称为维度融合网络(D-UNet)这个网络在编码阶段创新的结合了二维和三维卷积。所提出的网络结构实现了比2D网络更好的分割性能,同时与3D网络需要更少的计算开销和计算时间。此外,为了缓解网络训练正样本和负样本之间的不平衡问题。本文提出了一种新的损失函数,称为增强混合损失函数,这个损失函数增加了一个加权焦点系数,并结合了两个传统的损失函数

Introduction

形状差异大,边界不清是目前对于脑卒中病变分割乃至整个医学图像分割领域中存在的一个问题。

在D-Net网络中MRI数据中的三维空间信息在二维框架中得到了有效的利用。

维度融合网络:首先,为了从MRI数据中提取连续切片的信息,我们设计了一种基于UNet改进的新型下采样块。这种改进在网络的早期阶段对少量连续切片进行3D和2D特征提取。然后,以一种新颖的方式融合它们各自的特征映射,以实现二维网络中的少量参数。通过提取MRI数据中的3D特征,D-UNet可以获得比纯2D网络更好的性能。

增强混合损失:增强混合损失(Enhanced mixed Loss):其次,为了提高网络的收敛速度,我们提出了一种新的损失函数,称为增强混合损失(Enhanced mixed Loss),它不仅增强了传统Dice Loss的梯度传播,而且结合了Dice Loss和Focal Loss函数的优点。

方法

DUNet用于提取三维信息

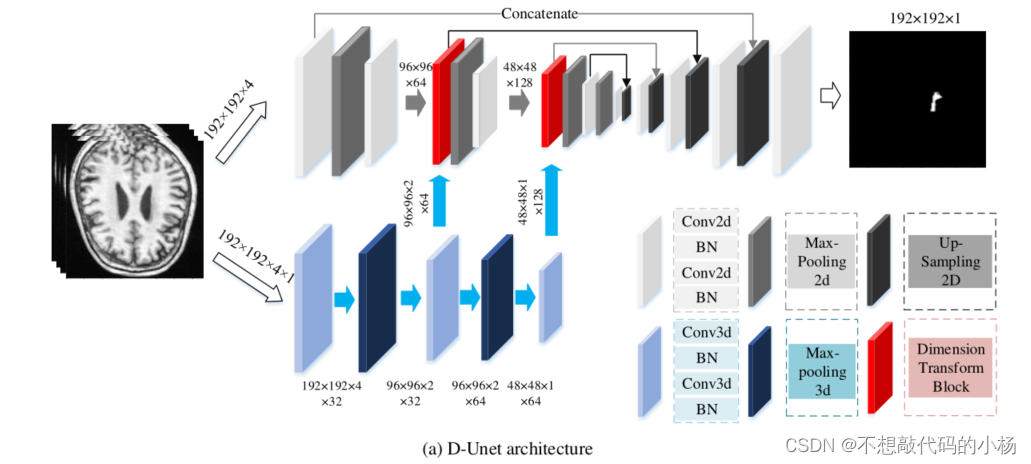

网络的结构由改进的UNet组成。这种对称的编码器-解码器结构结合了高级语义和低级细节信息,这种结构取得了不错的效果。DUNet的编码阶段由两个维度组成,其结构如下图所示:

如上图所示二维卷积和三维卷积在各自的维度上都进行了下采样操作,其结果通过红色立方体的维度变换块进行组合。这种融合方法通过使得后续的二维网络能够被集成到三维信息当中,从而细化目标区域的边界提高网络识别小病变区域的能力。同时,由于网络早期提取的三维信息较好,并且随着网络的深入,网络的可训练参数极大增加,因此仅在编码早期添加维数变换块。

具体的过程如下图所示:

在图中H×W表示高度和宽度的特征维度,D表示体积特征中的深度,C表示特征图的通道。维数变换块由三维降维、SE模块和维数融合组成。为了提高三维特征和二维特征的融合效果。将这个SE模块应用到融合块中。

在上图中的每个维度变换块当中,我们首先将三维分支的特征图进行维度的降维,然后分别与SE加权后的二维分支进行相加,其中I3d和I2d分别表示来自3D和2D网络的特征图,分别作为这个维度变换块的输入。其中n表示批大小,h*w*d表示的是特征图的高度宽度和深度

具体来说我们首先使用3D 1x1x1的卷积将维度从转换成

。然后使用Squeeze压缩将维度从

压缩到n*h*w*d。为了使三维数据的通道数与2D分支保持一致,使用一个2D的3x3卷积将特征图的维度从n*h*w*d压缩到

.设

表示进行降维以后的3D特征图。用公式表示为

![]()

式子中的fr表示的是降维操作,我们将三维特征图从转化为

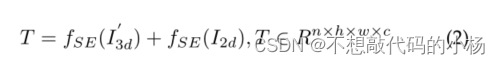

。此外,为了增强融合前融合前二维特征的表达能力,本文使用了一个SE块对三维和二维特征映射通道进行加权,并将其在通道维度进行加权输出相加。用公式表示如下

在这一步中融合了3D和2D的特征,T为特征图融合后的结果。

增强混合损失函数

在训练过程中可能会有大量的背景区域来主导损失函数,导致学习过程容易陷入局部最优解。因此本文提出了一种新的损失函数来解决类不平衡的问题,将两个传统的损失函数组合起来。

Focal Loss

focal loss是对交叉熵损失的一个改进,增加了一个调和因子,它减缓了简单样本对于训练的贡献度。其公式如下:

Dice Loss

Dice Loss通过修改预测样本与真实标签之间的分割评价指标DSC来缓解背景和前景之间像素不平衡的问题。这个损失的公式如下图所示:

提出的增强混合损失

首先在DiceLoss中使用log值,本文将其反转以保持值为正,从而增强每次迭代得到梯度。并且将DiceLoss和Focal二者有机的结合起来。得到的最终的损失函数如下

![]()

结论

本文提出了一种能够有效利用三维上下文信息,对算力要求低的端到端的自动分割方法,同时提出了一种新的损失函数,使得收敛速度更快,更平滑!