深度学习8.池化的概念

一、一些基本概念

1. 什么是池化

池化 (Pooling) 用来降低卷积神经网络(CNN)或循环神经网络(RNN)中的特征图(Feature Map)的维度。在卷积神经网络中,池化操作通常紧跟在卷积操作之后,用于降低特征图的空间大小。

池化操作的基本思想是将特征图划分为若干个子区域(一般为矩形),并对每个子区域进行统计汇总。池化操作的方式可以有很多种,比如最大池化(Max Pooling)、平均池化(Average Pooling)等。其中,最大池化操作会选取每个子区域内的最大值作为输出,而平均池化操作则会计算每个子区域内的平均值作为输出。

2. 池化的作用

通过池化操作,可以:

- 降低特征图的维度,减少网络中参数的数量,避免过拟合现象的发生,

- 提高模型的计算速度和运行效率。

3. 池化核大小

池化窗口的大小,在PyTorch里池化核大小可以是一个整数或者一个元组,例如 kernel_size=2 或者 kernel_size=(2, 3)。

- 如果是一个整数,则表示高和宽方向上的池化窗口大小相同;

- 如果是一个元组,则第一个元素表示高方向上的池化窗口大小,第二个元素表示宽方向上的池化窗口大小。

4. 步幅大小

用于指定池化窗口在高和宽方向上的步幅大小,可以是一个整数或者一个元组,例如 stride=2 或者 stride=(2, 3)。

- 如果是一个整数,则表示高和宽方向上的步幅大小相同;

- 如果是一个元组,则第一个元素表示高方向上的步幅大小,第二个元素表示宽方向上的步幅大小。

5. 填充

池化层的填充(padding)可以控制池化操作在特征图边缘的行为,使得池化后的输出特征图与输入特征图大小相同或相近。

在池化操作时,如果输入特征图的尺寸不能被池化窗口的大小整除,那么最后一列或者最后一行的部分像素就无法被包含在池化窗口中进行池化,因此池化后的输出特征图尺寸会减小。

通过在输入特征图的边缘添加填充,可以使得池化操作在边缘像素处进行池化,避免了信息的丢失,并且保持了输出特征图的大小与输入特征图相同或相近。同时,填充也可以增加模型的稳定性,减少过拟合的风险。

需要注意的是,池化层的填充和卷积层的填充有所不同:

- 池化层的填充通常是指在输入特征图的边缘添加0值像素;

- 卷积层的填充是指在输入特征图的边缘添加0值像素或者复制边缘像素。

PyTorch里的填充大小可以是一个整数或者一个元组,例如 padding=1 或者 padding=(1, 2)。

- 如果是一个整数,则表示在高和宽方向上的填充大小相同;

- 如果是一个元组,则第一个元素表示高方向上的填充大小,第二个元素表示宽方向上的填充大小。默认为 0,表示不进行填充。

二、最大池化

1. 最大池化运算示例

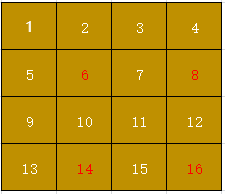

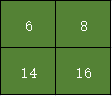

假设我们有一个 4 × 4 4\times 4 4×4 的原始数据矩阵:

现在要对其进行最大池化操作,则结果为:

其中6、8、14、16是原始矩阵中分子区域后每个子区域的最大值。类似的,平均池化就是每个子区域求平均值。

2. Python实现最大池化算法

import numpy as np

def max_pooling(data, pool_size):

"""

Max pooling operation.

Args:

data: Original data matrix, shape (H, W).

pool_size: Pooling kernel size, int or tuple of two ints.

Returns:

Pooled data matrix, shape (H', W').

"""

# 判断池化核大小是否为整数,如果不是,则假设其为一个形如 (ph, pw) 的元组

if isinstance(pool_size, int):

pool_size = (pool_size, pool_size)

h, w = data.shape

ph, pw = pool_size

oh = h // ph

ow = w // pw

# 计算池化后的矩阵大小,初始化一个全零矩阵 pooled

pooled = np.zeros((oh, ow))

# 遍历每个池化子区域,并对每个子区域取最大值,存入 pooled 矩阵中

for i in range(oh):

for j in range(ow):

rstart, cstart = i * ph, j * pw

rend, cend = rstart + ph, cstart + pw

patch = data[rstart:rend, cstart:cend]

pooled[i, j] = np.max(patch)

return pooled

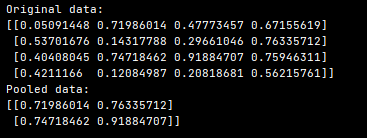

# 生成一个 4x4 的随机数据矩阵

data = np.random.rand(4, 4)

print("Original data:")

print(data)

# 对数据进行 2x2 的最大池化操作

pooled = max_pooling(data, 2)

print("Pooled data:")

print(pooled)

运行示例:

三、PyTorch中的池化函数

PyTorch中有多个池化函数,最常用的是: torch.nn.MaxPool2d,用于最大池化操作:

1. MaxPool2d参数

- kernel_size:池化核大小;

- stride:步幅大小;

- padding:填充大小;

- dilation:膨胀系数,用于指定池化核中各个元素之间的跨度,可以是一个整数或者一个元组,例如 dilation=2 或者 dilation=(2, 3)。如果是一个整数,则表示高和宽方向上的膨胀系数相同;如果是一个元组,则第一个元素表示高方向上的膨胀系数,第二个元素表示宽方向上的膨胀系数。默认为 1,表示不进行膨胀操作。

- ceil_mode:是否使用 ceil 模式计算输出大小,如果设置为 True,则使用 ceil 模式计算输出大小;如果设置为 False,则使用 floor 模式计算输出大小。默认为 False。

- return_indices:是否返回最大值的索引,如果设置为 True,则在输出张量中同时返回最大值的索引;如果设置为 False,则只返回最大值。默认为 False。

- return_inverse:是否返回逆序操作,如果设置为 True,则在输出张量中同时返回逆序操作所需的索引;如果设置为 False,则不返回逆序操作所需的索引。默认为 False。

2. 简单调用示例

import torch

# 定义输入数据张量,大小为 (batch_size, channels, height, width)

input_tensor = torch.randn(2, 3, 16, 16)

# 定义最大池化层,kernel_size 为池化核大小,stride 为步幅

max_pool = torch.nn.MaxPool2d(kernel_size=2, stride=2)

# 对输入数据进行最大池化操作

output_tensor = max_pool(input_tensor)

# 输出池化后的结果张量大小

print(output_tensor.shape)

这个示例输入大小为 (2,3,16,16)的张量, 然后定义了一个最大池化层,池化操作以后,

最后输出的张量大小是: torch.Size([2, 3, 8, 8])

3. 对一个图片进行池化操作

下面代码使用前一节的卷积后的图片作为池化输入,代码示例:

import torch

from PIL import Image

from torchvision.transforms import ToTensor

from torchvision.transforms.functional import to_pil_image

# 读入示例图片并将其转换为 PyTorch 张量

img = Image.open('output.jpg')

img_tensor = ToTensor()(img)

# 定义 MaxPool2d 函数,进行池化操作

max_pool = torch.nn.MaxPool2d(kernel_size=2, stride=2)

img_pool = max_pool(img_tensor.unsqueeze(0)).squeeze(0)

# 将池化后的张量转换为 PIL 图像并保存

img_pool_pil = to_pil_image(img_pool)

img_pool_pil.save('example_pool.jpg')

读入示例图片:

最大池化后的结果:

池化后图形减少了很多。

4. 其它池化函数

1. AvgPool2d 平均池化函数

取池化窗口的平均值。

2. AdaptiveMaxPool2d

自适应最大池化函数,该函数可以根据输入的大小自动调整池化窗口的大小,输出指定大小的张量。

3. AdaptiveAvgPool2d

自适应平均池化函数。