PyCharm安装scrapy框架

一、系统环境说明:

操作系统:windows10 64位专业版;

python版本:python 3.5。

二、安装准备:

1、安装pip工具

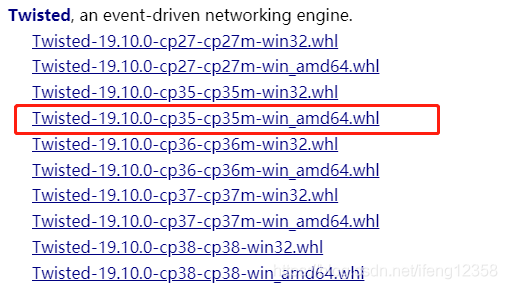

2、下载并安装Twisted(我的python版本是3.5的,所以对应的Twisted也要3.5的。根据个人的python版本号下载)。

下载地址:点击下载Twisted

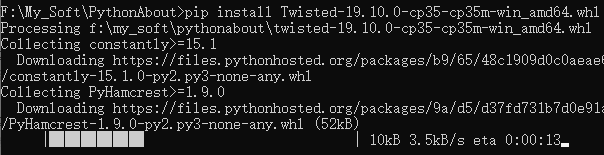

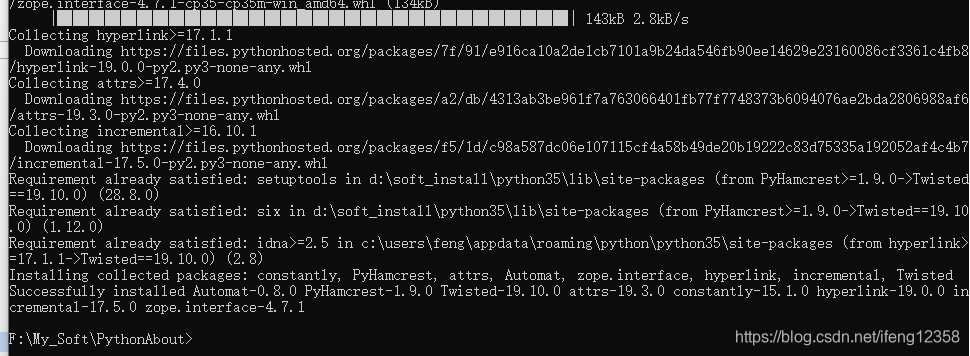

3、安装Twisted

使用pip命令安装下载的Twisted。

pip install Twisted-19.10.0-cp35-cp35m-win_amd64.whl

安装成功后,会有提示:

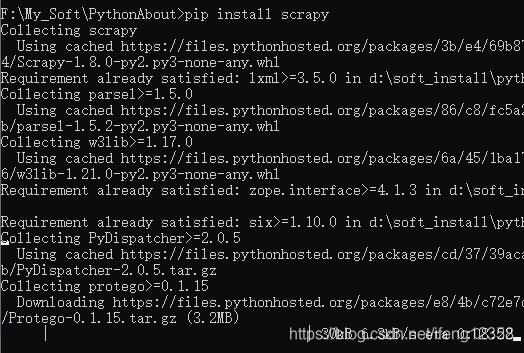

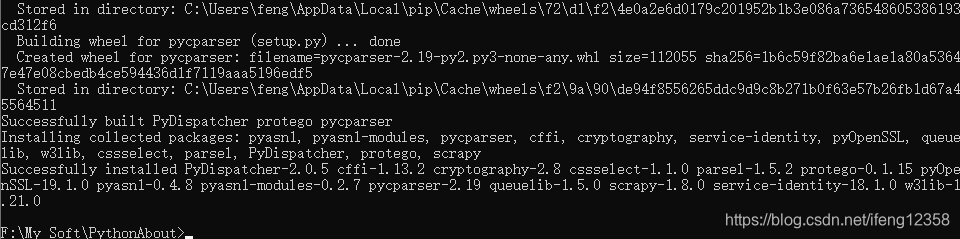

3、安装scrapy:

使用pip命令安装:

pip install scrapy

如果使用上面的安装比较慢,可以使用国内的豆瓣源:

pip install -i https://pypi.douban.com/simple scrapy4、安装完成后,在命令行下输入:scrapy可以查看是否安装成功。

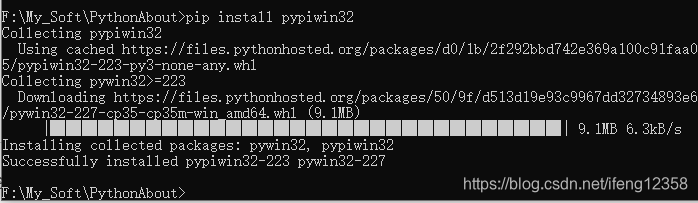

5、安装scrapy成功后,启动项目时,可能会报错“没有win32模块”,需要安装pypiwin32模块。

pip install pypiwin32

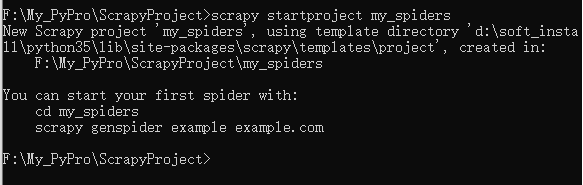

6、我们在F:\My_PyPro路径下,创建一个ScrapyProject用作项目路径。

使用 scrapy startproject 命令创建一个项目:

scrapy startproject my_spiders

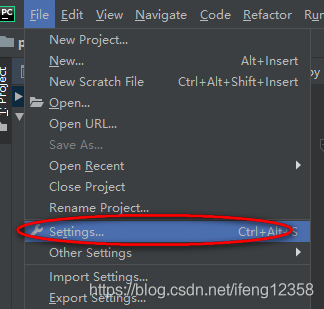

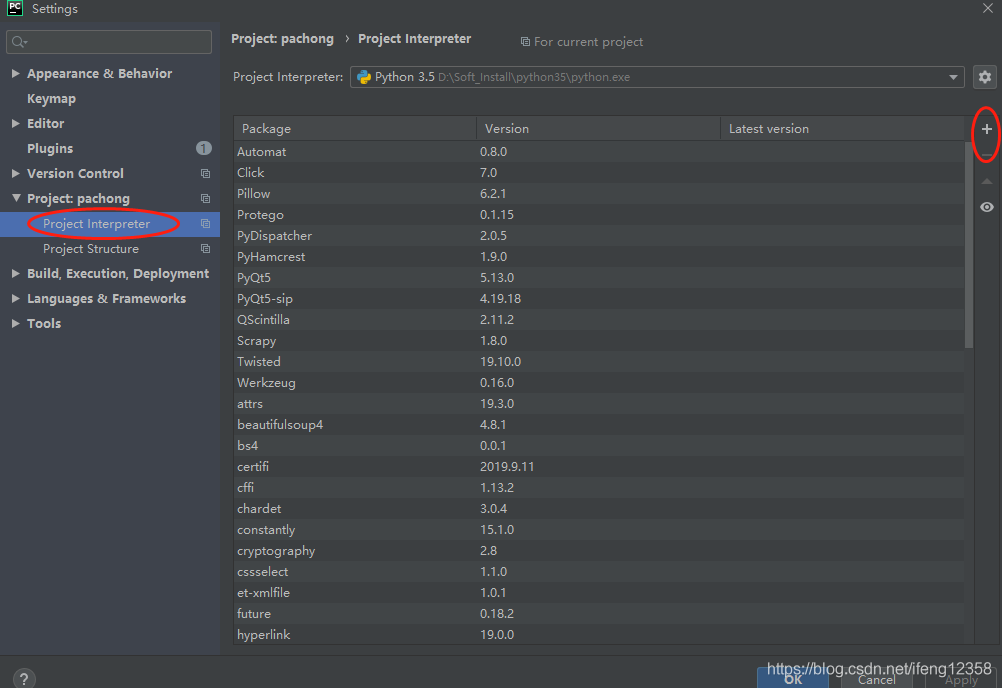

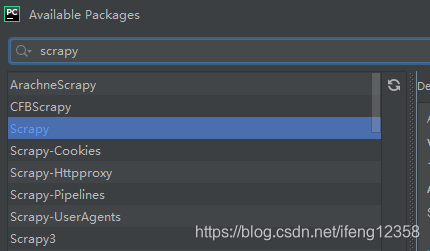

7、配置PyCharm:

点击安装scrapy:

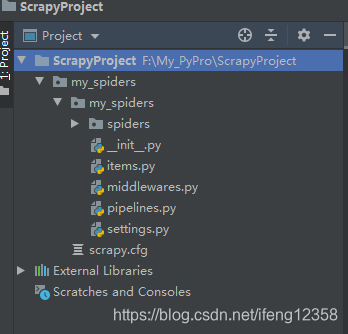

8、配置好之后,我们打开刚才创建的my_spiders项目,如下图所示:

scrapy.cfg: 项目的配置文件。

my_spiders/: 该项目的python模块,之后将在此加入代码。

my_spiders/items.py: 项目中的item文件,主要是创建爬虫存储的字段。

my_spiders/middlewares.py是中间件,主要是编写下载中间件、Cookies中间件等。

my_spiders/pipelines.py: 项目中的pipelines文件,用来爬虫后数据的处理(如存储到CSV、存储到数据库等)。

my_spiders/settings.py: 项目的设置文件。

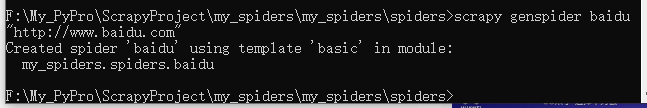

my_spiders/spiders/: 放置spider代码的目录。9、使用命令创建一个测试脚本:

scrapy genspider baidu "http://www.baidu.com"

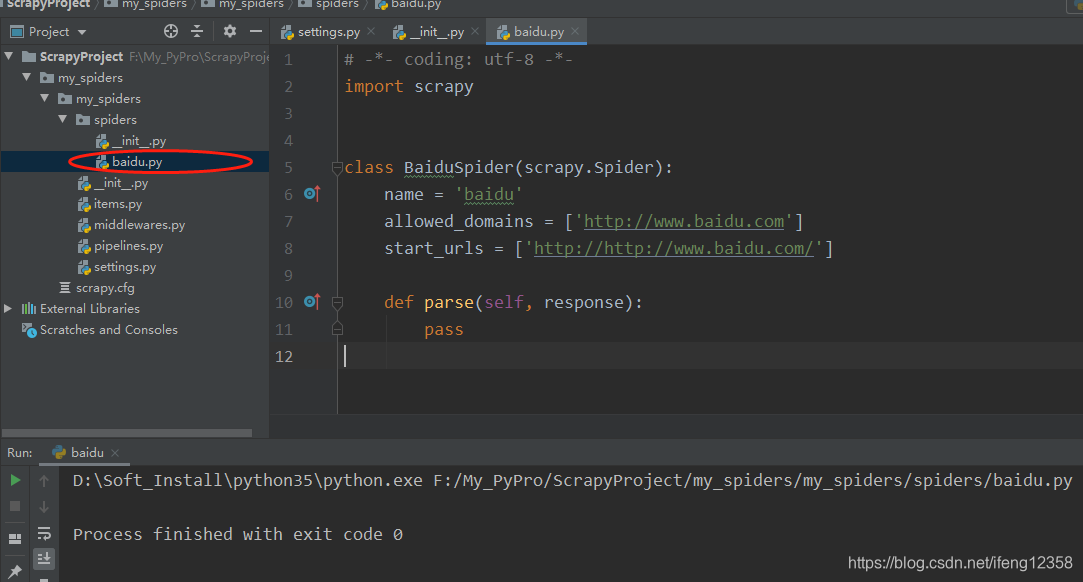

可以在PyCharm中看到我们创建的脚本文件:

10、运行脚本:

scrapy crawl baidu

本文原创作者:冯一川([email protected]),未经作者授权同意,请勿转载。如需获取本程序源代码和资源,欢迎发邮件与我联系。