文章目录

1 矩阵的迹

矩阵的迹:对于n阶方阵A,A的迹(trace)是主对角线上的元素之和,即tr(A)=Σi∈[1,n]aii。迹的性质:

(1)tr(AT)=tr(A);

(2)tr(A+B)=tr(A)+tr(B);

(3)tr(AB)=tr(BA);

(4)tr(ABC)=tr(BCA)=tr(CAB)。

2 行列式的性质

行列式的性质:设A、B是n阶方阵,c为常数,行列式的性质如下:

(1)|c·A|=cn|A|;

(2)|AT|=|A|;

(3)|A·B|=|A|·|B|;

(4)若A是可逆矩阵,则|A-1|=1/|A|;

(5)|An|=|A|n。

3 向量相对于标量的导数与标量相对于向量的导数

向量相对于标量的导数与标量相对于向量的导数:向量α相对于标量x的导数、标量x相对于向量α的导数都是向量,其第i个分量分别为:

(1)(∂α/∂x)i=∂αi/∂x;

(2)(∂x/∂α)i=∂x/∂αi。

4 矩阵相对于标量的导数与标量相对于矩阵的导数

矩阵相对于标量的导数与标量相对于矩阵的导数:矩阵A对于标量x的导数、标量x对于矩阵A的导数都是矩阵,其第i行第j列上的元素分别为:

(1)(∂A/∂x)ij=∂Aij/∂x;

(2)(∂x/∂A)ij=∂x/∂Aij。

5 函数f(x)对向量x的导数

函数f(x)对向量x的导数:假定函数f(x)对向量x的元素可导,则:

(1)f(x)关于向量x的一阶导数是一个向量,其第i个分量为:(▽f(x))i=∂f(x)/∂xi;

(2)f(x)关于向量x的二阶导数是称为海森矩阵的一个方阵,其第i行第j列上的元素为:(▽2f(x))ij=∂2f(x)/∂xi∂xj。

6 向量和矩阵的导数满足乘法法则

向量和矩阵的导数满足乘法法则:

(1)∂xTα/∂x=∂αTx/∂x=α;

(2)∂AB/∂x=(∂A/∂x)·B+A·(∂B/∂x)。

7 逆矩阵的导数

逆矩阵的导数:∂A-1/∂x=-A-1·∂A/∂x·A-1。

8 关于矩阵的迹的求导公式

关于矩阵的迹的求导公式:

(1)∂tr(AB)/∂Aij=Bji;

(2)∂tr(AB)/∂A=BT;

(3)∂tr(ATB)/∂A=B;

(4)∂tr(A)/∂A=Ⅰ,其中Ⅰ是单位阵;

(5)∂tr(ABAT)/∂A=A·(B+BT);

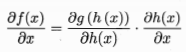

9 求导链式法则

求导链式法则:链式法则是计算复杂导数时的重要工具,若f(x)=g(h(x)),则有:

10 矩阵最常用求导公式

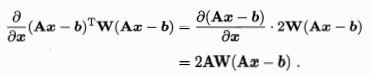

矩阵最常用求导公式:

(1)∂xTAx/∂x=(A+AT)x;

(2)上面的公式应该是下面的特例,这样看的话下面的公式好像不对…只有当W是对称矩阵,即WT=W时,下式才是正确的:

END