随着汽车智能化、电子化的推进,自动驾驶已经成为未来汽车发展的主流趋势之一。

围绕自动驾驶关键技术体系研究,实现公开道路实地测试以及商业化应用是当下行业关注的重点。

简单来说,实现自动驾驶需要解决三个核心问题:“我在哪?我要去哪?我该如何去?”能完整解决这三个问题就是真正的自动驾驶。

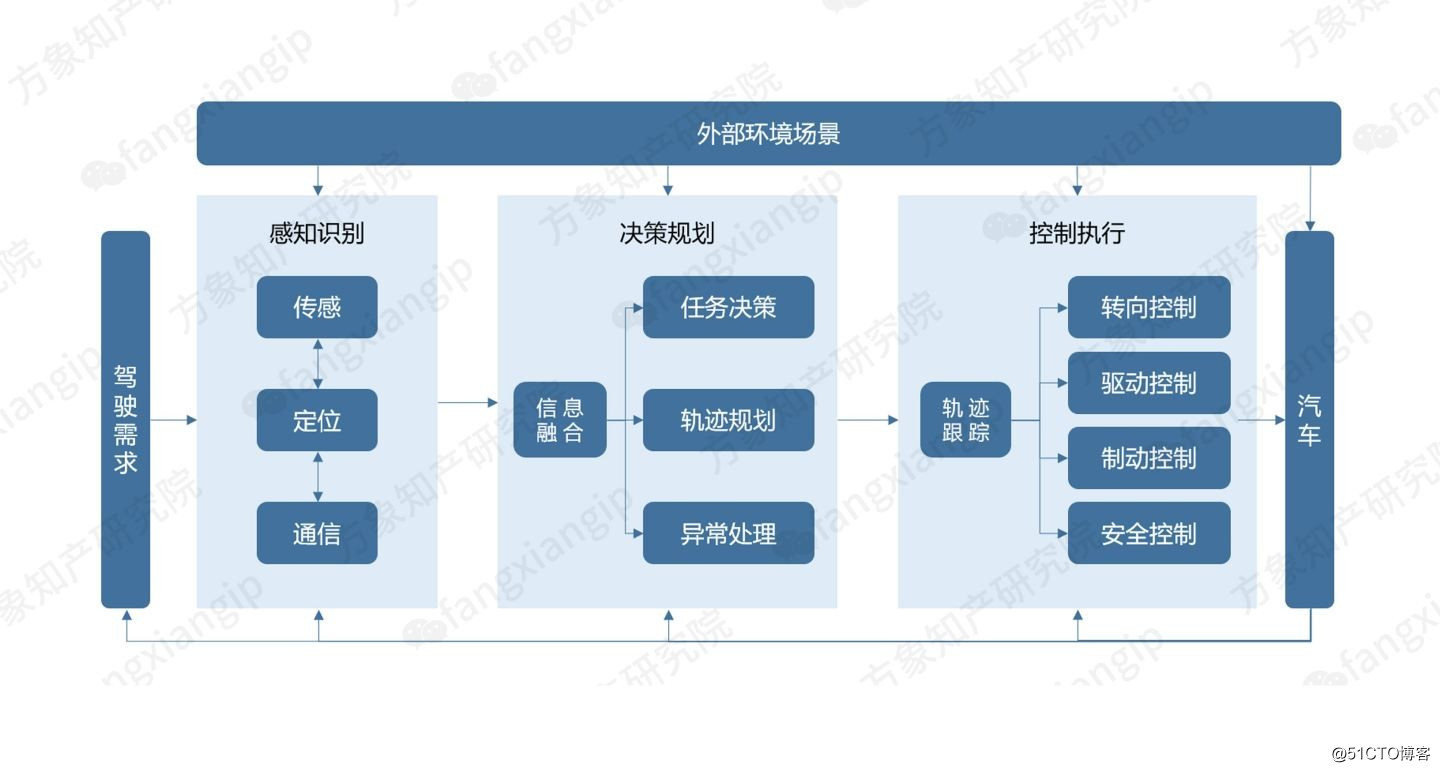

目前,自动驾驶汽车关键技术主要包括环境感知、精准定位、决策与规划、控制与执行、高精地图与车联网V2X以及自动驾驶汽车测试与验证技术等。

在这套技术体系以及关键软硬件设备的支持下,自动驾驶汽车可通过车载摄像机、激光雷达、毫米波雷达、超声波等传感器来感知周围环境,实时动态监测周边环境变化,并依据所获取的信息进行决策判断,形成安全合理的路径规划。在规划好路径之后,汽车执行系统会控制车辆沿着规划好的路径完成驾驶。

这套自动驾驶核心技术体系可简单概括为“感知、决策与执行”。

感知、决策与执行(图片来源:方象知产研究院)

感知系统也被称为“中层控制系统”,负责感知周围的环境,并进行环境信息与车内信息的采集与处理,主要涉及道路边界监测、车辆检测、行人检测等技术。

决策系统也被称为“上层控制系统”,负责路径规划和导航,通过执行相应控制策略,代替人类做出驾驶决策。

执行系统也被称为“底层控制系统”,负责汽车的加速、刹车和转向,主要由电子制动、电子驱动以及电子转向三部分构成。

通过“感知、决策与执行”三个系统的分工协作,责任明确地控制汽车运行,可以令自动驾驶汽车具备理论上“自动行驶”的条件。

自动驾驶汽车常用的各种硬件(图片来源:见参考资料1)

本文将从感知、决策与执行三个角度,详细介绍自动驾驶的核心技术体系。

一、感知篇

实现自动驾驶,需要优先解决一个问题:行车安全。

为了确保自动驾驶车辆在不同场景下均可以做出正确判断,需要实现对周围环境信息的实时动态获取和识别,这些信息包括但不限于自车的状态、交通流信息、道路状况、交通标志等,以满足车辆决策系统的需求。

换言之,环境感知起着类似人类驾驶员“眼睛”、“耳朵”的作用,是实现自动驾驶的前提条件。

为了满足环境感知的需求,自动驾驶汽车往往装备了诸多摄像机、激光雷达、毫米波雷达、超声波等车载传感器,在这些传感器以及V2X和5G网络技术的协作下,可以实时获取汽车所处的交通环境和车辆状态等多源信息,为自动驾驶汽车的决策规划提供支持服务。

目前,环境感知技术有两种技术路线,一种是以摄像机为主导的多传感器融合方案,典型代表是特斯拉。另一种是以激光雷达为主导,其他传感器为辅助的技术方案,典型企业代表如谷歌、百度等。

主流车载传感器的特点(图片来源:36氪)

Ξ 1.摄像机

车载摄像机是实现众多预警、识别类ADAS功能的基础,是目前最便宜也是最常用的车载传感器之一。

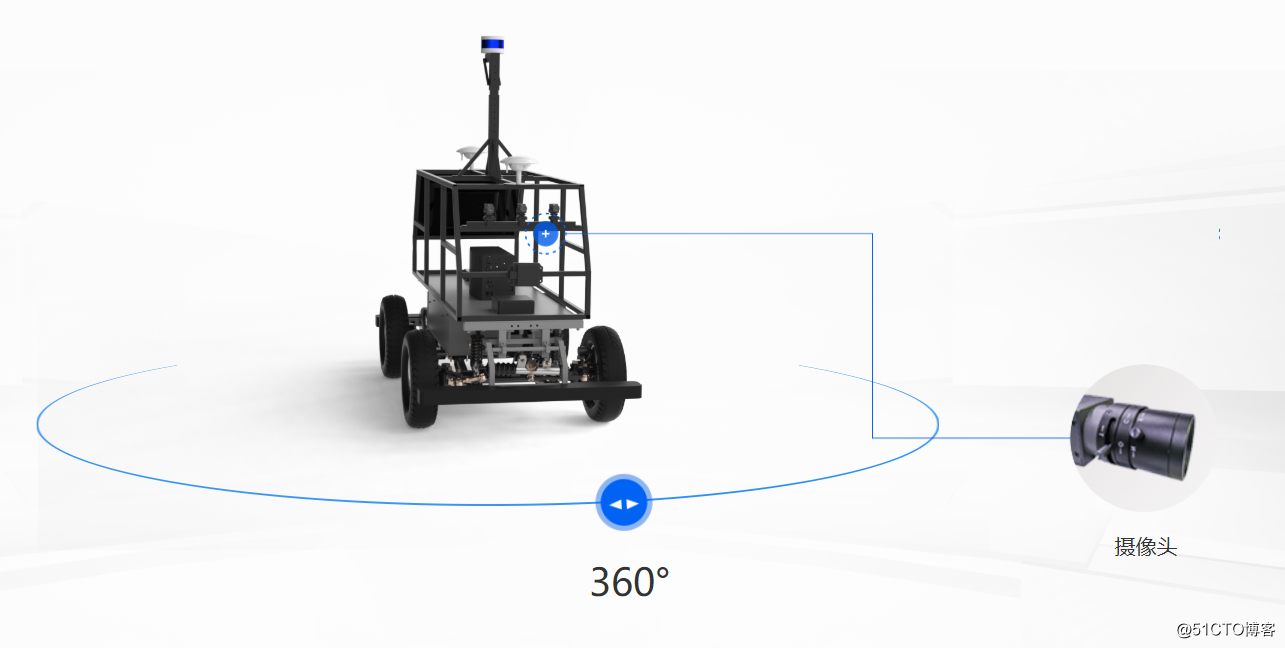

百度Apollo自动驾驶摄像机组件

摄像机可以识别车辆行驶环境中的车辆、行人、车道线、路标、交通标志、交通信号灯等,具有较高的图像稳定性、抗干扰能力和传输能力。

作为一种比较常见的车载传感器,摄像机的优点是可以分辨颜色,比较适用于场景解读。但是其也有比较明显的缺点。

首先摄像机缺乏“深度”这一维度,没有立体视觉,无法判断物体和相机间的距离;其次,摄像机对光线较为敏感,过暗或过强的光线以及二者之间的快速切变都会对其成像造成严重影响。

根据镜头和布置方式的不同,摄像机可大致分为四种:单目摄像机、双目摄像机、三目摄像机和环视摄像机。

单目摄像机主要用于自动驾驶过程中的路况判断,但单目摄像机在测距范围与距离方面,有一个不可调和的矛盾:摄像机的视角越宽,所能探测到精准距离的长度越短;视角越窄,探测到的距离越长。

这与人眼类似,看远处的时候,所能覆盖的范围就窄,看近处的时候,覆盖的范围就会广一些。

为了解决这个问题,实现用一个定焦镜头解决不同距离的观察,双目甚至多目摄像机的方案,逐渐得到越来越广泛的应用。

双目摄像机,顾名思义,拥有两个摄像机组件。相近的两个摄像机拍摄物体时,会得到物体像素偏移量、相机焦距和两个摄像机的实际距离等信息,根据信息即可换算得出物体的距离。

不过,虽然双目能得到较高精度的测距结果和提供图像分割的能力,但它与单目摄像机一样,镜头的视野完全依赖于镜头。而且双目测距原理对两个镜头的安装位置和距离要求较多,在相机标定方面存在一定难度。

目前应用比较广泛的是三目摄像机,三个不同焦距单目摄像机的组合。我们以特斯拉Autopilot为例,下图为特斯拉AutoPilot安装在挡风玻璃下方的三目摄像机:

特斯拉AutoPilot的三目摄像机

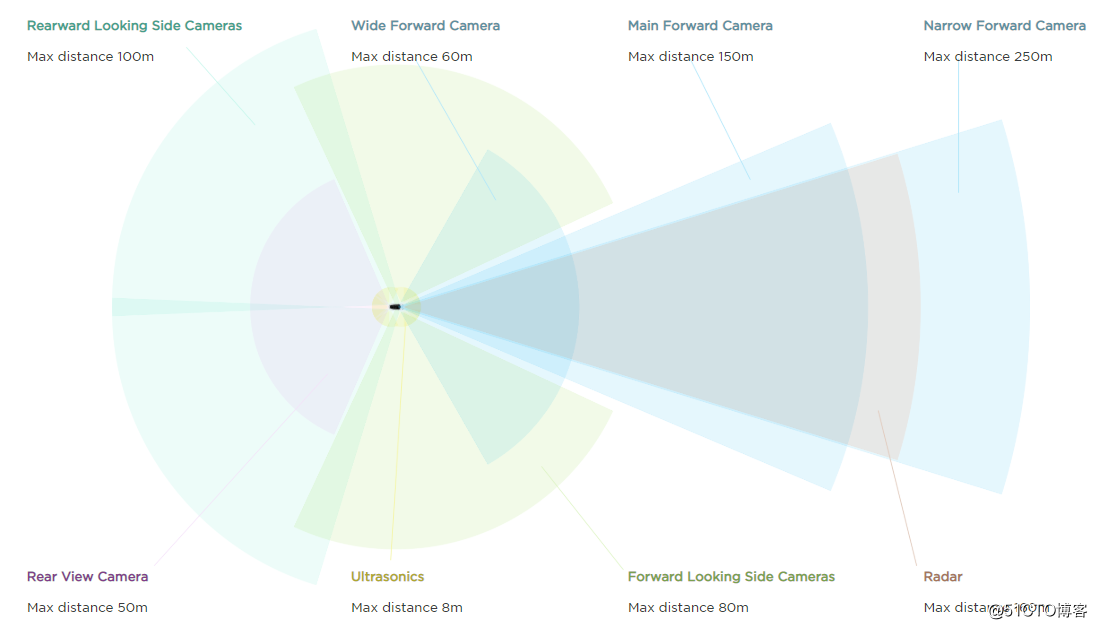

特斯拉Autopilot总计拥有8个摄像头、1个前毫米波雷达、12个超声波雷达的传感器配置,整体俯视图视场覆盖如下:

其中三目摄像机的具体配置如下:

FOV35度,最远距离250米;FOV50度,最远检测距离150米;FOV120度,最远检测距离60米。

三目摄像机以及其他位置摄像机的组合为特斯拉Autopilot提供了全向的环境感知能力,较好地解决了感知范围与感知精度的问题。

除了单目与多目摄像机以外,还有一种比较常见的摄像机类型,即环视摄像机。与上面提到的三种摄像机不同,环视摄像机的镜头是鱼眼镜头,而且安装位置是朝向地面。

环视摄像机的优点是视野广阔,但缺点也很明显,就是图像畸变严重,所以主要用于车身5-10米内的障碍物检测、自主泊车时的库位线识别等。

Ξ 2. 激光雷达

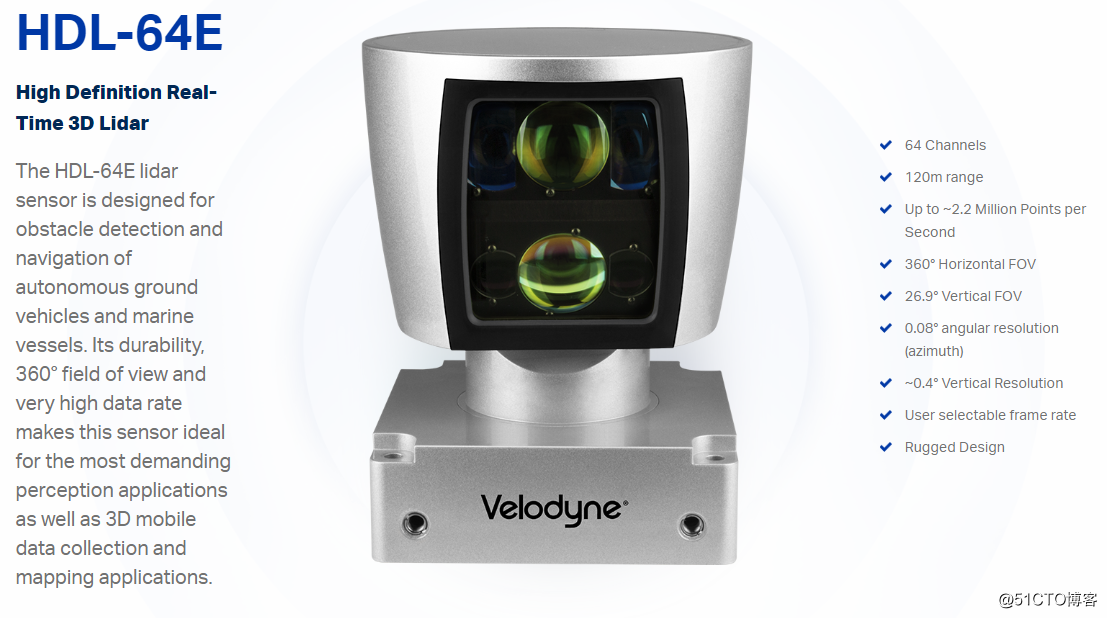

激光雷达是以发射激光束来探测目标空间位置的主动测量设备。在自动驾驶场景中,激光雷达主要有两个功能:3D的环境感知与SLAM加强定位。

根据探测原理,激光雷达可分为单线(二维)激光雷达和多线(三维)激光雷达。

单线激光雷达,通过发出一束激光扫描线对区域进行旋转扫描,并根据区域内各个点与激光雷达的相对空间距离与方位,返回测量值。单线激光雷达的数据缺少一个维度,只能描述线状信息,无法描述面。不过,单线激光雷达是目前成本最低的激光雷达。

多线激光雷达,通过发出两束或两束以上的激光扫描线对区域进行旋转扫描。多线激光雷达能够检测目标的空间距离与方位,并可以通过点云来描述三维环境模型,可以提供目标的激光反射强度信息,提供被检测目标的详细形状描述。

目前,国际市场上推出的主要有4线、8线、16线、32线和64线。激光雷达发出的线束越多,每秒采集的点云越多,同时造价也越高。

以激光雷达行业内知名企业Velodyne 公司为例,旗下的HDL-64E目前的售价在接近10万美金左右:

目前,激光雷达已经发展了三代产品,包括第一代机械扫描激光雷达、第二代混合固态激光雷达以及第三代纯固态激光雷达。

总体而言,激光雷达无论是在技术门槛还是在制造成本上都比较高,自动驾驶商业化应用期待市场出现更多优质且价格较低的同类产品。

Ξ 3. 毫米波雷达

由于激光雷达价格过高,单独一个雷达的价格可能远超车辆本身的价格,因此很多企业选择使用性价比更高的毫米波雷达作为测距和测速的传感器。

毫米波雷达是指工作在毫米波波段,频率在30—300GHz之间的雷达。与激光波雷达相比,毫米波雷达不仅成本更低,且可以同时解决摄像机测距、测速不够精确的问题,此外毫米波雷达还可以完美处理激光雷达所处理不了的沙尘天气。

不过,毫米波雷达也并不是没有缺点。首先,毫米波雷达的数据稳定性较差,对后续的软件算法提出了更高的要求。

此外,毫米波雷达对金属极为敏感,路面的金属广告牌在很多场景下会被认为是障碍物,导致刹车不断。最后毫米波雷达只能提供距离和角度信息,不能像激光雷达那样提供高度信息。

百度Apollo自动驾驶毫米波雷达组件

根据测量原理的不同,毫米波雷达可分为脉冲方式毫米波雷达和调频连续波方式毫米波雷达两种。

脉冲方式毫米波雷达,其基本原理与激光雷达相似,它在硬件结构上比较复杂、成本较高,很少用于自动驾驶汽车,目前大多数车载毫米波雷达都采用调频连续波方式。

调频连续波方式毫米波雷达,具有结构简单、体积小、成本低廉,容易实现近距离探测。

Ξ 4. 超声波雷达

超声波雷达工作在机械波波段,工作频率在 20kHz以上。

超声波雷达的工作原理是通过超声波发射装置向外发出超声波,通过接收器接收回波的时间差来测算距离。常用的工作频率有40kHz, 48kHz和58kHz三种。一般来说,频率越高,灵敏度越高,但水平与垂直方向的探测角度就越小,所以一般采用40kHz的探头。

超声波雷达具有频率高、波长短、绕射现象小、方向性好、能够成为射线而定向传播等优点,且兼具防水、防尘的特性,因此非常适合应用于泊车。

一般情况下,超声波雷达会安装在汽车保险杠上方,隐藏在保险杠的某个位置,如下图所示:

常见的超声波雷达有两种。一种是安装在汽车前后保险杠上,用于测量汽车前后障碍物的倒车雷达,称之为UPA;另一种是安装在汽车侧面,用于测量侧方障碍物距离的超声波雷达,称之为APA。UPA和APA的区别还体现在探测范围和探测区域上。

Ξ 5. 精准定位

自动驾驶汽车的环境感知还包括汽车的精准定位,不仅需要获取车辆与外界环境的相对位置关系,还需要通过车身状态感知确定车辆的绝对位置与方位。

目前自动驾驶领域常见的几种精准定位方式包括“惯性导航系统”、“轮速编码器与航迹推算”、“卫星导航系统”以及“SLAM自主导航系统”等。

惯性导航系统是以陀螺和加速度计为敏感器件的导航参数解算系统,通过测量运动载体的线加速度和角速率数据,并将这些数据对时间进行积分运算,从而得到速度、位置和姿态。

具体来说惯性导航系统属于一种推算导航方式。即从一已知点的位置根据连续测得的运载体航向角和速度推算出其下一点的位置,因而可连续测出运动体的当前位置。

以百度Apollo自动驾驶技术使用的惯性导航系统为例,其采用了松耦合的方式,并采用了一个误差Kalman滤波器。

惯性导航解算的结果用于Kalman滤波器的时间更新,即预测;而GNSS、点云定位结果用于Kalman滤波器的量测更新。Kalman滤波会输出位置、速度、姿态的误差用来修正惯导模块,IMU期间误差用来补偿IMU原始数据。

轮速编码器与航迹推算的原理是通过轮速编码器推算出自动驾驶汽车的位置。轮速编码器主要安装在汽车前轮,用于记录车轮行驶的总转数。

通过分析每个时间段里左右轮的转数,可以推算出车辆向前行驶的距离和左右的偏转度。不过,由于在不同地面材质上转数对距离转换存在偏差,所以时间越久,测量偏差也会越大,这种定位方式更多以辅助的形式存在。

卫星导航系统主要包括中国的北斗卫星导航系统、美国的GPS卫星导航系统以及俄罗斯的GLONASS卫星导航系统。这些导航系统可以提供高精度的定位服务。

SLAM(即时定位与地图构建),也称为CML(并发建图与定位)。

目前主流有两种SLAM方式。第一种是基于激光雷达的SLAM,以谷歌汽车为例。车辆携带有GPS,通过GPS 对位置进行判断,并以激光雷达SLAM点云图像与高精度地图进行坐标配准,匹配后确认自身位姿。

第二种是基于视觉的SLAM,以Mobileye为例。Mobileye提出一种无需SLAM的定位方法——REM。车辆通过采集包括信号灯、指示牌等标识,得到了一个简单的三维坐标数据,再通过视觉识别车道线等信息,获取一个一维数据。摄像机中的图像与 REM 地图中进行配准,即可完成定位。

目前,SLAM常用于自主导航,特别是在GPS无信号或不熟悉的地区的导航。

Ξ 6. 高精地图

高精地图是用于自动驾驶的专题地图,由含有语义信息的车道模型、道路部件(Object)、道路属性三类矢量信息,以及用于多传感器定位的特征(feature)图层构成。

高精地图拥有精确的车辆位置信息和丰富的道路元素数据信息,起到构建类似于人脑对于空间的整体记忆与认知的功能,可以帮助汽车预知路面复杂信息,如坡度、曲率、航向等,更好地规避潜在的风险,是自动驾驶汽车的核心技术之一。

相较于GPS导航系统的传统地图而言,高精地图最显著的特征是其表征路面特征的精准性。关于高精地图的详细内容,我们会在后面的文章中详细介绍。

未完待续...

参考资料:

- Development of Steering Control System for Autonomous Vehicle Using Geometry-Based Path Tracking Algorithm

2.AMiner《2018年人工智能之自动驾驶研究报告》

3.【感知】自动驾驶传感器汇

(https://blog.csdn.net/yuxuan20062007/article/details/83862525)

4.Apollo官网

5.Velodyne官网

6.36氪《自动驾驶行业研究报告》