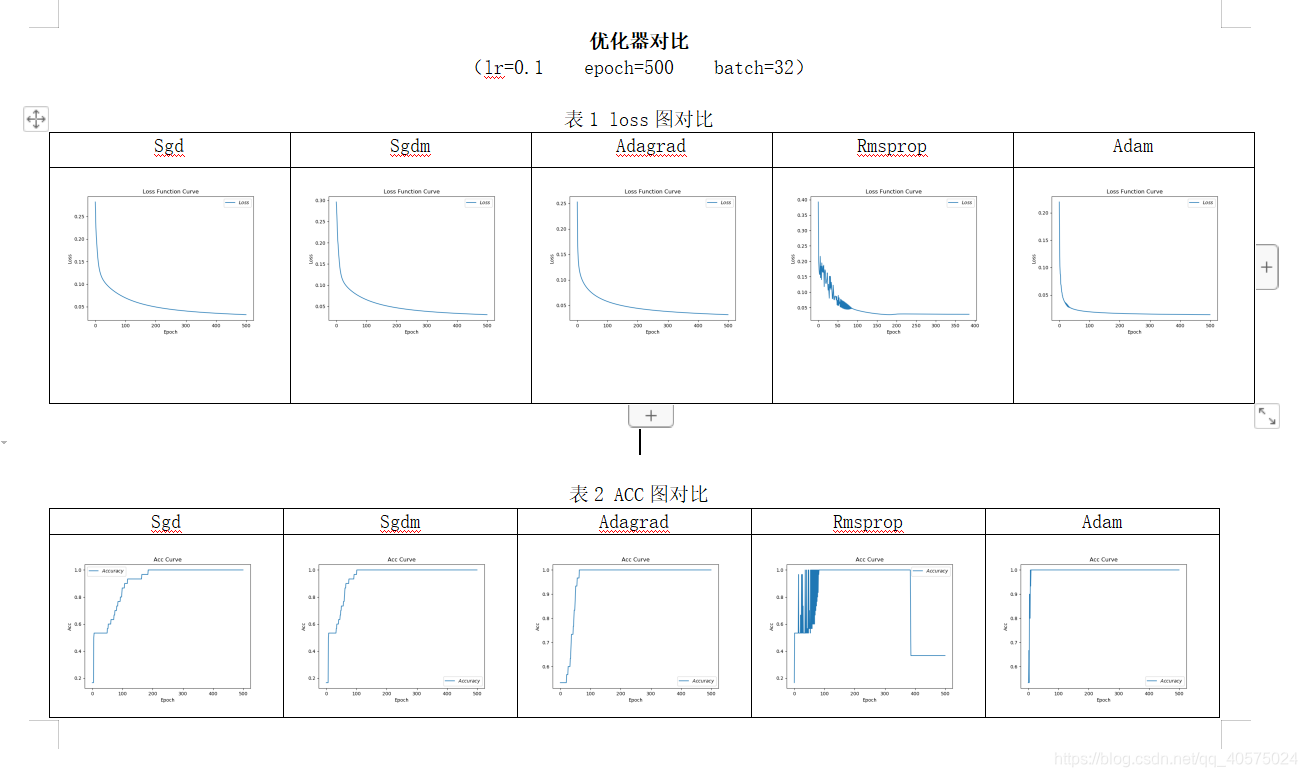

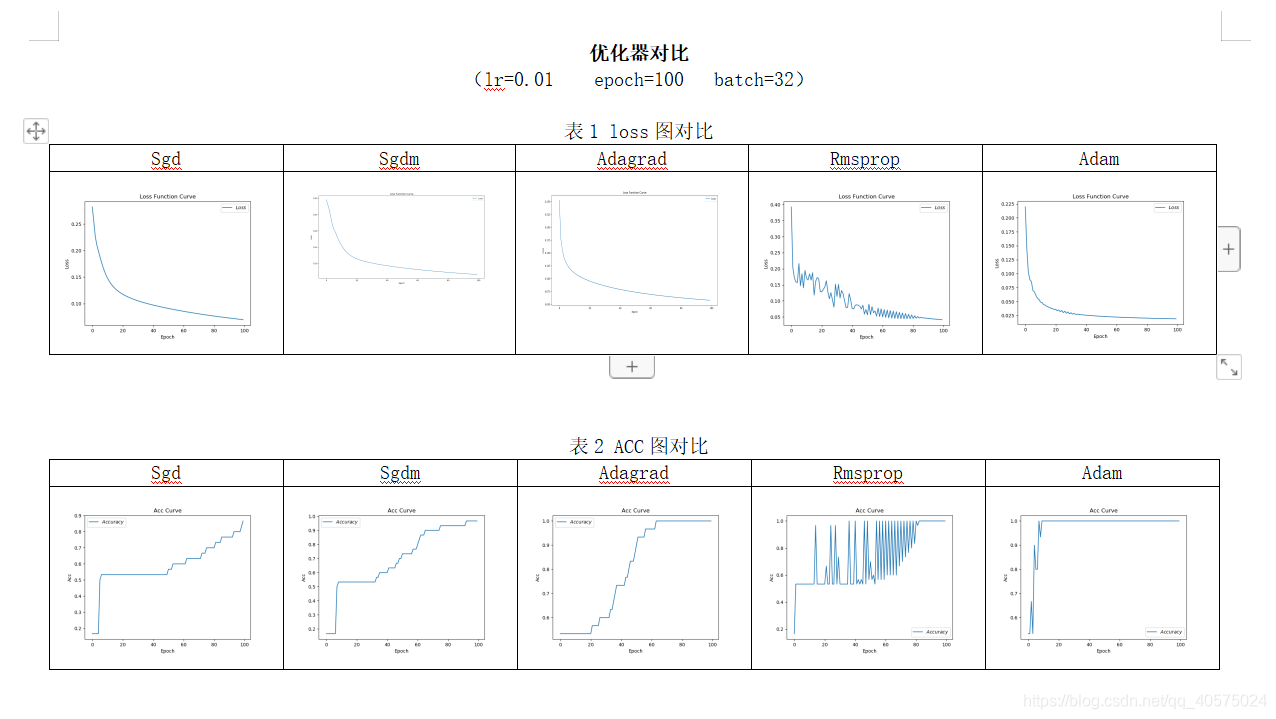

tensorflow2 5种优化器 SGD,SGDM,ADAGRAD,RMSPROP,ADAM 在鸢尾花数据集中的对比

猜你喜欢

转载自blog.csdn.net/qq_40575024/article/details/105874503

今日推荐

周排行