HMM(隐马尔可夫模型)

-

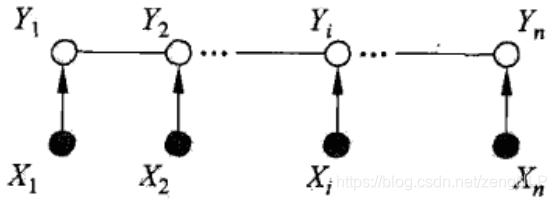

核心概念:

隐含状态链

可见状态链

转移概率(transition probability)

输出概率(emission probability) -

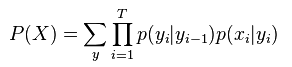

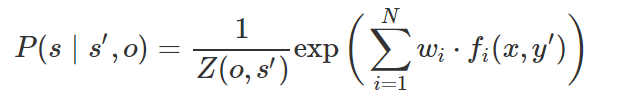

HMM公式

-

举例说明:

假设我手里有三个不同的骰子。第一个骰子是D6,6个面,每个面(1,2,3,4,5,6)出现的概率是1/6。第二个骰子是D4,每个面(1,2,3,4)出现的概率是1/4。第三个骰子D8,每个面(1,2,3,4,5,6,7,8)出现的概率是1/8。

掷10次骰子得到一串数字:1 6 3 5 2 7 3 5 2 4

可见状态链就是: 1 6 3 5 2 7 3 5 2 4

隐含状态链可能是:D6 D8 D8 D6 D4 D8 D6 D6 D4 D8

转移概率:D4、D6、D8的下一个状态是D4、D6、D8的转移概率都是1/3

输出概率:D6得到1的输出概率是1/6,得到2、3、4、5、6的概率也都是1/6;D4、D8同理

-

问题

条件概率的输出独立性假设 -

HMM的三种问题:

1、知道骰子有几种(隐含状态数量),每种骰子是什么(转移概率),根据掷骰子掷出的结果(可见状态链),我想知道每次掷出来的都是哪种骰子(隐含状态链)

2、知道骰子有几种(隐含状态数量),每种骰子是什么(转移概率),根据掷骰子掷出的结果(可见状态链),我想知道掷出这个结果的概率。

3、知道骰子有几种(隐含状态数量),不知道每种骰子是什么(转移概率),观测到很多次掷骰子的结果(可见状态链),我想反推出每种骰子是什么(转移概率) -

Viterbi算法

维特比算法就是求解HMM上的最短路径的算法。

MEMM (大熵马尔可夫模型)

-

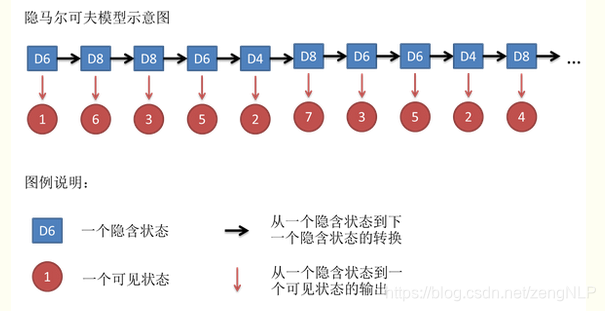

熵

熵是表示物质系统状态的一种度量,表征系统的无序程度。

熵越大,系统越无序,意味着系统结构和运动的不确定和无规则;反之,熵越小,系统越有序,意味着具有确定和有规则的运动状态。 -

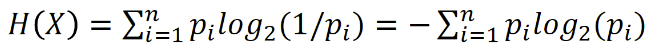

信息熵

-

MEMM公式

给定先前标记 ,输入词 和任意其它特征 来估计每个局部标记的概率

是与每个特征 相关联的需要学习的权重, 是使矩阵在每行上总和为 1 的归一化因子 -

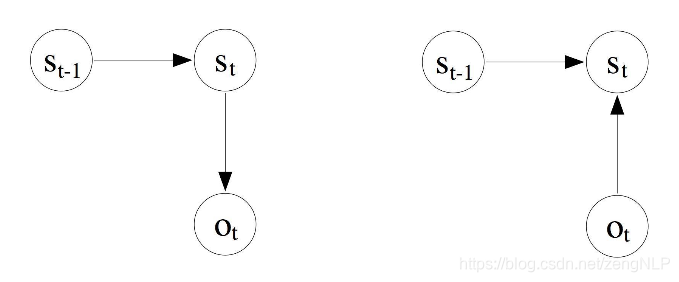

HMM 与 MEMM 对比

(左边是HMM,右边是MEMM) -

标注偏置问题(label bias problem)

MEMM所做的是本地归一化,导致有更少转移的状态拥有的转移概率普遍偏高,概率最大路径更容易出现转移少的状态。因MEMM存在着标注偏置问题。

CRF(条件随机场)

-

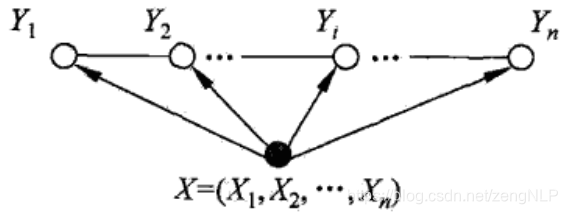

定义

条件随机场(conditional random field)是给定随机变量X条件下,随机变量Y的马尔可夫随机场。在该条件概率模型P(Y|X)中,Y是输出变量,表示标记序列,即状态序列,X是输入变量,也就是我们得到的需要标注的观测序列。

-

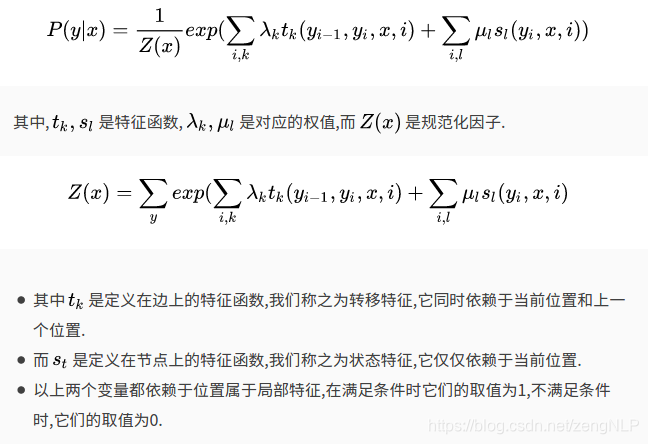

CRF公式

-

线性链条件随机场

-

X和Y具有相同图结构的线性链条件随机场