本文只是从一般的图像处理角度来看待Markov模型,并未从图模型的角度入手,主要参考《Markov.Random.Field.Modeling.In.Image.Analysis》一书。

1. 贴标签问题(Labeling problem)

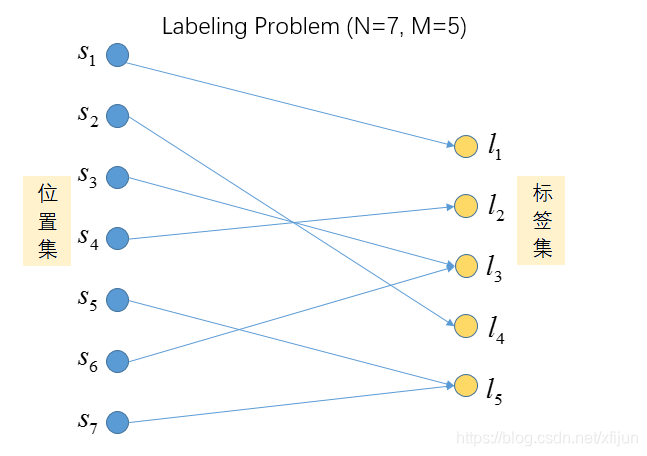

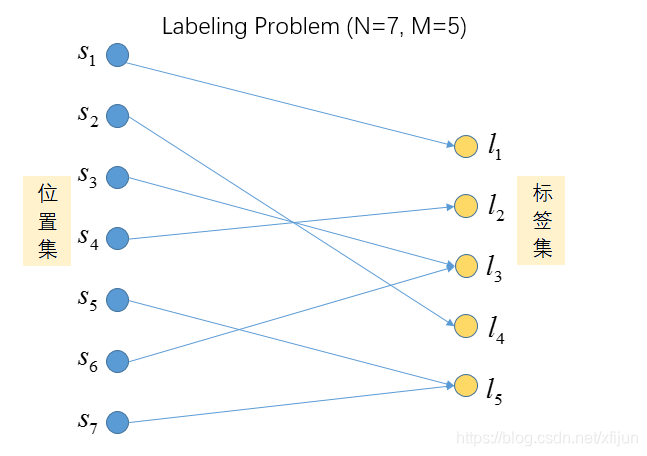

给定一系列的位置

(site) 和一系列的标签

(label),贴标签问题

(Labeling Problem)是指,为每个地点贴上一个标签。

- 假设

S={s1,⋯,sn,⋯,sN} 表示具有

N 个位置的离散位置集

(discrete site set),

L={l1,⋯,lm,⋯,lM} 表示具有

M 个标签的离散标签集

(discrete label set)

- 对于位置集

S 中的任意一个位置

sn,都可以从标签集

L 中选择一个标签

lm、给位置

sn “贴上一个标签”

(labeling)

例如,对于一幅

N×N 大小的灰度图像而言:

(1) “位置集” 可表示为

S={(i,j) ∣ ∀ i,j∈{1,2,⋯,N} }

(2) “标签集” 可表示为

L={l ∣ 0,1,⋯,255}

因此,贴标签问题相当于定义了一个映射

φ:

φ:S→L

φ(i,j)=l 或

φ(sn)=lm

显然,对于一副

N×N 大小的灰度图像,任意

(i,j) 处像素的灰度值都可能是标签集

L 中元素

0∼255 中的一个(即:任一位置像素的灰度值具有

256 种可能),对整幅图像而言、就存在

256N2 种可能的贴标签方式。我们把其中任意一种贴标签的方式称为一种配置

(configuration),任何一副

N×N 大小的灰度图像必然是这

256N2 种配置中的一种。

2. 邻域系统和子团(Neighborhood System and Cliques)

位置集

S={s1,⋯,sN} 上的一个位置

si 是通过邻域系统

(Neighborhood System) 和另一个位置

sj 建立联系。

2.1 邻域系统

位置集

S 上的邻域系统可定义为:

N={Nsi ∣ ∀ si∈S},其中

Nsi 是邻近

si 的一部分位置组成的集合。显然,

Nsi 描述了位置

si 和邻近的位置

sj 之间的关系:

(1) 位置

si 和自己不是相邻的,即

si∈/Nsi

(2) 邻域关系是相互的

(mutual),即

si∈Nsj⟺sj∈Nsi 【很关键的一点】

对于具有规则网格

(regular lattice) 结构的位置集

S(例如灰度图像),一种典型的定义邻域系统的方式是:

Nsi={sj∈S ∣ ∥sj−si∥2≤r,∀ j=i},表示以

si 为中心、

r 为半径的圆内所包含的所有

sj 组成了位置

si 的邻域

Nsi,如下图所示:

图1 引自于《Markov.Random.Field.Modeling.In.Image.Analysis》Figure 2.1

2.2 子团

子团

(Clique) 是位置集

S 中的子集

(subset),可以包括“单个位置

(single site)”

C1,“两个位置

(pair sites)”

C2,“三个位置

(triple sites)”

C3 等情形。

C1={si ∣ si∈S}

C2={ {si,sj} ∣ sj∈Ni,si∈S}

C3={ {si,sj,sk} ∣ sj∈Ni,sk∈Ni,sj∈Nk,si,sj,sk∈S},即:

si,sj,sk 彼此互为邻近点

(neighbor)

子团中的位置是有序的

(ordered),即:

{si,sj} 和

{sj,si} 是不一样的。

所有子团的并集记为

C=C1∪C2∪C3∪⋯,这里的

⋯ 表示所有可能的、更大的子团。

定义在规则网格

(regular lattice) 结构的位置集

S 上的子团类型

(type of a clique),取决于子团的大小、形状和方向。

图2 解释如下:

-

对于图1中

r=1 的邻域系统,

x 位置只和上下左右位置的像素点互为

Neighbor,

(a) 为 single-site clique,

(b) 和

(c) 为 pair-sites clique;但是

(d) 和

(e) 却不是为 pair-sites clique,因为

r=1 的邻域系统中对角线上的元素不满足互为

Neighbor 的条件。

-

对于图1中

r=2 的邻域系统,

x 位置和上下左右以及对角的像素点互为

Neighbor,

(a) 为 single-site clique,

(b),(c),(d),(e) 都为 pair-sites clique(其中一个为

x 点),

(f),(g),(h),(i) 都为 triple-sites clique(拐角处为

x 点),

(j) 为 quadruple-sites clique(其中一个为

x 点),这些 clique 中的 site 都满足互为

Neighbor 的条件。

不规则地点集

(irregular site set) 的邻域系统和子团:

引自于《Markov.Random.Field.Modeling.In.Image.Analysis》Figure 2.1 and Figure 2.2

在

C2 中,

f 和

m 两个位置不构成 clique,因为不满足互为

Neighbor 的条件。

3. Markov随机场(Markov Random Field)

3.1 随机场

令

F={F1,F2,⋯,FN2} 为定义在位置集

S={1,2,⋯,N2} 上的一族随机变量(每个位置

i 对应了一个随机变量

Fi),每个随机变量

Fi 可从离散标签集

L={l ∣ 0,1,⋯,255} 中取出一个整数

fi=0∼255 , 这样的一族随机变量

F 称为随机场。

如果将

N×N 大小的灰度图像(表示为一维)看成是一个随机场,那么,

N×N 灰度图像随机场

F 的一种配置

(configuration) 就表示为

(F1=f1,F2=f2,⋯,FN2=fN2),记为

(F=f),对应了随机场的一次实现

(realization)。

关于随机场

F 的联合概率

P(F=f)=P(F1=f1,F2=f2,⋯,FN2=fN2) 简写为

P(f)。

其中,位置

i 所对应随机变量

Fi 取值为

fi∈L 的概率

P(Fi=fi) 简写为

P(fi)。

3.2 马尔科夫性(Markovianity)

当满足以下条件时,称随机场

F 是定义在

S={1,2,⋯,N2} 上、关于邻域系统

N 的

Markov随机场

(Markov Random Field):

(1) 非负性:

P(f)>0,∀ f∈F

(2) 马尔可夫性:

P(fi∣fS−{i})=P(fi∣fNi),其中

fNi 表示邻域

Ni 中位置所对应随机变量

显然,马尔科夫随机场是一种概率模型。灰度图像随机场

F 的任意一种配置

f,都以一定的概率

P(f) 对应了一幅(与其它配置所对应图像不一样的)灰度图像;而且,

N×N 灰度图像中任意位置

(x,y) 处像素的灰度值,只与该位置

i (i=x×N+y) 的邻域

Ni 所包含的像素灰度值有关。

例如,在图

(1) 中如果用

r=1 定义邻域系统,

x 位置的像素值只和上下左右

4 个像素值有关;如果用

r=2 定义邻域系统,

x 位置的像素值只和包围该位置的

8 个像素值有关。这种“图像具有马尔科夫性”的假设,对于很多自然图像都是满足的。

3.3 Gibbs随机场(Gibbs Random Field)

如果随机场

F 的任一配置

(F=f) 的概率都服从

Gibbs 分布,就称随机场

F 是定义在位置集

S={1,2,⋯,N2} 上的 Gibbs随机场。

Gibbs 分布:

P(f)=Ze−T1U(f) ,归一化常数

Z=f∈F∑e−T1U(f), 显然

f∈F∑P(f)=1

其中:

(1) “归一化常数”

Z 称为配分函数

(partition function):所有配置

f∈F 对应的

e−T1U(f) 值之和

(2) 常数

T 为温度

(temperature):用于控制

Gibbs 分布的尖锐程度

(sharpness)

当

T 值很大,所有配置

f 的概率

P(f) 趋于相等;

当

T 值固定时,能量函数

U(f) 的值越小,

P(f) 越大。

(3)

U(f) 称为能量函数

(energy function):所有子团的势能之和

(sum of clique potentials)

U(f)=c∈C∑Vc(f) 其中,

Vc(f) 表示子团

c 上的势能。

关于Gibbs分布的解释可参考《数字图像处理(王桥)》P167-168

和Gibbs分布、Boltzmann分布有关的求解过程基本上都可以采用模拟退火过程。

在实际计算能量函数的时候,通常需要考虑

GRF 的两个特殊性质:齐次性

(homogeneity),各向同性

(isotropy)。

MRF/GRF 中的(空间)齐次性是对Markov链中(时间)齐次性的扩展。

一阶Markov链:

P(Xt+1=xt+1∣Xt=xt,⋯,X0=x0)=P(Xt+1=xt+1∣Xt=xt)

齐次的(homogeneous)一阶Markov链:

记

t 时刻的一步转移概率为:

P(Xt+1=j∣Xt=i)=pij(t), ∀ i,j∈ 状态空间

当一步转移概率

pij(t) 与时间

t 无关,即:

pij(t)=pij 时,为齐次

Markov链。

《Markov.Random.Field.Modeling.In.Image.Analysis》2.1节对

MRF/GRF 中的(空间)齐次性做了如下解释:

(a) MRF中的齐次性:

P(fi∣fNi) 与

i 在

S 中的相对位置无关

如果都采用相同的邻域系统,位置

j (j=i) 的邻域

Nj 应该和位置

i 的邻域

Ni 的结构是一样的,那么就有

P(fj∣fNj)=P(fi∣fNi),也就是说

P(fi∣fNi) 的计算与

i 在

S 中的具体位置无关,只要满足位置

i∈S 对应的

Ni 的结构一致

(b) GRF中的齐次性:

Vc(f) 与子团

c 的相对位置无关

以

pair sites 子团

C2 为例,假设位置

i,i′,j,j′∈S,如果

{i,i′} 与

{j,j′} 以相同的结构形成子团

ci={i,i′},cj={j,j′},ci,cj∈C2,那么这两个子团的能量函数

Vci(fi,fi′),Vcj(fj,fj′) 可以用一个通式

V2(fi,fi′),V2(fj,fj′) 来表示

即:

c∈C2∑Vc(f)={i,j}∈C2∑V2(fi,fj)

因此,齐次

(homogeneous)Gibbs分布的能量函数可以表示为

U(f)={i}∈C1∑V1(fi)+{i,j}∈C2∑V2(fi,fj)+{i,j,k}∈C3∑V3(fi,fj,fk)+⋯

一种很重要的情形:仅考虑“

single site子团”

C1 和“

pair sites子团”

C2 的情况,此时的能量函数表示为

U(f)={i}∈C1∑V1(fi)+{i,j}∈C2∑V2(fi,fj)=i∈S∑V1(fi)+i∈S∑j∈Ni∑V2(fi,fj)

这时

P(fi∣fNi)=P(fNi)P(fi,fNi)=∑fi′∈LP(fi′,fNi)P(fi,fNi)分子:Fi=fi,分母:Fi=fi′=∑fi′∈Le−[V1(fi′)+∑j∈NiV2(fi,fj)]e−[V1(fi)+∑j∈NiV2(fi,fj)]

3.4 Markov与Gibbs的等价性

-

Markov随机场的特点在于考虑了位置集

S 的局部特性,提供了随机场的条件分布(条件分布满足马尔科夫性),实现起来比较困难;

-

Gibbs随机场的特点在于考虑了位置集

S 的全局特性,提供了随机场的联合分布(

S 上的随机场

F 的每个配置

f 服从

Gibbs 分布),可以借助空间上的邻域系统来实现(选择不同的子团类型和对应的能量函数形式,可以产生不同形式的GRF)。

Hammersley−Clifford 定理建立了

MRF 和

GRF 之间的一一对应关系:如果随机场

F 具有局部

Markov 性,那么随机场

F 具有

Gibbs 分布;反之,如果随机场

F 具有

Gibbs 分布。

假设

P(f) 是位置集

S 上的关于邻域系统

N 的Gibbs分布,那么

P(fi∣fS−{i})=P(fS−{i})P(fi,fS−{i}) , 记 (F=f)=(Fi=fi,fS−{i})=∑fi′∈LP(fi′,fS−{i})P(f), 记 fi′ 为 L 中某个值,Fi 的取值为 fi′=∑fi′∈LP(f′)P(f) , 记 (F=f′)=(Fi=fi′,fS−{i})=∑fi′∈Le−∑c∈CVc(f′)e−∑c∈CVc(f)=∑fi′∈L[e−∑c∈AVc(f′)⋅e−∑c∈BVc(f′)]e−∑c∈AVc(f)⋅e−∑c∈BVc(f)

其中,

A 为包含位置

i 的所有子团,

B 为不包含位置

i 的所有子团,显然分母中的

e−∑c∈BVc(f′) 与随机变量

Fi=fi′ 的取值无关,可以放到

∑fi′∈L 的外面。

因此,可得到:

P(fi∣fS−{i})=∑fi′∈L[e−∑c∈AVc(f′)⋅e−∑c∈BVc(f′)]e−∑c∈AVc(f)⋅e−∑c∈BVc(f)=e−∑c∈BVc(f′)⋅∑fi′∈L[e−∑c∈AVc(f′)]e−∑c∈AVc(f)⋅e−∑c∈BVc(f)=∑fi′∈Le−∑c∈AVc(f′)e−∑c∈AVc(f)

这就说明

P(fi∣fS−{i}) 只和包含位置

i 的所有子团的势能有关,对于满足

c∈B 的子团,实际上就是3.3节中的

P(fi∣fNi)。这说明了,在定义了邻域系统

N 的情况下,

GRF 和

MRF 是等价的。

4 图像的MRF建模

4.1 图像随机场

将一幅

N×M 大小的灰度图像建模为随机场:

(1) 假设图像大小为

N×M,位置集

(site set) 按照图像扫描顺序排列

即:

S={0,1,⋯,m×M+n,⋯,N×M},位置集中的

m×M+n 表示图像中

(m,n) 位置处的像素

(2) 只考虑灰度图像时,标签集

(label set) 为

L={0,1,⋯,255}

(3) 在位置集

S 上定义一族随机变量

Fi 组成了图像随机场

F={F1,⋯,Fi,⋯,FN×M} , i∈S

(4) 随机场

F 的一种配置

(F=f) 表示

(F1=f1,⋯,Fi=fi,⋯,FN×M=fN×M) , fi∈L

我们观测到了图像

y={y1,⋯,yi,⋯,yN×M},观测图像

y 也对应了随机场

F 的一种配置或一次实现,即:

(F=y)=(F1=y1,⋯,Fi=yi,⋯,FN×M=yN×M)

4.2 图像退化的似然描述

假设我们观测到了一幅退化的(有噪声的)图像

y,原始图像为

f。对于该图像的第

i 个像素,满足

yi=φ(fi)+εi,例如高斯噪声为

εi∼N(0,σi2), i∈S。

考虑图像的退化模型

P(y∣f),一般我们假设“退化过程关于不同位置的像素值是相互独立的”,也就是:

P(y∣f)=i∈S∏P(yi∣fi)=i=1∏N×MP(yi∣fi)

上式可以认为是“图像退化的似然描述”,因为观测图像

y 是已知的、固定不变的,概率值

P(y∣f) 对于

f 的变动来说,可以称为“似然”。

可参考《数字图像处理(王桥)》§7.1 (P159) 和 §7.3.4 (P170)

对比关于观测数据集

D={x1,x2,⋯,xN} 的似然函数

p(D∣θ)=p(x1,x2,⋯,xN∣θ),这里的“似然”是指概率值

p(D∣θ) 的大小对于参数

θ 的变动而言,可参考《正态分布的最大似然估计》。

例如,高斯似然模型

εi∼N(0,σi2),退化模型为

P(yi∣fi)=2π

σi1e−2σi2[φ(fi)−yi]2,可得到

P(y∣f)=i∈S∏P(yi∣fi)=∏i=1N×M2πσi2

1e−U(f), 其中U(f)=i∈S∑2σi2[φ(fi)−yi]2

4.3 MAP-MRF模型

通过建立图像的随机场模型、以及对图像退化过程进行似然描述,就可以获得对图像的概率描述。有了这些概率工具,就可以去考虑“通过观测图像估计真实图像”之类的估计问题,最常用的框架就是最大后验估计

(Maximum A Posteriori, MAP)。

(1) 从概率的角度来看,要从一幅包含噪声的观测图像中恢复原始图像,就是要得到随机场

F 的某一种配置

(F=f),该配置的概率值最大。

在MAP-MRF框架中图像真实值

x 的最佳估计

x^:

x^=fargmaxP(f∣y)

也就是,在已知观测值

y 的条件下、具有最大后验概率时的配置

f 作为原始图像的估计

(2) 贝叶斯推理:

P(f∣y)=P(y)P(y∣f)P(f)∝P(y∣f)P(f)

其中,

P(f) 是可能的原始图像

f的先验概率,

P(y∣f)=i=1∏N×MP(yi∣fi)是图像退化的似然模型

条件概率值

P(y∣f) 表示可能的原始图像

f 退化为观测图像

y 的似然值(可能性)

(3) 图像的MAP-MRF框架就为:

f^=fargmaxP(f∣y)=fargmax{lnP(y∣f)+lnP(f)}

如果

P(f) 服从均匀分布,最大后验估计就等价于最大似然估计

因此,图像的

MRF模型就是根据实际需要,选择合适的退化模型

P(y∣f) 和图像先验模型

P(f) 来进行贝叶斯推理。

5. 图像分类的例子

对于

N×M 灰度图像的随机场建模如4.1节所描述,位置集

S={0,1,⋯,N×M}。对于图像分类问题(图像分割),标签集

L={1,⋯,M},其中

M 表示类别数。

退化模型:假设图像退化的似然模型

P(y∣f) 为高斯型:

P(yi∣fi)=2π

σfi1exp[−2σfi2(yi−fi)2], ∀ i∈S

此时,

fi∈{1,⋯,M} 表示类别的索引,而

σfi2 表示第

fi 类的方差。

先验模型:在MAP-MRF框架中,图像先验模型

P(f) 采用

Gibbs分布:

P(f)=Ze−T1U(f)

在图像分类问题中,只考虑

pair sites子团。考虑图1中的

r=1 邻域系统,其子团类型为图2中

(b),(c) 两种结构,

pair sites子团的能量函数可定义为:

V2(fi,fj)=βγ(fi,fj),γ(fi,fj)=⎩⎨⎧−1+1, fi=fj, fi=fj,∀ i,j∈S

也就是说,在某个恒定温度时,当两个位置的像素值相等时,子团势能降低,能量函数也降低,从而使得

P(f) 的概率越来越大。

图中为二分类的结果,除了边界处的子团会增加总能量之外,其他平坦区域的子团均会使得总能量值下降。

以图中的二值分割为例,

V2(fi,fj)=βγ(fi,fj) 实际上表示的是边界的长度。

显然,边界越长(不可能整幅图像都是边界),能量函数值越大,这种情况出现的概率就越低。

齐次

Gibbs分布的能量函数就为:

U(f)={i,j}∈C2∑V2(fi,fj)={i,j}∈C2∑βγ(fi,fj)

因此,图像分类就建模为一个最优化问题:

f^=fargmaxP(f∣y)=fargmax{lnP(y∣f)+lnP(f)}=fargmax⎩⎨⎧−i=1∑N×M(ln2π

σfi+2σfi2(yi−fi)2)−T1{i,j}∈C2∑βγ(fi,fj)⎭⎬⎫=fargmin⎩⎨⎧i=1∑N×M(ln2π

σfi+2σfi2(yi−fi)2)+T1{i,j}∈C2∑βγ(fi,fj)⎭⎬⎫

对该优化模型的求解,可采用

ICM,

Gibbs采样,

Metropolis采样等随机优化方法。