百度发布首个大规模隐变量对话模型PLATO - 飞桨PaddlePaddle的文章 - 知乎

https://zhuanlan.zhihu.com/p/131019469

PLATO: Pre-trained Dialogue GenerationModel with Discrete Latent Variable

PLATO:具有离散潜变量的预训练对话生成模型

PLATO可以灵活支持多种对话,包括闲聊、知识聊天、对话问答等等。

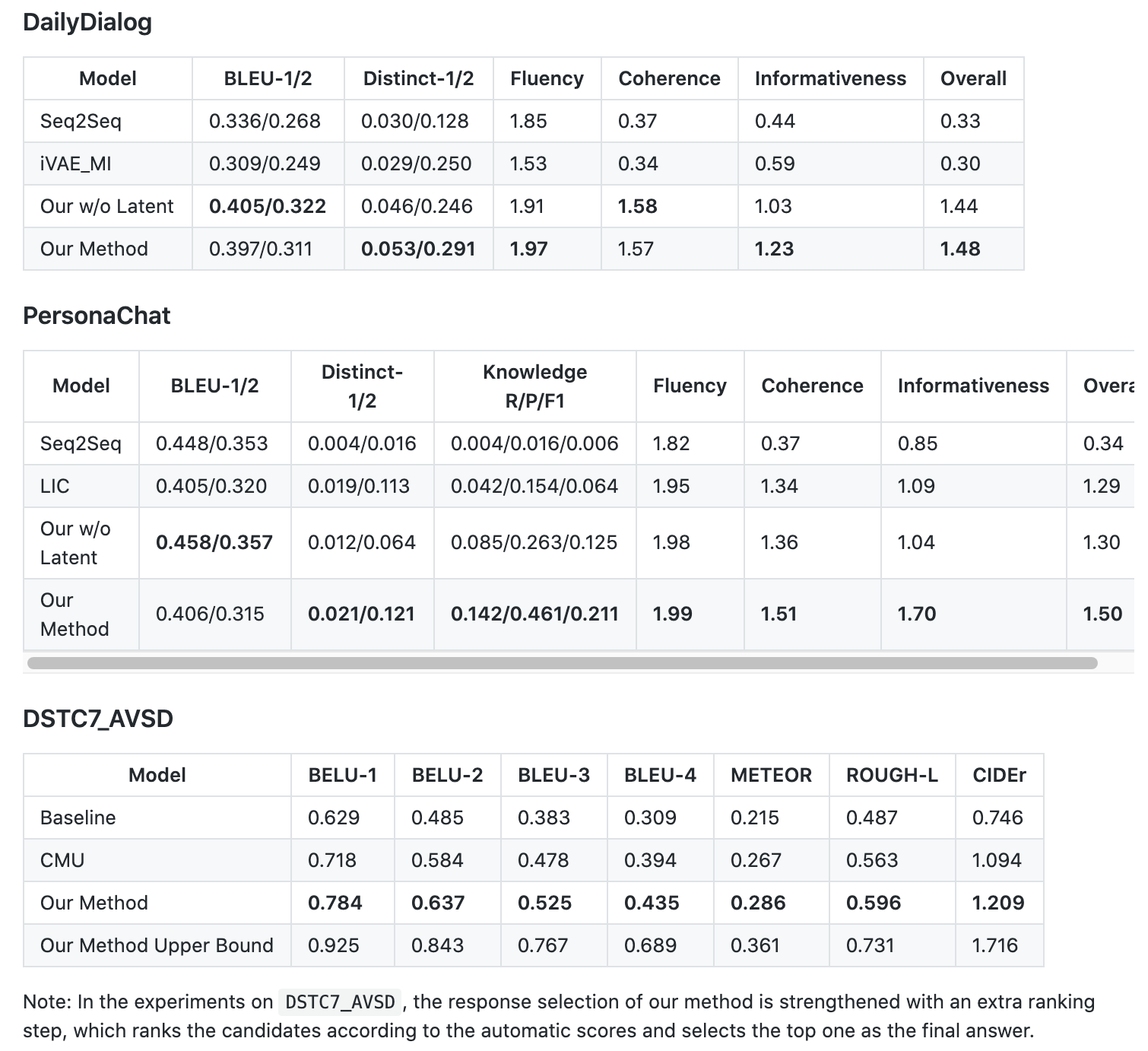

文章最终公布的在三个公开对话数据集上的测试,PLATO都取得了新的最优效果。

为了验证预训练模型的效果,论文在3个公开对话数据集上进行了测试:Persona-Chat、Daily Dialog以及DSTC7-AVSD。

- Persona-Chat是典型的知识聊天任务:两个人讲述自己信息(Persona Profiles),并在对话中尽量了解对方;

- Daily Dialog偏向日常闲聊类型;

- DSTC7-AVSD是对话式问答,根据视频场景信息,两人进行多轮问答,讨论视频中物体和事件。

requirements.txt:

paddlepaddle == 1.6.0

numpy

nltk

tqdm

regex

python3 -m venv env

source env/bin/active

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

在自己机器试了一下,sh scripts/DailyDialog/baseline_infer.sh

必须要GPU?