决策树

什么是决策树?

决策树思想的来源非常朴素,程序设计中的条件分支结构就是if-else结构,最早的决策树就是利用这类结构分割数据的一种分类学习方法 。

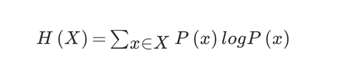

信息熵

H的专业术语称之为信息熵,单位为比特。

公式:

决策树的划分

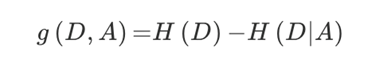

决策树的划分依据之一:信息增益

信息增益表示得知特征X的信息而使得类Y的信息的不确定性减少的程度。

特征A对训练数据集D的信息增益g(D,A),定义为集合D的信息熵H(D)与特征A给定条件下D的信息条件熵H(D|A)之差,即公式为:

信息增益的计算

举例

既然我们有了这两个公式,我们可以根据前面的是否通过例子来通过计算得出我们的决策特征顺序。那么我们首先计算总的经验熵为:

H(D)=-(9/15)log(9/15)-(6/15)log(6/15) = 0.971

然后我们让A1, A2, A3, A4分别表示年龄、有工作、有自己的房子和信贷情况4个特征,则计算出年龄的信息

增益为:

年龄: g(D,A1)=H(D) - [(5/15)H(D1)+(5/15)H(D2)+(5/15)H(D3)]

H(D1) = -(2/5)log(2/5)-(3/5)log(3/5)

H(D2)=-(3/5)log(3/5)-(2/5)log(2/5)

H(D3)=-(4/5)log(4/5)-(1/5)log(1/5)

同理其他的也可以计算出来,g(D,A2)=0.324,g(D,A3)=0.420,g(D,A4)=0.363, 相比较来说其中特征A3 (有自己的房子)的信息增益最大,所以我们选择特征A3为最有特征

常见决策树使用的算法

- ID3

信息增益 最大的准则 - C4.5

信息增益比 最大的准则 - CART

回归树: 平方误差 最小

分类树: 基尼系数 最小的准则 在sklearn中可以选择划分的原则

基尼系数比信息增益的划分更多仔细

知识储备

sklearn决策树API

sklearn.tree.DecisionTreeClassifier(criterion=’gini’,max_depth=None,random_state=None)

- criterion:默认是’gini’系数,也可以选择信息增益的熵’entropy’

- max_depth:树的深度大小

- random_state:随机数种子

- method:

- decision_path:返回决策树的路径

代码演示

from sklearn.tree import DecisionTreeClassifier,export_graphviz

from sklearn.model_selection import train_test_split

from sklearn.feature_extraction import DictVectorizer

import pandas as pd

def decisionTree():

'''

决策树对泰坦尼克号生死进行预测

:return :None

'''

# 数据来源http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt

# 如果获取数据超时,可以选择将数据下载到本地进行

titan = pd.read_csv("http://biostat.mc.vanderbilt.edu/wiki/pub/Main/DataSets/titanic.txt")

# 处理数据,找出特征值和目标值

# 我们提取的数据集中的特征是票的类别,存活,乘坐班,年龄,登陆,home.dest,房间,票,船和性别。

x = titan[['pclass','age','sex']]

y = titan['survived']

# 缺失值处理

x['age'].fillna(x['age'].mean(),inplace=True)

#分割数据到训练集和测试集

x_train, x_test, y_train, y_test = train_test_split(x, y, test_size=0.25)

#进行特征工程处理 特征->类型信息->one_hot编码

dict = DictVectorizer(sparse=False)

x_train = dict.fit_transform(x_train.to_dict(orient="records"))

print(dict.get_feature_names())

x_test = dict.transform(x_test.to_dict(orient="records"))

# print(x_train)

#用决策树进行预测

dec = DecisionTreeClassifier(max_depth=5)

dec.fit(x_train,y_train)

#预测准确率

print("预测的准确率为:",dec.score(x_test,y_test))

#导出决策树的结构

#安装graphviz

#dot -Tpng tree.dot -o tree.png

export_graphviz(dec,out_file='./tree.dot',feature_names=['年龄', 'pclass=1st', 'pclass=2nd', 'pclass=3rd', '女性', '男性'])

return None

if __name__ == "__main__":

decisionTree()

决策树的优缺点以及改进

优点:

- 简单的理解和解释,树木可视化。

- 需要很少的数据准备,其他技术通常需要数据归一化。

缺点:

- 决策树学习者可以创建不能很好地推广数据的过于复杂的树,这被称为过拟合。

- 决策树可能不稳定,因为数据的小变化可能会导致完全不同的树被生成。

改进:

- 减枝cart算法

- 随机森林

减枝cart算法已在决策树的API中实现,DecisionTreeClassifier()中的参数min_samples_split,min_samples_leaf,当树的枝叶少于min_samples_leaf则自动为你剪除该枝叶,可以根据自己的实际需要进行减枝。