半监督

有监督学习就是指我们拥有的数据中已经包括了我们想要预测的数据属性。也叫目标变量。

分类:样本属于多个类别,我们想通过根据数据中已经标明的数据,经过训练来预测没有标明分类的数据属于什么分类。比如经典的手写字识别,利用给出的训练数据集确定10个标签值,再输入预测数据时可预测输入数据属于哪个0-9类别。

回归如果希望的输出是一个或者多个连续的变量,那么称为回归。比如利用三文鱼的年龄和体重去预测其长度。无监督学习 聚类 简而言之无监督学习就是给出了训练的输入数据集,却没有相应的标签数据。所需要的标签数据是经过训练根据输入数据集自主总结出来的,不需要人工进行标签分类。这个称为聚类。

半监督学习 半监督学习指的是既包含部分带标签的数据也有不带标签的数据,通过这些数据来进行学习(不需要所有数据都打上lable可节省人力)在半监督学习中有三个常用的基本假设来建立预测样例和学习目标之间的关系,有以下三个:

1平滑假设、两个样例被稠密数据区域中的边连接时,它们在很大的概率下有相同的类标签; 2聚类假设 两个样例位于同一聚类簇时,它们在很大的概率下有相同的类标签。分类决策边界应该穿过稀疏数据区域 3流形假设

将高维数据嵌入到低维流形中,当两个样例位于低维流形中的一个小局部邻域内时,它们具有相似的类标签。

特征分解 又称谱分解

(Spectral

decomposition)是将矩阵分解为由其特征值和特征向量表示的矩阵之积的方法。需要注意只有对可对角化矩阵才可以施以特征分解。矩阵的谱分解,特征分解,对角化都是同一个概念

拉普拉斯矩阵

什么是拉普拉斯矩阵?

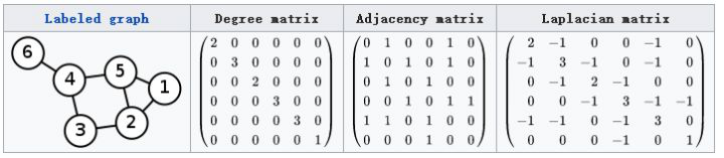

(图傅里叶变换和图卷积)的定义都用到图的拉普拉斯矩阵, 对于图 G=(V,E),其Laplacian 矩阵的定义为 L=D-A,其中 L 是Laplacian 矩阵, D 是顶点的度矩阵(对角矩阵),对角线上元素依次为各个顶点的度, A 是图的邻接矩阵

这里要说明的是:常用的拉普拉斯矩阵实际有三种:

为什么GCN要用拉普拉斯矩阵?(半正定矩阵 可以谱分解)

由于卷积在傅里叶域的计算相对简单,为了在graph上做傅里叶变换,需要找到graph的连续的正交基对应于傅里叶变换的基,因此要使用拉普拉斯矩阵的特征向量。

Spectral graph theory(图谱理论)

简单的概括就是借助于图的拉普拉斯矩阵的特征值和特征向量来研究图的性质,GCN的核心基于拉普拉斯矩阵的谱分解

为什么拉普拉斯矩阵的特征向量可以作为傅里叶变换的基?特征值表示频率?

https://blog.csdn.net/yyl424525/article/details/100058264

基于谱分析做卷积