参考

采样在特征学习中是重要的:论述采样在特征学习中的重要性,有实验证明

不错的讲义:以下基础部分主要参考这个文献

蒙特卡洛采样:蒙特卡洛采样基础参考这部分

Machine Learning_ A Probabilistic Perspective:MH算法的有效性证明参见本书24.3.6

马尔可夫链及吉布斯抽样 入门详解(Markov Chain Monte Carlo and Gibbs Sampling):这个对于Gibbs采样的想法说得很清楚

动机

给定某个分布,如何生成足够多的样本?实际上,这是一个中间问题,因为有很多应用问题需要这一步进行近似推断。

我们更需要关注如何应用采样方法解决实际问题,而不是算法的证明。站在巨人的肩膀上,先理解如何熟练应用。一开始想着做本质改进,一般连最基础的理解都达不到。

函数变换

如果

则

,理由如下:

即, 的概率分布函数为 ,概率密度函数为 .

拒绝采样

对于p(z),假设其非正规化版本

更容易得到。我们找到一个常数

和一个已知分布

使得总有

那么,我们可以通过重复以下步骤进行采样:

- 生成一个 的样本

- 生成一个 的样本

- 如果 就保留 ,作为一个所求样本,否则舍弃 ,继续上述步骤

重要性采样

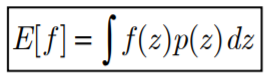

应用在对随机变量期望的估计。期望为

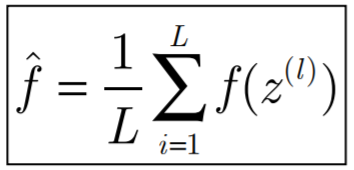

一般对分布

采取

个样本

,使用

进行估计。

但是,我们可以使用另外更加容易采样的分布

来做估计。对

采取

个样本

,然后使用下式

蒙特卡洛采样

这里我们只简单表达它的思想和算法,证明去看Machine Learning_ A Probabilistic Perspective

马尔科夫蒙特卡洛采样算法(MCMC)的基本想法是,找到转移概率,使得所采样分布为对应马尔科夫链的平稳分布。

MH采样算法

如果分布

满足

时, 就是转移概率 对应的马尔科夫链的平稳分布。

但是,这样的转移概率分布是不容易的,我们使用一个先验的转移概率分布

设

为非正规化分布,选择一个先验的转移概率分布

,通过一个接受率

来进行修正。

Gibbs采样算法

对于

元分布

,可以使用本身构造转移概率,得到Gibbs采样算法