谷歌有情怀!谷歌开放大规模音频数据集 AudioSet

导读: 近日,谷歌开放了一个大规模的音频数据集 AudioSet。该数据集包含了 632 类的音频类别以及 2084320 条人工标记的每段 10 秒长度的声音剪辑片段(包括 527 个标签)。此项研究论文已发表于最近正在新奥尔良举办的 IEEE ICASSP 2017 大会上。

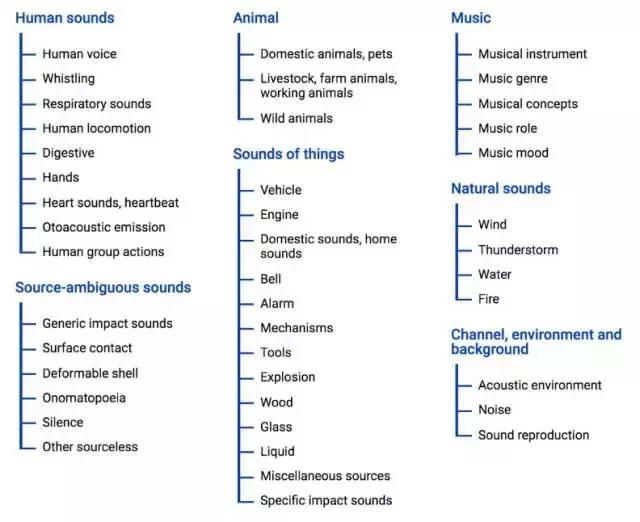

AudioSet 包含了 632 类的音频类别以及 2084320 条人工标记的每段 10 秒长度的声音剪辑片段(片段来自 YouTube 视频)。音频本体 (ontology) 被确定为事件类别的一张层级图,覆盖大范围的人类与动物声音、乐器与音乐流派声音、日常的环境声音。

图:音频本体类别

通过发布 AndioSet,我们希望能为音频事件检测提供一个常见的、实际的评估任务,也是声音事件的综合词汇理解的一个开端。

大型数据收集

该数据集收集了所有与我们合作的人类标注者从 YouTube 视频中识别的声音。我们基于 YouTube 元数据和基于内容的搜索来挑选需要标注的片段。

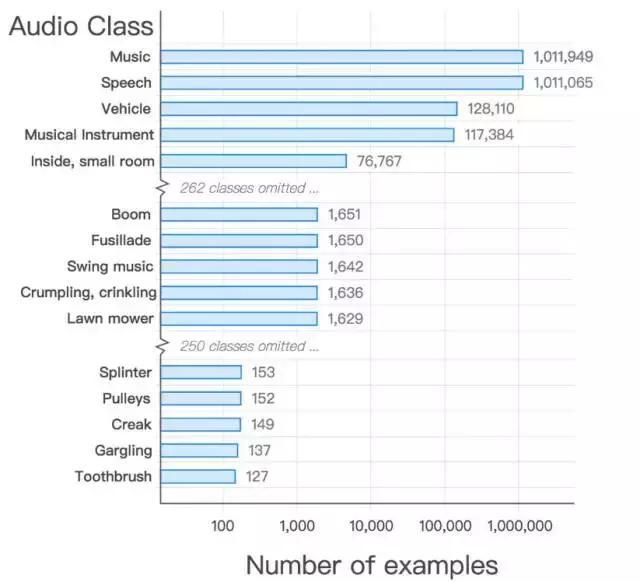

在我们的音频本体中,得到的数据集在音频事件类上有极好的覆盖。

图:每类别样本的数量

在我们 ICASSP 2017 论文中音频本体和数据集的构建有更加具体的描述。你可以在我们 GitHub 知识库中为音频本体作更多补充。数据集与机器提取特征(machine-extracted features)已可以下载 https://github.com/audioset/ontology

此项研究成果已经以论文的形式发表在了 IEEE ICASSP 2017 大会上:

论文:Audio Set: An ontology and human-labeled dataset for audio events

音频事件识别,类似人类识别音频事件并进行关联的能力,是机器感知研究中的一个新生问题。类似问题,比如识别图像中的目标研究已经从广泛数据集——主要是 ImageNet 中获益匪浅。这篇论文描述了大规模人工标记音频事件数据组 Audio Set 的建造过程。该数据组旨在弥合图片和音频研究之间存在的鸿沟。使用文献和人工管理指导下精细建构起来的 635 个音频类别的层级本体,我们搜集了源自人工标记者的大量数据,探查特定音频类别(10 秒时长的 YouTube 音频片段)的现状。建议使用基于元数据、文本(比如链接)以及内容分析的搜索对这些片段进行标记。结果,我们获得了一个宽度和大小都史无前例的数据集,我们希望它能实质上促进高水平音频事件识别程序的发展。