1. Os principais pontos de conhecimento desta seção são resumidos em suas próprias palavras e podem ser acompanhados de figuras e explicar a importância dos pontos de conhecimento .

2. Pensando em que algoritmos de regressão linear podem ser usados? (Todo mundo tenta não escrever duplicatas)

3. Escreva um algoritmo de regressão linear de forma independente, os dados podem ser criados por você mesmo ou obtidos na Internet. (Pontos positivos)

Resposta:

1. Os principais pontos de conhecimento desta seção são resumidos em suas próprias palavras e podem ser acompanhados de figuras e explicar a importância dos pontos de conhecimento.

O conceito de algoritmo de regressão:

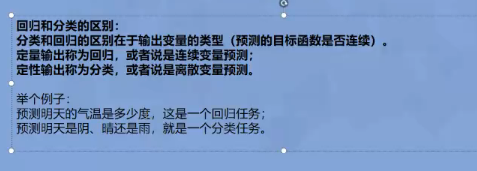

DifferenceA diferença entre regressão e classificação ( por exemplo):

③ Uso de regressão linear: previsão de preços da habitação, previsão de vendas, previsão de cotas de empréstimos;

A regressão linear é dividida em fator único e multifator.O fator único é uma regressão linear única.Se for um fator múltiplo, é uma regressão linear;

Os dados de regressão linear são contínuos;

DefinitionA definição e forma de regressão linear:

TrIntroduza a diferença entre matriz e matriz:

Introdução da função de perda (devido ao erro de regressão linear), também conhecido como método do quadrado mínimo, existem duas maneiras;

Métodos para reduzir erros (estratégia para otimizar a regressão linear); (ênfase)

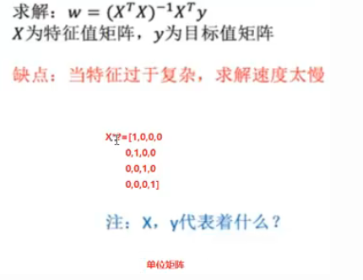

Ⅰ . Equação normal:

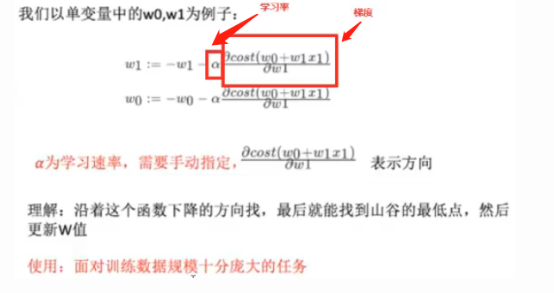

Ⅱ . Descida Gradiente:

O erro é essencial, mas se puder ser minimizado, a precisão do modelo pode ser melhorada.

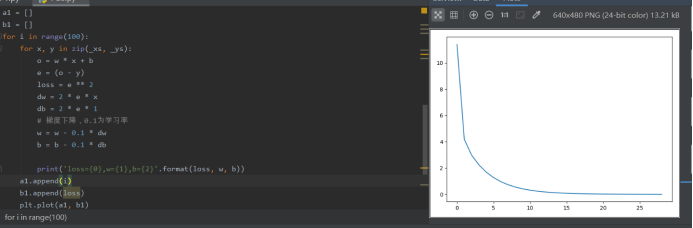

Código de descida do gradiente:

importar aleatoriamente importar matplotlib.pyplot como plt # 数据 x _xs = [0,1 * x para x no intervalo (0, 10 )] _ys = [12 * i + 4 para i em _xs] print (_xs) print (_ys) print (_ys) w = random.random () b = random.random () a1 = [] b1 = [] para i no intervalo (100 ): para x, y em zip (_xs, _ys): o = w * x +b e = (o - y) perda = e ** 2 dw = 2 * e * x db = 2 * e * 1 w = w - 0,1 * dw b = b - 0,1 * db print ( ' loss = {0} , w = {1}, b = {2} ' .format (perda, w, b)) a1.append (i) b1.append (perda) plt.plot (a1, b1) plt.pause ( 0,1 ) plt .exposição()

Os resultados da visualização mostram que, à medida que o treinamento aumenta, a perda continua diminuindo e diminuindo gradualmente.De 20 a 3 iniciais , pode-se saber que o resultado do método de descida do gradiente ainda é satisfatório.

2. Pensando em que algoritmos de regressão linear podem ser usados? (Todo mundo tenta não escrever duplicatas)

Life A vida útil de um produto, como uma câmera, considera os fatores de influência relevantes, como motivos climáticos e tensão;

AnalysisAnálise de crescimento populacional, considerando fatores como renda nacional bruta, taxa de crescimento do índice de preços ao consumidor e PIB per capita ;

③Previse as condições meteorológicas, levando em consideração fatores relevantes, como a cobertura de nuvens e a velocidade do vento.

3. Escreva um algoritmo de regressão linear de forma independente , os dados podem ser criados por você mesmo ou obtidos na Internet. (Pontos positivos)

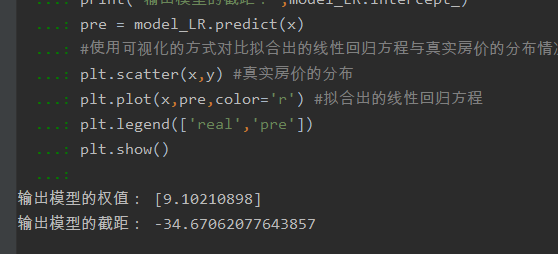

Preveja e visualize os preços das casas em Boston;

O código é o seguinte:

de sklearn.datasets import load_boston de sklearn.linear_model import LinearRegression import matplotlib.pyplot como plt data = load_boston () data_all = data [ ' dados ' ] x = data_all [: 5: 6 ] y = data [ ' target ' ] model_LR = LinearRegression () model_LR.fit (x, y) print ( " 输出 模型 的 权 .co: " , model_LR.coef_) print ( " 输出 模型 的 截距:" , Model_LR.intercept_) pré = model_LR.predict (X) # uso maneira visual da comparação equipado com a equação de regressão linear da distribuição da taxa verdadeira plt.scatter (X, Y) # distribuição taxa real plt.plot ( X, pré, Cor = ' R & lt ' ) # equipada regressão equação plt.legend ([ ' real ' , ' pré ' ]) plt.show ()

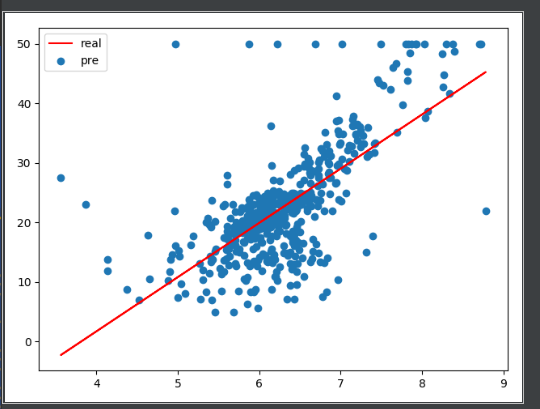

Executar captura de tela:

Resultados da visualização: