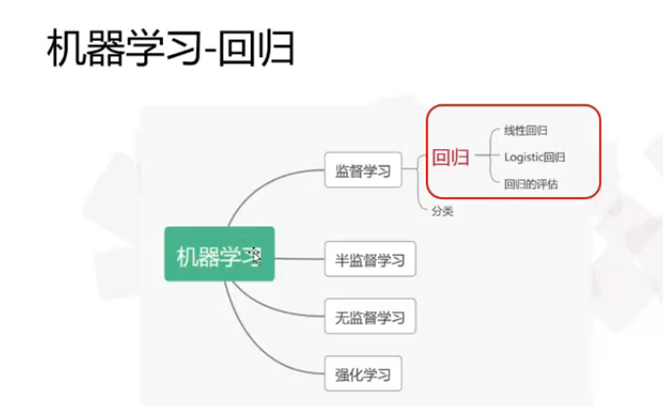

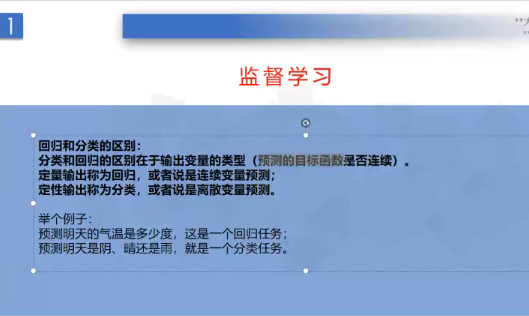

(2) Aprendizado supervisionado: compreensão de regressão e classificação.

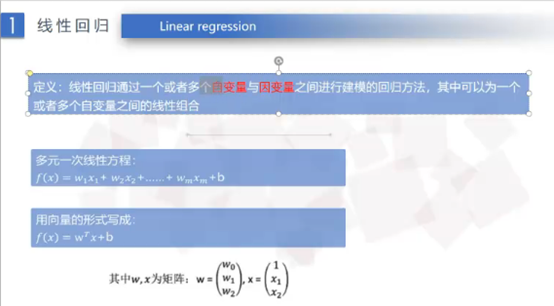

(3) Definição de regressão linear:

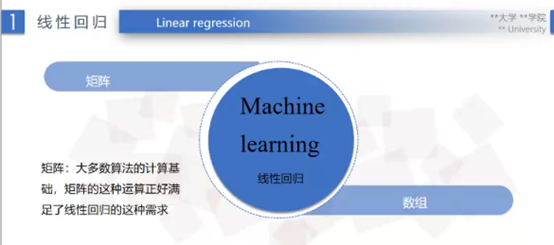

(4) matriz e matriz de algoritmos:

Matriz: matriz 0/1/2 / 3-dimensional; matriz tridimensional é RGB.

Matriz: 1. Deve ser uma matriz bidimensional; 2. Matriz atende aos requisitos de operações especiais.

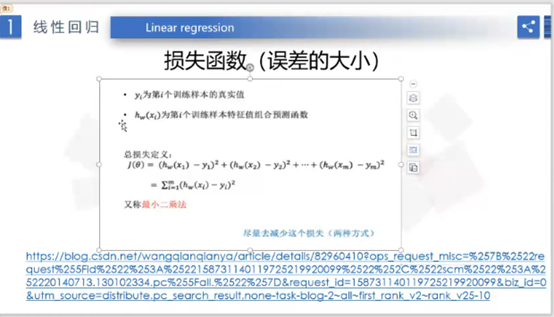

(5) Para reduzir erros, é introduzida uma função de erro:

Site de aprendizagem: https://blog.csdn.net/wangqianqianya/article/details/82960410?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522158731140119725219920099%2522%252C%2522sc%2522%25333%2522405102 255Fall.% 2522% 257D & request_id = 158731140119725219920099 & biz_id = 0 & utm_source = distribut.pc_search_result.none-task-blog-2 ~ all ~ first_rank_v2 ~ rank_v25-10

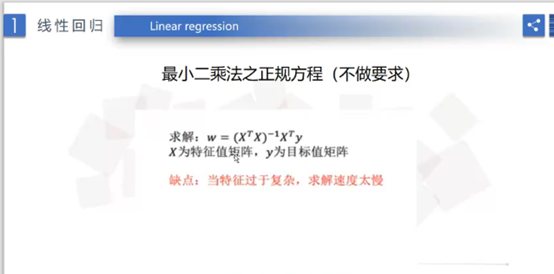

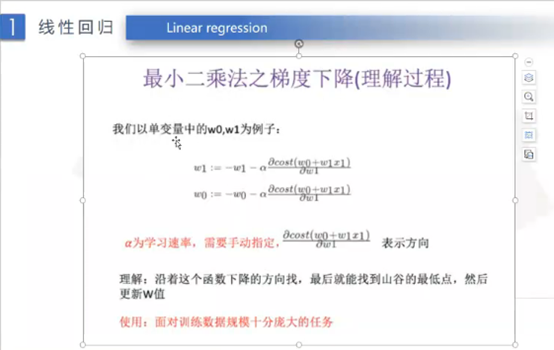

(6) Otimização do algoritmo de aprendizado estatístico: (método dos mínimos quadrados) 1. Equação normal; 2. Descida em gradiente.

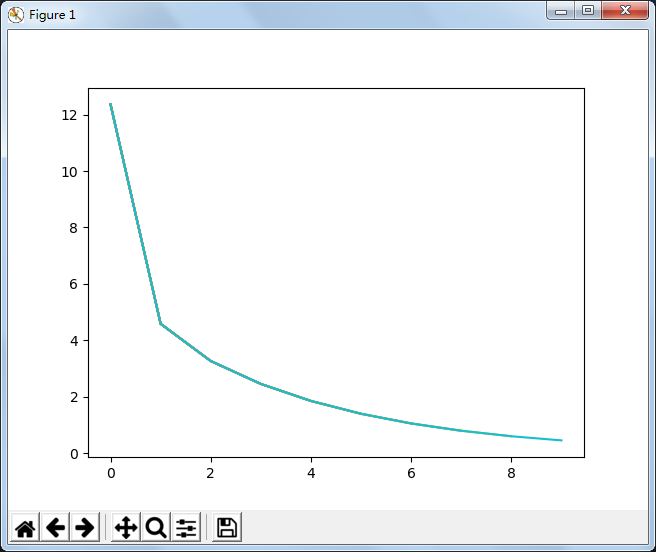

Gráfico dinâmico da otimização da descida do gradiente:

Após 10 ciclos, o valor da perda muda da seguinte forma: web se aproximam gradualmente dos valores de 12, 4.

Após 100 ciclos, o valor da perda muda da seguinte forma: quanto mais w e b estiverem dos valores 12,4.

Código de execução:

importação aleatória

hora de importação

importar matplotlib.pyplot como plt

#New data

_xs = [0,1 * x para x no intervalo (0, 10)]

_ys = [12 * i + 4 para i em _xs]

print (_xs)

print (_ys)

w = random.random () #weight

impressão (w)

b = random.random () #bias

impressão (b)

# y = wx + b

a1 = []

b1 = []

para i na faixa (10):

para x, y em zip (_xs, _ys): #traverse _xs e _ys

print ("x =", x, "y =", y)

o = w * x + b # valor previsto

print ("o =")

e = (o-y) # erro

imprimir ("e =", e)

função loss = e ** 2 #loss

dw = 2 * e * x

db = 2 * e * 1

w = w-0.1 * dw # descida do gradiente w

b = b-0,1 * db # descida do gradiente b

print ('perda = {0}, w = {1}, b = {2}'. formato (perda, w, b))

a1.append (i)

b1.append (perda)

plt.plot (a1, b1)

plt.pause (0,1)

plt.show ()

2. Pensando em que algoritmos de regressão linear podem ser usados? (Todo mundo tenta não escrever duplicatas)

Resposta: A regressão linear é uma previsão variável contínua, que pode prever mudanças contínuas nos dados, como preços específicos da habitação e temperatura do tempo, e pode ser usada como uma ferramenta de previsão para prever os dados de maneira mais científica e precisa.