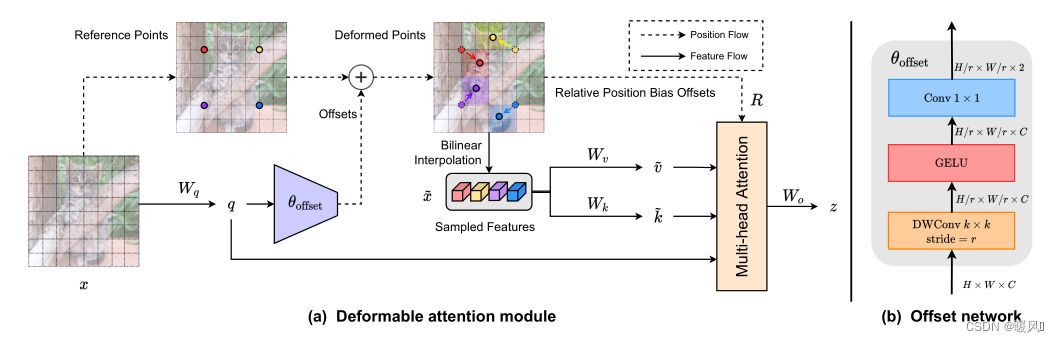

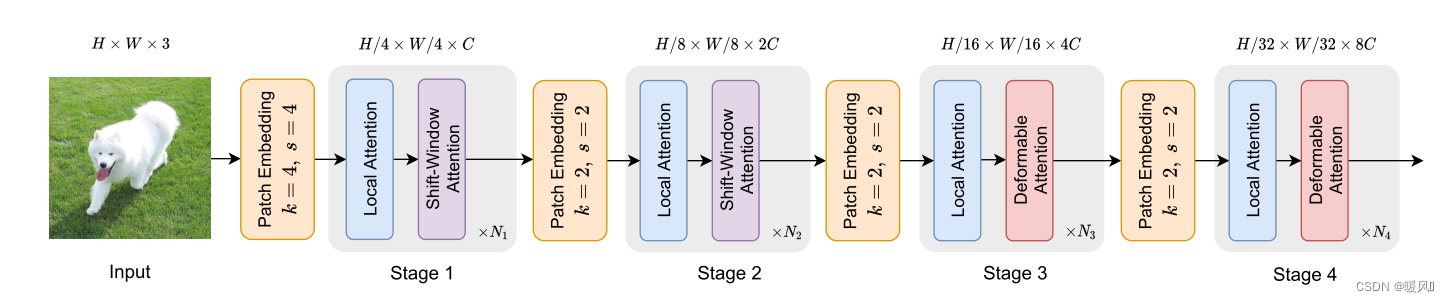

この記事は Swin-Transformer や PVT を改良し、変形可能な機構を追加し、同時に計算量を増やさずにネットワークを制御する. 著者は、q に対応する k の範囲を減らすことで、無関係な干渉を減らすことができると考えています.情報と強化 情報のキャプチャがDCN机制注意モジュールに導入され、新しい注意モジュールが提案されました。変形可能なマルチヘッド注意モジュール- 注意は、k と v の DCN オフセットの後に計算されます。このモジュールを Swin-Transformer の第 3 段階と第 4 段階のスライディング ウィンドウの注意部分に置き換えると、実験のパフォーマンスが向上しました。

元のリンク: Deformable Attention を備えたビジョン トランスフォーマー

ソース コード アドレス: https://github.com/LeapLabTHU/DAT