当你配置好CUDA、cuDNN、tensorflow,并且确保这三者之间的版本对应一致之后,你满怀希望的在终端中输入:

In[1] import tensorflow as tf

In[2] tf.test.is_gpu_available()

结果生活给了你当头一棒:

Out[2]: False

这个时候,不要惊慌,先想一想我上面说的CUDA、cuDNN和tensorflow的版本有没有对应一致,不知道版本对应关系的,可以进这个传送门:官方最新版本对应信息https://blog.csdn.net/flana/article/details/104768188 查看截止到2020年3月10日的官方最新的消息。(如果不对应的话,也可以通过修改lib里面的文件名来达到对应效果 但这种通过修改来达到目的的手段是不稳定的,最好的解决方法还是将三个工具的版本对应一致)

如果确定对应一致,而且环境变量也确认配置正确了,还是返回了False,那么请跟随一下步骤:

1、在桌面右击,打开Nvidia控制面板,若无Nvidia控制面板,则执行步骤2;若有,执行步骤3。

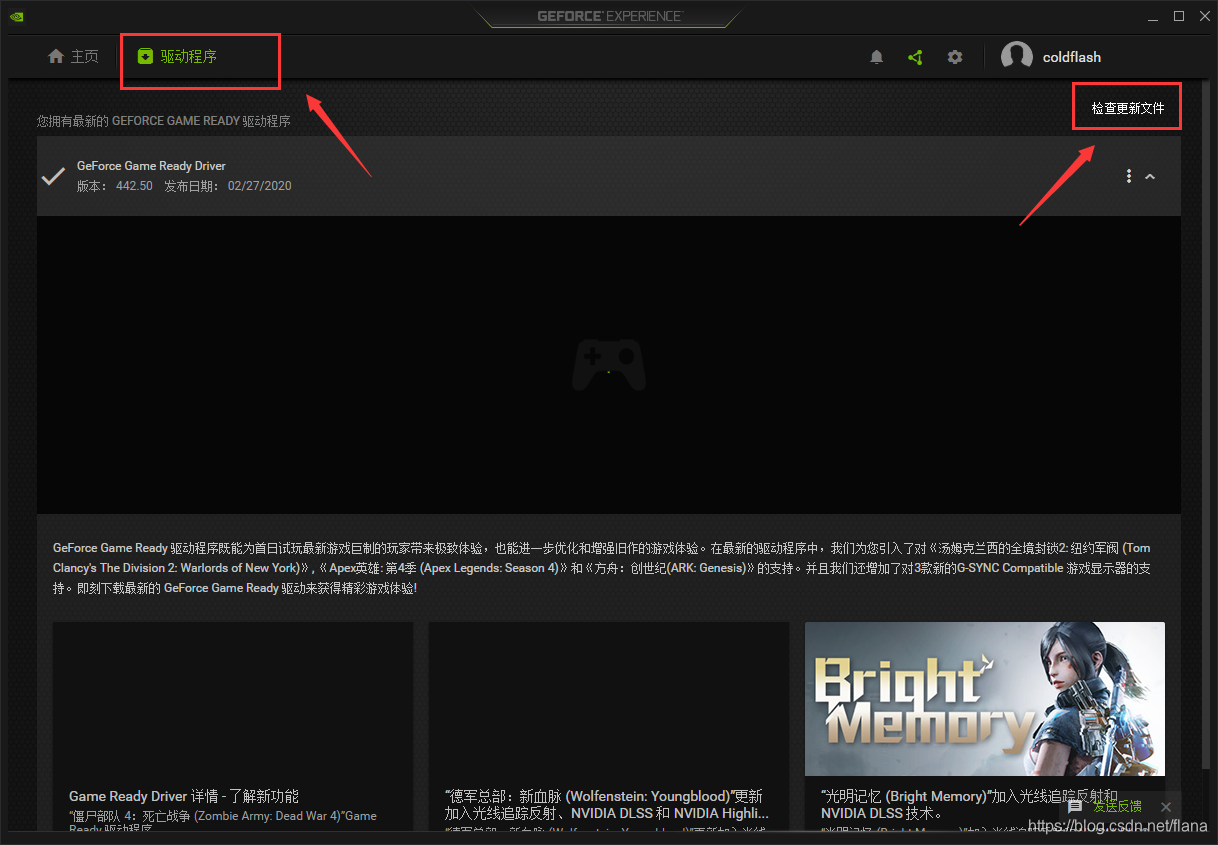

2、下载Nvidia Experience,默认选项安装(大概占用C盘4G容量)。安装完成后,执行步骤1.

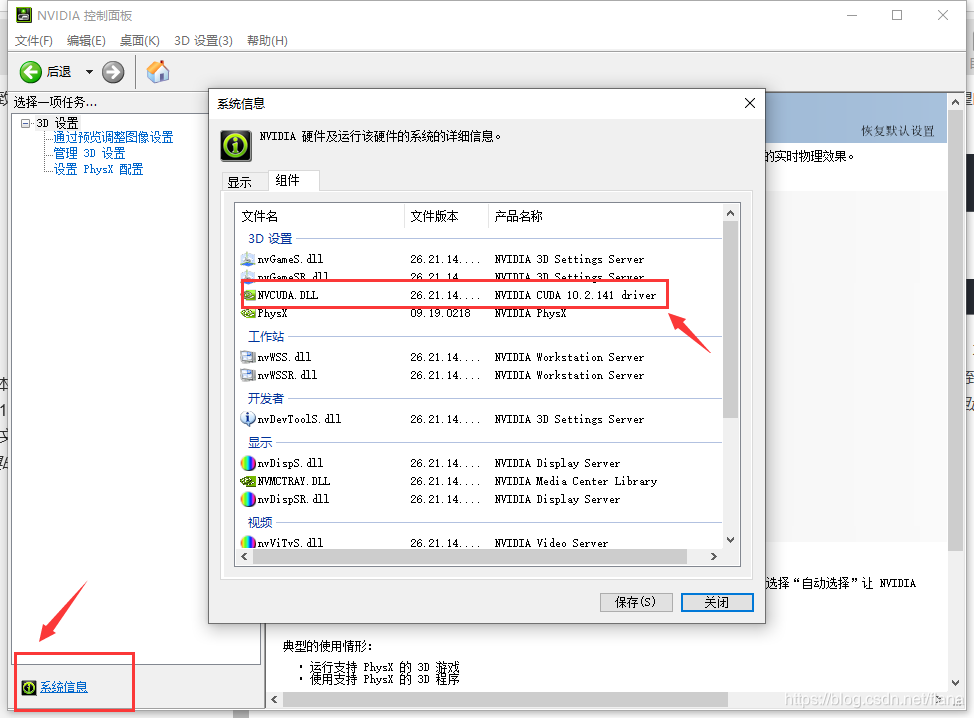

3、打开系统信息。

4、查看CUDA的驱动版本,如果版本太低,到Nvidia Experience更新驱动程序。默认安装即可。

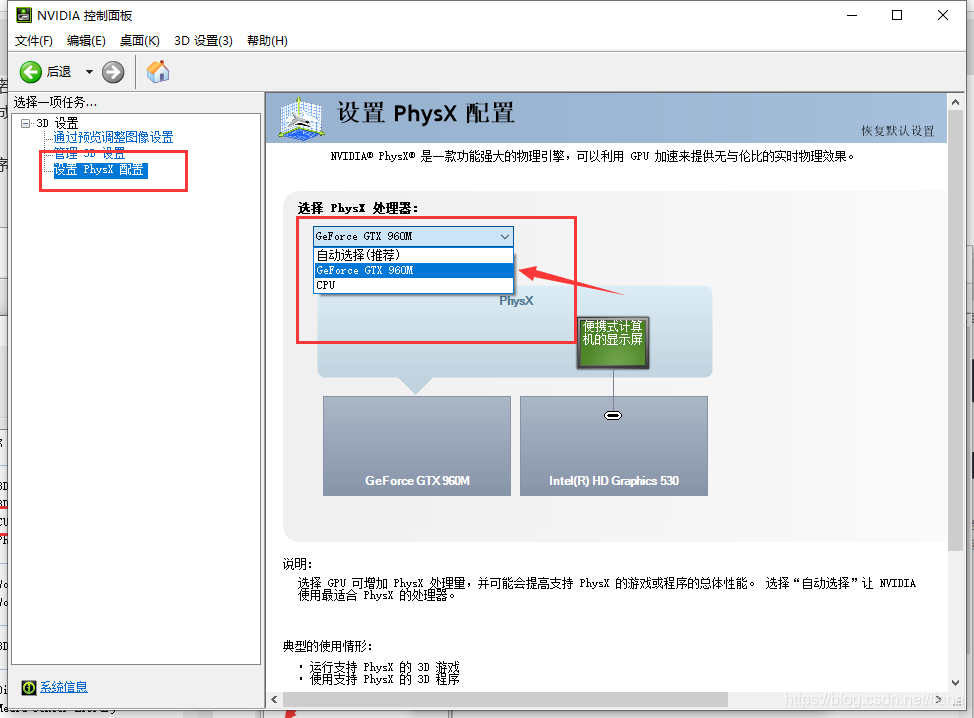

5、安装完之后,顺便把PhysX设置固定为独立显卡。

下面我们再次在终端输入:

In[3] import tensorflow as tf

In[4] tf.test.is_gpu_available()

经过大约10分钟的等待之后(时间由显卡的计算能力决定)

你将会感受到来自科学的甜美气息:

Out[4] True

下面我们就可以继续快乐的使用tensorflow-gpu啦