案例1:实验环境

案例2:部署ceph集群

案例3:创建Ceph块存储

1 案例1:实验环境

1.1 问题

准备四台KVM虚拟机,其三台作为存储集群节点,一台安装为客户端,实现如下功能:

创建1台客户端虚拟机

创建3台存储集群虚拟机

配置主机名、IP地址、YUM源

修改所有主机的主机名

配置无密码SSH连接

配置NTP时间同步

创建虚拟机磁盘

1.2 方案

使用4台虚拟机,1台客户端、3台存储集群服务器,拓扑结构如图-1所示。

图-1

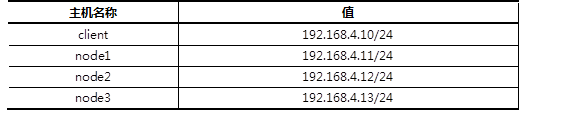

所有主机的主机名及对应的IP地址如表-1所示。

表-1 主机名称及对应IP地址表

1.3 步骤

实现此案例需要按照如下步骤进行。

步骤一:安装前准备

1)物理机为所有节点配置yum源,注意所有的虚拟主机均需要挂载安装光盘。

[root@root9pc01 ~]# yum -y install vsftpd

[root@root9pc01 ~]# mkdir /var/ftp/ceph

[root@root9pc01 ~]# mount -o loop \

rhcs2.0-rhosp9-20161113-x86_64.iso /var/ftp/ceph

[root@root9pc01 ~]# systemctl restart vsftpd

2)修改所有节点yum配置(以node1为例)

[root@node1 ~]# cat /etc/yum.repos.d/ceph.repo

[mon]

name=mon

baseurl=ftp://192.168.4.254/ceph/rhceph-2.0-rhel-7-x86_64/MON

gpgcheck=0

[osd]

name=osd

baseurl=ftp://192.168.4.254/ceph/rhceph-2.0-rhel-7-x86_64/OSD

gpgcheck=0

[tools]

name=tools

baseurl=ftp://192.168.4.254/ceph/rhceph-2.0-rhel-7-x86_64/Tools

gpgcheck=0

3)修改/etc/hosts并同步到所有主机。

[root@node1 ~]# cat /etc/hosts

... ...

192.168.4.10 client

192.168.4.11 node1

192.168.4.12 node2

192.168.4.13 node3

[root@node1 ~]# for i in 10 11 12 13

> do

> scp /etc/hosts 192.168.2.$i:/etc/

> done

3)配置无密码连接。

[root@node1 ~]# ssh-keygen -f /root/.ssh/id_rsa -N ''

[root@node1 ~]# for i in 10 11 12 13

> do

> ssh-copy-id 192.168.4.$i

> done

步骤二:配置NTP时间同步

1)创建NTP服务器。

[root@client ~]# yum -y install chrony

[root@client ~]# cat /etc/chrony.conf

server 0.centos.pool.ntp.org iburst

allow 192.168.4.0/24

local stratum 10

[root@client ~]# systemctl restart chronyd

2)其他所有节点与NTP服务器同步时间(以node1为例)。

[root@node1 ~]# cat /etc/chrony.conf

server 192.168.4.10 iburst

[root@node1 ~]# systemctl restart chronyd

步骤三:准备存储磁盘

1)物理机上为每个虚拟机准备3块磁盘。(可以使用命令,也可以使用图形直接添加)

[root@root9pc01 ~]# cd /var/lib/libvirt/images

[root@root9pc01 ~]# qemu-img create -f qcow2 node1-vdb.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node1-vdc.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node1-vdd.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node2-vdb.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node2-vdc.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node2-vdd.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node3-vdb.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node3-vdc.vol 10G

[root@root9pc01 ~]# qemu-img create -f qcow2 node3-vdd.vol 10G

2)使用virt-manager为虚拟机添加磁盘。

[root@root9pc01 ~]# virt-manager

2 案例2:部署ceph集群

2.1 问题

沿用练习一,部署Ceph集群服务器,实现以下目标:

安装部署工具ceph-deploy

创建ceph集群

准备日志磁盘分区

创建OSD存储空间

查看ceph状态,验证

2.2 步骤

实现此案例需要按照如下步骤进行。

步骤一:部署软件

1)在node1安装部署工具,学习工具的语法格式。

[root@node1 ~]# yum -y install ceph-deploy

[root@node1 ~]# ceph-deploy --help

2)创建目录

[root@node1 ~]# mkdir ceph-cluster

[root@node1 ~]# cd ceph-cluster/

步骤二:部署Ceph集群

1)创建Ceph集群配置。

[root@node1 ceph-cluster]# ceph-deploy new node1 node2 node3

2)给所有节点安装软件包。

[root@node1 ceph-cluster]# ceph-deploy install node1 node2 node3

3)初始化所有节点的mon服务(主机名解析必须对)

[root@node1 ceph-cluster]# ceph-deploy mon create-initial

步骤三:创建OSD

1)准备磁盘分区

[root@node1 ~]# parted /dev/vdb mklabel gpt

[root@node1 ~]# parted /dev/vdb mkpart primary 1M 50%

[root@node1 ~]# parted /dev/vdb mkpart primary 50% 100%

[root@node1 ~]# chown ceph.ceph /dev/vdb1

[root@node1 ~]# chown ceph.ceph /dev/vdb2

//这两个分区用来做存储服务器的日志journal盘

2)初始化清空磁盘数据(仅node1操作即可)

[root@node1 ~]# ceph-deploy disk zap node1:vdc node1:vdd

[root@node1 ~]# ceph-deploy disk zap node2:vdc node2:vdd

[root@node1 ~]# ceph-deploy disk zap node3:vdc node3:vdd

3)创建OSD存储空间(仅node1操作即可)

[root@node1 ~]# ceph-deploy osd create node1:vdc:/dev/vdb1 node1:vdd:/dev/vdb2

//创建osd存储设备,vdc为集群提供存储空间,vdb1提供JOURNAL日志,

//一个存储设备对应一个日志设备,日志需要SSD,不需要很大

[root@node1 ~]# ceph-deploy osd create node2:vdc:/dev/vdb1 node2:vdd:/dev/vdb2

[root@node1 ~]# ceph-deploy osd create node3:vdc:/dev/vdb1 node3:vdd:/dev/vdb2

步骤四:验证测试

-

查看集群状态

[root@node1 ~]# ceph -s

3 案例3:创建Ceph块存储

3.1 问题

沿用练习一,使用Ceph集群的块存储功能,实现以下目标:

创建块存储镜像

客户端映射镜像

创建镜像快照

使用快照还原数据

使用快照克隆镜像

删除快照与镜像

3.2 步骤

实现此案例需要按照如下步骤进行。

步骤一:创建镜像

1)查看存储池。

[root@node1 ~]# ceph osd lspools

0 rbd,

2)创建镜像、查看镜像

[root@node1 ~]# rbd create demo-image --image-feature layering --size 10G

[root@node1 ~]# rbd create rbd/image --image-feature layering --size 10G

[root@node1 ~]# rbd list

[root@node1 ~]# rbd info demo-image

rbd image 'demo-image':

size 10240 MB in 2560 objects

order 22 (4096 kB objects)

block_name_prefix: rbd_data.d3aa2ae8944a

format: 2

features: layering

步骤二:动态调整

1)缩小容量

[root@node1 ~]# rbd resize --size 7G image --allow-shrink

[root@node1 ~]# rbd info image

2)扩容容量

[root@node1 ~]# rbd resize --size 15G image

[root@node1 ~]# rbd info image

步骤三:通过KRBD访问

1)集群内将镜像映射为本地磁盘

[root@node1 ~]# rbd map demo-image

/dev/rbd0

[root@node1 ~]# lsblk

… …

rbd0 251:0 0 10G 0 disk

[root@node1 ~]# mkfs.xfs /dev/rbd0

[root@node1 ~]# mount /dev/rbd0 /mnt

2)客户端通过KRBD访问

#客户端需要安装ceph-common软件包

#拷贝配置文件(否则不知道集群在哪)

#拷贝连接密钥(否则无连接权限)

[root@client ~]# yum -y install ceph-common

[root@client ~]# scp 192.168.4.11:/etc/ceph/ceph.conf /etc/ceph/

[root@client ~]# scp 192.168.4.11:/etc/ceph/ceph.client.admin.keyring \

/etc/ceph/

[root@client ~]# rbd map image

[root@client ~]# lsblk

[root@client ~]# rbd showmapped

id pool image snap device

0 rbd image - /dev/rbd0

-

客户端格式化、挂载分区

[root@client ~]# mkfs.xfs /dev/rbd0

[root@client ~]# mount /dev/rbd0 /mnt/

[root@client ~]# echo “test” > /mnt/test.txt

步骤四:创建镜像快照

-

查看镜像快照

[root@node1 ~]# rbd snap ls image

-

创建镜像快照

[root@node1 ~]# rbd snap create image --snap image-snap1

[root@node1 ~]# rbd snap ls image

SNAPID NAME SIZE

4 image-snap1 15360 MB -

删除客户端写入的测试文件

[root@client ~]# rm -rf /mnt/test.txt

-

还原快照

[root@node1 ~]# rbd snap rollback image --snap image-snap1

#客户端重新挂载分区

[root@client ~]# umount /mnt

[root@client ~]# mount /dev/rbd0 /mnt/

[root@client ~]# ls /mnt

步骤四:创建快照克隆

1)克隆快照

[root@node1 ~]# rbd snap protect image --snap image-snap1

[root@node1 ~]# rbd snap rm image --snap image-snap1 //会失败

[root@node1 ~]# rbd clone \

image --snap image-snap1 image-clone --image-feature layering

//使用image的快照image-snap1克隆一个新的image-clone镜像

2)查看克隆镜像与父镜像快照的关系

[root@node1 ~]# rbd info image-clone

rbd image 'image-clone':

size 15360 MB in 3840 objects

order 22 (4096 kB objects)

block_name_prefix: rbd_data.d3f53d1b58ba

format: 2

features: layering

flags:

parent: rbd/image@image-snap1

#克隆镜像很多数据都来自于快照链

#如果希望克隆镜像可以独立工作,就需要将父快照中的数据,全部拷贝一份,但比较耗时!!!

[root@node1 ~]# rbd flatten image-clone

[root@node1 ~]# rbd info image-clone

rbd image 'image-clone':

size 15360 MB in 3840 objects

order 22 (4096 kB objects)

block_name_prefix: rbd_data.d3f53d1b58ba

format: 2

features: layering

flags:

#注意,父快照信息没了!

步骤四:其他操作

1) 客户端撤销磁盘映射

[root@client ~]# umount /mnt

[root@client ~]# rbd showmapped

id pool image snap device

0 rbd image - /dev/rbd0

//语法格式:

[root@client ~]# rbd unmap /dev/rbd/{poolname}/{imagename}

[root@client ~]# rbd unmap /dev/rbd/rbd/image

2)删除快照与镜像

[root@node1 ~]# rbd snap rm image --snap image-snap

[root@node1 ~]# rbd list

[root@node1 ~]# rbd rm image